.前提是hadoop已经安装配置成功

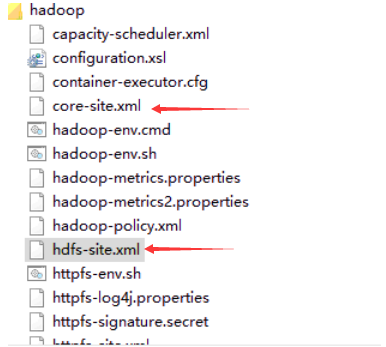

2.主要是修改core-site.xml和hdfs-site.xml这两个配置文件

3.我使用的是notepad++连接Linux进行修改的

4.进入notepad++中查看目录找到这两个配置文件

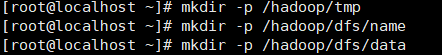

5.首先要在Linux中建立存放name和data的文件

进入Linux输入命令如下

创建三个文件夹

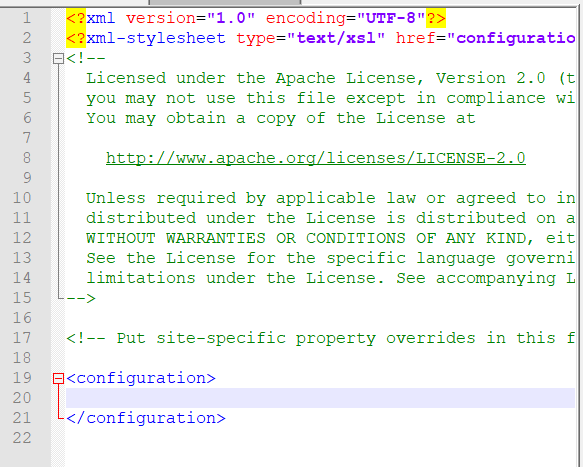

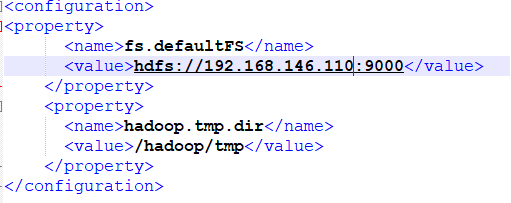

6.编辑core-site.xml

开始为空

配置

fs.defaultFS hadoop访问目录节点nameNode默认

hadoop.tmp.dir Hadoop的临时存放目录

保存!!!!

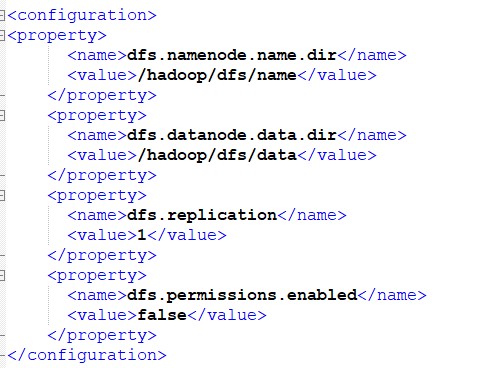

7.编辑hdfs-site.xml

开始为空

配置

dfs.namenode.name.dir NN存放元数据和日志位置

dfs.datanode.data.dir 配置hdfs每个数据节点存放位置

dfs.replication 配置系统自动数据备份数量为3份(默认是3份)(伪分布设为1)

dfs.ha.automatic-failover.enabled 是否开启自动故障转移 false

保存!!!!

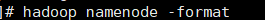

8.进入Linux输入命令启动hdfs

(1)首先格式化

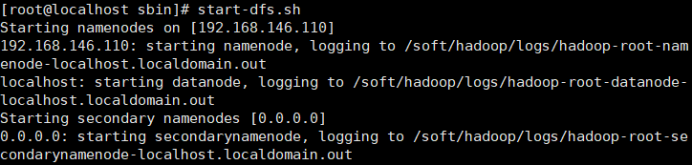

(2)进入到hadoop的sbin中,其中有启动服务

(3)启动成功如下

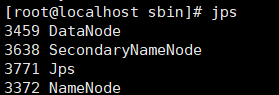

(4)输入jps命令,可以看到以下已运行的结点

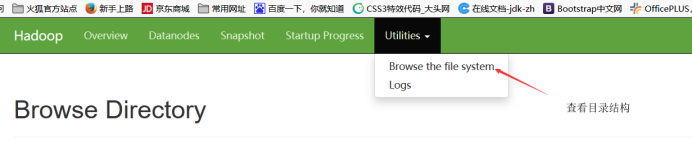

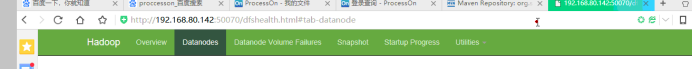

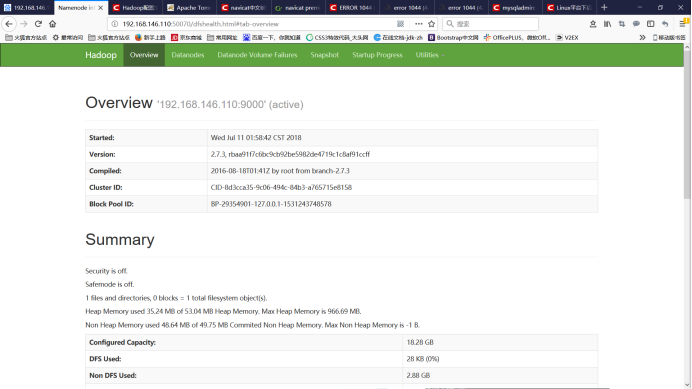

9.可以在Windows下查看

在浏览器输入自己的IP,端口为50070

有如下界面

可查看存放的文件目录,也可下载