原文链接:http://tecdat.cn/?p=23344

原文出处:拓端数据部落公众号

在许多网站上都可以找到一个流行的德国信贷数据集german_credit,其中包含了银行贷款申请人的信息。该文件包含1000名申请人的20条信息。

下面的代码可以用来确定申请人是否有信用,以及他(或她)是否对贷款人有良好的信用风险。有几种方法被应用到数据上,帮助做出这种判断。在这个案例中,我们将看一下这些方法。

请注意,本例可能需要进行一些数据处理,以便为分析做准备。

我们首先将数据加载到R中。

-

-

credit <- read.csv(credit, header = TRUE, sep = ',')

这段代码在数据上做了一个小的处理,为分析做准备。否则,就会出现错误,因为在某些文件的某一列中发现有四类因素。

基本上,任何4类因变量都被覆盖为3类。继续进行分析。

No.of.Credits[No.of.Credits == 4] <- 3快速浏览一下数据,了解一下我们的工作内容。

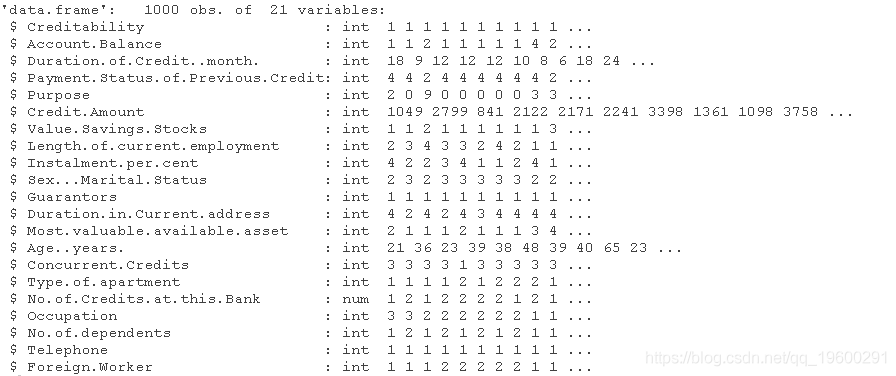

str(credit)

你可能会立即注意到有几个变量很显眼。我们要排除它们。"信贷期限(月)"、"信贷金额 "和 "年龄"。

为什么?

我们在这个模型中试图把重点放在作为信用价值指标的数据分类或类别上。这些是分类变量,而不是数字变量。申请人有电话吗?申请人是否已婚?是否有共同签署人?申请人在同一地址住了多长时间?这类事情。

关于这些因素,重要的是我们知道它们与贷款决定的关系。良好的信用与某些因素的组合有关,从而使我们可以用概率将新的申请人按其特征进行分类。

在数据中,这些问题的答案不是 "是 "或 "不是 "或 "十年"。答案被分组为更广泛的分类。

我们需要做的是删除真正的数字数据(时间、金额和年龄),保留分类因素。我们排除选定列。

然后我们创建一个简短的函数,将整数转换成因子。

for(i in S) credit[, i] <- as.factor(credit[, i])现在我们有了有用的数据,我们可以开始应用不同的分析方法。

方法一:逻辑回归(Logistic Regression)

第一步是创建我们的训练数据集和测试数据集。训练集用于训练模型。测试集则用于评估模型的准确性。

我们把数据集分成任何我们喜欢的大小,在这里我们使用三分之一,三分之二的分割。

(1:nrow(credit))[-sample(1:nrow(credit), size = 333)]在这个阶段,我们将使用glm()函数进行Logistic回归。在这里,我们有选择地使用模型中的变量。但现在只是用五个变量来确定信用度的值。

LogisticModel<- glm(Credit ~ Account + Payment + Purp + Length.of.current + Sex, family = binomial, data = credit)完成后,我们继续将我们刚刚创建的模型拟合到测试集i_test1上,并准备进行第一次预测。

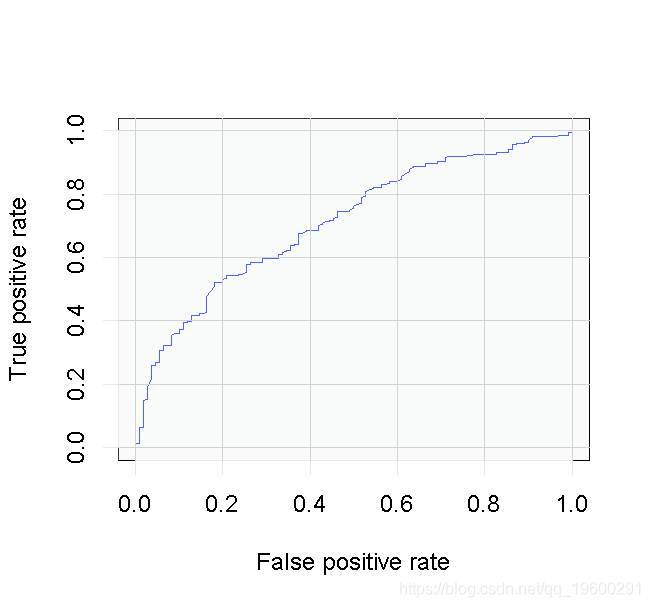

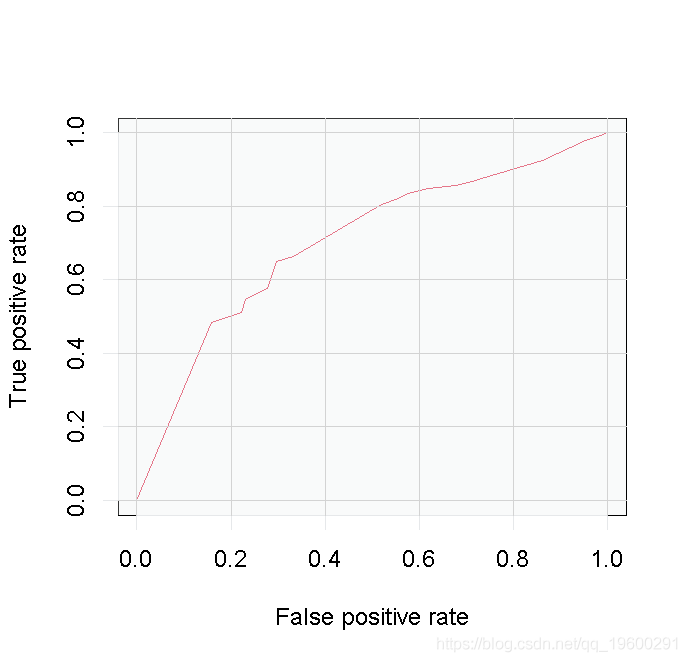

我们已经拟合了模型。现在我们将使用ROCR包来创建预测,并以曲线下面积(AUC)来衡量性能。AUC越大,说明我们的模型表现越好。

-

-

perf1 <- performance(pred1, 'tpr', 'fpr')

让我们描绘一下结果。

我们将通过寻找AUC来结束这一部分。

AUCLog1![]()

这不是一个糟糕的结果,但让我们看看是否可以用不同的方法做得更好。

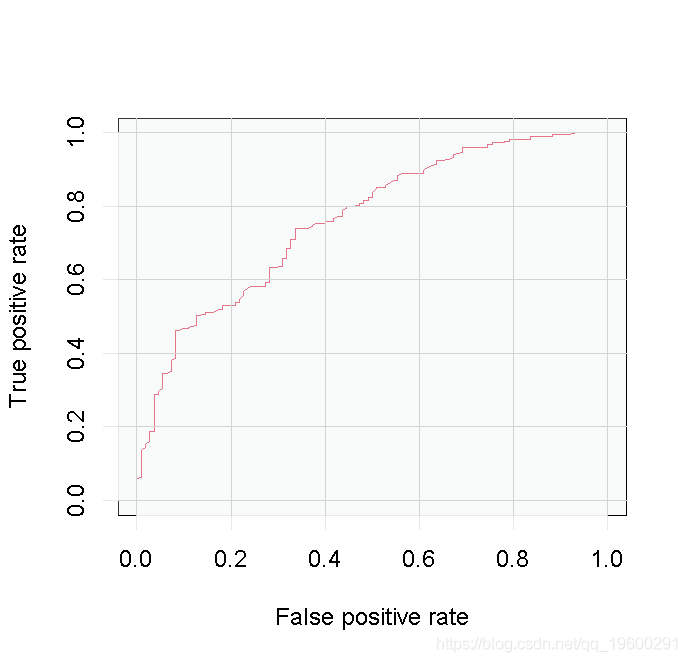

方法二:另一种Logistic模型

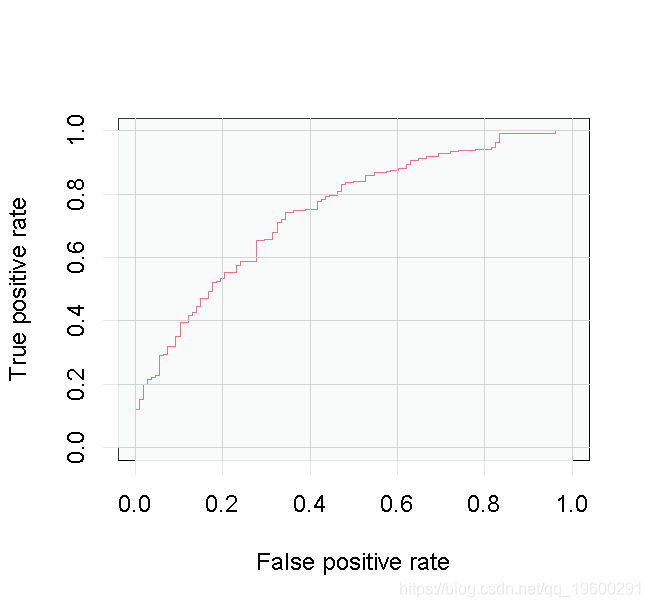

在这种方法中,我们将建立第二个Logistic逻辑模型来利用我们数据集中的所有变量。其步骤与上述第一个模型相同。

-

-

perf2 <- performance(pred2, 'tpr', 'fpr')

-

plot(perf2)

AUCLog2![]()

包括所有的变量,我们并没有得到多少改善。一个好的规则是尽可能保持模型的简单。增加更多的变量会带来很少的改善,所以坚持使用更简单的模型。

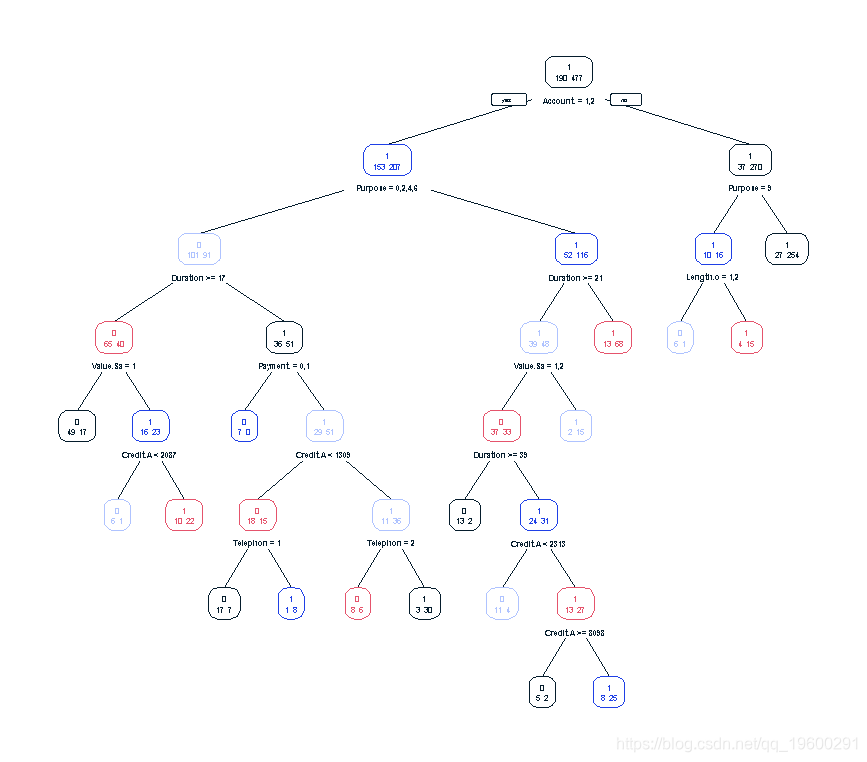

方法三:回归树

接下来,让我们试着用回归树的方法来分析数据。我们的大部分代码与上述逻辑模型中使用的代码相似,但我们需要做一些调整。

请再次注意,我们正在研究我们模型中的所有变量,找到它们对我们感兴趣的变量--信用度的影响。

-

-

TreeModel <- rpart(Creditability ~ ., data = credit[i_calibration1, ])

-

library(rpart.plot)

-

prp(TreeModel, type = 2, extra = 1)

-

-

perf3 <- performance(pred3, 'tpr', 'fpr')

-

plot(perf3)

![]()

考虑到我们的树状模型的复杂性,这些结果并不令人满意,所以我们不得不再次怀疑第一个例子中更简单的Logistic Regression模型是否更好。

方法四:随机森林

与其建立一棵决策树,我们可以使用随机森林方法来创建一个决策树 "森林"。在这种方法中,最终结果是类的模式(如果我们正在研究分类模型)或预测的平均值(如果我们正在研究回归)。

随机森林背后的想法是,决策树很容易过度拟合,所以找到森林中的 "平均 "树可以帮助避免这个问题。

你可以想象,这比创建一棵决策树在计算上要求更高,但R可以很好地处理这一工作。

randomForest(Credit ~ )

![]()

通过努力,我们得到了一个有点改进的结果。随机森林模型是我们所尝试的四个模型中表现最好的。但是,这需要判断结果是否值得付出额外的努力。

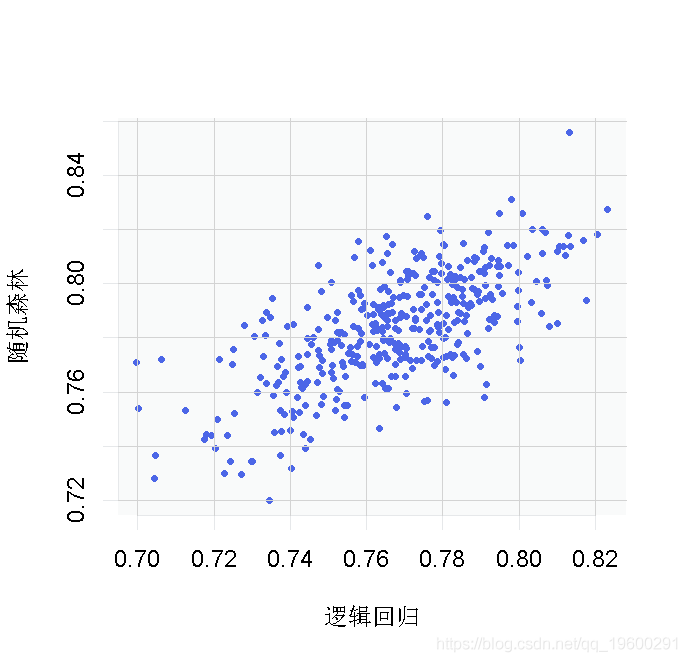

方法五:比较随机森林和Logistic模型

好了,我们已经看了使用两种基本分析方法的各种结果--逻辑回归和决策树。我们只看到了以AUC表示的单一结果。

随机森林方法要求我们创建一个决策树的森林,并取其模式或平均值。为什么不利用所有这些数据呢?它们会是什么样子呢?

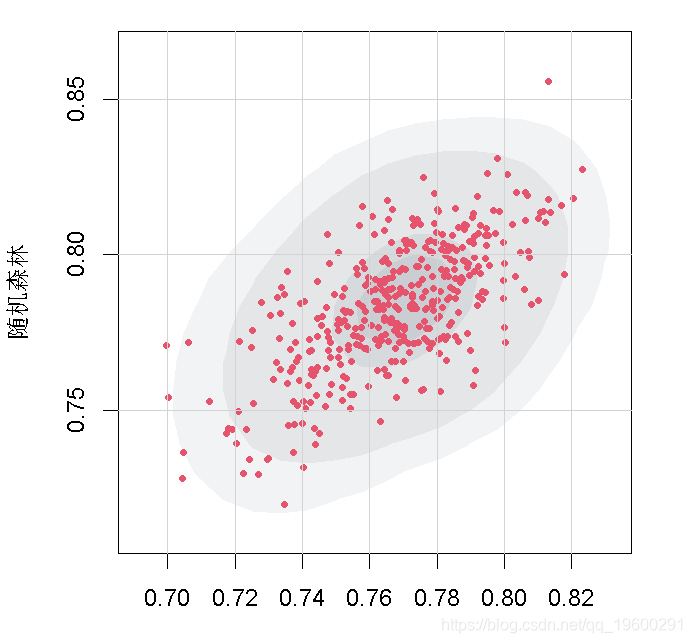

下面的代码创建了一个图表,描述了我们的随机森林中每棵树的AUC分数和逻辑模型的数百种组合。

首先我们需要一个函数来进行分析。

-

function(i){

-

i_test2 <- sample(1:nrow(credit), size = 333)

-

-

summary(LogisticModel.3)

-

fitLog3 <- predict(LogisticModel.3, type = 'response', newdata = credit[i_test2,

这部分代码的运行需要一段时间,因为我们要对数百个单独的结果进行列表和记录。你可以通过改变VAUC对象中的计数来调整模型中的结果数量。在这里,我们选择计算200个x-y对,或400个单独的结果。

plot(t(VC))

你可以看到,我们从前四个模型中得到的结果正好处于分布的中间。

这为我们证实了这些模型都是有可比性的。我们所希望的最好结果是AUC达到0.84,而且大多数人给我们的结果与我们已经计算的结果相似。

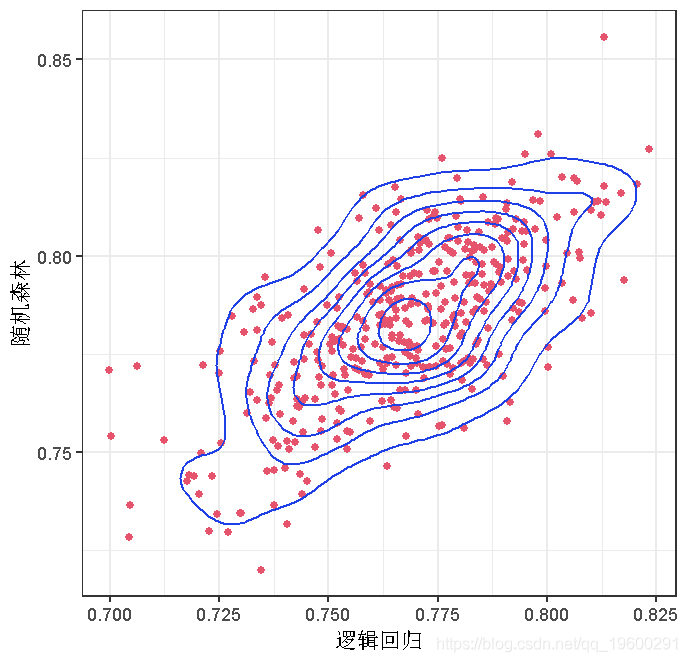

但是,让我们试着更好地可视化。

首先,我们将对象转换成一个数据框架。

我们创建几个新图。第一个是密度等高线图。

plot(AA, aes(x = V1, y = V2)

第二张是高密度等高线图,给我们提供了数据的概率区域。

-

-

with(AA, boxplot(V1, V2))

无论我们以何种方式描述我们的结果,都必须使用数据来做出合理的贷款决定。这里有一个问题?

这些可能是我们使用这些模型所能得出的最佳分数,但这些结果对于确定贷款申请人的信用价值是否可以接受?这取决于贷款机构所使用的信用标准。

在最好的情况下,看起来我们的模型给了82%的机会向良好的信用风险提供贷款。对于每100万元的贷款,我们最多可能期望得到82万元的偿还。平均而言,我们预计会收回大约78万元的本金。换句话说,根据我们的分析,有75%到80%的机会重新获得100万元的贷款,这取决于我们使用的建模方法。

当我们把贷款申请人加入我们的数据库时,如果我们要把他们视为良好的信贷风险,我们希望他们聚集在高密度图的最暗区域。

除非我们收取大量的利息来弥补我们的损失,否则我们可能需要更好的模型。

最受欢迎的见解

3.python中使用scikit-learn和pandas决策树

7.用机器学习识别不断变化的股市状况——隐马尔可夫模型的应用