第一步:

下载和解压

假设我们将其解压到D:softwarekafka_2.11-1.1.0目录

第二步:启动服务

kafka依赖于zookeeper,所以,需要先启动zookeeper,使用kafka内置的脚本启动即可(可以不用自己下载)

cd D:softwarekafka_2.11-1.1.0

bin/windows/zookeeper-server-start.bat config/zookeeper.properties

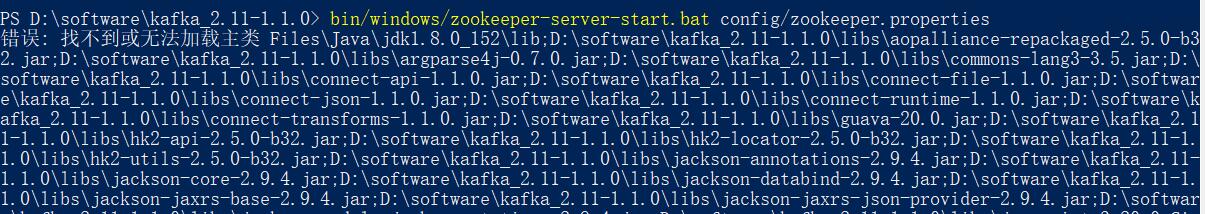

然后会发下,报错了,报错内容如下:

错误: 找不到或无法加载主类 FilesJavajdk1.8.0_152lib;D:softwarekafka_2.11-1.1.0libsaopalliance-repackaged-2.5.0-b32.jar;D:softwarekafka_2.11-1.1.0libsargparse4j-0.7.0.jar;D:softwarekafka_2.11-1.1.0libscommons-lang3-3.5.jar;D:softwarekafka_2.11-1.1.0libsconnect-api-1.1.0.jar;D***

原因是java的安装的目录有空格,但是,在kafka的脚本中,设置classpath的时候,没有加入双引号

修改的方法是:

找到安装目录/bin/windows/kafka-run-class.bat ,找到

set COMMAND=%JAVA% %KAFKA_HEAP_OPTS% %KAFKA_JVM_PERFORMANCE_OPTS% %KAFKA_JMX_OPTS% %KAFKA_LOG4J_OPTS% -cp %CLASSPATH% %KAFKA_OPTS% %*

修改为:

set COMMAND=%JAVA% %KAFKA_HEAP_OPTS% %KAFKA_JVM_PERFORMANCE_OPTS% %KAFKA_JMX_OPTS% %KAFKA_LOG4J_OPTS% -cp "%CLASSPATH%" %KAFKA_OPTS% %*

就是在%CLASSPATH%上加了一个双引号

然后再次尝试执行启动zookeeper的脚本,这就启动成功了

然后启动kafka:

bin/windows/kafka-server-start.bat config/server.properties

第三步:创建一个topic

我们用一个分区和一个副本创建一个名为“test”的topic:

bin/windows/kafka-topics.bat --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic test

执行下面的命令来查看topic,可以看到刚刚创建的test的topic

.inwindowskafka-topics.bat --list --zookeeper localhost:2181

test

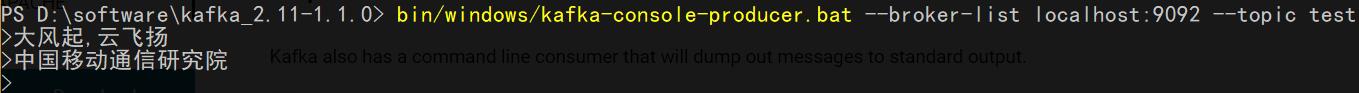

第四步:发送消息

Kafka带有一个命令行客户端,它将从文件或标准输入中获取输入,并将其作为消息发送到Kafka集群。默认情况下,每行将作为单独的消息发送。

运行生产者,然后在控制台中输入几条消息发送到服务器。

bin/windows/kafka-console-producer.bat --broker-list localhost:9092 --topic test

每一个就是一条消息,如果不需要再发送,就可以CTRL + C 把这个进程停掉即可

第五步:启动一个消费者

卡夫卡也有一个命令行消费者,将消息转储到标准输出。

bin/windows/kafka-console-consumer.bat --bootstrap-server localhost:9092 --topic test --from-beginning

如果您将上述每个命令都在不同的终端中运行,那么您现在应该能够将消息键入生产者终端,并将它们显示在消费者终端中。

所有的命令行工具都有其他选项;在没有参数的情况下运行该命令将显示更详细地记录它们的使用信息。

第六步:设置多broker群集

首先,我们为每个broker创建配置文件:

copy config/server.properties config/server-1.properties

copy config/server.properties config/server-2.properties

然后,编辑这些新文件,并设置以下的属性:

config/server-1.properties:

broker.id=1

listeners=PLAINTEXT://:9093

log.dir=/tmp/kafka-logs-1

config/server-2.properties:

broker.id=2

listeners=PLAINTEXT://:9094

log.dir=/tmp/kafka-logs-2

broker.id属性是集群中每个节点的唯一且永久的名称。我们必须重写端口和日志目录,因为我们在同一台机器上运行这些端口和日志目录,并且我们希望让所有代理都试图在同一个端口上注册或覆盖彼此的数据。

我们已经有Zookeeper和我们的单节点了,所以我们只需要启动两个新节点:

bin/windows/kafka-server-start.bat config/server-1.properties

bin/windows/kafka-server-start.bat config/server-2.properties

现在创建一个复制因子为三的新topic:

bin/windows/kafka-topics.bat --create --zookeeper localhost:2181 --replication-factor 3 --partitions 1 --topic my-replicated-topic

现在我们有一个集群,我们怎么知道哪个broker在做什么?要查看运行“描述主题”命令:

bin/windows/kafka-topics.bat --describe --zookeeper localhost:2181 --topic my-replicated-topic

这里是对输出的解释。第一行给出了所有分区的摘要,每个附加行提供了有关一个分区的信息。由于我们只有一个分区,所以只有一行。

leader是负责给定分区的所有读写操作的节点。每个节点将成为分区随机选择部分的leader

replicas是复制此分区的日志的节点列表,无论他们是领导者还是他们仅仅只活着

isr是一组同步中的副本。这是复制品列表的子集,目前活着并被引导到leader身边

请注意,在我的示例中,节点1是该主题唯一分区的leader

我们可以在我们创建的原始主题上运行相同的命令,以查看它的位置:

bin/windows/kafka-topics.bat --describe --zookeeper localhost:2181 --topic test

所以在这里并不奇怪 - 原始主题没有副本,并且在服务器0上,它是我们创建群集时唯一的服务器。

给新的主题发送一些消息:

bin/windows/kafka-console-producer.bat --broker-list localhost:9092 --topic my-replicated-topic

消费这些消息:

bin/windows/kafka-console-consumer.bat --bootstrap-server localhost:9092 --from-beginning --topic my-replicated-topic

现在,我们测试容错,因为broker1是leader,所以我们将它的进程停掉

wmic process where "caption = 'java.exe' and commandline like '%server-1.properties%'" get processid

得到的进程信息如下:

ocessid

ProcessId

8824

杀掉这个进程

> taskkill -pid 8824 -F

成功: 已终止 PID 为 8824 的进程。

leader已切换到其中一个从属节点,并且节点1不再处于同步副本集中:

> bin/windows/kafka-topics.bat --describe --zookeeper localhost:2181 --topic my-replicated-topic

Topic:my-replicated-topic PartitionCount:1 ReplicationFactor:3 Configs:

Topic: my-replicated-topic Partition: 0 Leader: 0 Replicas: 1,0,2 Isr: 0,2

但是即使原先写入的领导者失败,这些消息仍然可用于消费:

bin/windows/kafka-console-consumer.bat --bootstrap-server localhost:9092 --from-beginning --topic my-replicated-topic

第七步:使用kafka的连接来导入和导出数据

从控制台写入数据并将其写回控制台是一个方便的起点,但您可能需要使用其他来源的数据或将数据从Kafka导出到其他系统。对于许多系统,您可以使用Kafka Connect导入或导出数据,而不是编写自定义集成代码。

Kafka Connect是Kafka附带的一个工具,可以将数据导入和导出到Kafka。它是一个可扩展的工具,运行连接器,实现与外部系统交互的自定义逻辑。在此快速入门中,我们将看到如何使用简单的连接器运行Kafka Connect,这些连接器将数据从文件导入到Kafka主题,并将数据从Kafka主题导出到文件。

首先,我们创建一些数据来作为测试数据:

echo foo> test.txt

echo bar>> test.txt

接下来,我们将启动两个以独立模式运行的连接器,这意味着它们将在单个本地专用进程中运行。我们提供三个配置文件作为参数。首先是Kafka Connect过程的配置,包含常见的配置,例如要连接的Kafka代理和数据的序列化格式。其余的配置文件都指定了要创建的连接器。这些文件包括唯一的连接器名称,要实例化的连接器类以及连接器所需的任何其他配置。

bin/windows/connect-standalone.bat config/connect-standalone.properties config/connect-file-source.properties config/connect-file-sink.properties

Kafka附带的这些示例配置文件使用您之前启动的默认本地群集配置,并创建两个连接器:第一个源连接器从输入文件中读取行,并将每个连接生成为Kafka主题,第二个连接器为连接器连接器它读取来自Kafka主题的消息,并在输出文件中将每个消息生成为一行。

在启动过程中,您会看到许多日志消息,包括一些指示连接器正在实例化的消息。一旦Kafka Connect进程启动,源连接器应该从test.txt开始读取行并将其生成到主题connect-test,并且接收器连接器应该开始读取主题connect-test中的消息并将它们写入文件测试.sink.txt。我们可以通过检查输出文件的内容来验证通过整个管道传输的数据:

test.sink.txt文件中,会出现我们在test.txt里边写入的内容,

数据存储在Kafka的一个名为connect-test的topic中,因此我们还可以运行控制台使用者以查看主题中的数据(或使用自定义使用者代码来处理它)

bin/windows/kafka-console-consumer.bat --bootstrap-server localhost:9092 --topic connect-test --from-beginning

{"schema":{"type":"string","optional":false},"payload":"foo"}

{"schema":{"type":"string","optional":false},"payload":"bar"}

连接器继续处理数据,所以我们可以将数据添加到文件中,并看到它在整个管道中移动

您应该看到新添加的数据行出现在控制台消费者输出和接收器文件中

第八步:使用Kafka Streams处理数据

Kafka Streams是一个用于构建关键任务实时应用程序和微服务的客户端库,输入和/或输出数据存储在Kafka集群中。 Kafka Streams结合了在客户端编写和部署标准Java和Scala应用程序的简单性以及Kafka服务器端集群技术的优势,使这些应用程序具有高度可伸缩性,弹性,容错性,分布式等特性。本快速入门示例将演示如何运行在此库中编码的流式应用程序。