这篇文章的一些笔记摘要

《细粒度情感分析在到餐场景中的应用》

https://tech.meituan.com/2021/12/09/meituan-aspect-based-sentiment-analysis-daodian.html

大规模预训练模型(BERT)、提示学习(Prompt)等 NLP 技术飞速发展。

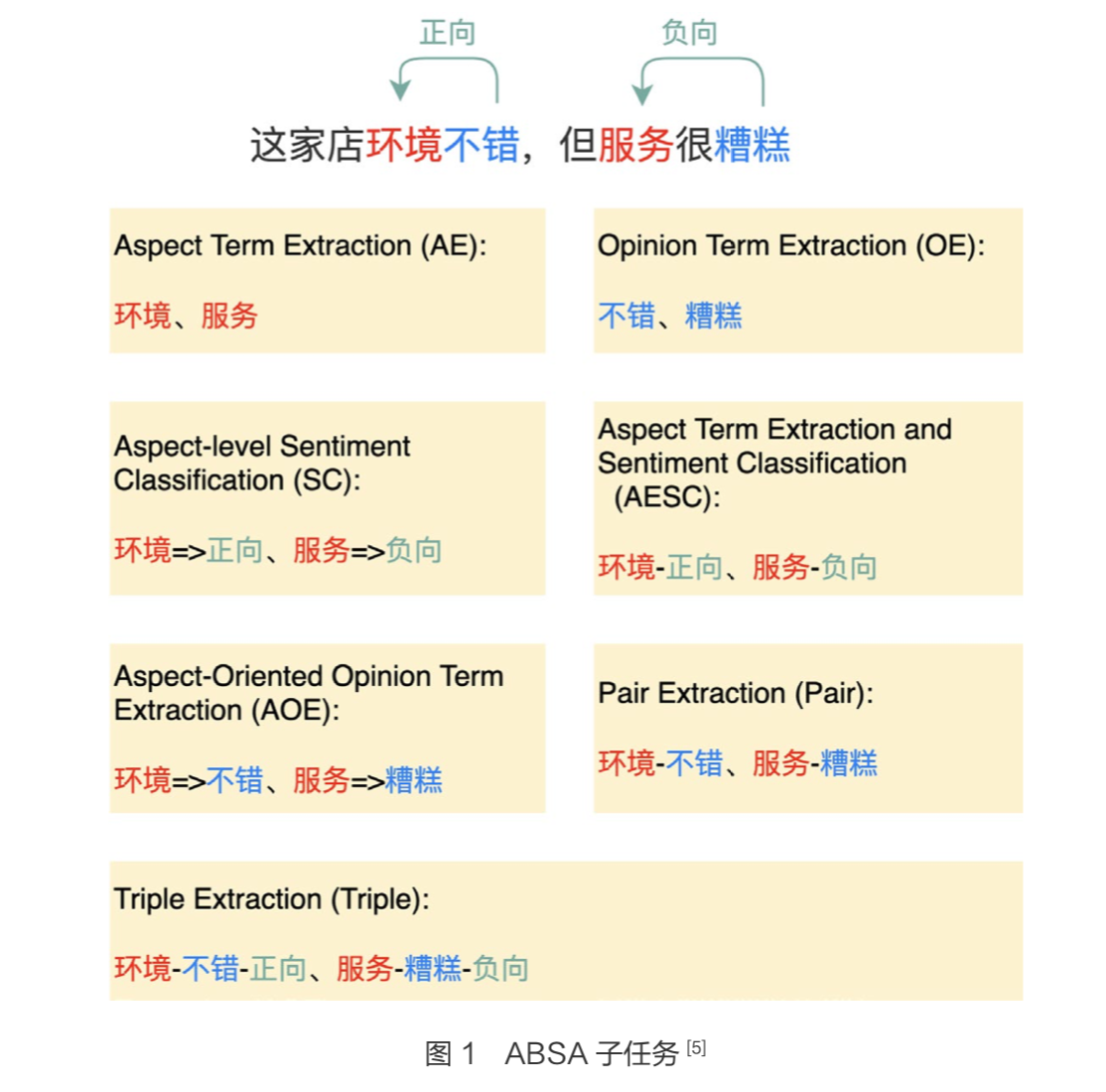

按照情感极性判定粒度,可以细分为篇章 / 整句粒度情感分析、细粒度情感分析 (ABSA, Aspect-based Sentiment Analysis)[1]。

细粒度情感分析的 任务目标主要围绕属性(Aspect Term)、观点(Opinion Term)、情感(Sentiment Polarity)三要素展开,可以拆分为属性抽取、观点抽取以及属性 - 观点对的情感倾 向判定三个级联任务 [2-5]。

例如,对于给定的用户评论“这家店环境不错,但服务很糟糕”,预期的输出结果为(环境,不错,正向)、(服务,糟糕,负向)。

在实验过程中,我们发现 BERT+CRF 相比简单的 BERT+Softmax 效果提升甚微,究其原因,由于预训练模型经过微调之后可以学 习到具有明显区分度的特征,导致增加 CRF 层对实体识别结果几乎没有影响。

进一步实验后发现,通过调整 BERT 和 CRF 层 的学习率,如 BERT 使用较小的学习率而 CRF 层使用 100 倍于 BERT 的学习率

(即 e2/e1>100), 最 终 BERT+CRF 的 效 果 相 比 BERT+Softmax 有了较明显的提升。

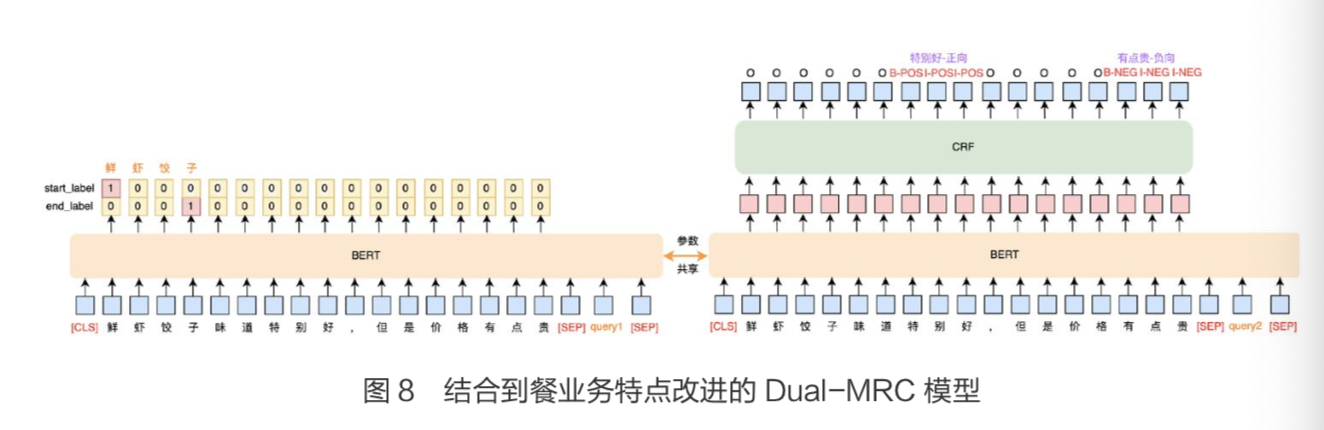

借鉴 MRC(Machine Reading Comprehension)任务的思 想,通过构建合理的 Query 引入先验知识,辅助观点抽取。

考虑到 Google 中文预训练模型 BERT 是以字粒 度为切分,没有考虑到传统 NLP 中的中文分词,

在预训练层我们将 BERT 模型替换 为哈工大开源的中文预训练模型,如 BERT-wwm-ext、RoBERTa-wwm 等,最 终模型效果取得进一步提升。

目前在学术界,三元组(属性,观点,情感)联合抽取的方法主要包括序列标注方法 [11]、 QA 方法 [5,12]、生成式方法 [13,14] 等。

我们采取了 QA 式的联合抽取方法,主要参考模型 Dual-MRC。

在到餐业务场景中,主 要面临少样本问题,参考业界 NLP 少样本解决方法,以基于对比学习的 R-drop[23] 方法和基于 Prompt[24] 的第四范式为代表。我们在 BERT 模型结构基础上,分别实 验了 Prompt 模板方法(如图 9 所示)和 R-drop 数据增强(如图 10 所示)。其中, Prompt 模板主要借鉴 P-tuning[25] 的思想,采取自动化构建模板的方式,基于 MLM 任务解决问题。