使用Docker-compose实现Tomcat+Nginx负载均衡

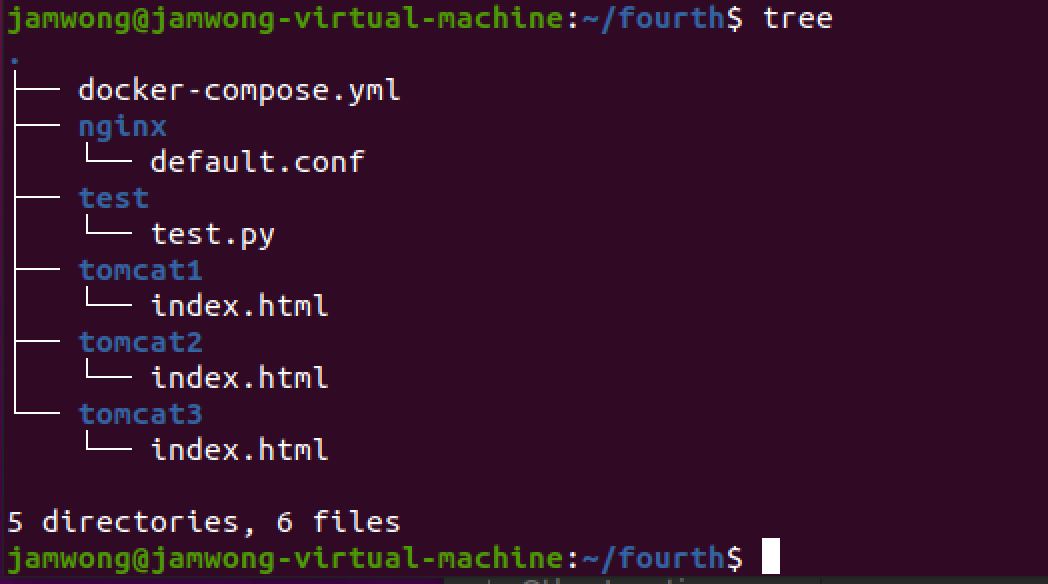

文件结构

tomcat1/2/3中的index.html内容为"hello tomcat1</2/3>!" 用于打印验证负载均衡

docker-compose.yml

version: "3"

services:

nginx:

image: nginx

container_name: zxhngx

ports:

- 80:2525

volumes:

- ./nginx/default.conf:/etc/nginx/conf.d/default.conf # 挂载配置文件

depends_on:

- tomcat01

- tomcat02

- tomcat03

tomcat01:

image: tomcat

container_name: tc1

volumes:

- ./tomcat1:/usr/local/tomcat/webapps/ROOT # 挂载web目录

tomcat02:

image: tomcat

container_name: tc2

volumes:

- ./tomcat2:/usr/local/tomcat/webapps/ROOT

tomcat03:

image: tomcat

container_name: tc3

volumes:

- ./tomcat3:/usr/local/tomcat/webapps/ROOT

nginx/default.conf

upstream tomcats {

server tc1:8080; # 主机名:端口号

server tc2:8080; # tomcat默认端口号8080

server tc3:8080; # 默认使用轮询策略

}

server {

listen 2525;

server_name localhost;

location / {

proxy_pass http://tomcats; # 请求转向tomcats

}

}

test/test.py 用于验证负载均衡

import requests

import re

url = 'http://localhost'

for i in range(0,20):

response = requests.get(url)

text = response.text

print(text)

验证默认的轮询策略

修改default.conf为权重策略

upstream tomcats {

server tc1:8080 weight=3; # 主机名:端口号

server tc2:8080 weight=2; # tomcat默认端口号8080

server tc3:8080 weight=1; # 修改为权重策略

}

server {

listen 2525;

server_name localhost;

location / {

proxy_pass http://tomcats; # 请求转向tomcats

}

}

- 验证权重策略(记得每次修改策略要重启容器)

使用Docker-compose部署javaweb运行环境

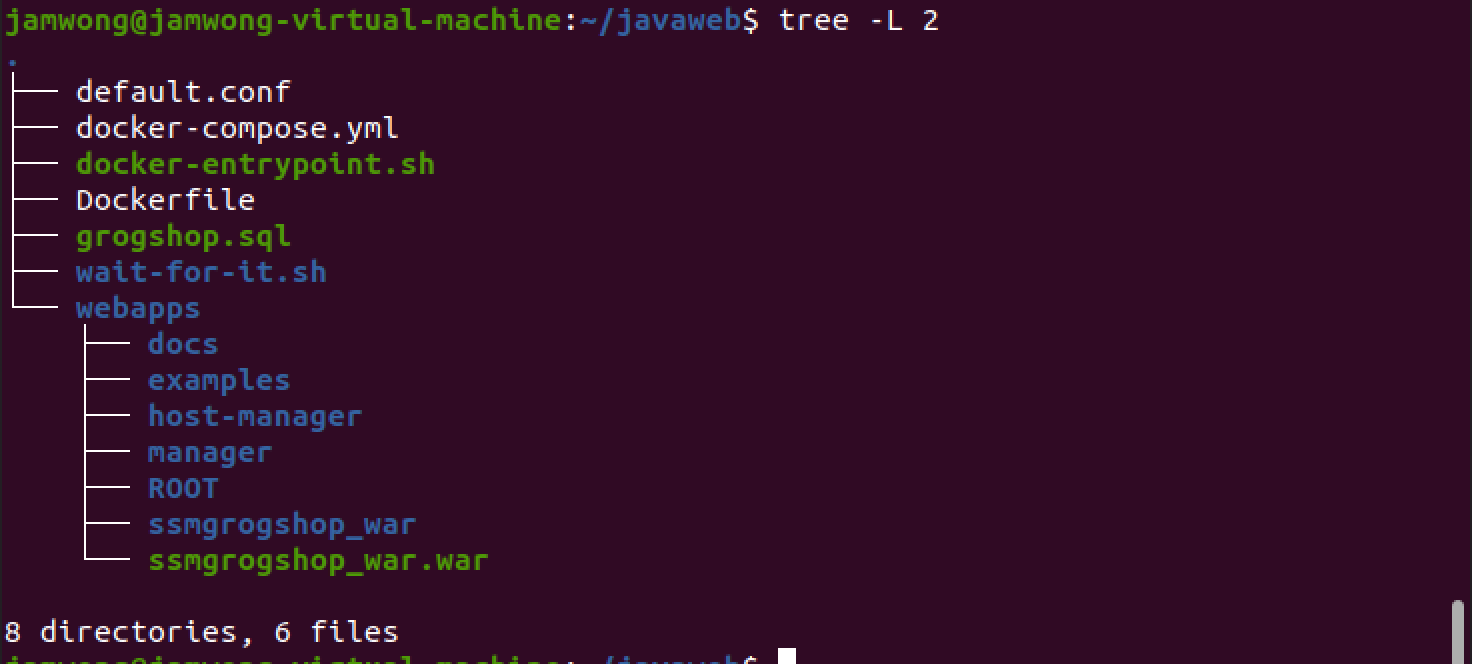

文件目录

default.conf

upstream tomcats {

server tomcat00:8080;

}

server {

listen 8080;

server_name localhost;

location / {

proxy_pass http://tomcats;

}

}

docker-compose.yml

version: "3" #版本

services: #服务节点

tomcat: #tomcat 服务

image: tomcat #镜像

hostname: hostname #容器的主机名

container_name: tomcat00 #容器名

ports: #端口

- "5050:8080"

volumes: #数据卷

- "./webapps:/usr/local/tomcat/webapps"

- ./wait-for-it.sh:/wait-for-it.sh

networks: #网络设置静态IP

webnet:

ipv4_address: 15.22.0.15

mymysql: #mymysql服务

build: . #通过MySQL的Dockerfile文件构建MySQL

image: mymysql:test

container_name: mymysql

ports:

- "3309:3306"

#红色的外部访问端口不修改的情况下,要把Linux的MySQL服务停掉

#service mysql stop

#反之,将3306换成其它的

command: [

'--character-set-server=utf8mb4',

'--collation-server=utf8mb4_unicode_ci'

]

environment:

MYSQL_ROOT_PASSWORD: "123456"

networks:

webnet:

ipv4_address: 15.22.0.6

nginx:

image: nginx

container_name: "nginx-tomcat"

ports:

- 8080:8080

volumes:

- ./default.conf:/etc/nginx/conf.d/default.conf # 挂载配置文件

tty: true

stdin_open: true

networks:

webnet:

ipv4_address: 15.22.0.7

networks: #网络设置

webnet:

driver: bridge #网桥模式

ipam:

config:

-

subnet: 15.22.0.0/24 #子网

docker-entrypoint.sh

#!/bin/bash

mysql -uroot -p123456 << EOF

source /usr/local/grogshop.sql;

Dockerfile

# 这个是构建MySQL的dockerfile

FROM registry.saas.hand-china.com/tools/mysql:5.7.17

# mysql的工作位置

ENV WORK_PATH /usr/local/

# 定义会被容器自动执行的目录

ENV AUTO_RUN_DIR /docker-entrypoint-initdb.d

#复制gropshop.sql到/usr/local

COPY grogshop.sql /usr/local/

#把要执行的shell文件放到/docker-entrypoint-initdb.d/目录下,容器会自动执行这个shell

COPY docker-entrypoint.sh $AUTO_RUN_DIR/

#给执行文件增加可执行权限

RUN chmod a+x $AUTO_RUN_DIR/docker-entrypoint.sh

# 设置容器启动时执行的命令

#CMD ["sh", "/docker-entrypoint-initdb.d/import.sh"]

.../webapps/ssmgrogshop_war/WEB-INF/classes/jdbc.properties

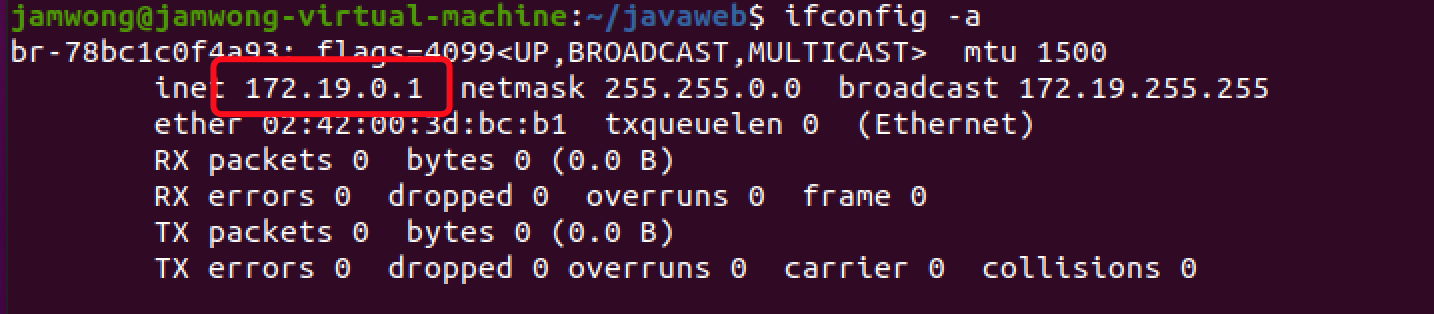

查看网卡ifconfig -a

替换ip为如下

driverClassName=com.mysql.jdbc.Driver

url=jdbc:mysql://172.19.0.1:3309/grogshop?useUnicode=true&characterEncoding=utf-8

username=root

password=123456

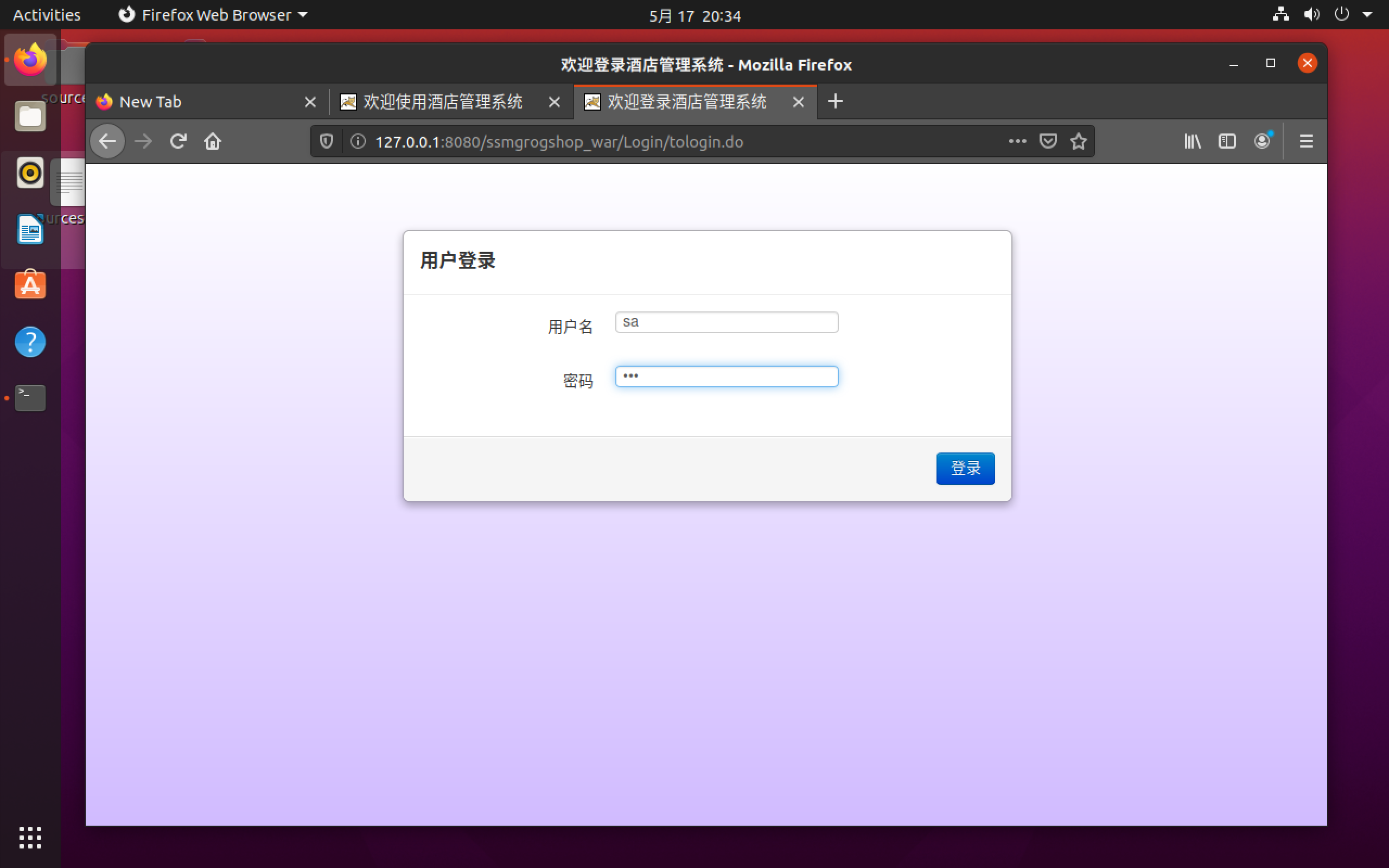

登陆酒店管理系统

- 地址:

http://127.0.0.1:8080/ssmgrogshop_war

- 进行删除操作

反向代理

default.conf

upstream tomcats{

server tt1:8080 ;

server tt2:8080 ;

server tt3:8080 ;

}

server {

listen 2525;

server_name localhost;

location / {

root /usr/share/nginx/html;

index index.html index.htm;

proxy_pass http://tomcats;

}

}

docker-compose.yml

version: "3.1"

services:

nginx:

image: nginx

container_name: ng1

ports:

- 80:2525

- ./nginx/default.conf:/etc/nginx/conf.d/default.conf # 挂载配置文件

on:

- tomcat01

02

- tomcat03

tomcat01:

image: tomcat

container_name: tt1

volumes:

- ./tomcat/tomcat1:/usr/local/tomcat/webapps/ROOT # 挂载web目录

tomcat02:

image: tomcat

container_name: tt2

volumes:

- ./tomcat/tomcat2:/usr/local/tomcat/webapps/ROOT

tomcat03:

image: tomcat

container_name: tt3

volumes:

- ./tomcat/tomcat3:/usr/local/tomcat/webapps/ROOT

使用Docker搭建大数据集群环境

直接用机器搭建Hadoop集群,会因为不同机器配置等的差异,遇到各种各样的问题;也可以尝试用多个虚拟机搭建,但是这样对计算机的性能要求比较高,通常无法负载足够的节点数;使用Docker搭建Hadoop集群,将Hadoop集群运行在Docker容器中,使Hadoop开发者能够快速便捷地在本机搭建多节点的Hadoop集群。

要求:

- 完成hadoop分布式集群环境配置,至少包含三个节点(一个master,两个slave);

- 成功运行hadoop 自带的测试实例。

文件目录

Dockerfile

FROM ubuntu

COPY ./sources.list /etc/apt/sources.list

之前的作业已经替换过虚拟机的ubuntu20.04阿里镜像源,可以直接复制使用这里就不再说明了。

docker build -t ubuntu .

docker run -it --name ubuntu ubuntu

执行上述两条命令后便成功创建并进入容器

配置Ubuntu容器

安装vim与ssh

apt-get update

apt-get install vim # 用于修改配置文件

apt-get install ssh # 分布式hadoop通过ssh连接

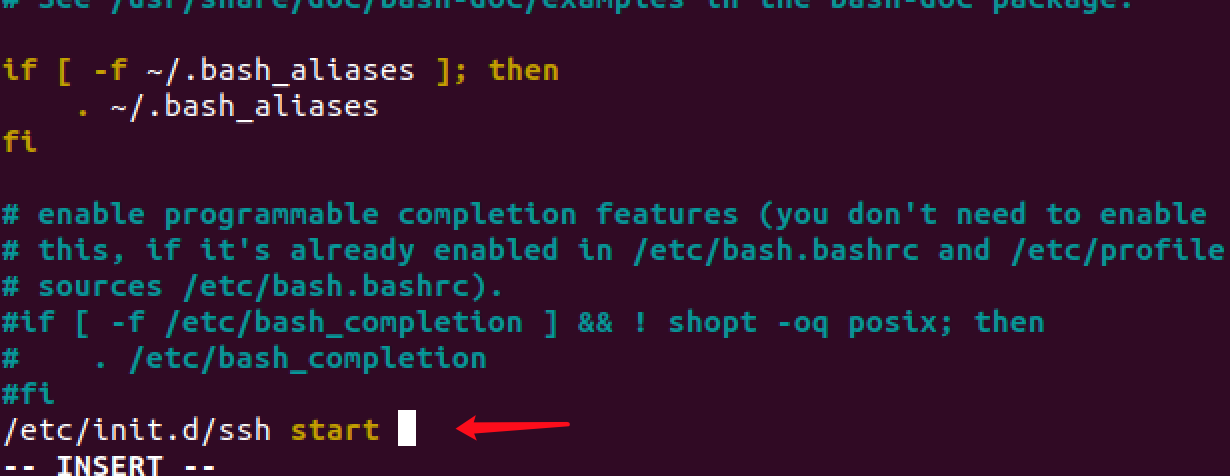

vim ~/.bashrc # 在文件末尾添加下面一行的内容,实现ssd开机自启

/etc/init.d/ssh start # 开启sshd服务器

配置sshd免密登陆

ssh-keygen -t rsa # 一直按回车即可

cd ~/.ssh

cat id_rsa.pub >> authorized_keys

安装JDK

qygg说Hadoop不要安装太高版本的jdk会有很多坑,果断也选择jdk8

apt-cache search jdk

apt-get install openjdk-8-jdk

vim ~/.bashrc # 在文件末尾添加以下两行,配置Java环境变量:

export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64/

export PATH=$PATH:$JAVA_HOME/bin

最后source ~/.bashrc 使.bashrc生效

commit一下容器并挂载工作目录使Hadoop能够读取安装文件

docker ps # 查看当前容器id

docker commit 容器ID ubuntu/jdk8

docker run -it -v /home/jamwong/bigData/hadoop/build:/root/build --name ubuntu-jdk8 ubuntu/jdk8

安装Hadoop

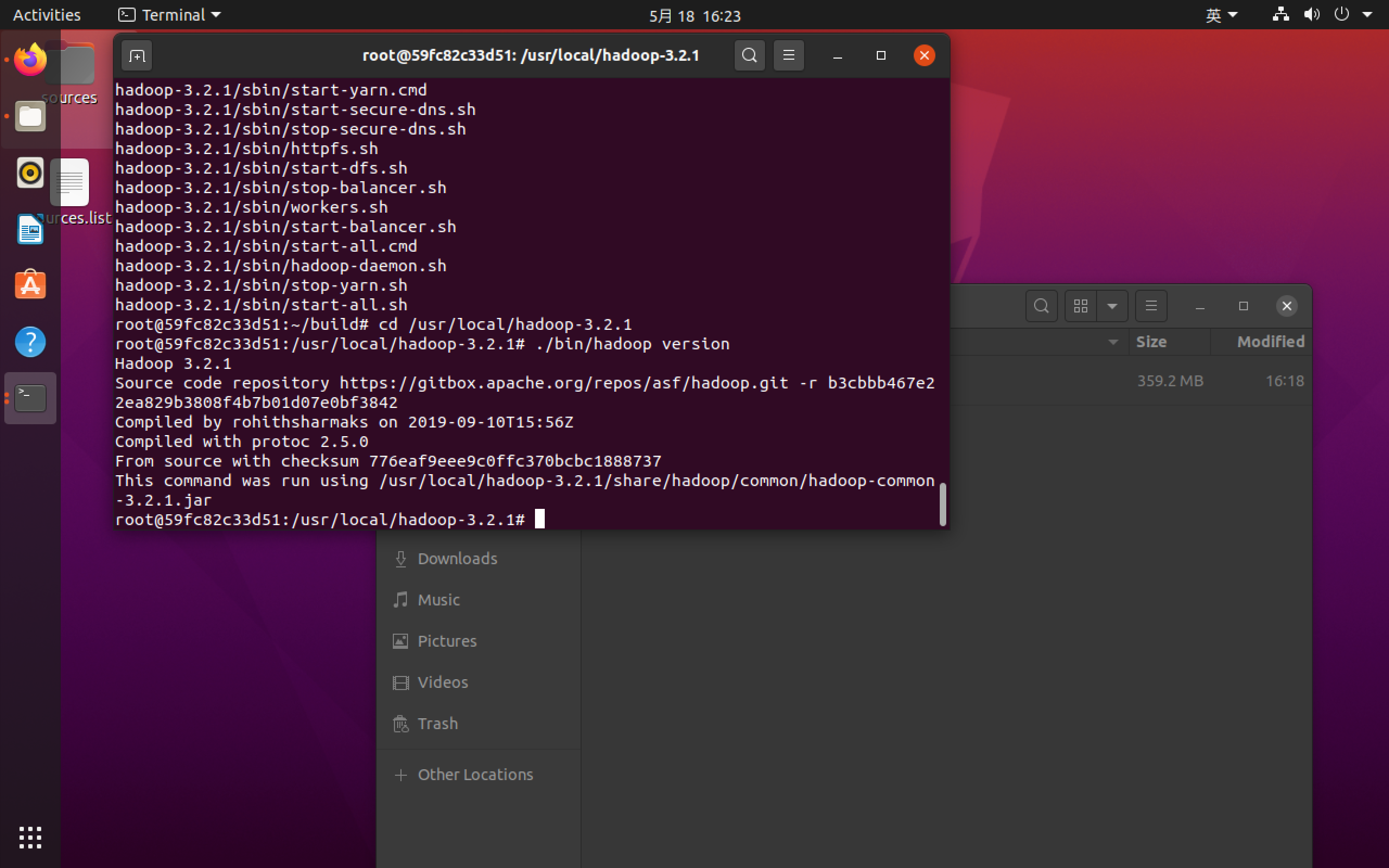

下载好Hadoop的安装包后(这里选用3.2.1版本)放到上一步挂载的目录中

cd /root/build

tar -zxvf hadoop-3.2.1.tar.gz -C /usr/local

cd /usr/local/hadoop-3.2.1

./bin/hadoop version # 验证安装

Hadoop分布式集群环境配置

cd /usr/local/hadoop-3.2.1/etc/hadoop 进入配置文件目录

- hadoop-env.sh

vim hadoop-env.sh

export JAVA_HOME=/usr/lib/jvm/java-8-openjdk-amd64/ # 在任意位置添加

- core-site.xml

vim core-site.xml

<?xml version="1.0" encoding="UTF-8" ?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl" ?>

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

</configuration>

- hdfs-site.xml

vim hdfs-site.xml

<?xml version="1.0" encoding="UTF-8" ?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl" ?>

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/namenode_dir</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/datanode_dir</value>

</property>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

</configuration>

- mapred-site.xml

vim mapred-site.xml

<?xml version="1.0" ?>

<?xml-stylesheet type="text/xsl" href="configuration.xsl" ?>

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>yarn.app.mapreduce.am.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/hadoop-3.2.1</value>

</property>

<property>

<name>mapreduce.map.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/hadoop-3.2.1</value>

</property>

<property>

<name>mapreduce.reduce.env</name>

<value>HADOOP_MAPRED_HOME=/usr/local/hadoop-3.2.1</value>

</property>

</configuration>

- yarn-site.xml

vim yarn-site.xml

<?xml version="1.0" ?>

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

</configuration>

修改脚本

cd /usr/local/hadoop-3.2.1/sbin 进入脚本编辑文件目录

对于start-dfs.sh和stop-dfs.sh文件,添加下列参数:

HDFS_DATANODE_USER=root

HADOOP_SECURE_DN_USER=hdfs

HDFS_NAMENODE_USER=root

HDFS_SECONDARYNAMENODE_USER=root

对于start-yarn.sh和stop-yarn.sh,添加下列参数:

YARN_RESOURCEMANAGER_USER=root

HADOOP_SECURE_DN_USER=yarn

YARN_NODEMANAGER_USER=root

commit一下配置完Hadoop的容器

docker commit 容器ID ubuntu/hadoop

运行Hadoop集群

# 第一个终端

docker run -it -h master --name master ubuntu/hadoop

# 第二个终端

docker run -it -h slave01 --name slave01 ubuntu/hadoop

# 第三个终端

docker run -it -h slave02 --name slave02 ubuntu/hadoop

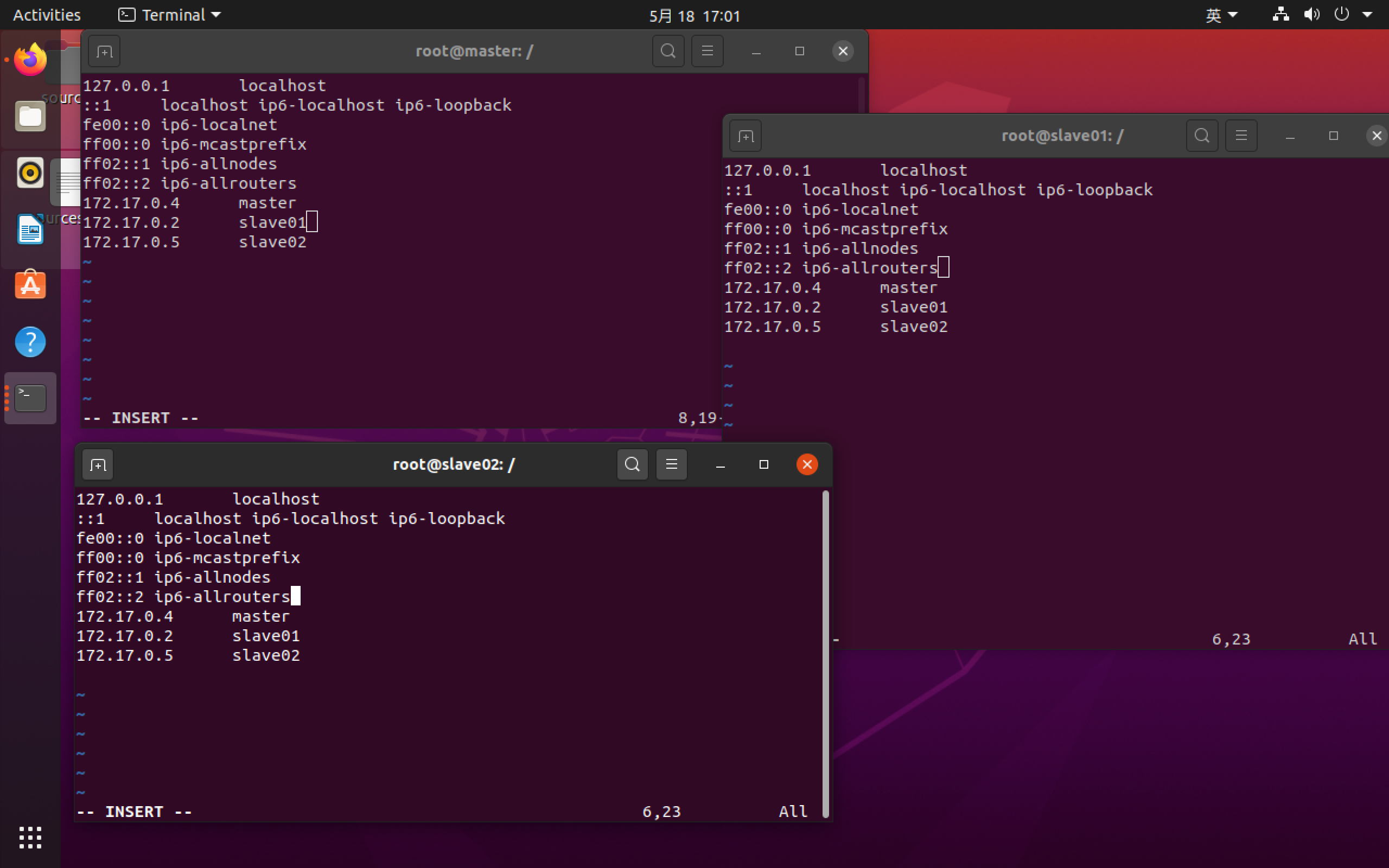

/etc/hosts

为三台主机配置对方的地址信息,使其才能找到彼此

vim /etc/hosts

172.18.0.2 master

172.18.0.3 slave01

172.18.0.4 slave02

修改workers

vim /usr/local/hadoop-3.2.1/etc/hadoop/workers # 旧版为slaves

#将localhost修改为:

slave01

slave02

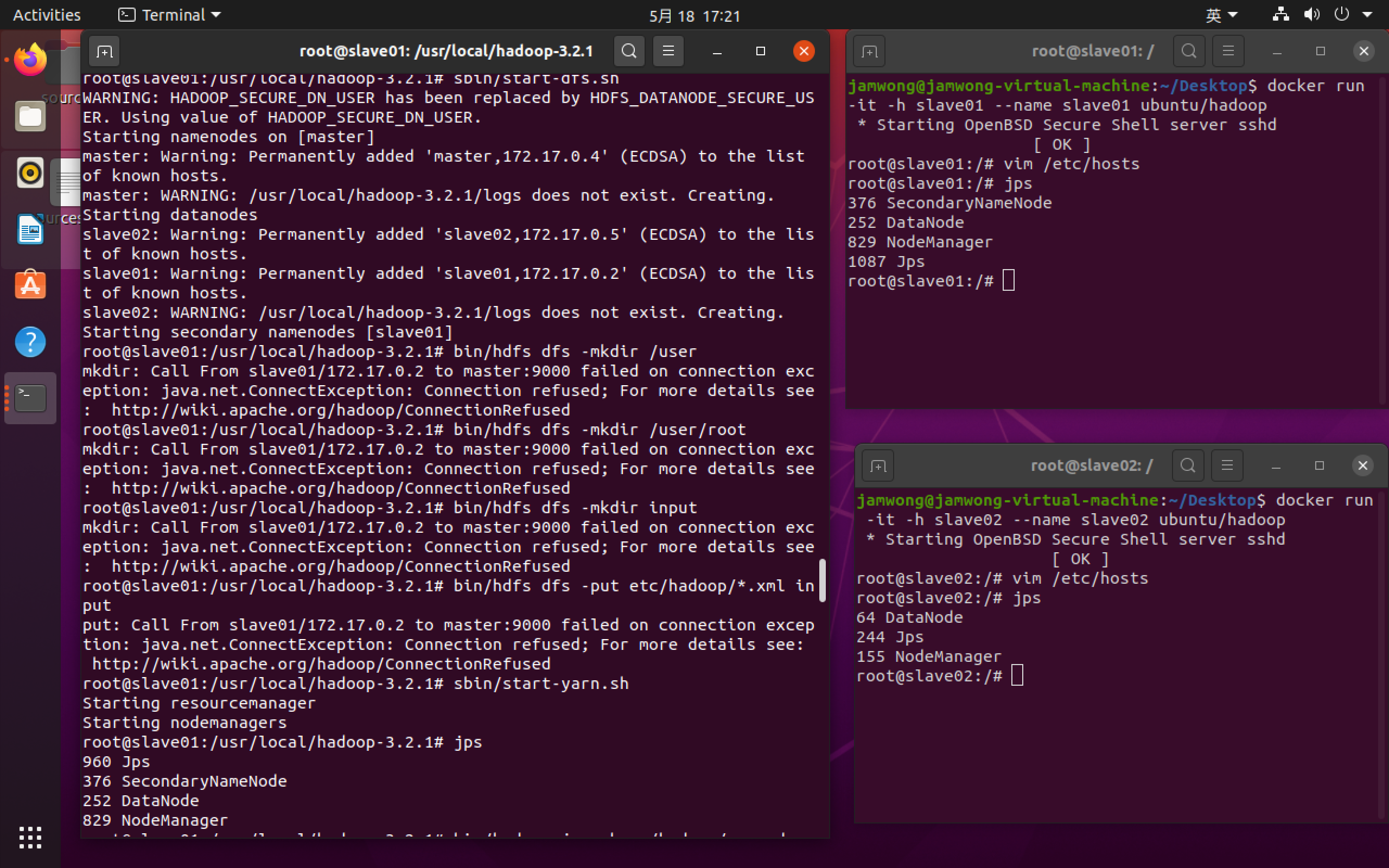

测试Hadoop集群

cd /usr/local/hadoop-3.2.1

bin/hdfs namenode -format # 格式化文件系统

sbin/start-dfs.sh # 开启NameNode和DataNode服务

bin/hdfs dfs -mkdir /user # 建立HDFS文件夹,也可以放到下面示例程序中进行

bin/hdfs dfs -mkdir /user/root

bin/hdfs dfs -mkdir input

bin/hdfs dfs -put etc/hadoop/*.xml input # 将xml复制到input下,作为示例程序输入

sbin/start-yarn.sh # 开启ResourceManager和NodeManager服务

jps # 查看服务状态

运行Hadoop示例程序

在master上:

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-3.2.1.jar grep input output 'dfs[a-z.]+' # 运行示例

bin/hdfs dfs -get output output # 获取输出结果

cat output/* # 查看输出结果

sbin/stop-all.sh # 停止所有服务

总结

- 实验二中.../jdbc.properties中的容器端口号为3309配置成了3306,导致一直无法登陆成功,修改过来后重启容器便可以了。

- 对于实验三因为没有这学期没有选大数据课程,关于Hadoop的概念都很陌生。前面的时间都用来大概的了解一些概念,三天前才开始正式实验(拖延症晚期没救了)。三个实验花的时间大概10个小时左右,qygg的身先士卒坑先踩给了很大的帮助。

8多说了 zaqny 永远滴神