Hadoop学习笔记(1)

——菜鸟入门

Hadoop是什么?先问一下百度吧:

【百度百科】一个分布式系统基础架构,由Apache基金会所开发。用户能够在不了解分布式底层细节的情况下。开发分布式程序。充分利用集群的威力进行快速运算和存储。 Hadoop实现了一个分布式文件系统(Hadoop Distributed File System),简称HDFS。HDFS有高容错性的特点,并且设计用来部署在低廉的(low-cost)硬件上;并且它提供高传输率(high throughput)来訪问应用程序的数据,适合那些有着超大数据集(large data set)的应用程序。

HDFS放宽了(relax)POSIX的要求,能够以流的形式訪问(streaming access)文件系统中的数据。Hadoop的框架最核心的设计就是:HDFS和MapReduce。HDFS为海量的数据提供了存储,则MapReduce为海量的数据提供了计算。

Hadoop主要用于一些分布式计算。在这个大数据年代,那这个的确是一个非常不错的工具。所以非常有必要来学一学。

如何开展这个学习呢,无论如何。学习一样新东西,我喜欢这种顺序:先依葫芦画瓢。一步一步行将其执行起来,再来分析一些应用场景及执行的情况,然后深入看一下其高级应用。 最后因为这个是一个开源产品,正好来借此机会来读一读大牛们的代码。学学其精华。

好了,開始行动:

-

执行环境搭建

首先,这个是须要执行在linux系统中的,所以得安装个linux才行,市面上有非常多个linux的版本号,如红帽子、Fedra、Ubuntu。选哪种呢,对我这样的习惯windows的来说,当然要使用方便的。所以选择了Ubuntu。

安装Ubuntu,这里我就不多说了,在官网上有非常多。事实上也非常easy,一路下一步。

当然这里能够安装在Vmware虚拟机上,也能够直接安装在硬盘上。

我个人建议,能够直接安装在硬盘上,与现有windows做个双系统。

由于后面还要跑开发环境 eclipse。在虚拟机上会有点吃力。 同一时候安装在硬盘上后,还能够这样玩。在进入windows后,安装 vmware,然后新建虚拟机后,不要创建硬盘,直接使用硬盘的分区。这样, 就能够在vmware中启动安装在硬盘上的ubuntu了。

做到双系统,双启动。

这样优点是。当要开发时。能够直接进ubuntu系统,当仅仅是看看代码。以及后面模拟分布式部署时,就能够用vmware来启动。同一时候再建上几个虚拟机来进行分布式部署。

操作系统准备好后,就须要一些组件了,hadoop比較简单,仅仅须要ssh和java环境。再加个下代码的SVN。

先用 sudo apt-get install subversion ssh ant 这个命令,把SSH、Ant和SVN安装起来。

java环境,能够在网上下载一个安装JDK包,如:jdk-6u24-linux-i586.bin

安装直接在文件夹下执行./jdk-6u24-linux-i586.bin就可以。

然后配置jdk文件夹:

先进入安装文件夹 cd jdk-6u24-…

然后输入 PWD 就能够看到java安装文件夹,复制下来:

命令行运行:sudo gedit /etc/profile

在打开的文件中,追加:

export JAVA_HOME=/home/administrator/hadoop/jdk1.6.0_27 //这里要写安装文件夹

export PATH=${JAVA_HOME}/bin:$PATH

运行source /etc/profile 马上生效

验证是否安装完毕,那比較easy了。在命令行下执行 java -version ant svn ssh 看是否找不到命令。假设都能找到。说明OK了。

-

下载代码:

这是个开源的系统,代码非常方便用SVN就能够下载到,版本号也非常多,在这里我选择0.20.2版本号,一个是网上好多书都基于这个版本号的。另外是看源代码,还是曾经点版本号吧,后面的版本号里面肯定又加了非常多。

执行这个命令来下载:

svn co http://svn.apache.org/repos/asf/hadoop/common/tags/release-0.20.2/

下载完毕后,会在当前目录内产生一个新目录release-0.20.2,这里面就是代码了。

为了后面方便操作。把这目录重命令一下:

mv release-0.20.2/ hadoop-0.20.2

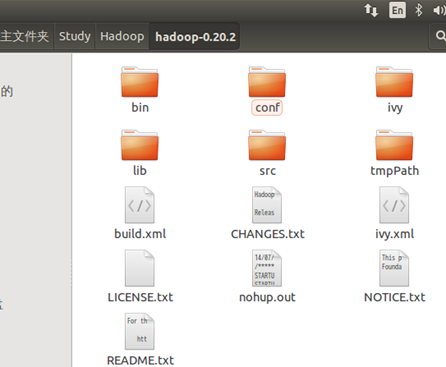

好了,用图形界面进入该目录。看一看:

-

编译代码

刚下完的代码是无法直接执行的。须要编译一下,但用什么编译呢?

编译前先改动一下build.xml,打开,将里面的版本改成:0.20.2。例如以下:

看到代码里面有个build.xml。这个是典型的用ant编译用的配置文件,所以直接在命令行里输入:

~/hadoop-0.20.2$ant

~/hadoop-0.20.2$ant jar

~/hadoop-0.20.2$ant examples

[注意] 编译时须要联网,否则在自己主动下载jar包时会挂掉。

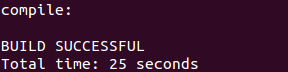

然后屏幕会刷啊刷,等到完毕看到以下字符时,也就OK了:

-

配置SSH

我们了解到。这个hadoop是支持分布式执行的,每台机器到时都会来安装hadoop程序,假设想启动全部程序怎么办? 一台台去启动? 那也太土了。 当然是远程去启动咯。为实现这个目标。就得用上SSH了。

SSH是什么。说白了。这个就是一个远程登陆器。跟远程桌面、telnet几乎相同。

在linux上全部操作都能够用命令行来完毕,全部SSH也就是一个命令行形式,同一时候比telnet高级,由于通过了加密通道传输信息。

那我们就部署了一台机器,还要这个SSH吗? 答案是要的,由于在执行hadoop里,即使是本机的。里面也要通过SSH localhost的方式来启动。这样代码统一。

前面不是安装过SSH了么,还要配置什么?SSH正常登陆时,是须要输入usernamepassword的,可是当全部的hadoop子服务都受主服务管了后,最好就直接信任了,不要输入帐号信息。所以我们配置的目的也就是这个。

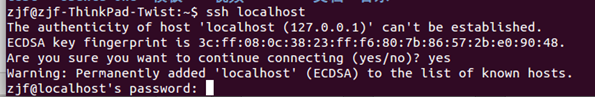

先试一下,我用SSH登陆当前本机信息:

能够看到。登陆本机时,也要输入一下password。怎么办?

SSH是能过RSA加密的,所以有公钥私钥的说法,所以,我们先产生一对固定的公私钥,执行这个ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa命令:

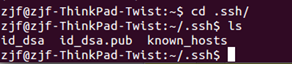

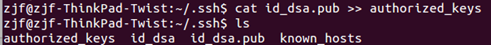

这里产生公私钥,并生成在.ssh目录下。于是我们就进入看一下:

果然,这里多了两个文件,id_dsa为私钥。id_dsa.pub为公钥

然后再把公钥复制成authorized_key。即将这个公钥固定为SSH登陆所用。

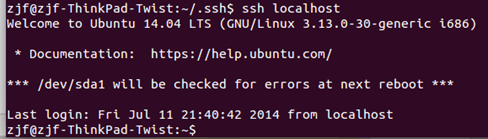

这步非常重要。做完这步后。就能够再试一下登陆本机了:

看,如今再ssh localhost时,就直接进入。没有再输入帐号了。

到这里,SSH配置就成功了。

-

改动配置文件

在正式执行之前。还要改动一下配置文件才地。这里详细的配置參数。就不讲,葫芦画瓢么,先跑起来。后面再来研究这是为啥:

在代码的conf目录内。就能够找到以下几个配置文件。分别配置成以下内容:

core-site.xml

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/zjf/hadoop-0.20.2/tmpPath</value> 。这里改下路径

</property>

</configuration>

hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

mapred-site.xml

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

<property>

<name>mapred.job.tracker</name>

<value>hdfs://localhost:9001</value>

</property>

</configuration>

-

执行

Hadoop是一头奇妙的大象,那我们得站在大象背上说句Hello world了。

进入hadoop文件夹: $cd Hadoop-0.20.2

首次执行,须要对namenode进行格式化:bin/hadoop namenode -format

启动hadoop:

bin/start-all.sh

关闭hadoop能够用:

bin/stop-all.sh

假设验证启动成功呢?有两种方式

-

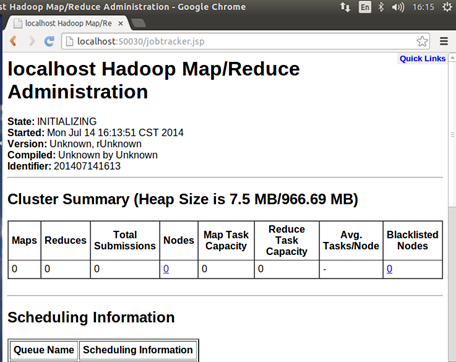

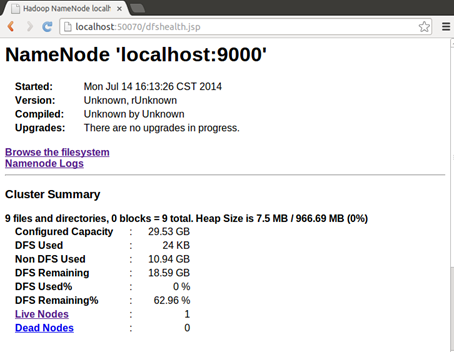

訪问一下管理页面看:

Job跟踪:http://localhost:50030

NameNode结点:http://localhost:50070

-

用jps看一下有几个java进程在执行。假设是以下几个就正常了:

主要有DataNode NameNode SecondaryNameNode TaskTracker JobTracker这几个进程,就表示正常了

系统启动正常后,跑个程序吧

$mkdir input

$cd input

$echo "hello world">test1.txt

$echo "hello hadoop">test2.txt

$cd ..

$bin/hadoop dfs -put input in

$bin/hadoop jar build/hadoop-0.20.2-examples.jar wordcount in out

$bin/hadoop dfs -cat out/*

最关健的是。最后输入:

输出这个结果这就表示我们的程序执行成功了。

至于这结果是什么意思,我想看到后大概也猜到了吧。至于具体讲解,下期再看。