神经网络与深度学习(更新至第6讲 循环神经网络)_哔哩哔哩_bilibili

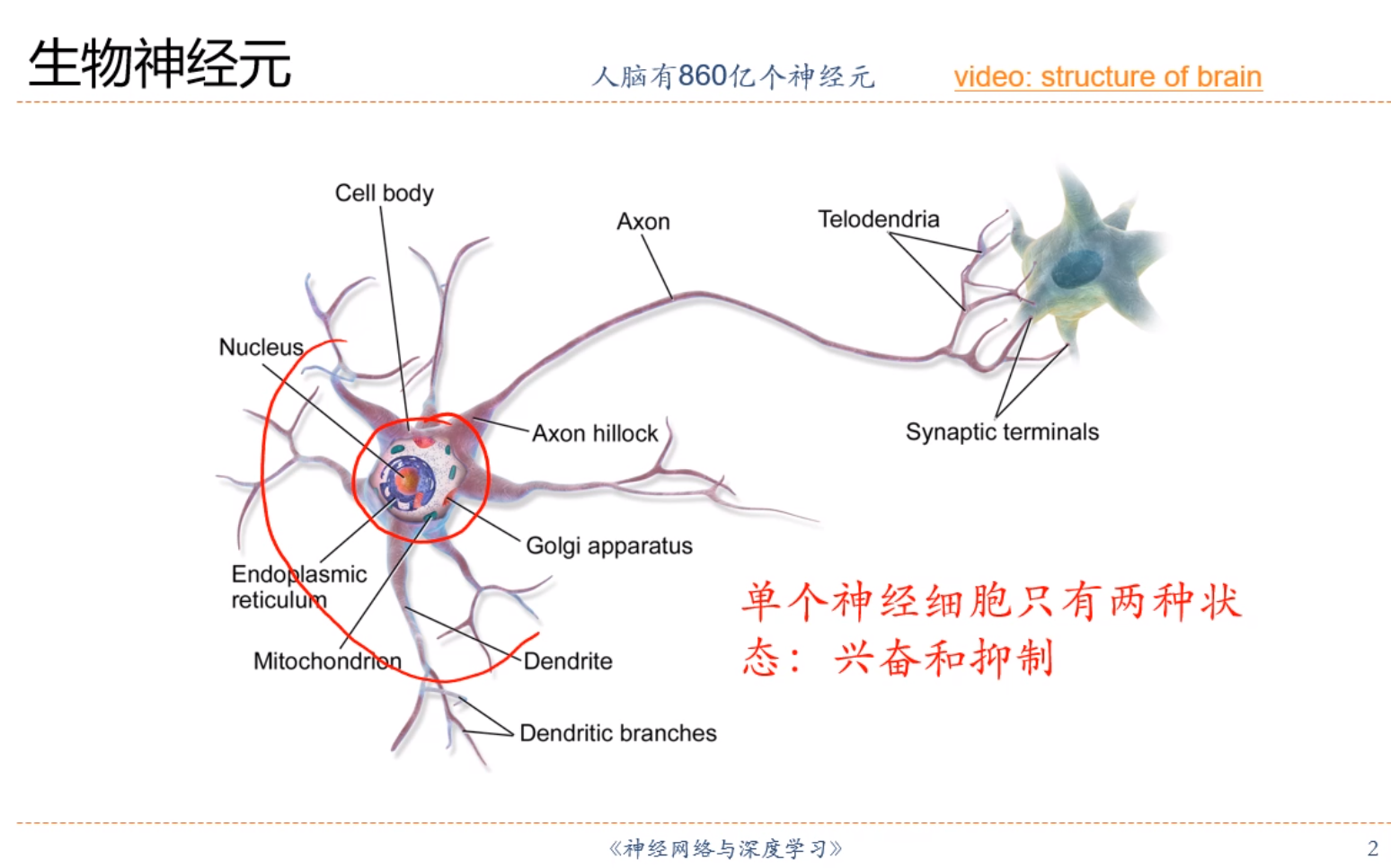

axon

英 [ˈæksɒn] 美 [ˈæksɑːn]

- n. 轴索,[解剖]轴突(神经细胞)

telodendria

终端(树)突

nucleus

英 [ˈnjuːkliəs] 美 [ˈnuːkliəs]

- n. 原子核;细胞核;核心,中心;神经核;(彗星的)核

注解:

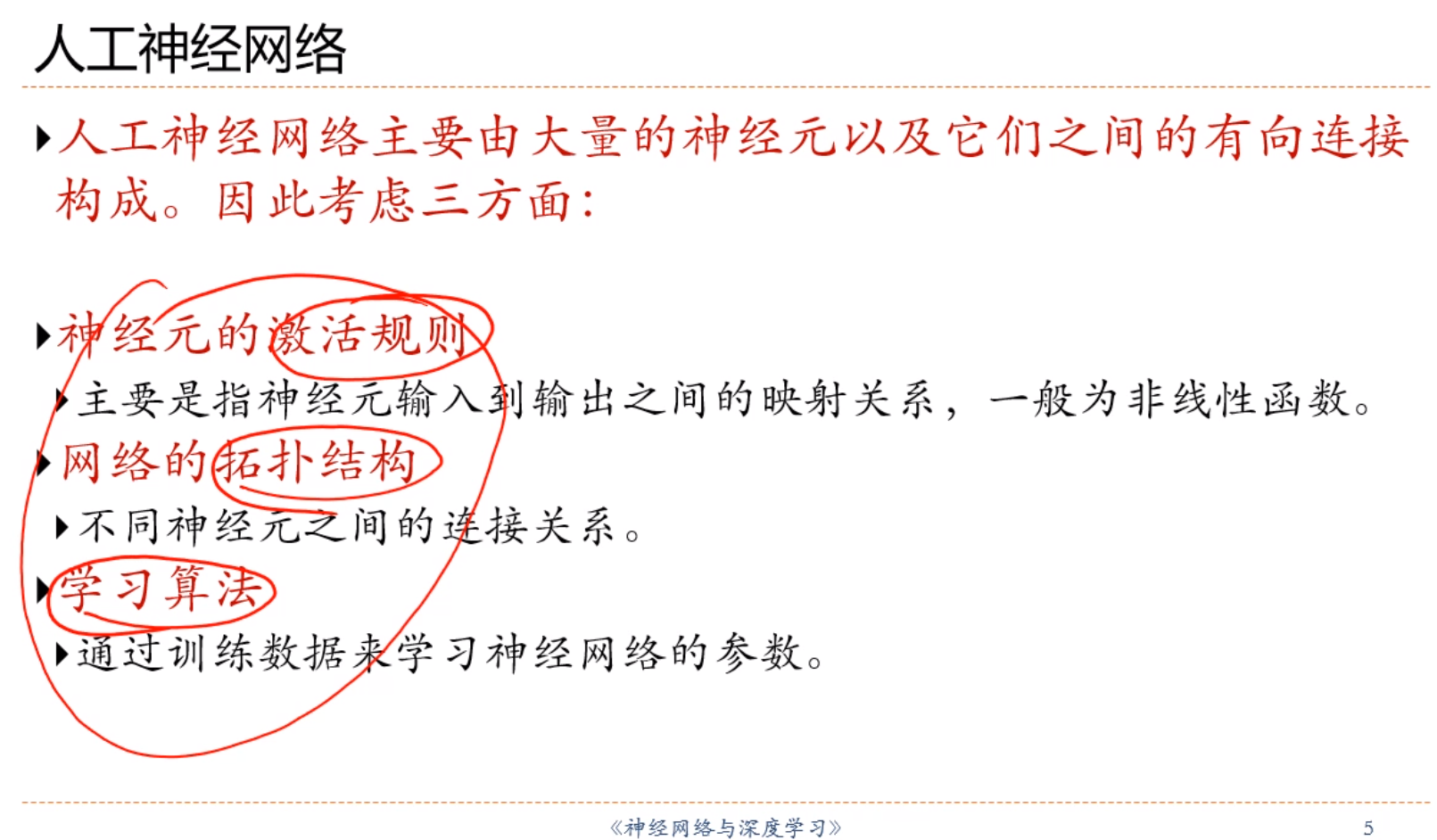

1.x1,x2,...xn代表一个神经元接受到的信号。

2.w1,w2,...wn代表不同的权重,代表一个神经元的不同的轴突之间的连接的强度(老师说的是:用来模拟不同神经元之间的连接强度)。

3.对轴突上的值进行加权求和之后,再流入一个激活函数,由这个激活函数决定这个神经元是抑制(不兴奋)还是激活(兴奋)。

注解:

1.学习算法在神经网络中指的是误差的反向传播。

2.学习算法通常意义上指的是梯度下降。

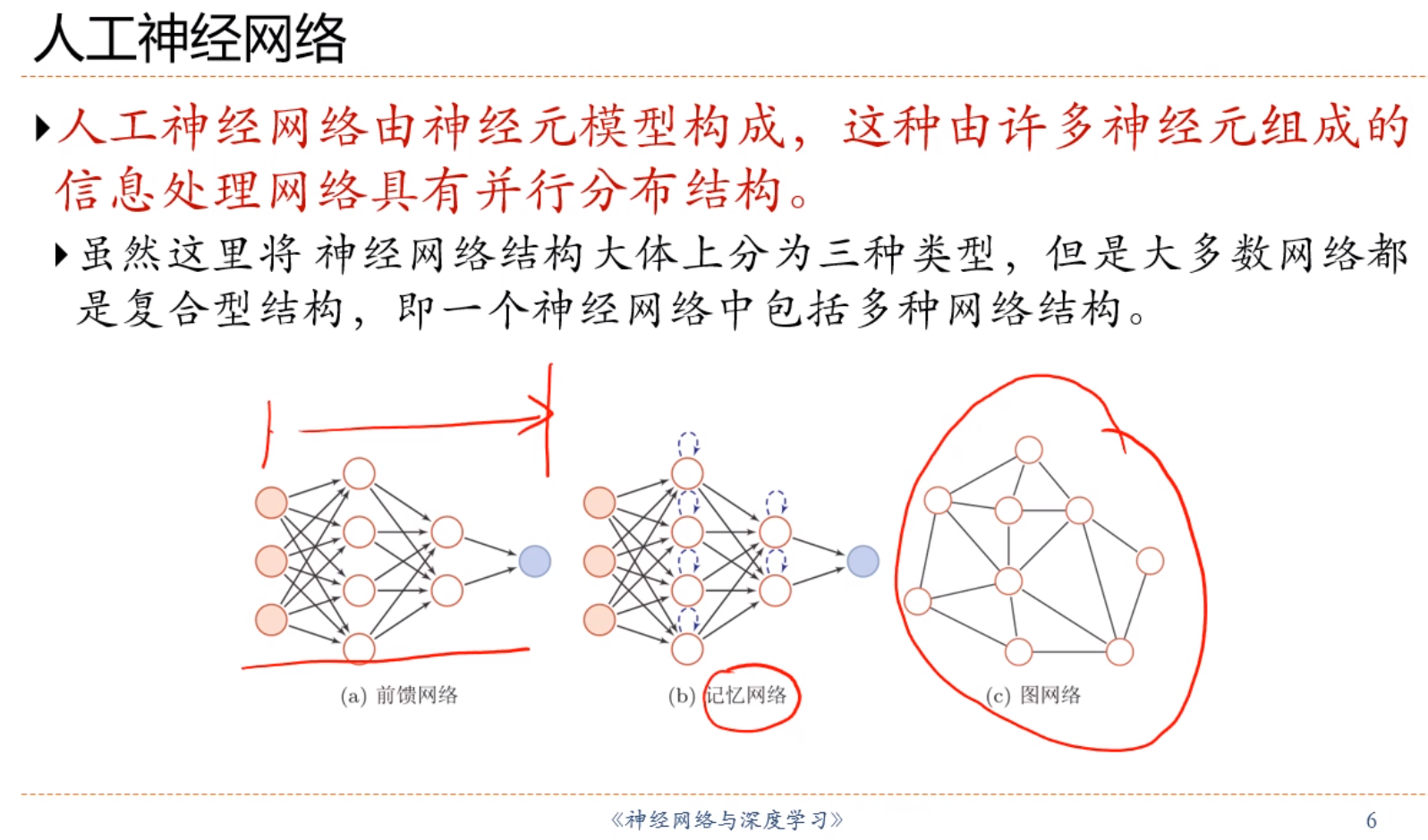

注解:

1.就算是混合形式的神经网络,相对于人脑的神经网络还是非常简单的网络。

注解:

1.这张图说明的是神经网络和深度学习的对应,即多层神经网络的组合学习就是深度学习。

2.第三层的映射函数f3是分类器。

3.每一层都可以看作是特征的抽取器。

4.整个的神经网络的学习可以认为是端到端的学习。

5.我称这个多层嵌套的函数为神经网络函数。

6.第一个隐藏层可以看成是和f1对应。

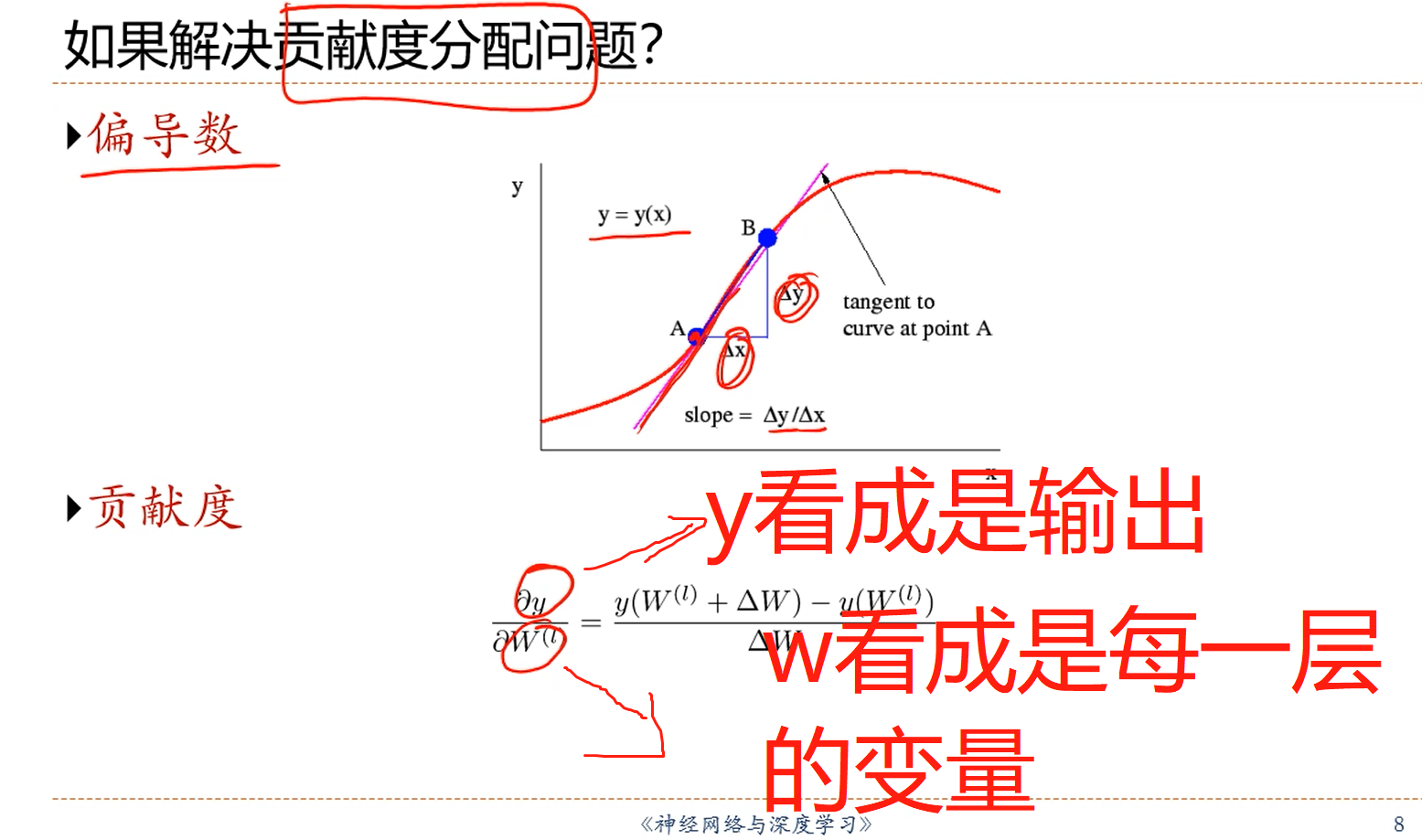

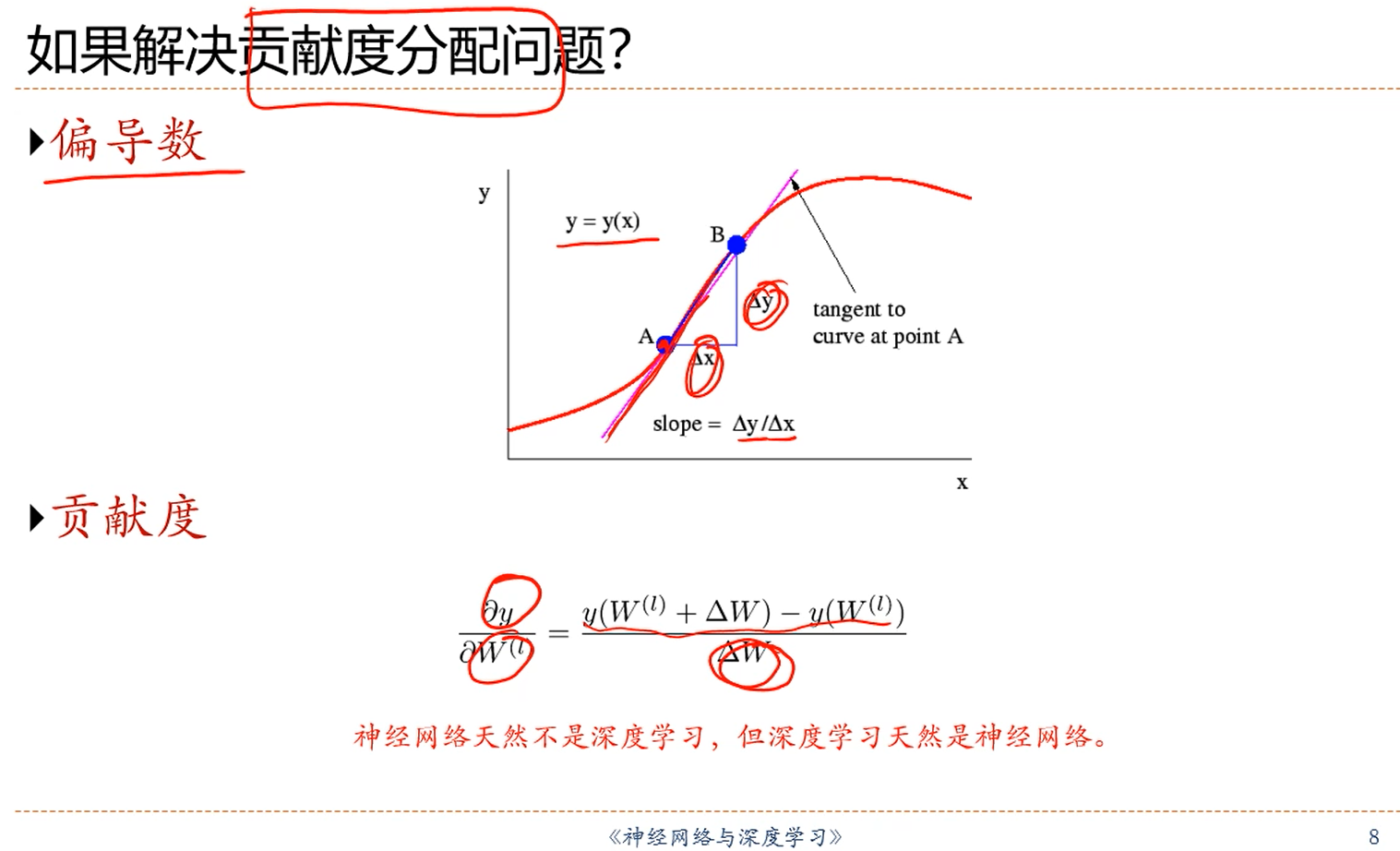

注解:

1.神经网络函数其实是连续可导的。

2.怎样看自变量x对因变量的影响有多大呢?对自变量x做一个扰动,看看y的变动有大多,这样就可以看出x的变化对y的影响有多大。

3.斜率就表示了x的变化对y造成的影响。如果在一个点上的斜率大,就说明在这一点处,一个微小的扰动就能造成y的较大的变化。

4.把y看成是神经网络的输出,w可以看成是每一层的参数,如果这个参数重要的话,对参数做一个小扰动,y应该变化很大,这意味着这个参数的贡献度很大。

5.如果计算的结果不好,可以先调节那些重要的参数。