- JDK下载与配置

- Hadoop下载,安装与部署

- 由于Hadoop是由java编程而写,所有运行环境需要java支持,Hadoop需java1.6及以上支持。

1.JDK 下载与配置

- 查看当前系统jdk,chuxianOpen JDK 需要卸载 rpm -qa | grep jdk

- rpm -e --nodeps + 软件包的名字

- 下载Oracle JDK

5.解压 Oracle JDK tar -zxvf 压缩包名字

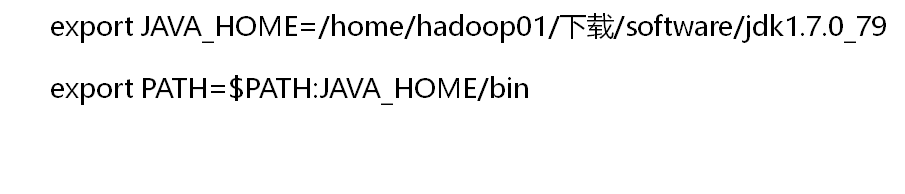

6.配置环境变量:vi /etc/profile(追加)

7.使配置文件生效: source /etc/prfile

8.检查jdk版本:java -version

2.Hadoop安装与部署

- 目前常用的Hadoop的版本有:

- Apache Hadoop

- CDH

- HDP

- 安装CDH:tar -zxvf + 压缩包的名字

- 修改配置文件:vi /etc/hadoop

-

hadoop.env.sh

Bash脚本

记录Hadoop要用的环境变量

core-site.xml

Hadoop配置XML

Hadoop Core的配置项,例如:HDFS和MapReduce常用的I/O设置等

hdfs-site.xml

Hadoop配置XML

HDFS守护进程的配置项,包括NameNode、SecondaryNameNode、DataNote等

yarn-site.xml

Hadoop配置XML

YARN守护进程的配置,包括ResourceManage和NodeManager等

mapred-site.xml

Hadoop配置XML

MapReduce计算框架的配置项

slaves

纯文本

运行DateNode和NodeManager的机器列表(每行一个)

- 修改hadoop-env.sh (在该文件的末尾加上hadoop的环境变量)

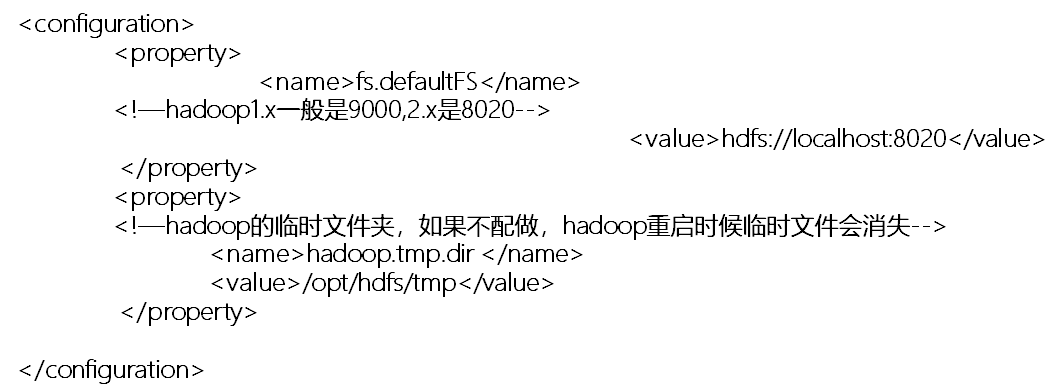

- 修改core-size.xml(etc/hadoop/core-size.xml)

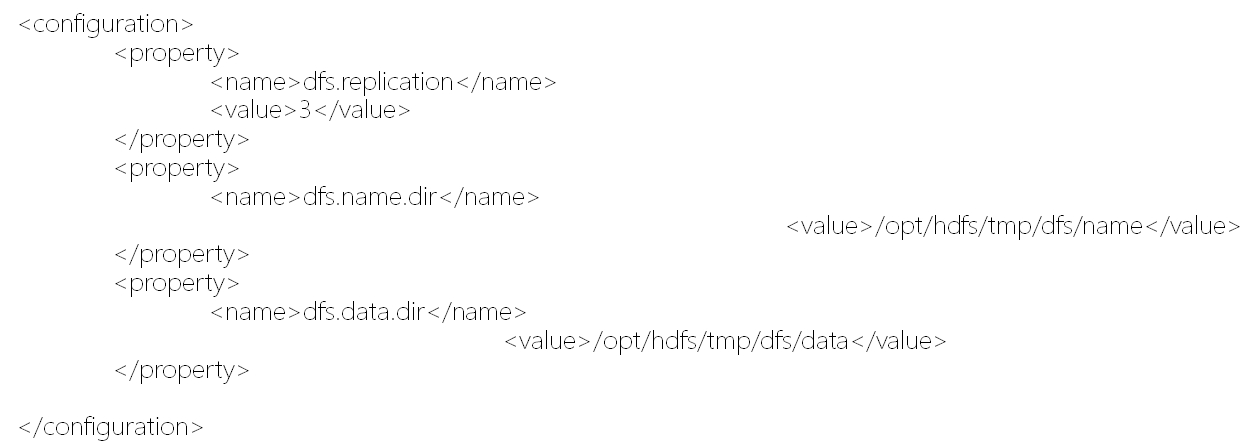

- 修改hdfs-site.xml(etc/hadoop/hdfs-site.xml)

- 修改slaves文件 改成自己的主机名

- 追加HADOOP_HOME 到/etc/profile 中

- 使配置文件生效 source /etc/profile

- 格式化HDFS : 进入bin目录执行命令:hadoop namenode -format

- 启动Hadoop并验证安装 : 进入sbin 目录执行命令 start -dfs.sh 检查是否成功:jps (出现下面四个进程表示成功)

- datanode

- secondarynamenode

- jps

- namenode

14.可在浏览器输入:http://主机名:50070 看到网页

15停止hdfs:进入sbin目录执行命令stop-dfs.sh