一、PNN的网络结构图

二、PNN的网络结构介绍

1、Input

Input是经过one-hot之后的数据,数据比较稀疏。

2、Embedding Layer Pair-wisely Connected

通过Embedding Layer将高维稀疏的数据,转换为低维稠密的数据,这样既有利于提高模型训练时的时间效率,也有利于提高模型的准确度。

f的维度为M,W的维度为M*(endi-starti+1)。

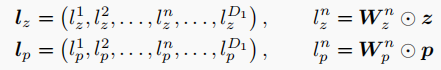

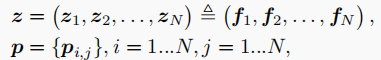

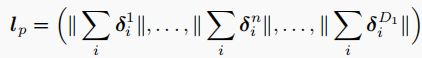

3、Product Layer Pair-wisely Connected

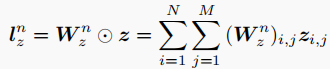

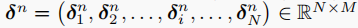

Di为第i个隐层参数的个数;M为Embedding 后单个特征的维度;N输入特征的个数。

圆圈点:任意一种运算。

z为线性变换部分,p为内积/外积部分。

z的维度为NM,p的维度为NN。

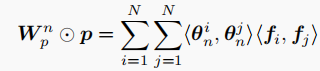

1)IPNN(内积)

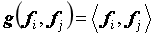

内积原理:

假设

θ的维度为N。

一阶分解的效果。

高阶分解的效果。

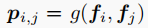

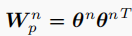

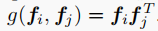

2)OPNN(外积)

外积原理:

p的维度为M*M。

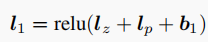

4、Hidden Layer1 Fully Connected

将Product Layer层的输出线性变换和内积/外积变换的结果进行相加,再添上一个偏置,最后经过rule函数进行激活。

b的维度为D1。

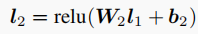

5、Hidden Layer2 Fully Connected

将Hidden Layer1 层的输出进行线性变换,再加上一个偏置,最后经过rule函数进行激活。

L1的维度为D1。

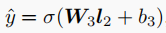

6、Output

将Hidden Layer2 层的输出进行线性变换,再加上一个偏置,最后经过sigmoid函数进行激活。输出为输出为0-1之间的一个数值。

W的维度为1*D1;b的维度为1维;l的维度为D2。

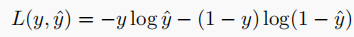

模型优化

使用交叉熵损失函数进行优化。