一、机器学习正则化

无论是机器学习还是深度学习,正则化都是一项关键的技术。其实现阶段,我们的模型都可以在训练集上去的比较好的效果,但我们的模型在测试集上的效果才是我们所关心的。因此正则化就显得尤为重要,正则化可以防止模型过拟合,增加鲁棒性。

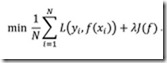

总的来说,监督学习的核心原理就是如下公式 :

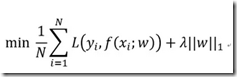

该公式分为两部分,前一项是经验最小化,后一项为正则项。经验最小化是为了极大程度的拟合训练数据,正则项则是为了防止过分拟合训练数据。机器学习中的正则项有L1正则和L2正则.

在聊这两个正则前,我们先说说L0正则。L0正则也就是矩阵中所有非0元素的个数,对于L0正则的理解就是希望参数矩阵W的大多数元素都为0,这样正则项就会很小。此时,可能会有人会说L1正则不就是在干这个事吗?这里面的原理,扯就一大堆,简答说:在机器学习中,L0和L1正则都可以实现矩阵的稀疏性,但在实践中,L1的泛化求解特征更好一些,所以人们大多使用L1正则而不是用L0正则。对于L1正则而言,L1范式就是矩阵中各个元素绝对值之和。至于为啥稀疏,稀疏的作用,主要是为了特征的选择和易于解释模型.