1. 以下关系型数据库中的表和数据,要求将其转换为适合于HBase存储的表并插入数据:

学生表(Student)(不包括最后一列)

|

学号(S_No) |

姓名(S_Name) |

性别(S_Sex) |

年龄(S_Age) |

课程(course) |

|

2015001 |

Zhangsan |

male |

23 |

|

|

2015003 |

Mary |

female |

22 |

|

|

2015003 |

Lisi |

male |

24 |

数学(Math)85 |

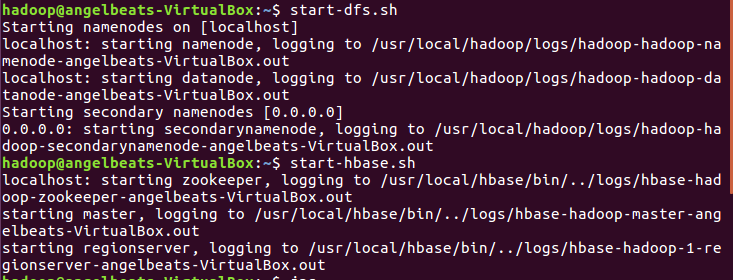

流程:1.开启dfs和hbase

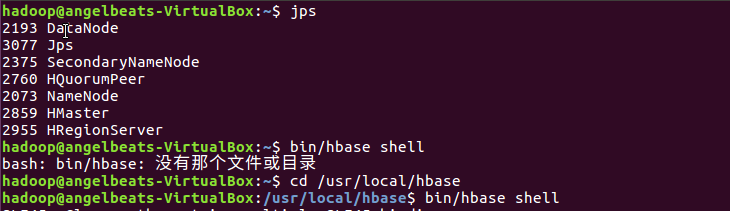

验证是否成功开启

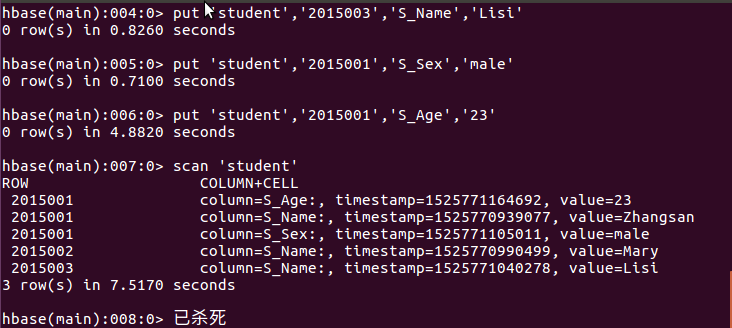

创建表,但是因为我在shell命令写的时候总会卡死,之后进程就直接被杀死了,所以下面我自己手写

2. 用Hadoop提供的HBase Shell命令完成相同任务:

- 列出HBase所有的表的相关信息;list

-

hbase(main):008:0>list

- 在终端打印出学生表的所有记录数据;

-

hbase(main):009:0>scan 'student'

- 向学生表添加课程列族;

-

hbase(main):010:0>alter 'student',{NAME=>'course',VERSIONS=>3}

- 向课程列族添加数学列并登记成绩为85;

-

'hbase(main):011:0>put 'student','2015003;','course:Math','85'

- 删除课程列;

-

disable 'student'

- 统计表的行数;count 's1'

-

count 'student'

- 清空指定的表的所有记录数据;truncate 's1'

truncate 'student'

3. 用Python编写WordCount程序任务

|

程序 |

WordCount |

|

输入 |

一个包含大量单词的文本文件 |

|

输出 |

文件中每个单词及其出现次数(频数),并按照单词字母顺序排序,每个单词和其频数占一行,单词和频数之间有间隔 |

- 编写map函数,reduce函数

- 将其权限作出相应修改

- 本机上测试运行代码

- 放到HDFS上运行

- 下载并上传文件到hdfs上

- 用Hadoop Streaming命令提交任务

流程:

1.创建mapper.py文件

cd /home/hadoop/wc

sudo gedit mapper.py

2.map函数

#!/usr/bin/env python import sys for i in stdin: i = i.strip() words = i.split() for word in words: print '%s %s' % (word,1)

3.reduce函数

#!/usr/bin/env python from operator import itemgetter import sys current_word = None current_count = 0 word = None for i in stdin: i = i.strip() word, count = i.split(' ',1) try: count = int(count) except ValueError: continue if current_word == word: current_count += count else: if current_word: print '%s %s' % (current_word, current_count) current_count = count current_word = word if current_word == word: print '%s %s' % (current_word, current_count)

4.创造reduce.py文件

cd /home/hadoop/wc

sudo gedit reducer.py

5.赋予权限及测试代码

chmod a+x /home/hadoop/mapper.py echo "foo foo quux labs foo bar quux" | /home/hadoop/wc/mapper.py echo "foo foo quux labs foo bar quux" | /home/hadoop/wc/mapper.py | sort -k1,1 | /home/hadoop/wc/reducer.p

6.下载文件上传

#上传 cd /home/hadoop/wc wget http://www.gutenberg.org/files/5000/5000-8.txt wget http://www.gutenberg.org/cache/epub/20417/pg20417.txt #下载 cd /usr/hadoop/wc hdfs dfs -put /home/hadoop/hadoop/gutenberg/*.txt /user/hadoop/input

以上在第七章PPT都有所描述。