一、下载解压

二、配置

(假设已经配置了Java、Hadoop)

1、环境变量

2、spark配置

进入spark安装目录,复制文件

编辑spark-env.sh文件,在文件中添加如下信息(括号中路径为Hadoop的路径),有了下面的配置信息以后,Spark就可以把数据存储到Hadoop分布式文件系统HDFS中,也可以从HDFS中读取数据。如果没有配置上面信息,Spark就只能读写本地数据,无法读写HDFS数据。

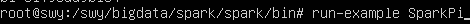

3、运行自带案例

接下来会出现版一大堆信息

4、启动spark(没有启动Hadoop)

spark-shell命令及其常用的参数如下:

spark-shell --master <master-url>

Spark的运行模式取决于传递给SparkContext的Master URL的值。Master URL可以是以下任一种形式:

(1) local 使用一个Worker线程本地化运行SPARK(完全不并行)

(2) local[*] 使用逻辑CPU个数数量的线程来本地化运行Spark

(3) local[K] 使用K个Worker线程本地化运行Spark(理想情况下,K应该根据运行机器的CPU核数设定)

(4) spark://HOST:PORT 连接到指定的Spark standalone master。默认端口是7077.

(5)yarn-client 以客户端模式连接YARN集群。集群的位置可以在HADOOP_CONF_DIR 环境变量中找到。

(6) yarn-cluster 以集群模式连接YARN集群。集群的位置可以在HADOOP_CONF_DIR 环境变量中找到。

(7) mesos://HOST:PORT 连接到指定的Mesos集群。默认接口是5050。

获取帮助信息

spark-shell --help

在Spark中采用本地模式启动Spark Shell的命令主要包含以下参数:

–master:这个参数表示当前的Spark Shell要连接到哪个master,如果是local[*],就是使用本地模式启动spark-shell,其中,中括号内的星号表示需要使用几个CPU核心(core);

–jars: 这个参数用于把相关的JAR包添加到CLASSPATH中;如果有多个jar包,可以使用逗号分隔符连接它们;

通过下面命令启动spark-shell环境:

spark-shell

该命令省略了参数,这时,系统默认是“spark-shell –master local[*]”,也就是说,是采用本地模式运行,并且使用本地所有的CPU核心。

退出:

scala>:quit