论文连接:Going deeper with convolutions

之所以名为“GoogLeNet”而非“GoogleNet”,文章说是为了向早期的LeNet致敬。在2014年的ImageNet图像识别挑战赛中,⼀个名叫GoogLeNet的⽹络结构⼤放异彩 。它虽然在名字上向LeNet致敬,但在⽹络结构上已经很难看到LeNet的影⼦。GoogLeNet吸收了NiN中⽹络串联⽹络的思想,并在此基础上做了很⼤改进。在随后的⼏年⾥,研究⼈员对GoogLeNet进⾏了数次改进。

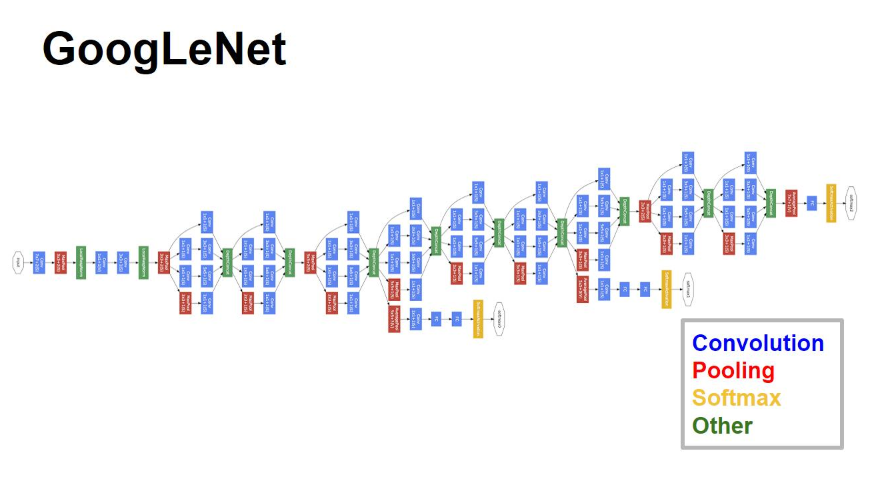

GoogleLeNet整体结构:

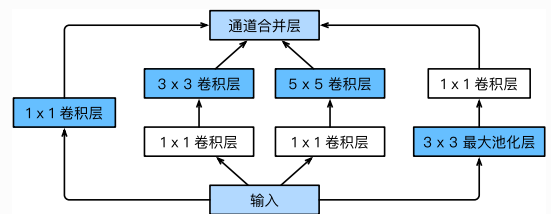

GoogLeNet中的基础卷积块叫作Inception块,得名于同名电影《盗梦空间》(Inception)。与上⼀节介绍的NiN块相⽐,这个基础块在结构上更加复杂,如下图所示:

GoogLeNet跟VGG⼀样,在主体卷积部分中使⽤5个模块(block),每个模块之间使⽤步幅为2的最⼤池化层来减⼩输出⾼宽。第⼀模块使⽤⼀个64通道的 卷积层。

- Inception块相当于⼀个有4条线路的⼦⽹络。它通过不同窗⼝形状的卷积层和最⼤池化层来并⾏抽取信息,并使⽤ 卷积层减少通道数从⽽降低模型复杂度。

- GoogLeNet将多个设计精细的Inception块和其他层串联起来。其中Inception块的通道数分配之⽐是在ImageNet数据集上通过⼤量的实验得来的。

- GoogLeNet和它的后继者们⼀度是ImageNet上最⾼效的模型之⼀:在类似的测试精度下,它们的计算复杂度往往更低。

参考链接:https://zh.d2l.ai/chapter_convolutional-neural-networks/vgg.html

参考博客:https://blog.csdn.net/shuzfan/article/details/50738394