今天完成了实验三,跟着实验三把hadoop的内容复习了一下,还学习了spark的相关内容,但是还是没有战胜eclipse,明天继续奋战,并进行实验四。

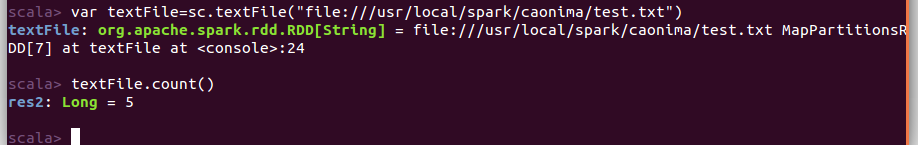

(1)在 spark-shell 中读取 Linux 系统本地文件“/home/hadoop/test.txt”,然后统计出文件的行数;

$ cd /usr/local/spark $./bin/spark-shell scala>val textFile=sc.textFile("file:///home/hadoop/test.txt") scala>textFile.count()

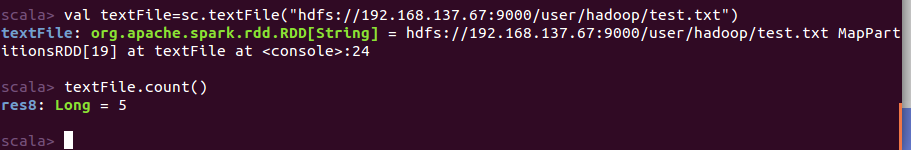

(2)在 spark-shell 中读取 HDFS 系统文件“/user/hadoop/test.txt”(如果该文件不存在,请先创建),然后,统计出文件的行数;

scala>val textFile=sc.textFile("hdfs://192.168.137.67:9000/user/hadoop/test.txt")

scala>textFile.count()

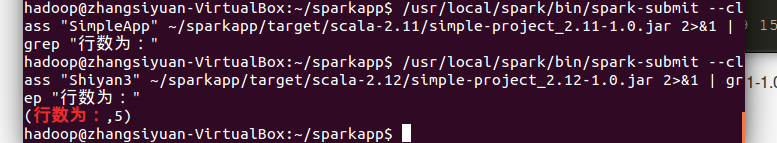

(3)编写独立应用程序,读取 HDFS 系统文件“/user/hadoop/test.txt”(如果该文件不存在,请先创建),然后,统计出文件的行数;通过 sbt 工具将整个应用程序编译打包成 JAR 包,并将生成的 JAR 包通过 spark-submit 提交到 Spark 中运行命令。

$ cd ~ $ mkdir ./sparkapp # 创建应用程序根目录 $ mkdir -p ./sparkapp/src/main/scala #创建所需的文件夹结构

在“~/sparkapp/src/main/scala”下建立一个名为 Shiyan.scala 的 Scala 代码文件

$ vim ./sparkapp/src/main/scala/Shiyan.scala

然后,在 Shiyan.scala 代码文件中输入以下代码:

import org.apache.spark.SparkContext import org.apache.spark.SparkContext._ import org.apache.spark.SparkConf object Shiyan{ def main(args: Array[String]) { val logFile = " hdfs://192.168.137.67:9000/user/hadoop/test.txt" val conf = new SparkConf().setAppName("Shiyan") val sc = new SparkContext(conf) val logData = sc.textFile(logFile, 2) val num = logData.count() printf("行数为:", num) }

}

然后进行打包

$ cd ~/sparkapp $ /usr/local/sbt/sbt package

生成的 JAR 包的位置为“~/sparkapp/target/scala-2.12/simple-project_2.12-1.0.jar”。

对于前面 sbt 打包得到的应用程序 JAR 包,可以通过 spark-submit 提交到 Spark 中运行,命令如下:

第一个命令会产生很多无用的信息,通常使用第二个提取有用信息。

$ /usr/local/spark/bin/spark-submit --class "SimpleApp" ~/sparkapp/target/scala-2.12/simple-project_2.12-1.0.jar

$ /usr/local/spark/bin/spark-submit --class "SimpleApp" ~/sparkapp/target/scala-2.12/simple-project_2.12-1.0.jar 2>&1 | grep "行数为:"