""" 1)什么是接口的后台缓存 前台访问后台接口,后台会优先从缓存(内存)中查找接口数据 如果有数据,直接对前台响应缓存数据 如果没有数据,与(mysql)数据库交互,得到数据,对前台响应,同时将数据进行缓存,以备下次使用 了解:前台缓存 - 前台在请求到接口数据后,在前台建立缓存,再发送同样请求时,发现前台缓存有数据,就不再对后台做请求了 2)什么的接口会进行接口缓存 i)接口会被大量访问:比如主页中的接口,几乎所有人都会访问,而且会重复访问 ii)在一定时间内数据不会变化(或数据不变化)的接口 iii)接口数据的时效性不是特别强(数据库数据发生变化了,不是立即同步给前台,验后时间同步给前台也没事) 注:理论上所有接口都可以建立缓存,只要数据库与缓存数据同步及时 3)如何实现接口缓存:主页轮播图接口 """

Celery 官网:http://www.celeryproject.org/

Celery 官方文档英文版:http://docs.celeryproject.org/en/latest/index.html

Celery 官方文档中文版:http://docs.jinkan.org/docs/celery/

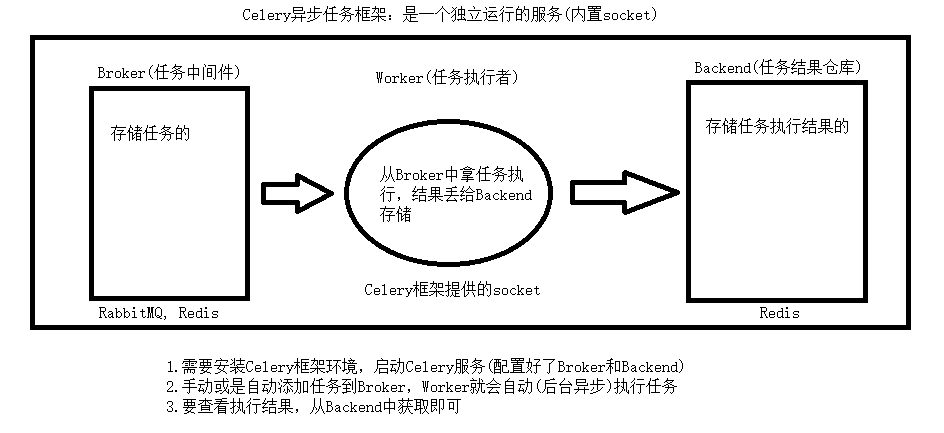

""" 1)可以不依赖任何服务器,通过自身命令,启动服务(内部支持socket) 2)celery服务为为其他项目服务提供异步解决任务需求的 注:会有两个服务同时运行,一个是项目服务,一个是celery服务,项目服务将需要异步处理的任务交给celery服务,celery就会在需要时异步完成项目的需求 人是一个独立运行的服务 | 医院也是一个独立运行的服务 正常情况下,人可以完成所有健康情况的动作,不需要医院的参与;但当人生病时,就会被医院接收,解决人生病问题 人生病的处理方案交给医院来解决,所有人不生病时,医院独立运行,人生病时,医院就来解决人生病的需求 """

使用场景

异步执行:解决耗时任务

延迟执行:解决延迟任务

定时执行:解决周期(周期)任务

Celery的安装配置

pip install celery

消息中间件:RabbitMQ/Redis

app=Celery('任务名', broker='xxx', backend='xxx')

# 如果 Celery对象:Celery(...) 是放在一个模块下的 # 1)终端切换到该模块所在文件夹位置:scripts # 2)执行启动worker的命令:celery worker -A 模块名 -l info -P eventlet # 注:windows系统需要eventlet支持,Linux与MacOS直接执行:celery worker -A 模块名 -l info # 注:模块名随意 # 如果 Celery对象:Celery(...) 是放在一个包下的 # 1)必须在这个包下建一个celery.py的文件,将Celery(...)产生对象的语句放在该文件中 # 2)执行启动worker的命令:celery worker -A 包名 -l info -P eventlet # 注:windows系统需要eventlet支持,Linux与MacOS直接执行:celery worker -A 模块名 -l info # 注:包名随意

from celery import Celery app = Celery() # 传入必要参数

# tt_celey是包 from celery import Celery app = Celery() # 传入必要参数

包架构封装

project ├── celery_task # celery包 │ ├── __init__.py # 包文件 │ ├── celery.py # celery连接和配置相关文件,且名字必须交celery.py │ └── tasks.py # 所有任务函数 ├── add_task.py # 添加任务 └── get_result.py # 获取结果

celery.py

# 1)创建app + 任务 # 2)启动celery(app)服务: # 非windows # 命令:celery worker -A celery_task -l info # -A 采用相对路径 -l日志采用info可以在控制台看到记录 最后加&代表后台启动 # windows: # pip3 install eventlet # celery worker -A celery_task -l info -P eventlet # eventlet启动进程依赖 # 3)添加任务:手动添加,要自定义添加任务的脚本,右键执行脚本 # 4)获取结果:手动获取,要自定义获取任务的脚本,右键执行脚本 from celery import Celery broker = 'redis://127.0.0.1:6379/1' backend = 'redis://127.0.0.1:6379/2' app = Celery(broker=broker, backend=backend, include=['celery_task.tasks'])

from .celery import app import time @app.task def add(n, m): print(n) print(m) time.sleep(10) print('n+m的结果:%s' % (n + m)) return n + m @app.task def low(n, m): print(n) print(m) print('n-m的结果:%s' % (n - m)) return n - m

from celery_task import tasks # 添加立即执行任务 t1 = tasks.add.delay(10, 20) t2 = tasks.low.delay(100, 50) print(t1.id) # 添加延迟任务 from datetime import datetime, timedelta eta=datetime.utcnow() + timedelta(seconds=10) tasks.low.apply_async(args=(200, 50), eta=eta)

from celery_task.celery import app from celery.result import AsyncResult # 从celery模块导入拿异步任务方式 id = '21325a40-9d32-44b5-a701-9a31cc3c74b5' if __name__ == '__main__': task_result = AsyncResult(id=id, app=app) if task_result.successful(): result = task_result.get() print(result) elif task_result.failed(): print('任务失败') elif task_result.status == 'PENDING': print('任务等待中被执行') elif task_result.status == 'RETRY': print('任务异常后正在重试') elif task_result.status == 'STARTED': print('任务已经开始被执行')

from celery import Celery # 连接redis: 'redis://:密码@服务器IP:端口/数据库编号' broker = 'redis://:Admin123@127.0.0.1:6379/1' backend = 'redis://:Admin123@127.0.0.1:6379/2' # worker配置 app = Celery(broker=broker, backend=backend, include=['celery_task_1.tasks']) # 时区 app.conf.timezone = 'Asia/Shanghai' # 是否使用UTC # app.conf.enable_utc = False # 是否采用0时区,用上面的设定,此句可省 # 定时任务的配置 ''' app.conf.beat_schedule = { '自定义定时任务名': { 'task': '指向任务函数', 'schedule': '下一次再添加任务的时间间隔或固定的时间配置', 'args': '无名参数', 'kwargs': '有名参数' } } ''' # beat配置 from datetime import timedelta from celery.schedules import crontab app.conf.beat_schedule = { 'test-task': { 'task': 'celery_task_1.tasks.test_task', 'schedule': timedelta(seconds=3), # 'schedule': crontab(hour=8, day_of_week=1), # 每周一早八点 # 'schedule': crontab(month_of_year=1, day_of_month=1,hour=12,minute=0), # 每年1月,每月1号,12点 'args': (666,), } }

>: celery beat -A celery_task_1 -l info

from .celery import app @app.task def test_task(data): print('该方法就是任务,任务被执行了,传入的参数:%s' % data) return '该内容就是任务结果' @app.task def add(n1, n2): r = n1 + n2 print('%s + %s = %s' % (n1, n2, r)) return r

# 总结:该文件一定要独立开celery封装的包 # 原因:比如celery有一个更新轮播图缓存的任务,django项目是可以响应前台或后台用户主动更新轮播图数据库的数据, # 当用户更新了数据库数据,就可以执行一下代码,通知celery可以去异步执行更新轮播图缓存的任务了 # 右键执行该文件,该文件所在路径就会在环境变量中,所以该文件下的包可以直接被导入 from celery_task_1.tasks import test_task # 直接导入函数,调用函数,和celery没有任何关系 # test_task(666) # 要将任务交给celery来执行 # 1)异步任务(立即去异步执行) => 视频同步 # t1 = test_task.delay(666) # 返回值是任务对象,直接输出代表任务唯一标识:id # print(t1.id) # 2)延迟任务(达到设定的延迟时间后再去异步执行) => 定时发送邮件 from datetime import datetime, timedelta eta = datetime.utcnow() + timedelta(seconds=10) # t2 = test_task.apply_async(args=(888, ), eta=eta) # print(t2.id) from celery_task_1.tasks import add t3 = add.apply_async(args=(33, 66), eta=eta) # t3 = add.apply_async(kwargs={'n1': 44, 'n2': 66}, eta=eta) print(t3.id) # 3)定时任务(在worker服务以外,再启动一个beat服务,定时帮我们自动添加任务) => 定时更新轮播图 # i)在celery中配置好beat_schedule的配置后,执行命令启动定时添加任务服务 # >: celery beat -A 包名|模块名 -l info

# 获取任务结果也是项目正常逻辑来调用的 from celery.result import AsyncResult from celery_task_1.celery import app id = 'fad4b75c-c168-443a-be7c-7696b3233295' if __name__ == '__main__': task_result = AsyncResult(id=id, app=app) if task_result.successful(): result = task_result.get() print(result) elif task_result.failed(): print('任务失败') elif task_result.status == 'PENDING': print('任务等待中被执行') elif task_result.status == 'RETRY': print('任务异常后正在重试') elif task_result.status == 'STARTED': print('任务已经开始被执行')

""" celery框架django项目工作流程 1)加载django配置环境 2)创建Celery框架对象app,配置broker和backend,得到的app就是worker 3)给worker对应的app添加可处理的任务函数,用include配置给worker的app 4)完成提供的任务的定时配置app.conf.beat_schedule 5)启动celery服务,运行worker,执行任务 6)启动beat服务,运行beat,添加任务 重点:由于采用了django的反射机制,使用celery.py所在的celery_task包必须放置项目的根目录下 """

# 加载django的环境 import os # 如果不想把celery_task包放在项目根目录,必须添加如下几句,将项目根目录要添加到环境变量中, # 因为加载django环境需要加载dev # import sys # sys.path.append(r'C:UsersowenDesktopluffyluffyapi') os.environ.setdefault("DJANGO_SETTINGS_MODULE", "luffyapi.settings.dev") from celery import Celery # 连接redis: broker = 'redis://:Admin123@127.0.0.1:6379/1' backend = 'redis://:Admin123@127.0.0.1:6379/2' # worker app = Celery(broker=broker, backend=backend, include=['celery_task.tasks']) # 时区 app.conf.timezone = 'Asia/Shanghai'

# 是否使用UTC

# app.conf.enable_utc = False 可以省略 # beat 任务的定时配置 from datetime import timedelta from celery.schedules import crontab app.conf.beat_schedule = { 'update-banner-list': { 'task': 'celery_task.tasks.update_banner_list', 'schedule': timedelta(seconds=10), # 'schedule': crontab(hour=8), # 每天早八点 # 'schedule': crontab(month_of_year=1, day_of_month=1,hour=12,minute=0), # 每年1月,每月1号,12点 'args': (), } }

from .celery import app from django.core.cache import cache from home import models, serializers from django.conf import settings @app.task def update_banner_list(): queryset = models.Banner.objects.filter(is_delete=False, is_show=True).order_by('-orders')[:settings.BANNER_COUNT] banner_list = serializers.BannerSerializer(queryset, many=True).data # 拿不到request对象,所以头像的连接base_url要自己组装 for banner in banner_list: banner['image'] = 'http://127.0.0.1:8000%s' % banner['image'] cache.set('banner_list', banner_list, 86400) return True

>: celery worker -A celery_task -l info -P eventlet

>: celery beat -A celery_task -l info