林子雨 实验3 中的两道操作题(操作步骤解析)

目录:

一、在 spark-shell 中读取 Linux 系统本地文件

三、编写独立应用程序,读取 HDFS 系统文件(此处有sbt安装教程——>Spark之Scala独立应用编程 )

环境:

Hadoop 2.6.0以上

java JDK 1.7以上

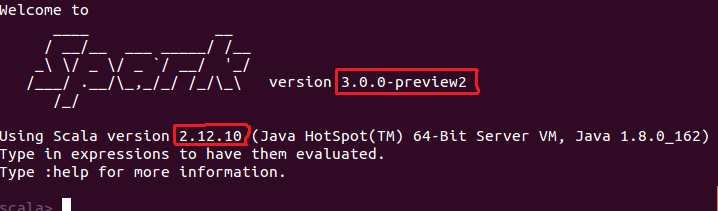

Spark 3.0.0-preview2

sbt 0.13.9

一、在 spark-shell 中读取 Linux 系统本地文件“/home/hadoop/test1.txt”,然后统计出文件的行数:

1、首先启动spark-shell进入Spark-shell模式:(进入spark目录下后 输入命令 bin/spark-shell 启动spark-shell模式)

2、加载text文件(spark创建sc,可以加载本地文件和HDFS文件创建RDD)

val textFile = sc.textFile("file:///home/hadoop/test1.txt") #注意file:后是三个“/”

注意:加载HDFS文件和本地文件都是使用textFile,区别是添加前缀(hdfs://和file://)进行标识。

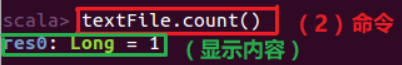

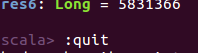

3、获取RDD文件textFile所有项(文本文件即总共行数)的计数(还有很多其他的RDD操作,自行百度)

textFile.count() #统计结果显示 1 行

二、在 spark-shell 中读取 HDFS 系统文件“/home/hadoop/test.csv(也可以是txt文件)”(如果该文件不存在, 请先创建),然后,统计出文件的行数:

方法一:

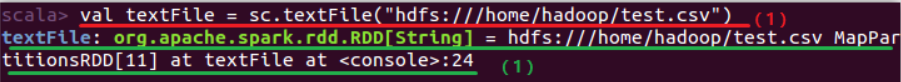

1、加载text文件(spark创建sc,可以加载本地文件和HDFS文件创建RDD)

val textFile = sc.textFile("hdfs:///home/hadoop/test.csv") #注意hdfs:后是三个“/”

注意:加载HDFS文件和本地文件都是使用textFile,区别是添加前缀(hdfs://和file://)进行标识。

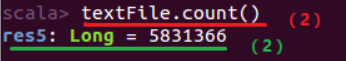

2、获取RDD文件textFile所有项的计数

textFile.count() #统计结果显示 1 行

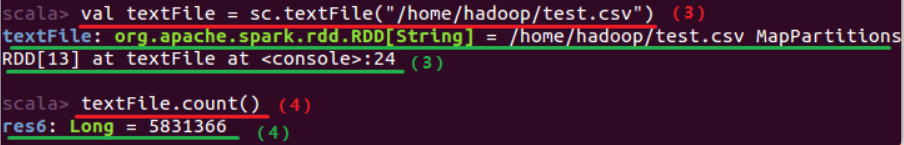

方法二:(Spark shell 默认是读取 HDFS 中的文件,需要先上传文件到 HDFS 中,否则会有“org.apache.hadoop.mapred.InvalidInputException: Input path does not exist: hdfs://localhost:9000/user/hadoop/README.md”的错误。)

1、省去方法一中第一步的命令(1)中的“hdfs://”,其他部分相同,命令如下:

三、编写独立应用程序,读取 HDFS 系统文件“/user/hadoop/test.txt”(如果该文件不存在, 请先创建),然后,统计出文件的行数;通过 sbt 工具将整个应用程序编译打包成 JAR 包, 并将生成的 JAR 包通过 spark-submit 提交到 Spark 中运行命令:

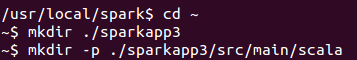

1、首先输入 :quit 命令退出spark-shell模式:

2、在终端中执行如下命令创建一个文件夹 sparkapp3 作为应用程序根目录:

cd ~ # 进入用户主文件夹

mkdir ./sparkapp3 # 创建应用程序根目录

mkdir -p ./sparkapp3/src/main/scala # 创建所需的文件夹结构

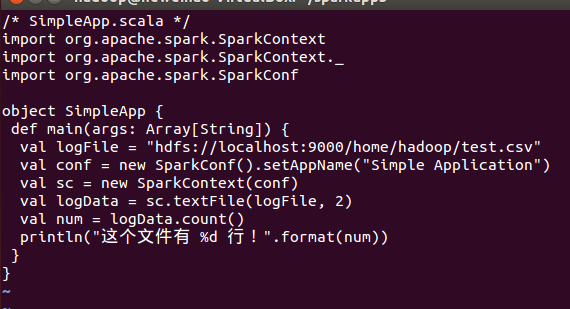

3、在 ./sparkapp3/src/main/scala 下建立一个名为 SimpleApp.scala 的文件(vim ./sparkapp3/src/main/scala/SimpleApp.scala),添加代码如下:

/* SimpleApp.scala */

import org.apache.spark.SparkContext

import org.apache.spark.SparkContext._

import org.apache.spark.SparkConf

object SimpleApp {

def main(args: Array[String]) {

val logFile = "hdfs://localhost:9000/home/hadoop/test.csv"

val conf = new SparkConf().setAppName("Simple Application")

val sc = new SparkContext(conf)

val logData = sc.textFile(logFile, 2)

val num = logData.count()

println("这个文件有 %d 行!".format(num))

}

}

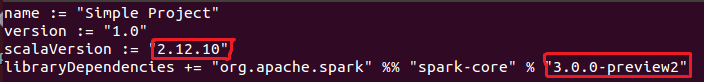

4、该程序依赖 Spark API,因此我们需要通过 sbt 进行编译打包。 ./sparkapp3 中新建文件 simple.sbt(vim ./sparkapp3/simple.sbt),添加内容如下,声明该独立应用程序的信息以及与 Spark 的依赖关系:

name := "Simple Project"

version := "1.0"

scalaVersion := "2.12.10"

libraryDependencies += "org.apache.spark" %% "spark-core" % "3.0.0-preview2"

注意:文件 simple.sbt 需要指明 Spark 和 Scala 的版本,如下图所示:

5、使用 sbt 打包 Scala 程序

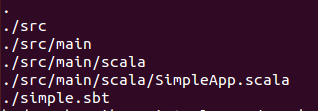

(1)为保证 sbt 能正常运行,先执行如下命令检查整个应用程序的文件结构:

cd ~/sparkapp3 #进入sparkapp3目录下

find . #显示整个应用程序的文件结构

(2)文件结构应如下图所示:

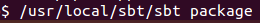

(3)接着,我们就可以通过如下代码将整个应用程序打包成 JAR:

/usr/local/sbt/sbt package

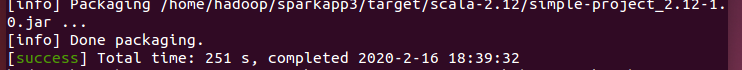

(4)打包成功的话,会输出如下图内容:

生成的 jar 包的位置为 ~/sparkapp3/target/scala-2.12/simple-project_2.12-1.0.jar。(scala-2.12和simple-project_2.12-1.0.jar处可能有所不同,读者只需要到对应的文件夹下对应查找即可)(~为主文件夹:点击虚拟机的![]() 进入就是主文件夹)

进入就是主文件夹)

4、通过 spark-submit 运行程序

(1)最后,我们就可以将生成的 jar 包通过 spark-submit 提交到 Spark 中运行了,命令如下:(红线部分就是上边说的生成的jar包的位置)

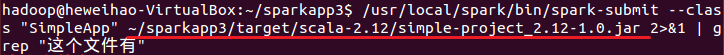

/usr/local/spark/bin/spark-submit --class "SimpleApp" ~/sparkapp3/target/scala-2.12/simple-project_2.12-1.0.jar 2>&1 | grep "这个文件有"

(2)最终得到的结果如下:

本博客参考:

Spark快速入门指南-Spark安装与基础使用 http://dblab.xmu.edu.cn/blog/spark-quick-start-guide/

大数据原理与应用 第十六章 Spark 学习指南 http://dblab.xmu.edu.cn/blog/804-2/