kubeadm介绍

kubeadm 概述

kubeadm 是一个工具,它提供了 kubeadm init 以及 kubeadm join 这两个命令作为快捷创建 kubernetes 集群的最佳实践

kubeadm 通过执行必要的操作来启动和运行一个最小可用的集群。kubeadm 只关心启动集群,而不关心其它工作,如部署前的节点准备工作、安装各种Kubernetes Dashboard、监控解决方案以及持定云提供商的插件,这些都不属于 kubeadm 关注范围。

kubeadm功能

- kubeadm init 启动一个 Kubernetes 主节点;

- kubeadm join 启动一个 Kubernetes 工作节点并且讲其加入到集群;

- kubeadm upgrade 更新一个 Kubernetes 集群到新版本;

- kubeadm config 如果使用 v1.7.x 或者更低版本的 kubeadm 初始化集群,您需要对集群做一些配置以便使用 kubeadm upgrade 命令;

- kubeadm token 管理 kubeadm join 使用的令牌;

- kubeadm reset 还原 kubeadm init 或者 kubeadm join 对主机所做的任何更改;

- kubeadm version 打印 kubeadm 版本;

- kubeadm alpha 预览一组可用的新功能以便从社区搜索反馈。

本方案描述

- 本方案采用 kubeadm 部署 Kubernetes 1.18.3版本;

- etcd 采用混部方式;

- Keepalived: 实现VIP高可用;

- HAProxy: 以系统 systemd 形式运行,提供反向代理至 3个 master 6443端口;

- 其他主要部署组件包括:

- Metrics:度量;

- Dashboard:Kubernetes 图形UI界面;

- Helm:Kubernetes Helm包管理工具;

- Ingress:Kubernetes 服务暴露;

- Longhorn:Kubernetes 动态存储组件。

集群部署规划

-节点规划

| hostname | ip | node | running server |

| master01 | 192.168.1.111 | Kubernetes master节点1 | docker、etcd、kube-apiserver、kube-scheduler、kube-controller-manager、 kubectl、kubelet、metrics、calico、HAProxy、KeepAlived |

| master02 | 192.168.1.112 | Kubernetes master节点2 | docker、etcd、kube-apiserver、kube-scheduler、kube-controller-manager、 kubectl、kubelet、metrics、calico、HAProxy、KeepAlived |

| master03 | 192.168.1.113 | Kubernetes master节点3 | docker、etcd、kube-apiserver、kube-scheduler、kube-controller-manager、 kubectl、kubelet、metrics、calico、HAProxy、KeepAlived |

| node01 | 192.168.1.114 | Kubernetes node节点1 | docker、kubelet、proxy、calico |

| node02 | 192.168.1.115 | Kubernetes node节点2 | docker、kubelet、proxy、calico |

| node03 | 192.168.1.116 | Kubernetes node节点3 | docker、kubelet、proxy、calico |

| node04 | 192.168.1.117 | Kubernetes node节点4 | docker、kubelet、proxy、calico |

|

VIP |

192.168.1.100 |

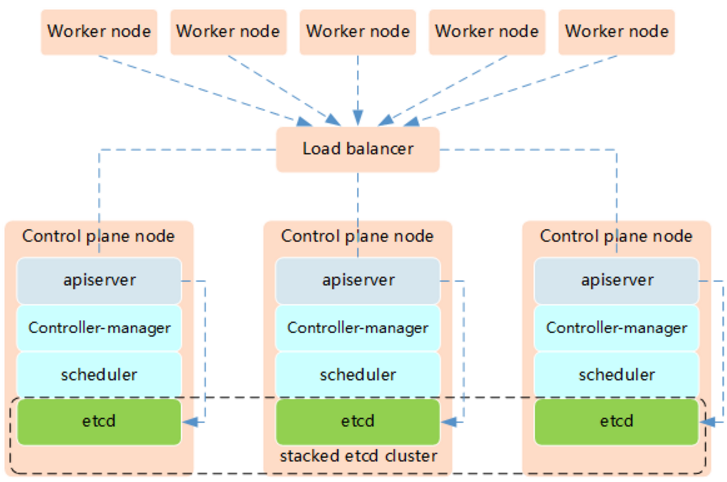

Kubernetes 的高可用主要指的是控制平面的高可用,即指多套Master 节点组件和Etcd组件,工作节点通过负载均衡连接到各Master。

Kubernetes 高可用架构中 etcd于Master 节点组件混布方式特点:

- 所需机器资源少

- 部署简单,利于管理

- 容易进行横向扩展

- 风险大,一台宿主机挂了,master和etcd就都少了一套,集群冗余度受到的影响比较大。

提示:本实验使用Keepalived+HAProxy架构实现Kubernetes的高可用。

初始准备

集群初始化-每个节点跑一遍

[root@master01 ~]# hostnamectl set-hostname master01 #其他节点依次修改 [root@master01 ~]# cat >> /etc/hosts << EOF 192.168.1.111 master01 192.168.1.112 master02 192.168.1.113 master03 192.168.1.114 node01 192.168.1.115 node02 192.168.1.116 node03

192.168.1.117 node04 EOF [root@master01 ~]# vi k8sinit.sh # Initialize the machine. This needs to be executed on every machine. # Install docker useradd -m docker

yum install -y yum-utils device-mapper-persistent-data lvm2 yum-config-manager --add-repo https://download.docker.com/linux/centos/docker-ce.repo

yum -y install docker-ce

mkdir /etc/docker cat > /etc/docker/daemon.json <<EOF { "registry-mirrors": ["https://dbzucv6w.mirror.aliyuncs.com"], "exec-opts": ["native.cgroupdriver=systemd"], "log-driver": "json-file", "log-opts": { "max-size": "100m" }, "storage-driver": "overlay2", "storage-opts": [ "overlay2.override_kernel_check=true" ] } EOF systemctl restart docker systemctl enable docker systemctl status docker # Disable the SELinux. sed -i 's/^SELINUX=.*/SELINUX=disabled/' /etc/selinux/config # Turn off and disable the firewalld. systemctl stop firewalld systemctl disable firewalld # Modify related kernel parameters & Disable the swap. cat > /etc/sysctl.d/k8s.conf << EOF net.ipv4.ip_forward = 1 net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 net.ipv4.tcp_tw_recycle = 0 vm.swappiness = 0 vm.overcommit_memory = 1 vm.panic_on_oom = 0 net.ipv6.conf.all.disable_ipv6 = 1 EOF sysctl -p /etc/sysctl.d/k8s.conf >&/dev/null swapoff -a sed -i '/ swap / s/^(.*)$/#1/g' /etc/fstab modprobe br_netfilter # Add ipvs modules cat > /etc/sysconfig/modules/ipvs.modules <<EOF #!/bin/bash modprobe -- ip_vs modprobe -- ip_vs_rr modprobe -- ip_vs_wrr modprobe -- ip_vs_sh modprobe -- nf_conntrack_ipv4 modprobe -- nf_conntrack EOF chmod 755 /etc/sysconfig/modules/ipvs.modules bash /etc/sysconfig/modules/ipvs.modules # Install rpm yum install -y conntrack ntpdate ntp ipvsadm ipset jq iptables curl sysstat libseccomp wget # Update kernel #rpm --import http://down.linuxsb.com:8888/RPM-GPG-KEY-elrepo.org #rpm -Uvh http://down.linuxsb.com:8888/elrepo-release-7.0-4.el7.elrepo.noarch.rpm rpm --import https://www.elrepo.org/RPM-GPG-KEY-elrepo.org rpm -Uvh http://www.elrepo.org/elrepo-release-7.0-2.el7.elrepo.noarch.rpm #yum --enablerepo=elrepo-kernel install kernel-ml yum --disablerepo="*" --enablerepo="elrepo-kernel" install -y kernel-ml sed -i 's/^GRUB_DEFAULT=.*/GRUB_DEFAULT=0/' /etc/default/grub grub2-mkconfig -o /boot/grub2/grub.cfg yum update -y # Reboot the machine. reboot

互信配置

为了更方便远程分发文件和执行命令,本实验配置master01节点到其它节点的 ssh 信任关系。

[root@master01 ~]# ssh-keygen -f ~/.ssh/id_rsa -N '' [root@master01 ~]# for host in master{01..03} node{01..04}; do ssh-copy-id $host;done

提示:此操作仅需要在master节点操作。

其他准备

[root@master01 ~]# vi environment.sh #!/bin/sh # 集群 MASTER 机器 IP 数组 export MASTER_IPS=(192.168.1.111 192.168.1.112 192.168.1.113) # 集群 MASTER IP 对应的主机名数组 export MASTER_NAMES=(master01 master02 master03) # 集群 NODE 机器 IP 数组 export NODE_IPS=(192.168.1.114 192.168.1.115 192.168.1.116 192.168.1.117) # 集群 NODE IP 对应的主机名数组 export NODE_NAMES=(node01 node02 node03) # 集群所有机器 IP 数组 export ALL_IPS=(192.168.1.111 192.168.1.112 192.168.1.113 192.168.1.114 192.168.1.115 192.168.1.116 192.168.1.117) # 集群所有IP 对应的主机名数组 export ALL_NAMES=(master01 master02 master03 node01 node02 node03 node04) [root@master01 ~]# source environment.sh [root@master01 ~]# chmod +x *.sh [root@master01 ~]# for all_ip in ${ALL_IPS[@]} do echo ">>> ${all_ip}" scp -rp /etc/hosts root@${all_ip}:/etc/hosts scp -rp k8sinit.sh root@${all_ip}:/root/ ssh root@${all_ip} "bash /root/k8sinit.sh" done

提示: 这条for 循环是将集群初始化脚本拷贝到 其它节点,进行运行,此方法比较慢,建议将脚本上传到其它节点上跑会比较快些

集群部署

相关组件包

需要在每台机器上都安装以下的软件包:

- kubeadm: 用来初始化集群的指令;

- kubelet: 在集群中的每个节点上用来启动 pod 和 container 等;

- kubectl: 用来与集群通信的命令行工具。

kubeadm不能安装或管理 kubelet 或 kubectl ,所以得保证他们满足通过 kubeadm 安装的 Kubernetes 控制层对版本的要求。如果版本没有满足要求,可能导致一些意外错误或问题。 具体相关组件安装见《附001.kubectl介绍及使用》。

提示:Kubernetes 1.18版本所有兼容相应组件的版本参考:https://github.com/kubernetes/kubernetes/blob/master/CHANGELOG/CHANGELOG-1.18.md。

正式安装

[root@master01 ~]# for all_ip in ${ALL_IPS[@]} do echo ">>> ${all_ip}" ssh root@${all_ip} "cat <<EOF > /etc/yum.repos.d/kubernetes.repo [kubernetes] name=Kubernetes baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/ enabled=1 gpgcheck=1 repo_gpgcheck=1 gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg EOF" ssh root@${all_ip} "yum install -y kubeadm-1.18.3-0.x86_64 kubelet-1.18.3-0.x86_64 kubectl-1.18.3-0.x86_64 --disableexcludes=kubernetes" ssh root@${all_ip} "systemctl enable kubelet" done [root@master01 ~]# yum search -y kubelet --showduplicates #查看相应版本

***提示:如上仅需Master01节点操作,从而实现所有节点自动化安装,同时此时不需要启动kubelet,初始化的过程中会自动启动的,如果此时启动了会出现报错,忽略即可。 说明:同时安装了cri-tools, kubernetes-cni, socat三个依赖: socat:kubelet的依赖; cri-tools:即CRI(Container Runtime Interface)容器运行时接口的命令行工具。

部署高可用组件

HAProxy安装

[root@master01 ~]# for master_ip in ${MASTER_IPS[@]} do echo ">>> ${master_ip}" ssh root@${master_ip} "yum -y install gcc gcc-c++ make libnl libnl-devel libnfnetlink-devel openssl-devel wget openssh-clients systemd-devel zlib-devel pcre-devel libnl3-devel" ssh root@${master_ip} "wget http://down.linuxsb.com/software/haproxy-2.1.6.tar.gz" ssh root@${master_ip} "tar -zxvf haproxy-2.1.6.tar.gz" ssh root@${master_ip} "cd haproxy-2.1.6/ && make ARCH=x86_64 TARGET=linux-glibc USE_PCRE=1 USE_OPENSSL=1 USE_ZLIB=1 USE_SYSTEMD=1 PREFIX=/usr/local/haprpxy && make install PREFIX=/usr/local/haproxy" ssh root@${master_ip} "cp /usr/local/haproxy/sbin/haproxy /usr/sbin/" ssh root@${master_ip} "useradd -r haproxy && usermod -G haproxy haproxy" ssh root@${master_ip} "mkdir -p /etc/haproxy && cp -r /root/haproxy-2.1.6/examples/errorfiles/ /usr/local/haproxy/" done

Keepalived安装

[root@master01 ~]# for master_ip in ${MASTER_IPS[@]} do echo ">>> ${master_ip}" ssh root@${master_ip} "yum -y install gcc gcc-c++ make libnl libnl-devel libnfnetlink-devel openssl-devel" ssh root@${master_ip} "wget http://down.linuxsb.com/software/keepalived-2.0.20.tar.gz" ssh root@${master_ip} "tar -zxvf keepalived-2.0.20.tar.gz" ssh root@${master_ip} "cd keepalived-2.0.20/ && ./configure --sysconf=/etc --prefix=/usr/local/keepalived && make && make install" done

提示:如上仅需Master01节点操作,从而实现所有节点自动化安装。

创建配置文件

[root@master01 ~]# wget http://down.linuxsb.com/hakek8s.sh #拉取自动部署脚本 [root@master01 ~]# chmod u+x hakek8s.sh [root@master01 ~]# vi hakek8s.sh #!/bin/bash ####################################### # set variables below to create the config files, all files will create at ./config directory ####################################### # master keepalived virtual ip address export K8SHA_VIP=192.168.1.100 # master01 ip address export K8SHA_IP1=192.168.1.111 # master02 ip address export K8SHA_IP2=192.168.1.112 # master03 ip address export K8SHA_IP3=192.168.1.113 # master01 hostname export K8SHA_HOST1=master01 # master02 hostname export K8SHA_HOST2=master02 # master03 hostname export K8SHA_HOST3=master03 # master01 network interface name export K8SHA_NETINF1=ens33 # master02 network interface name export K8SHA_NETINF2=ens33 # master03 network interface name export K8SHA_NETINF3=ens33 # keepalived auth_pass config export K8SHA_KEEPALIVED_AUTH=412f7dc3bfed32194d1600c483e10ad1d # kubernetes CIDR pod subnet export K8SHA_PODCIDR=10.10.0.0 # kubernetes CIDR svc subnet export K8SHA_SVCCIDR=10.20.0.0 [root@master01 ~]# ./hakek8s.sh

解释:如上仅需Master01节点操作。执行hakek8s.sh脚本后会生产如下配置文件清单:

kubeadm-config.yaml:kubeadm初始化配置文件,位于当前目录keepalived:keepalived配置文件,位于各个master节点的/etc/keepalived目录haproxy:haproxy的配置文件,位于各个master节点的/etc/haproxy/目录calico.yaml:calico网络组件部署文件,位于config/calico/目录

[root@master01 ~]# cat kubeadm-config.yaml #检查集群初始化配置 apiVersion: kubeadm.k8s.io/v1beta2 kind: ClusterConfiguration networking: serviceSubnet: "10.20.0.0/16" #设置svc网段 podSubnet: "10.10.0.0/16" #设置Pod网段 dnsDomain: "cluster.local" kubernetesVersion: "v1.18.3" #设置安装版本 controlPlaneEndpoint: "192.168.1.100:16443" #设置相关API VIP地址 apiServer: certSANs: - master01 - master02 - master03 - 127.0.0.1 - 192.168.1.111 - 192.168.1.112 - 192.168.1.113 - 192.168.1.200 timeoutForControlPlane: 4m0s certificatesDir: "/etc/kubernetes/pki" imageRepository: "k8s.gcr.io" --- apiVersion: kubeproxy.config.k8s.io/v1alpha1 kind: KubeProxyConfiguration featureGates: SupportIPVSProxyMode: true mode: ipvs

提示:如上仅需Master01节点操作,更多config文件参考:https://godoc.org/k8s.io/kubernetes/cmd/kubeadm/app/apis/kubeadm/v1beta2。此kubeadm部署初始化配置更多参考:https://pkg.go.dev/k8s.io/kubernetes/cmd/kubeadm/app/apis/kubeadm/v1beta2?tab=doc。

启动服务

[root@master01 ~]# cat /etc/keepalived/keepalived.conf [root@master01 ~]# cat /etc/keepalived/check_apiserver.sh 确认Keepalived配置 [root@master01 ~]# for master_ip in ${MASTER_IPS[@]} do echo ">>> ${master_ip}" ssh root@${master_ip} "systemctl start haproxy.service && systemctl enable haproxy.service" ssh root@${master_ip} "systemctl start keepalived.service && systemctl enable keepalived.service" ssh root@${master_ip} "systemctl status keepalived.service | grep Active" ssh root@${master_ip} "systemctl status haproxy.service | grep Active" done [root@master01 ~]# for all_ip in ${ALL_IPS[@]} do echo ">>> ${all_ip}" ssh root@${all_ip} "ping -c1 192.168.1.100" done #等待30s执行检查

提示:如上仅需Master01节点操作,从而实现所有节点自动启动服务。

解释:如上仅需Master01节点操作。执行hakek8s.sh脚本后会生产如下配置文件清单:

- kubeadm-config.yaml:kubeadm初始化配置文件,位于当前目录

- keepalived:keepalived配置文件,位于各个master节点的/etc/keepalived目录

- haproxy:haproxy的配置文件,位于各个master节点的/etc/haproxy/目录

- calico.yaml:calico网络组件部署文件,位于config/calico/目录

初始化集群

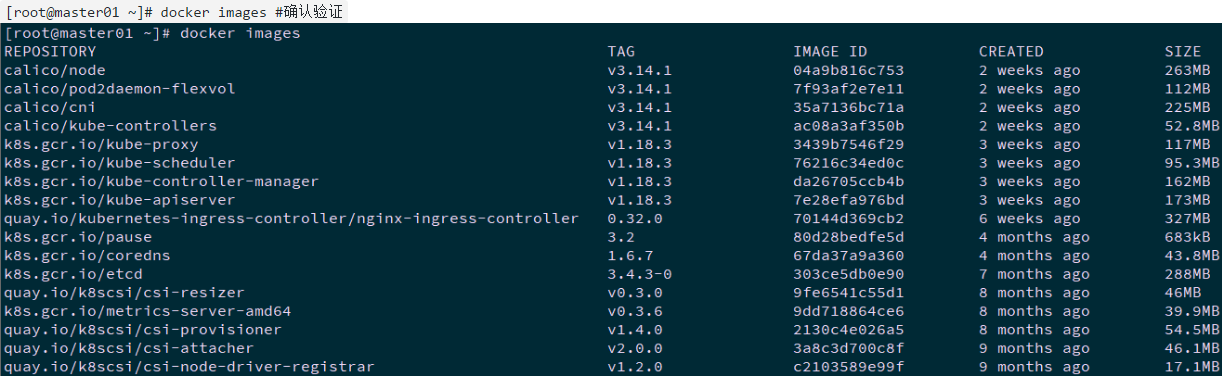

拉取镜像

[root@master01 ~]# kubeadm --kubernetes-version=v1.18.3 config images list #列出所需镜像 [root@master01 ~]# cat config/downimage.sh #确认版本 #!/bin/sh KUBE_VERSION=v1.18.3 CALICO_VERSION=v3.14.1 CALICO_URL=calico KUBE_PAUSE_VERSION=3.2 ETCD_VERSION=3.4.3-0 CORE_DNS_VERSION=1.6.7 GCR_URL=k8s.gcr.io METRICS_SERVER_VERSION=v0.3.6 INGRESS_VERSION=0.32.0 CSI_PROVISIONER_VERSION=v1.4.0 CSI_NODE_DRIVER_VERSION=v1.2.0 CSI_ATTACHER_VERSION=v2.0.0 CSI_RESIZER_VERSION=v0.3.0 ALIYUN_URL=registry.cn-hangzhou.aliyuncs.com/google_containers UCLOUD_URL=uhub.service.ucloud.cn/uxhy QUAY_URL=quay.io kubeimages=(kube-proxy:${KUBE_VERSION} kube-scheduler:${KUBE_VERSION} kube-controller-manager:${KUBE_VERSION} kube-apiserver:${KUBE_VERSION} pause:${KUBE_PAUSE_VERSION} etcd:${ETCD_VERSION} coredns:${CORE_DNS_VERSION} metrics-server-amd64:${METRICS_SERVER_VERSION} ) for kubeimageName in ${kubeimages[@]} ; do docker pull $UCLOUD_URL/$kubeimageName docker tag $UCLOUD_URL/$kubeimageName $GCR_URL/$kubeimageName docker rmi $UCLOUD_URL/$kubeimageName done calimages=(cni:${CALICO_VERSION} pod2daemon-flexvol:${CALICO_VERSION} node:${CALICO_VERSION} kube-controllers:${CALICO_VERSION}) for calimageName in ${calimages[@]} ; do docker pull $UCLOUD_URL/$calimageName docker tag $UCLOUD_URL/$calimageName $CALICO_URL/$calimageName docker rmi $UCLOUD_URL/$calimageName done ingressimages=(nginx-ingress-controller:${INGRESS_VERSION}) for ingressimageName in ${ingressimages[@]} ; do docker pull $UCLOUD_URL/$ingressimageName docker tag $UCLOUD_URL/$ingressimageName $QUAY_URL/kubernetes-ingress-controller/$ingressimageName docker rmi $UCLOUD_URL/$ingressimageName done csiimages=(csi-provisioner:${CSI_PROVISIONER_VERSION} csi-node-driver-registrar:${CSI_NODE_DRIVER_VERSION} csi-attacher:${CSI_ATTACHER_VERSION} csi-resizer:${CSI_RESIZER_VERSION} ) for csiimageName in ${csiimages[@]} ; do docker pull $UCLOUD_URL/$csiimageName docker tag $UCLOUD_URL/$csiimageName $QUAY_URL/k8scsi/$csiimageName docker rmi $UCLOUD_URL/$csiimageName done

[root@master01 ~]# for all_ip in ${ALL_IPS[@]} do echo ">>> ${all_ip}" scp -rp config/downimage.sh root@${all_ip}:/root/ ssh root@${all_ip} "bash downimage.sh &" done

提示:如上仅需Master01节点操作,从而实现所有节点自动拉取镜像。

在master上初始化

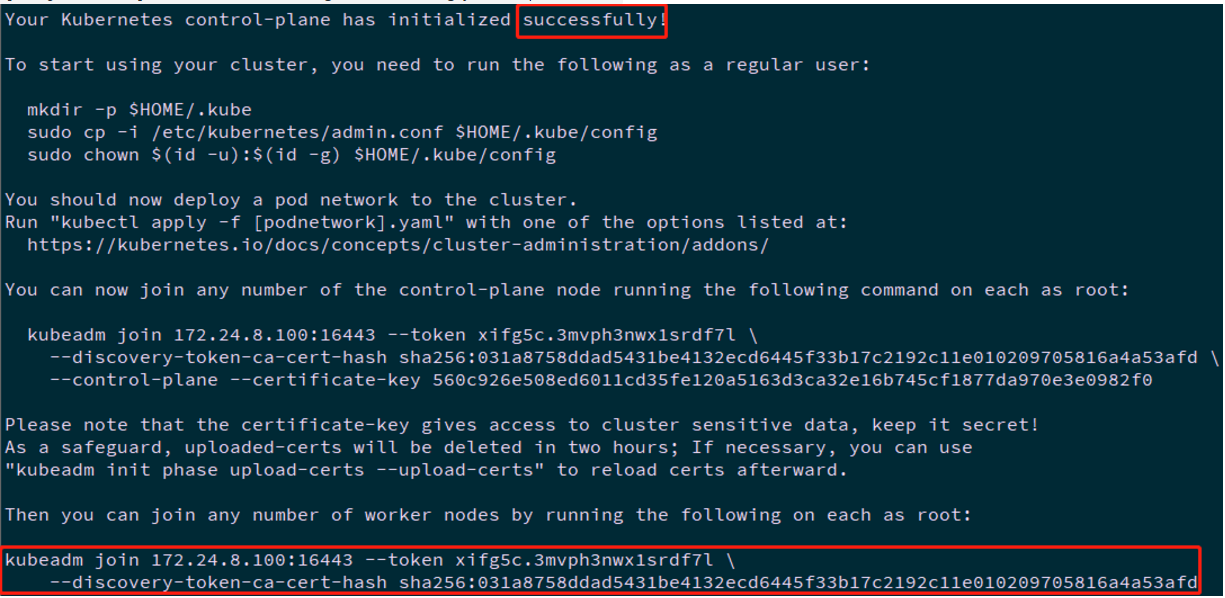

[root@master01 ~]# kubeadm init --config=kubeadm-config.yaml --upload-certs

注意:如上token具有默认24小时的有效期,token和hash值可通过如下方式获取: kubeadm token list 如果 Token 过期以后,可以输入以下命令,生成新的 Token:

kubeadm token create openssl x509 -pubkey -in /etc/kubernetes/pki/ca.crt | openssl rsa -pubin -outform der 2>/dev/null | openssl dgst -sha256 -hex | sed 's/^.* //' [root@master01 ~]# mkdir -p $HOME/.kube [root@master01 ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config [root@master01 ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config [root@master01 ~]# cat << EOF >> ~/.bashrc export KUBECONFIG=$HOME/.kube/config EOF #设置KUBECONFIG环境变量 [root@master01 ~]# echo "source <(kubectl completion bash)" >> ~/.bashrc [root@master01 ~]# source ~/.bashrc

附加:初始化过程大致步骤如下:

- [kubelet-start] 生成kubelet的配置文件”/var/lib/kubelet/config.yaml”

- [certificates]生成相关的各种证书

- [kubeconfig]生成相关的kubeconfig文件

- [bootstraptoken]生成token记录下来,后边使用kubeadm join往集群中添加节点时会用到

[root@master02 ~]# kubeadm join 172.24.8.100:16443 --token xifg5c.3mvph3nwx1srdf7l --discovery-token-ca-cert-hash sha256:031a8758ddad5431be4132ecd6445f33b17c2192c11e010209705816a4a53afd --control-plane --certificate-key 560c926e508ed6011cd35fe120a5163d3ca32e16b745cf1877da970e3e0982f0 [root@master02 ~]# mkdir -p $HOME/.kube [root@master02 ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config [root@master02 ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config [root@master02 ~]# cat << EOF >> ~/.bashrc export KUBECONFIG=$HOME/.kube/config EOF #设置KUBECONFIG环境变量 [root@master02 ~]# echo "source <(kubectl completion bash)" >> ~/.bashrc [root@master02 ~]# source ~/.bashrc

提示:初始化仅需要在master01上执行,若初始化异常可通过kubeadm reset && rm -rf $HOME/.kube重置。

添加其他master节点

kubeadm init phase upload-certs --upload-certs

添加 master 节点需要加上 --control-plane --certificate-key

[root@master02 ~]# kubeadm join 172.24.8.100:16443 --token xifg5c.3mvph3nwx1srdf7l --discovery-token-ca-cert-hash sha256:031a8758ddad5431be4132ecd6445f33b17c2192c11e010209705816a4a53afd --control-plane --certificate-key 560c926e508ed6011cd35fe120a5163d3ca32e16b745cf1877da970e3e0982f0 [root@master02 ~]# mkdir -p $HOME/.kube [root@master02 ~]# sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config [root@master02 ~]# sudo chown $(id -u):$(id -g) $HOME/.kube/config [root@master02 ~]# cat << EOF >> ~/.bashrc export KUBECONFIG=$HOME/.kube/config EOF #设置KUBECONFIG环境变量 [root@master02 ~]# echo "source <(kubectl completion bash)" >> ~/.bashrc [root@master02 ~]# source ~/.bashrc

提示:master03也如上执行添加至集群的controlplane。 提示:若添加异常可通过kubeadm reset && rm -rf $HOME/.kube重置。

安装NIC插件

NIC插件介绍

- Calico 是一个安全的 L3 网络和网络策略提供者。

- Canal 结合 Flannel 和 Calico, 提供网络和网络策略。

- Cilium 是一个 L3 网络和网络策略插件, 能够透明的实施 HTTP/API/L7 策略。 同时支持路由(routing)和叠加/封装( overlay/encapsulation)模式。

- Contiv 为多种用例提供可配置网络(使用 BGP 的原生 L3,使用 vxlan 的 overlay,经典 L2 和 Cisco-SDN/ACI)和丰富的策略框架。Contiv 项目完全开源。安装工具同时提供基于和不基于 kubeadm 的安装选项。

- Flannel 是一个可以用于 Kubernetes 的 overlay 网络提供者。

- Romana 是一个 pod 网络的层 3 解决方案,并且支持 NetworkPolicy API。Kubeadm add-on 安装细节可以在这里找到。

- Weave Net 提供了在网络分组两端参与工作的网络和网络策略,并且不需要额外的数据库。

- CNI-Genie 使 Kubernetes 无缝连接到一种 CNI 插件,例如:Flannel、Calico、Canal、Romana 或者 Weave。 提示:本方案使用Calico插件。

设置标签

[root@master01 ~]# kubectl taint nodes --all node-role.kubernetes.io/master- #允许master部署应用

提示:部署完内部应用后可使用kubectl taint node master01 node-role.kubernetes.io/master="":NoSchedule重新设置Master为Master Only 状态。

部署calico

[root@master01 ~]# cat config/calico/calico.yaml #检查配置 …… - name: CALICO_IPV4POOL_CIDR value: "10.10.0.0/16" #检查Pod网段 …… - name: IP_AUTODETECTION_METHOD value: "interface=ens.*" #检查节点之间的网卡 # Auto-detect the BGP IP address. - name: IP value: "autodetect" …… [root@master01 ~]# kubectl apply -f config/calico/calico.yaml [root@master01 ~]# kubectl get pods --all-namespaces -o wide #查看部署 [root@master01 ~]# kubectl get nodes

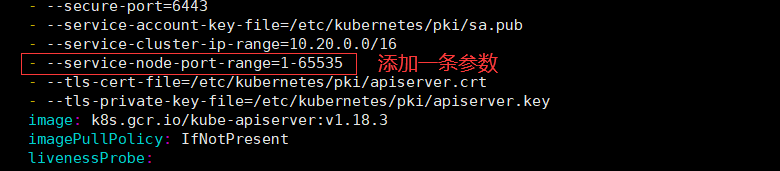

修改node端口范围

[root@master01 ~]# vi /etc/kubernetes/manifests/kube-apiserver.yaml …… - --service-node-port-range=1-65535 ……

提示:如上仅需在所有Master节点操作。

https://www.cnblogs.com/itzgr/p/13139247.html#_labelTop)

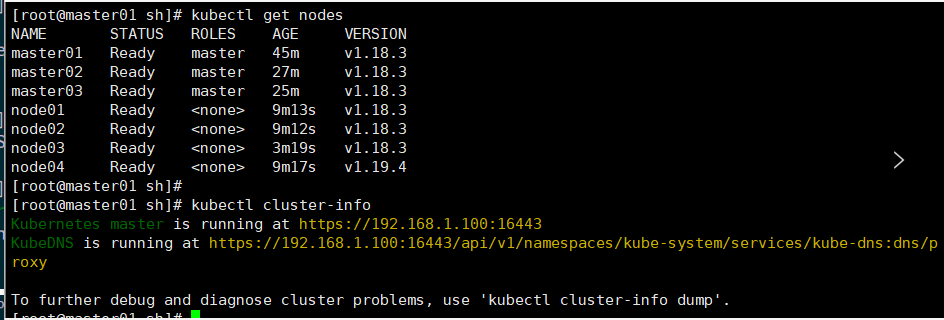

添加node节点

添加node节点

[root@master01 ~]# for node_ip in ${NODE_IPS[@]} do echo ">>> ${node_ip}" ssh root@${node_ip} "kubeadm join 172.24.8.100:16443 --token xifg5c.3mvph3nwx1srdf7l --discovery-token-ca-cert-hash sha256:031a8758ddad5431be4132ecd6445f33b17c2192c11e010209705816a4a53afd" ssh root@${node_ip} "systemctl enable kubelet.service" done

提示:如上仅需Master01节点操作,从而实现所有Worker节点添加至集群,若添加异常可通过如下方式重置:

[root@node01 ~]# kubeadm reset [root@node01 ~]# ifconfig cni0 down [root@node01 ~]# ip link delete cni0 [root@node01 ~]# ifconfig flannel.1 down [root@node01 ~]# ip link delete flannel.1 [root@node01 ~]# rm -rf /var/lib/cni/

确认验证

[root@master01 ~]# kubectl get nodes #节点状态 [root@master01 ~]# kubectl get cs #组件状态 [root@master01 ~]# kubectl get serviceaccount #服务账户 [root@master01 ~]# kubectl cluster-info #集群信息 [root@master01 ~]# kubectl get pod -n kube-system -o wide #所有服务状态

提示:更多Kubetcl使用参考:https://kubernetes.io/docs/reference/kubectl/kubectl/https://kubernetes.io/docs/reference/kubectl/overview/ 更多kubeadm使用参考:https://kubernetes.io/docs/reference/setup-tools/kubeadm/kubeadm/

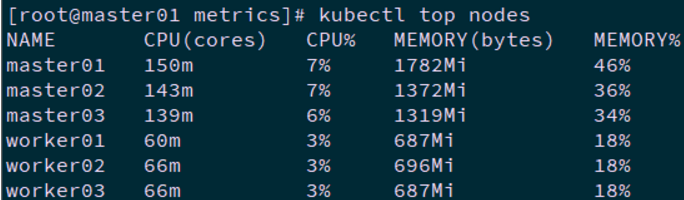

Metrics部署

Metrics介绍

Kubernetes的早期版本依靠Heapster来实现完整的性能数据采集和监控功能,Kubernetes从1.8版本开始,性能数据开始以Metrics API的方式提供标准化接口,并且从1.10版本开始将Heapster替换为Metrics Server。在Kubernetes新的监控体系中,Metrics Server用于提供核心指标(Core Metrics),包括Node、Pod的CPU和内存使用指标。 对其他自定义指标(Custom Metrics)的监控则由Prometheus等组件来完成。

开启聚合层

有关聚合层知识参考:https://blog.csdn.net/liukuan73/article/details/81352637 kubeadm方式部署默认已开启。

获取部署文件

[root@master01 ~]# mkdir metrics [root@master01 ~]# cd metrics/ [root@master01 metrics]# wget https://github.com/kubernetes-sigs/metrics-server/releases/download/v0.3.6/components.yaml [root@master01 metrics]# vi components.yaml …… apiVersion: apps/v1 kind: Deployment …… spec: replicas: 3 #根据集群规模调整副本数 …… spec: hostNetwork: true …… - name: metrics-server image: k8s.gcr.io/metrics-server-amd64:v0.3.6 imagePullPolicy: IfNotPresent args: - --cert-dir=/tmp - --secure-port=4443 - --kubelet-insecure-tls - --kubelet-preferred-address-types=InternalIP,Hostname,InternalDNS,ExternalDNS,ExternalIP #追加此args ……

正式部署

[root@master01 metrics]# kubectl apply -f components.yaml [root@master01 metrics]# kubectl -n kube-system get pods -l k8s-app=metrics-server NAME READY STATUS RESTARTS AGE metrics-server-7b97647899-8txt4 1/1 Running 0 53s metrics-server-7b97647899-btdwp 1/1 Running 0 53s metrics-server-7b97647899-kbr8b 1/1 Running 0 53s

查看资源监控

[root@k8smaster01 ~]# kubectl top nodes [root@master01 metrics]# kubectl top pods --all-namespaces

Server提供的数据也可以供HPA控制器使用,以实现基于CPU使用率或内存使用值的Pod自动扩缩容功能。 部署参考:https://linux48.com/container/2019-11-13-metrics-server.html 有关metrics更多部署参考: https://kubernetes.io/docs/tasks/debug-application-cluster/resource-metrics-pipeline/ 开启开启API Aggregation参考: https://kubernetes.io/docs/concepts/extend-kubernetes/api-extension/apiserver-aggregation/ API Aggregation介绍参考: https://kubernetes.io/docs/tasks/access-kubernetes-api/configure-aggregation-layer/

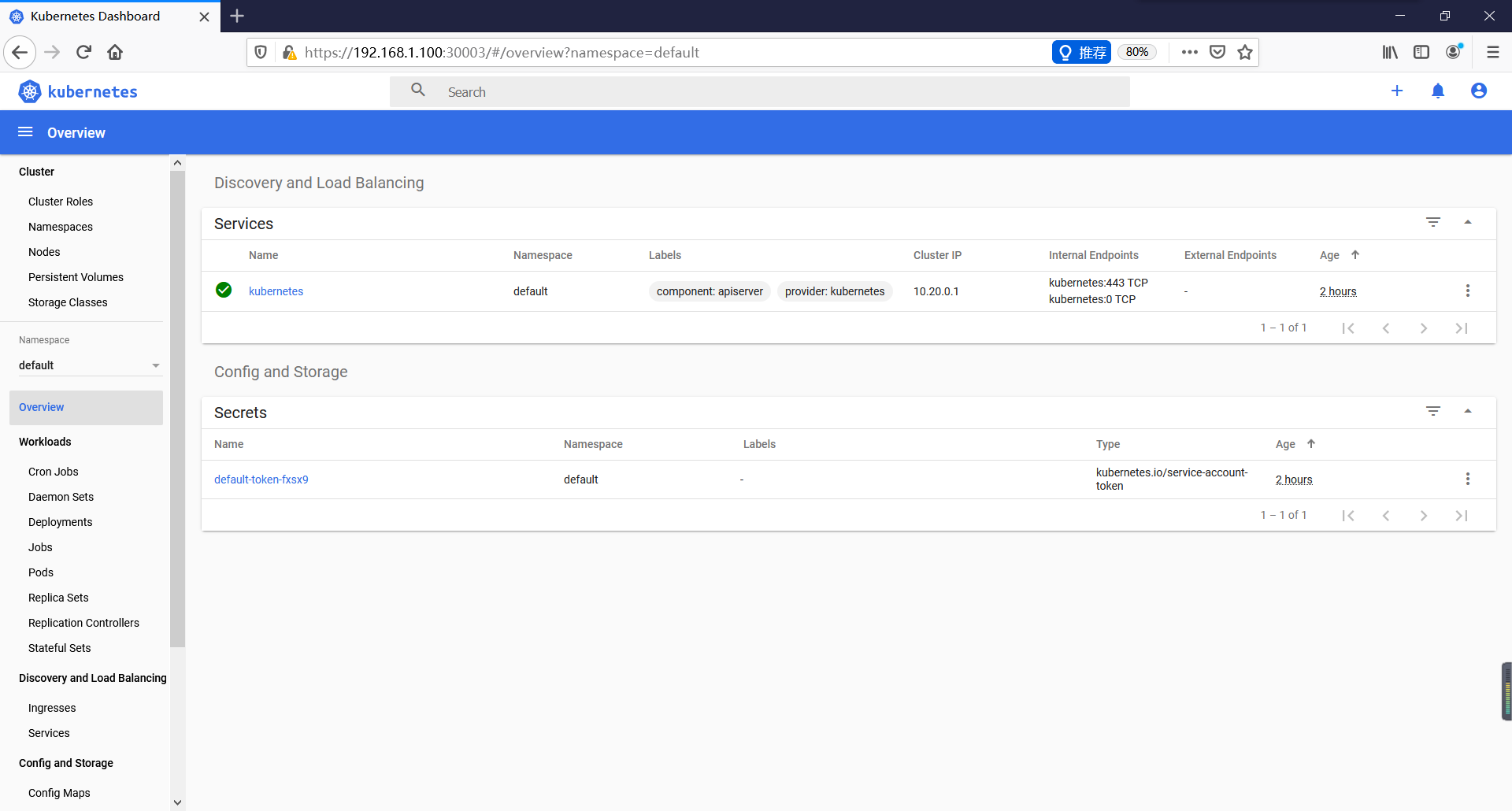

dashboard部署

下载并修改Dashboard安装脚本

下载官网安装说明的recommended.yaml脚本:

wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.0.0-beta5/aio/deploy/recommended.yaml

修改recommended.yaml文件内容:

--- #增加直接访问端口 kind: Service apiVersion: v1 metadata: labels: k8s-app: kubernetes-dashboard name: kubernetes-dashboard namespace: kubernetes-dashboard spec: type: NodePort #增加 ports: - port: 443 targetPort: 8443 nodePort: 30003 #增加 selector: k8s-app: kubernetes-dashboard ##因为自动生成的证书很多浏览器无法使用, ##所以我们自己创建,注释掉kubernetes-dashboard-certs对象声明 #--- #apiVersion: v1 #kind: Secret #metadata: # labels: # k8s-app: kubernetes-dashboard # name: kubernetes-dashboard-certs # namespace: kubernetes-dashboard #type: Opaque --- ...

创建证书

mkdir dashboard-certs cd dashboard-certs/ #创建命名空间 kubectl create namespace kubernetes-dashboard # 创建key文件 openssl genrsa -out dashboard.key 2048 #证书请求 openssl req -days 36000 -new -out dashboard.csr -key dashboard.key -subj '/CN=dashboard-cert' #自签证书 openssl x509 -req -in dashboard.csr -signkey dashboard.key -out dashboard.crt #创建kubernetes-dashboard-certs对象 kubectl create secret generic kubernetes-dashboard-certs --from-file=dashboard.key --from-file=dashboard.crt -n kubernetes-dashboard

安装Dashboard

#安装 kubectl create -f ~/recommended.yaml #检查结果 [root@k8s-master ~]# kubectl get service -n kubernetes-dashboard -o wide NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE SELECTOR dashboard-metrics-scraper ClusterIP 10.96.113.127 <none> 8000/TCP 16s k8s-app=dashboard-metrics-scraper kubernetes-dashboard NodePort 10.96.203.158 <none> 443:30008/TCP 16s k8s-app=kubernetes-dashboard

创建dashboard管理员

新建一个yaml文件:

vi dashboard-admin.yaml

内容:#创建账号: apiVersion: v1 kind: ServiceAccount metadata: labels: k8s-app: kubernetes-dashboard name: dashboard-admin namespace: kubernetes-dashboard --- #为用户分配权限: apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRoleBinding metadata: name: dashboard-admin-bind-cluster-role labels: k8s-app: kubernetes-dashboard roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: cluster-admin subjects: - kind: ServiceAccount name: dashboard-admin namespace: kubernetes-dashboard

保存退出后执行

kubectl create -f dashboard-admin.yaml

查看并复制用户Token

[root@k8s-master ~]# kubectl -n kubernetes-dashboard describe secret $(kubectl -n kubernetes-dashboard get secret | grep dashboard-admin | awk '{print $1}') Name: dashboard-admin-token-qxh98 Namespace: kubernetes-dashboard Labels: <none> Annotations: kubernetes.io/service-account.name: dashboard-admin kubernetes.io/service-account.uid: 04d65d27-2696-4646-a153-4ad1c79922cb Type: kubernetes.io/service-account-token Data ==== ca.crt: 1025 bytes namespace: 20 bytes token: eyJhbGciOiJSUzI1NiIsImtpZCI6ImxnSHVWam1TMG83emhKMlBQNUxteHI2YklDc2FCV1NUck4tXzVoS3N1dVUifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJrdWJlcm5ldGVzLWRhc2hib2FyZCIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VjcmV0Lm5hbWUiOiJkYXNoYm9hcmQtYWRtaW4tdG9rZW4tcXhoOTgiLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlcnZpY2UtYWNjb3VudC5uYW1lIjoiZGFzaGJvYXJkLWFkbWluIiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZXJ2aWNlLWFjY291bnQudWlkIjoiMDRkNjVkMjctMjY5Ni00NjQ2LWExNTMtNGFkMWM3OTkyMmNiIiwic3ViIjoic3lzdGVtOnNlcnZpY2VhY2NvdW50Omt1YmVybmV0ZXMtZGFzaGJvYXJkOmRhc2hib2FyZC1hZG1pbiJ9.ScSVuBaLFxGqnLj5w_rS_1rNbi0bC2TqmJarcc4ygwxIfUMeC90qp6upyeYsB-r7MO6Qd5fPgeVwvJK2FyT43vaqHgb6EBoMqvvfn58_TI1aZBY-Td3pzyUjk0PG50b88Rs2guhuo4pl5vtLWH4LgpVIqpfAKkXuqTAavfnjhFlnkJ3YNAOlPOh1jbWSHSM_FSrpYJ6ZmN0YGCm1tWnPItFNjo1ZJMikhU7rsKnWK1yfYF-5ne5N2pTVOMWrExnN6N78kYctdAi0w00j2bR7F89CfRN1ssq69blh_Q9mZfC5dC0t_tuyAQ46qIVKkrzqmlx5HD23vNyJnyFvEuF8HQ

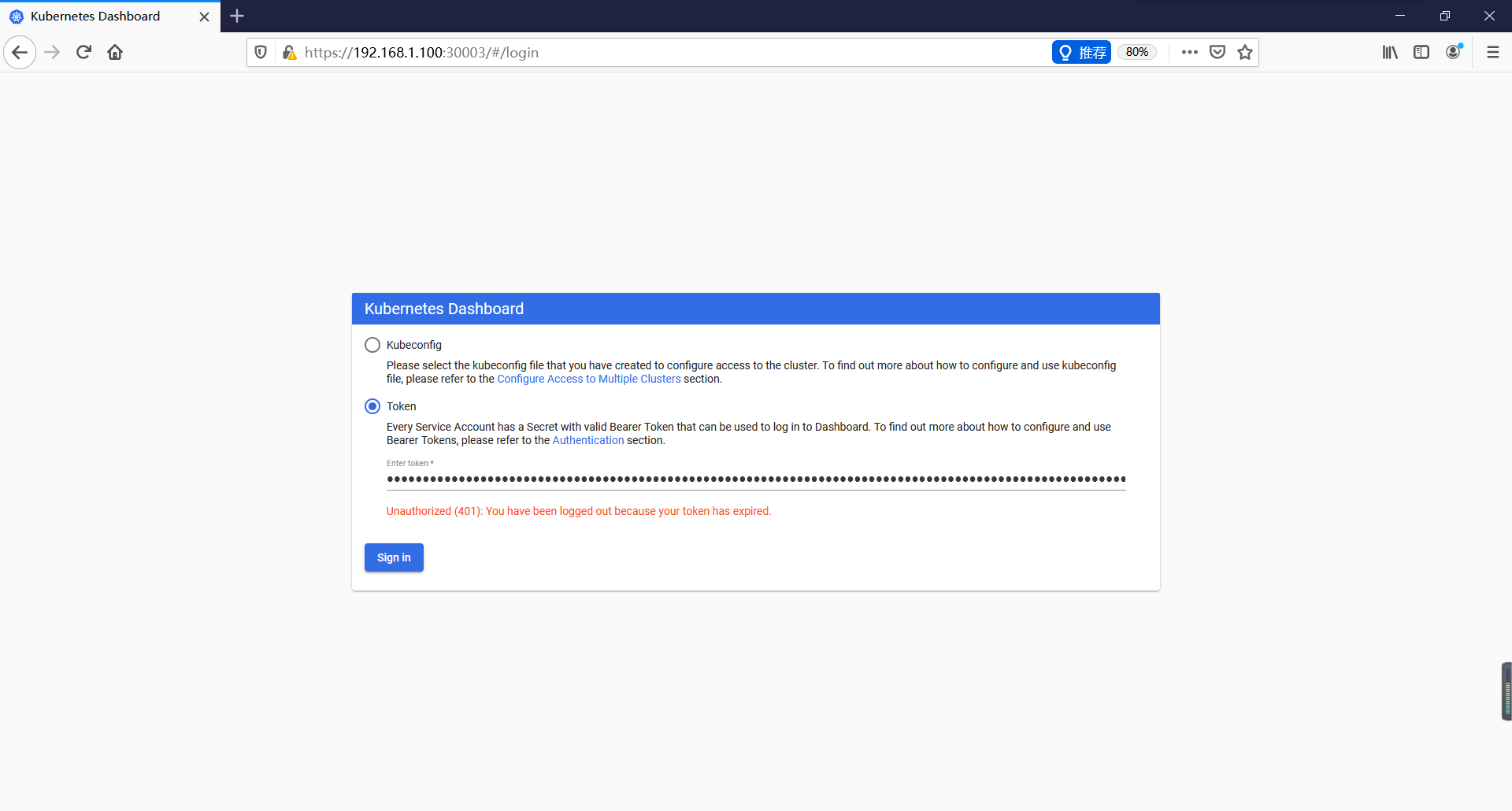

登录Dashboard

访问:https://192.168.1.111:30003,选择Token登录,复制刚才生成的密钥。 注意,IP为任意node节点的对外的IP.