集成学习--Bagging、Boosting、Stacking、Blending

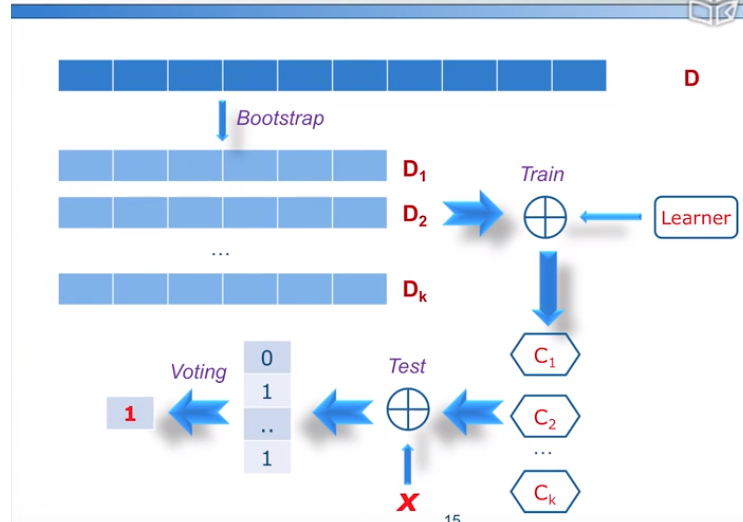

Bagging

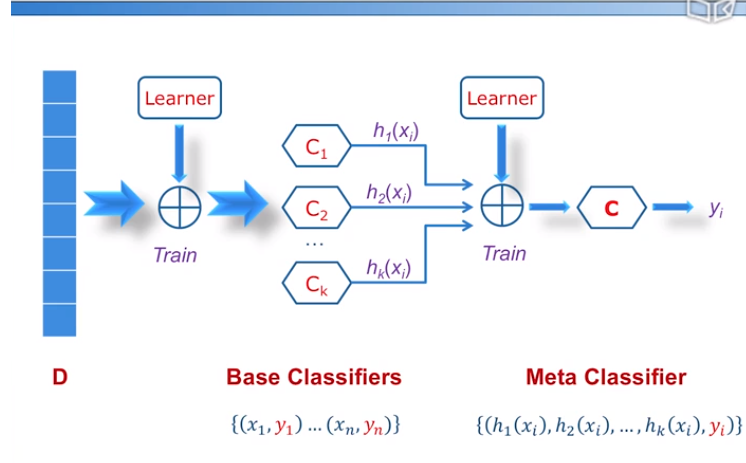

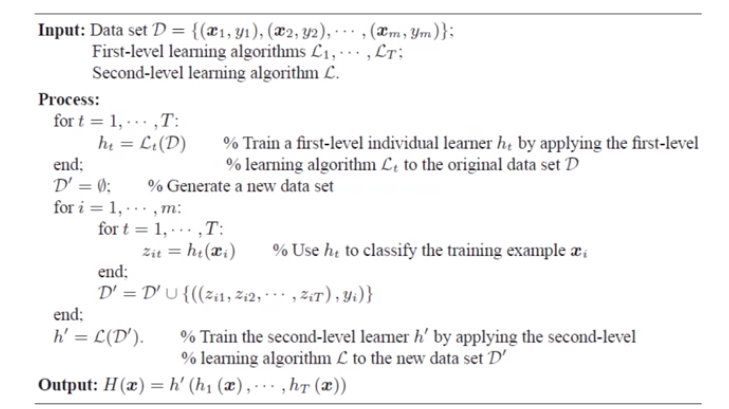

Stacking

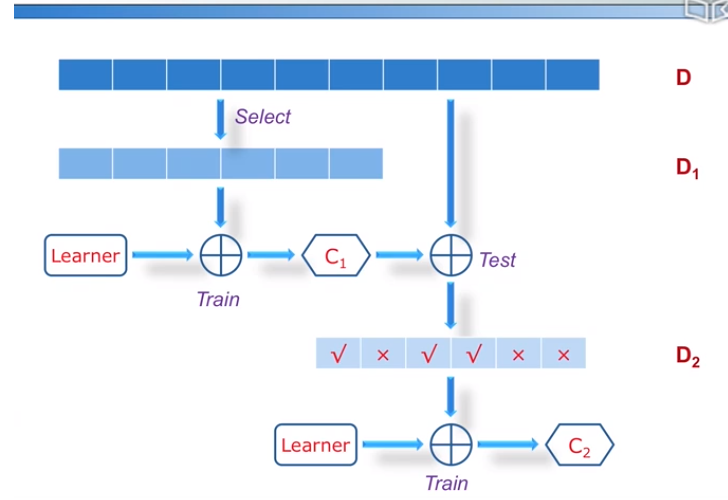

Boosting

-

例子,C1先训练,C2训练C1分错的(后面分类器训练前面分类器分错的),C3训练C1,C2不同的。

-

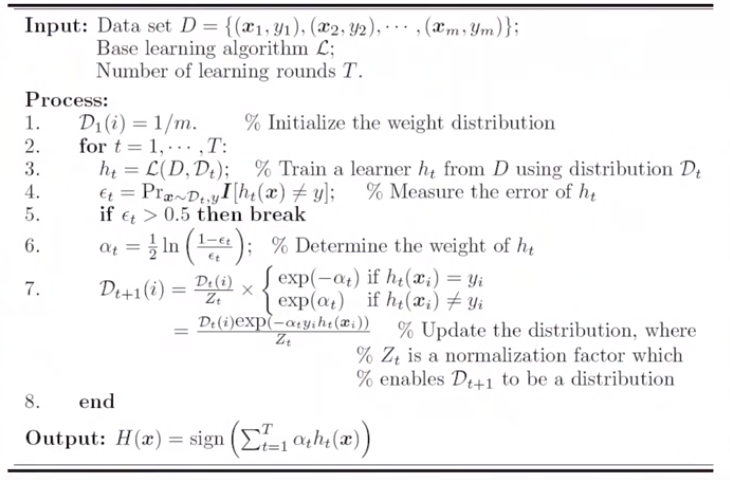

第一步:初始化训练数据的权重,w1=w2=...=wn=1/N,N为样本的数量。

-

第二步:训练第一个基模型,计算模型的错误率,计算模型的系数。

-

第三步:更新数据集的权重,误分类数据的权重调大,分类正确的数据权值调小。在训练一个基类模型。依次进行

-

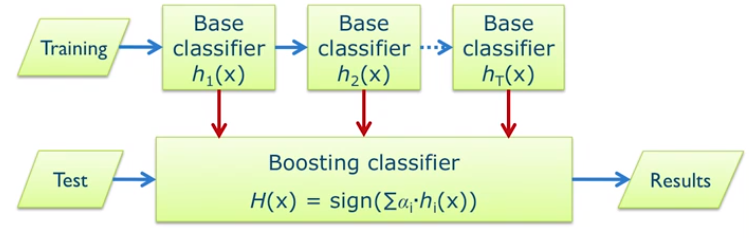

第四步:每个模型对测试数据,进行预测。

-

第五部:对所有基模型的预测结果进行加权求和。准确率高的模型调大权值,准确率低的模型减小权值。

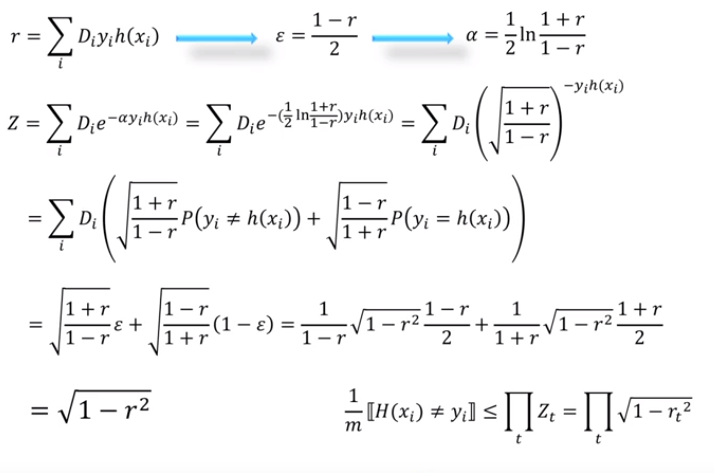

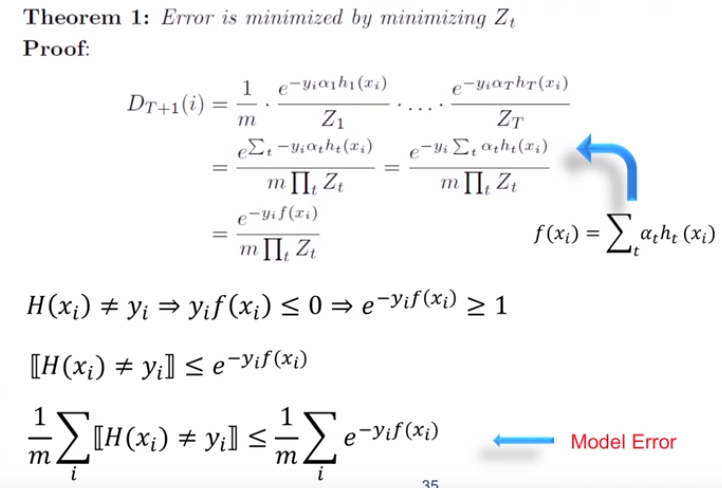

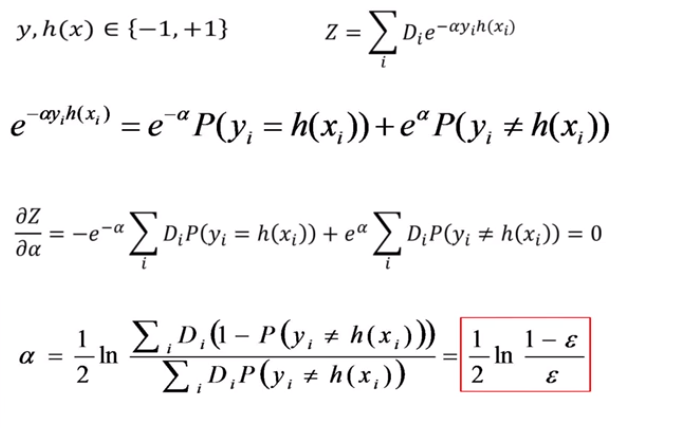

集成权重 (alpha) 的推导

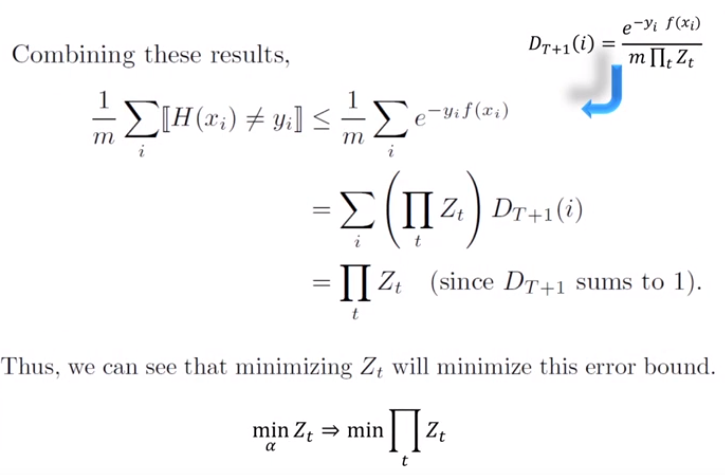

误差上界:(可以证明模型的误差上界趋近于0!!!amazing!!)