深度神经网络的自主学习能力是自动驾驶汽车开发的重要因素: 机器能够像人类一样, 逐步从经验中调整权重获得良好的驾驶技能.

困难在于, 驾驶过程中出现的问题难以从代码层面发现漏洞, 学习好的机器是个黑箱(被数据量包裹);

对自动驾驶汽车而言, 这种“不透明性”造成的后果非常严重:

无人车犯错了,按正常的逻辑来说,肯定是得让工程师找到病根,进而对漏洞进行修复,确保它不会再犯同样的错误。目前有一种方法是借助模拟的形式,先展示给机器大脑一个特征,之后再提供另一个特征,以此类推,以便找出影响其决策的关键因素。

车用AI芯片供应商英伟达联合卡内基·梅隆大学的研究人员, 找到了一种能够让人工智能系统决策过程变得更透明的简单方法.

英伟达汽车部门高级主管 Danny Shapiro 介绍称, 深度神经网络能够通过自主学习逐步提升驾驶经验,但这样的经验是无法通过手动编程提供的。即便如此,我们仍然有能力向大家解释为什么系统会做出这样或那样的决策”。

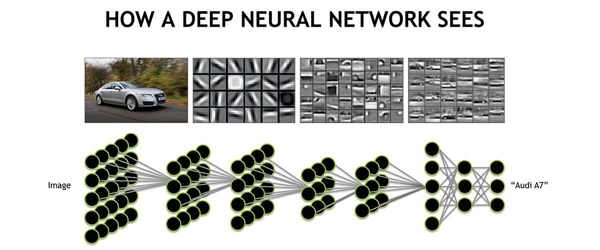

Shapiro表示,这个方法的关键在于它能够利用可视化地图将神经网络在看到图片后标记的重要特征进行定位。下面这几张图片是在汽车前置摄像头采集数据的基础上进行可视化加工而成的,而开发人员还只是在进行「利用深度神经网络控制车辆转向以保证其在车道线内行驶」领域的研究。

由于整个深度神经网络是由不同的层构成的,先将分析结果进行提取(已经获得了输入图像的重要特征),随后将结果附加至下层网络,作平均处理后再继续向下,直到将最终结果附加至原始输入的图片上。上面这几幅可视化地图中,绿色的部分表示深度神经网络高度优先关注的环境特征。而且你会发现,如果让人类来识别的话,这些特征(车道线、道路边缘,停着的其它车辆,沿线的绿篱等)同样是一个老司机不会忽视的重要区域。

当然,为了确保这些图像特征是机器进行决策的关键,研究人员还将所有的像素块分成了两类:I. 包含有明显对驾驶决策有影响的显著特征的图像;II. 一般是背景图,有一些和驾驶决策不太相关的非明显特征。通过对这两类图像进行人为数字操作,研究人员发现,改变“明显特征”这个变量会导致转向角度发生线性变化,这跟换掉整个图像的结果几乎是一致的;而如果只是将背景画面进更改,汽车的转向角度基本不会发生什么变化。

不过话又说回来了,目前工程师其实对人工智能系统出现的bug仍然束手无策,而回到本源,深度神经网络并不是由人工代码架构而成的,所以其实这里可能用“bug”都不是很合适,整个系统中对最终决策最关键的其实是一系列的识别特征。

将重要特征值进行可视化, 是方便人们搞明白机器是如何进行思考的重要一步.