转载于 https://blog.51cto.com/billy98/2355587

一、简介

Prometheus

Prometheus 是一个开源监控系统,它本身已经成为了云原生中指标监控的事实标准,几乎所有 Kubernetes 的核心组件以及其它云原生系统都以 Prometheus 的指标格式输出自己的运行时监控信息。

主要特性:

使用指标名称及键值对标识的多维度数据模型。 采用弹性查询语言PromQL。 不依赖分布式存储,为自治的单点服务。 使用http完成对监控数据的拉取。 通过网关支持时序数据的推送。 支持多种图形和Dashboard的展示。

另外在Prometheus的整个生态系统中有各种可选组件,用于功能的扩充。

Prometheus-Operator

CoreOS提供了一种名为Operator的管理工具,他是管理特定应用程序的控制器。通过扩展Kubernetes API以软件的方式帮助用户创建、配置和管理复杂的或又状态的应用程序实例(如etcd、Redis、MySQL、Prometheus等)。

它通过Kubernetes的CRD(Custom Resource Definition,自定义资源定义)对Prometheus和Prometheus需要监控的服务进行部署和配置。

Prometheus-Operator使用下面两种资源来配置Prometheus及其要监控的服务。

Prometheus:为Prometheus的deployment。 ServiceMonitor:用于描述Prometheus监控的服务。

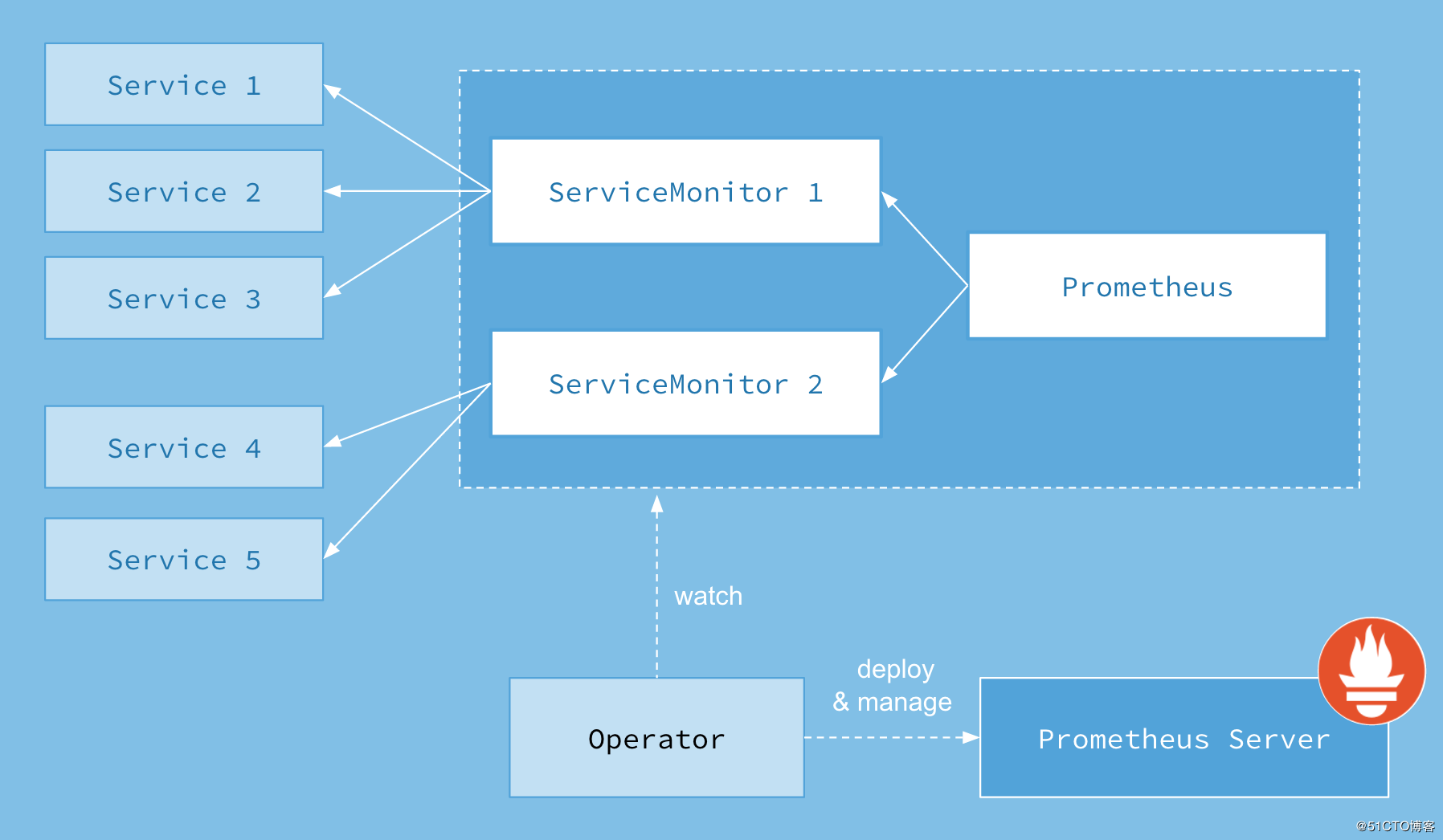

首先我们先来了解下 Prometheus-Operator 的架构图:

上图是 Prometheus-Operator 官方提供的架构图,其中 Operator 是最核心的部分,作为一个控制器,他会去创建 Prometheus 、 ServiceMonitor 、 AlertManager 以及 PrometheusRule 4个 CRD 资源对象,然后会一直监控并维持这4个资源对象的状态。

其中创建的 prometheus 这种资源对象就是作为 Prometheus Server 存在,而 ServiceMonitor 就是 exporter 的各种抽象, exporter是用来提供专门提供 metrics 数据接口的工具, Prometheus 就是通过 ServiceMonitor 提供的 metrics 数据接口去 pull 数据的。

当然 alertmanager 这种资源对象就是对应的 AlertManager 的抽象,而 PrometheusRule 是用来被 Prometheus 实例使用的报警规则文件。

二、说明

本文档基于Prometheus Operator对Prometheus监控系统而进行,完整的配置文件请参考https://github.com/coreos/prometheus-operator

本文使用的k8s集群是基于kubeadm搭建的,具体搭建的详细请参考https://blog.51cto.com/billy98/2350660

三、部署

1. 环境准备

配置Prometheus-Operator之前需要先准备以下几个环境:

- Helm环境:请参考https://blog.51cto.com/billy98/2338415

- gluster-heketi环境:因为prometheus和alertmanager都是有状态的statefulsets集群,所以需要使用到公共存储。请参考https://blog.51cto.com/billy98/2337874

- Ingress环境:请参考https://blog.51cto.com/billy98/2337874

2. 配置域名解析

将alert.cnlinux.club、grafana.cnlinux.club、prom.cnlinux.club三个域名的A记录解析到负责均衡的IP10.31.90.200。

3. 修改scheduler、controller-manager监听地址

修改/etc/kubernetes/manifests/ 目录下kube-controller-manager.yaml和kube-scheduler.yaml

将监听地址改成--address=0.0.0.0

systemctl restart kubelet.service

kubectl edit cm kube-proxy -n kube-system

把metricsBindAddress改成下面一行

metricsBindAddress: 0.0.0.0:10249

4. 创建Namespace

kubectl create ns monitoring

5. 创建Secret

因为etcd是使用https访问的,所以prometheus的容器中也必须要etcd的证书去监控etcd集群,创建Secret就是将证书挂载到prometheus容器中,后续还需要在Prometheus-Operator的配置文件中使用此Secret。

cd /etc/kubernetes/pki/etcd

kubectl -n monitoring create secret generic etcd-client-cert --from-file=etcd-ca=./ca.crt --from-file=etcd-client=./server.crt --from-file=etcd-client-key=./server.key

这里还有一个就是要修改values.yaml中的

725 caFile: /etc/prometheus/secrets/etcd-client-cert/etcd-ca

726 certFile: /etc/prometheus/secrets/etcd-client-cert/etcd-client

727 keyFile: /etc/prometheus/secrets/etcd-client-cert/etcd-client-key

1320 secrets: ["etcd-client-cert"]

要想通过只读端口访问kubelet的信息,做如下操作

values.yaml

511 kubelet:

523 https: false

每个安装了kubelet的节点,需要做如下操作

vi /etc/sysconfig/kubelet

KUBELET_EXTRA_ARGS=--read-only-port=10255

6. 配置Prometheus-Operator

1)首先使用helm下载Prometheus-Operator文件包。

helm fetch stable/prometheus-operator

2)解压下载的压缩包

tar zxf prometheus-operator-1.8.0.tgz

并修改prometheus-operator目录下的values.yaml。

具体修改的配置如下(配置过多,其他未修改的就不再展示了):

nameOverride: "p"

alertmanager:

ingress:

enabled: true

annotations:

kubernetes.io/ingress.class: nginx

labels: {}

hosts:

- alert.cnlinux.club

tls: []

alertmanagerSpec:

storage:

volumeClaimTemplate:

spec:

storageClassName: gluster-heketi

accessModes: ["ReadWriteOnce"]

resources:

requests:

storage: 20Gi

selector: {}

grafana:

enabled: true

adminPassword: admin

#grafana登录密码

ingress:

enabled: true

annotations:

kubernetes.io/ingress.class: nginx

labels: {}

hosts:

- grafana.cnlinux.club

kubeApiServer:

enabled: true

tlsConfig:

serverName: kubernetes

insecureSkipVerify: true

serviceMonitor:

jobLabel: component

selector:

matchLabels:

component: apiserver

provider: kubernetes

kubelet:

enabled: true

namespace: kube-system

serviceMonitor:

https: true

kubeControllerManager:

enabled: true

endpoints: []

service:

port: 10252

targetPort: 10252

selector:

component: kube-controller-manager

coreDns:

enabled: true

service:

port: 9153

targetPort: 9153

selector:

k8s-app: kube-dns

kubeEtcd:

enabled: true

endpoints: []

service:

port: 2379

targetPort: 2379

selector:

component: etcd

serviceMonitor:

scheme: https

insecureSkipVerify: false

serverName: ""

caFile: /etc/prometheus/secrets/etcd-certs/ca.crt

certFile: /etc/prometheus/secrets/etcd-certs/healthcheck-client.crt

keyFile: /etc/prometheus/secrets/etcd-certs/healthcheck-client.key

#secret etcd-certs挂载在prometheus的路径是/etc/prometheus/secrets/etcd-certs,证书文件名和secret一样

kubeScheduler:

enabled: true

endpoints: []

service:

port: 10251

targetPort: 10251

selector:

component: kube-scheduler

prometheus:

ingress:

enabled: true

annotations:

kubernetes.io/ingress.class: nginx

labels: {}

hosts:

- prom.cnlinux.club

prometheusSpec:

secrets: [etcd-certs]

#上面步骤创建etcd证书的secret

storageSpec:

volumeClaimTemplate:

spec:

storageClassName: gluster-heketi

accessModes: ["ReadWriteOnce"]

resources:

requests:

storage: 20Gi

selector: {}

- 安装prometheus-operator

[root@node-01 ~]# helm install --name p --namespace monitoring ./prometheus-operator

6. 部署中遇到的问题

在部署中有几个坑,我在此列举一下,大家配置的时候需要注意一下

1)名称过长导致pvc创建失败

由于alertmanager和prometheus都是有状态的statefulsets,所以我们使用了gluster的存储,并通过 prometheus-operator自动创建pvc,如果charts的release 名称过长会导致pvc创建失败。

所以在上面的安装中指定了release的名字为p, helm install --name p --namespace monitoring ./prometheus-operator,并且在配置文件中也修改了namenameOverride: "p"。

Warning ProvisioningFailed 3s (x2 over 40s) persistentvolume-controller Failed to provision volume with StorageClass "gluster-heketi": failed to create volume: failed to create endpoint/service

default/glusterfs-dynamic-72488422-3428-11e9-a74b-005056824bdc: failed to create endpoint: Endpoints "glusterfs-dynamic-72488422-3428-11e9-a74b-005056824bdc" is invalid:

metadata.labels: Invalid value: "alertmanager-prom-alertmanager-db-alertmanager-prom-alertmanager-0": must be no more than 63 characters

2)配置文件中labels

首先要查看pod的标签,然后修改修改prometheus-operator目录下的values.yaml对应的标签。

[root@node-01 ~]# kubectl -n kube-system get pod --show-labels

NAME READY STATUS RESTARTS AGE LABELS

coredns-7f65654f74-6gxps 1/1 Running 8 5d22h k8s-app=kube-dns,pod-template-hash=7f65654f74

etcd-node-01 1/1 Running 1 32d component=etcd,tier=control-plane

kube-controller-manager-node-01 1/1 Running 0 39h component=kube-controller-manager,tier=control-plane

kube-scheduler-node-01 1/1 Running 0 23h component=kube-scheduler,tier=control-plane

需要注意的是一定要修改prometheus-operator目录下values.yaml对应的标签,不能在安装的时候指定外部的配置文件来覆盖labels值,这可能是个bug,指定外部配置时无法覆盖labels而是追加,会导致prometheus无法抓取到数据。

7. 更新和删除

如果在修改了配置文件values.yaml,可以使用以下命令更新prometheus-operator

helm upgrade RELEASE_NAME ./prometheus-operator

如果需要删除,可以使用以下命令

helm del --purge RELEASE_NAME

kubectl -n monitoring delete crd prometheuses.monitoring.coreos.com

kubectl -n monitoring delete crd prometheusrules.monitoring.coreos.com

kubectl -n monitoring delete crd servicemonitors.monitoring.coreos.com

kubectl -n monitoring delete crd alertmanagers.monitoring.coreos.com

8. 验证

部署完后可以在浏览器访问prometheushttp://prom.cnlinux.club/targets,可以看到如下图,所有的项都有数据,并且是UP状态的。

浏览器访问grafana http://grafana.cnlinux.club/,可以看到各种资源的监控图。

用户名为admin,密码为values.yaml配置文件中指定的密码

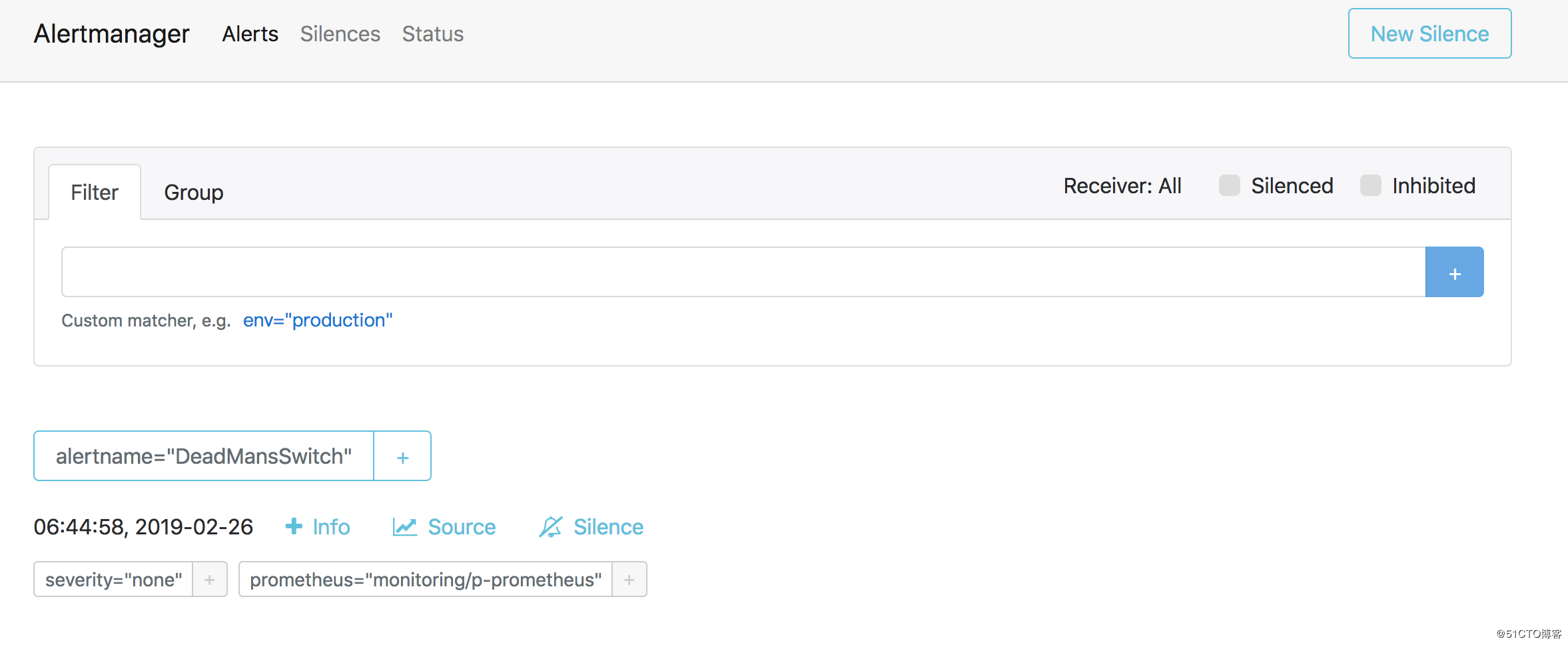

浏览器访问Alertmanager

http://alert.cnlinux.club/,可以看到报警项。