实验一 感知器及其应用

| 博客班级 | https://edu.cnblogs.com/campus/ahgc/machinelearning/ |

|---|---|

| 作业要求 | https://edu.cnblogs.com/campus/ahgc/machinelearning/homework/11950/ |

| 作业目标 | <1. 理解感知器算法原理,能实现感知器算法;2. 掌握机器学习算法的度量指标;3. 掌握最小二乘法进行参数估计基本原理;4. 针对特定应用场景及数据,能构建感知器模型并进行预测。> |

| 学号 | <3180701121> |

一.实验目的

-

理解感知器算法原理,能实现感知器算法;

-

掌握机器学习算法的度量指标;

-

掌握最小二乘法进行参数估计基本原理;

-

针对特定应用场景及数据,能构建感知器模型并进行预测。

二.实验要求

-

安装Pycharm,注册学生版。

-

安装常见的机器学习库,如Scipy、Numpy、Pandas、Matplotlib,sklearn等。

-

编程实现感知器算法。

-

熟悉iris数据集,并能使用感知器算法对该数据集构建模型并应用。

三.报告要求

1.按实验内容撰写实验过程;

2.报告中涉及到的代码,每一行需要有详细的注释;

3.按自己的理解重新组织,禁止粘贴复制实验内容!

四.实验内容

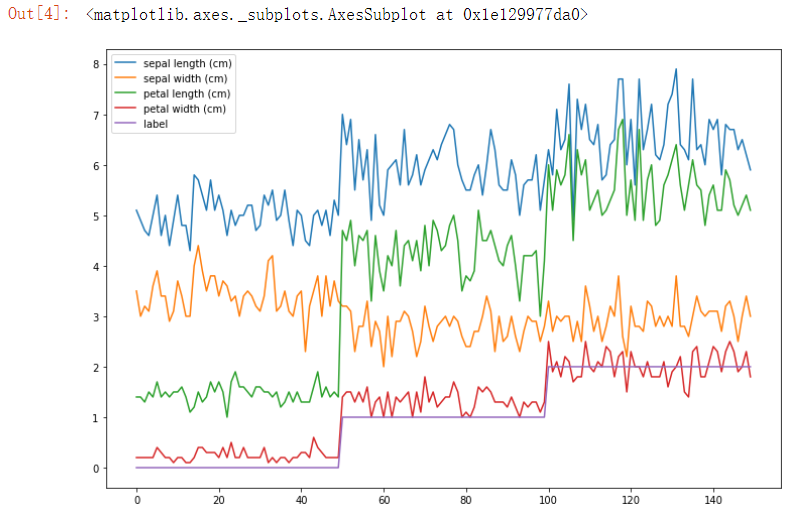

import pandas as pd

import numpy as np

from sklearn.datasets import load_iris #载入Fisher的鸢尾花数据

import matplotlib.pyplot as plt

#Matplotlib是Python的一个绘图库,是Python中最常用的可视化工具之一,可以非常方便地创建2D图表和一些基本的3D图表pyplot模块的plot函数可以接收输入参数和输出参数,还有线条粗细等参数

%matplotlib inline

# load data

iris = load_iris()

df = pd.DataFrame(iris.data, columns=iris.feature_names) #是一个表格

df['label'] = iris.target # 表头字段就是key

df.plot(figsize = (12, 8)) # 利用dataframe做简单的可视化分析

df.columns = ['sepal length', 'sepal width', 'petal length', 'petal width', 'label'] # 选择其中的4个特征进行训练

df.label.value_counts()

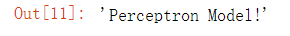

#画数据的散点图

plt.scatter(df[:50]['sepal length'], df[:50]['sepal width'], label='0')#将数据的前50个数据绘制散点图

plt.scatter(df[50:100]['sepal length'], df[50:100]['sepal width'], label='1')#将数据的50-100之间的数据绘制成散点图

plt.xlabel('sepal length')#给x坐标命名

plt.ylabel('sepal width')#给y坐标命名

plt.legend()

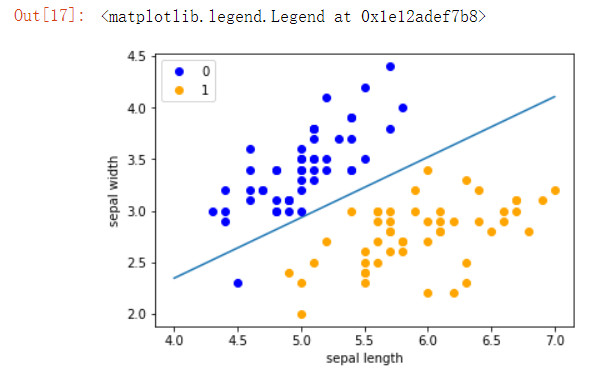

#对数据进行预处理

data = np.array(df.iloc[:100, [0, 1, -1]])#iloc函数:通过行号来取行数据,读取数据前100行的第0,1列和最后一列

X, y = data[:,:-1], data[:,-1]#X为data数据中除去最后一列的数据,y为data数据的最后一列(y中有两类0和1)

y = np.array([1 if i == 1 else -1 for i in y])#将y中的两类(0和1)改为(-1和1)两类

# 数据线性可分,二分类数据

# 此处为一元一次线性方程

class Model:

def __init__(self):

self.w = np.ones(len(data[0])-1, dtype=np.float32)

self.b = 0 #初始w/b的值

self.l_rate = 0.1

# self.data = data

def sign(self, x, w, b):

y = np.dot(x, w) + b #求w,b的值

#Numpy中dot()函数主要功能有两个:向量点积和矩阵乘法。

#格式:x.dot(y) 等价于 np.dot(x,y) ———x是m*n 矩阵 ,y是n*m矩阵,则x.dot(y) 得到m*m矩阵

return y

# 随机梯度下降法

#随机梯度下降法(SGD),随机抽取一个误分类点使其梯度下降。根据损失函数的梯度,对w,b进行更新

def fit(self, X_train, y_train): #将参数拟合 X_train数据集矩阵 y_train特征向量

is_wrong = False

#误分类点的意思就是开始的时候,超平面并没有正确划分,做了错误分类的数据。

while not is_wrong:

wrong_count = 0 #误分为0,就不用循环,得到w,b

for d in range(len(X_train)):

X = X_train[d]

y = y_train[d]

if y * self.sign(X, self.w, self.b) <= 0:

# 如果某个样本出现分类错误,即位于分离超平面的错误侧,则调整参数,使分离超平面开始移动,直至误分类点被正确分类。

self.w = self.w + self.l_rate*np.dot(y, X) #调整w和b

self.b = self.b + self.l_rate*y

wrong_count += 1

if wrong_count == 0:

is_wrong = True

return 'Perceptron Model!'

#线性可分可用随机梯度下降法

def score(self):

pass

perceptron = Model()#生成一个算法对象

perceptron.fit(X, y)#将测试数据代入算法中

#画出超平面

x_points = np.linspace(4, 7,10) #用于产生4,7之间的10点行矢量。其中4、7、10分别为起始值、中止值、元素个数。----产生x坐标

y_ = -(perceptron.w[0]*x_points + perceptron.b)/perceptron.w[1] #绘制超平面

plt.plot(x_points, y_)

plt.plot(data[:50, 0], data[:50, 1], 'bo', color='blue', label='0')#将数据的前50个数据绘制散点图

plt.plot(data[50:100, 0], data[50:100, 1], 'bo', color='orange', label='1')#将数据的50-100之间的数据绘制成散点图

plt.xlabel('sepal length')#给x坐标命名

plt.ylabel('sepal width')#给y坐标命名

plt.legend()

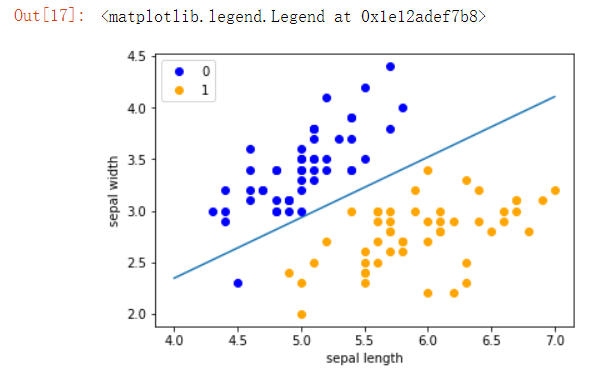

#定义感知机

from sklearn.linear_model import Perceptron

#使用训练数据进行训练

clf = Perceptron(fit_intercept=False, max_iter=1000, shuffle=False)

#得到训练结果,权重矩阵

clf.fit(X,y)

print(clf.coef_)#权值w参数

[[ 74.6 -127.2]]

print(clf.intercept_)#偏置b参数

[0.]

#画出sklearn结果的散点图

x_ponits = np.arange(4, 8)#x,为4,5,6,7,默认步长为1,起始为4,终止为8,不取8

y_ = -(clf.coef_[0][0]*x_ponits + clf.intercept_)/clf.coef_[0][1]#绘制超平面

plt.plot(x_ponits, y_)

plt.plot(data[:50, 0], data[:50, 1], 'bo', color='blue', label='0')#将数据的前50个数据绘制散点图

plt.plot(data[50:100, 0], data[50:100, 1], 'bo', color='orange', label='1')#将数据的50-100之间的数据绘制成散点图

plt.xlabel('sepal length')#给x坐标命名

plt.ylabel('sepal width')#给y坐标命名

plt.legend()

五.实验小结

1.通过本次实验,我理解并且能简单实现感知器算法.感知器是人工神经网络中的一种典型结构,它是一种分类学习器,是很多复杂算法的基础。

2.其“赏罚概念”在机器学习算法在中广为应用。在分类正确时,对正确的权重向量w赏,即w不变;当分类错误时,对权重向量罚,即将权重向量w向着争取的方向转变。

3.其中错误率和精度是分类任务中最常用的两种机器学习算法的性能度量指标,既适用于二分类任务,也适用于多分类任务。可以针对特定应用场景及数据,构建感知器模型并进行预测等。