目录

impala的简单介绍

-

概述

有两个关于impala介绍的网址:

https://docs.cloudera.com/documentation/enterprise/6/6.3/topics/impala_intro.html

https://impala.apache.org/docs/build/impala-2.12.pdf

内容基本相同

Impala直接对存储在HDFS、HBase或Amazon Simple Storage Service (S3)中的Apache Hadoop数据提供快速的交互式SQL查询。除了使用相同的统一存储平台外,Impala还使用了

与Apache Hive相同的元数据、SQL语法(Hive SQL)、ODBC驱动程序和用户界面(色调中的Impala查询UI)。

这为实时或面向批处理的查询提供了一个熟悉的、统一的平台。

Impala是大数据查询工具的补充。Impala不会替代构建在MapReduce上的批处理框架,比如Hive。Hive和其他构建在MapReduce上的框架最适合长时间运行的批处理作业,比如那些涉及提取、转换和加载(ETL)类型作业的批处理。 -

优点

1.数据科学家和分析师已经熟悉的SQL接口。

2.能够在Apache Hadoop中查询大量数据(“大数据”)。

3.在集群环境中使用分布式查询,方便扩展和利用具有成本效益的商品硬件。

4.能够在不同的组件之间共享数据文件,而不需要复制或导出/导入步骤;例如,用Pig来写,用Hive来转换,用Impala来查询。Impala可以读写Hive表,支持使用Impala对hiveproduced数据进行分析的简单数据交换。

5.单一系统的大数据处理和分析,因此客户可以避免昂贵的建模和ETL只是为了分析。 -

缺点

1.基于内存计算,对内存依赖性较大

2.改用C++编写,意味着维护难度增大

3.基于hive,与hive共存亡,紧耦合

4.稳定性不如hive,但不存在数据丢失的情况 -

impala和Hive的关系

impala是基于hive的大数据分析查询引擎,直接使用hive的元数据库metadata,意味着impala元数据都存储在hive的metastore当中,并且impala兼容hive的绝大多数sql语法。所以需要安装impala的话,必须先安装hive,保证hive安装成功,并且还需要启动hive的metastore服务。

-

impala如何和CDH一起工作

Impala解决方案由以下组件组成:

客户端 —— 包括Hue、ODBC客户端、JDBC客户端和Impala Shell在内的实体都可以与Impala进行交互。这些接口通常用于发出查询或完成管理任务,比如连接到Impala。

Hive Metastore —— 存储信息的数据可用的Impala。例如,metastore让Impala知道哪些数据库是可用的,以及这些数据库的结构是什么。当您通过Impala SQL语句创建、删除和更改模式对象、将数据加载到表中等等时,相关的元数据更改将通过Impala 1.2中引入的专用目录服务自动广播到所有Impala节点。

Impala —— 这个进程在数据节点上运行,协调和执行查询。Impala的每个实例都可以接收、计划和协调来自Impala客户端的查询。查询分布在Impala节点中,这些节点充当工作人员,执行并行查询片段。

HBase和HDFS —— 用于查询数据的存储。

使用Impala执行的查询处理如下:

1.用户应用程序通过ODBC或JDBC向Impala发送SQL查询,后者提供了标准化的查询接口。用户应用程序可以连接到集群中的任何impalad。这个impalad将成为查询的协调器。

2.Impala解析查询并分析它,以确定需要由集群中的impalad实例执行哪些任务。计划执行以获得最佳效率。

本地impalad实例可以访问HDFS和HBase等服务来提供数据。

3.每个impalad将数据返回给协调impalad,协调impalad将这些结果发送给客户机。 -

impala的架构及查询计划

架构:

impala-server:从节点。主要负责执行查询任务的计算,官方建议 impala-server与每一个datanode安装在一起

impala-catalog:主节点。主要是存储了元数据信息在两个地方,一个在内存当中,一个在磁盘当中。impala当中的元数据管理的服务

impala-statestore:主节点,状态存储区,主要存储了一些sql执行的进度信息,状态信息等等

查询计划:

fronted : 使用java来实现,负责生成查询计划

backend : 使用的C++来实现,主要负责的是执行查询

fronted前台的查询计划又分为两个阶段:

第一个阶段: 生成单机版的查询计划

第二个阶段: 生成分布式的查询计划,将单机版的查询计划,发送到其他机器上

sql语句的优化,其实就是查询计划的优化,单机版的优化策略与分布式的优化策略是一样 -

impala/hive/spark 对比

impala的安装部署

-

安装环境准备

一定已经安装了Hive和Hadoop,并且在Hadoop的lib目录的native目录下要有如下文件

-

下载impala的所有依赖包

要根据自己CDH的版本和centOS的版本选择下载

我下载的是 http://archive.cloudera.com/cdh5/repo-as-tarball/5.14.0/cdh5.14.0-centos7.tar.gz -

挂载磁盘

移步到 【Hadoop离线基础总结】Mac版VMware Fusion虚拟机磁盘挂载 查看详细步骤

-

上传压缩包并解压

cd /data02/

tar -zxvf cdh5.14.0-centos6.tar.gz -

制作本地yum源

镜像源是centos当中下载相关软件的地址,我们可以通过制作我们自己的镜像源指定我们去哪里下载impala的rpm包,这里我们使用httpd这个软件来作为服务端,启动httpd的服务来作为我们镜像源的下载地址

在第三台机器node03执行以下命令yum -y install httpd systemctl start httpd.service cd /etc/yum.repos.d vim localimp.repo[localimp] name=localimp baseurl=http://node03/cdh5.14.0/ gpgcheck=0 enabled=1这里如果启动httpd报错:Job for httpd.service failed because the control process exited with error code. See “systemctl status httpd.service” and “journalctl -xe” for details. 查看这篇文章即可解决 centos7启动httpd服务失败:Job for httpd.service failed because the control process exited with error code.

ln -s /data02/cdh/5.14.0 /var/www/html/cdh5.14.0创建apache httpd的读取链接

出现下图表示本地yum源制作成功

将制作好的localimp配置文件发放到所有需要安装impala的节点上去scp localimp.repo node02:$PWD scp localimp.repo node01:$PWD -

开始安装impala

安装规划

在node03执行以下命令yum install impala -y yum install impala-server -y yum install impala-state-store -y yum install impala-catalog -y yum install impala-shell -y在node01和node02执行

yum install impala-server -y -

所有节点配置impala

1.修改hive-site.xml

vim /export/servers/hive-1.1.0-cdh5.14.0/conf/hive-site.xml

添加配置<property> <name>hive.metastore.uris</name> <value>thrift://node03.hadoop.com:9083</value> </property> <property> <name>hive.metastore.client.socket.timeout</name> <value>3600</value> </property>2.将node03的hive安装包发送到node01,node02

cd /export/servers/ scp -r hive-1.1.0-cdh5.14.0/ node02:$PWD scp -r hive-1.1.0-cdh5.14.0/ node01:$PWD3.node03启动hive的metastore服务

cd /export/servers/hive-1.1.0-cdh5.14.0 nohup bin/hive --service metastore & nohup bin/hive -- service hiveserver2 &注意:一定要保证mysql的服务正常启动,否则metastore的服务不能够启动

4.所有hadoop节点修改hdfs-site.xml

在所有节点创建文件夹mkdir -p /var/run/hdfs-sockets

修改所有节点的hdfs-site.xml

vim /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/hdfs-site.xml

添加以下配置<property> <name>dfs.client.read.shortcircuit</name> <value>true</value> </property> <property> <name>dfs.domain.socket.path</name> <value>/var/run/hdfs-sockets/dn</value> </property> <property> <name>dfs.client.file-block-storage-locations.timeout.millis</name> <value>10000</value> </property> <property> <name>dfs.datanode.hdfs-blocks-metadata.enabled</name> <value>true</value> </property>因为我用的是root用户,所以不用以下操作,一般在实际工作过程中都是普通用户,就需要以下操作

创建文件夹/var/run/hadoop-hdfs/

chown -R hadoop:hadoop /var/run/hdfs-sockets/

5.重启hdfs

在node01执行cd /export/servers/hadoop-2.6.0-cdh5.14.0/ sbin/stop-dfs.sh sbin/start-dfs.sh6.创建hadoop与hive的配置文件的连接

impala的配置目录为/etc/impala/conf

这个路径下面需要把core-site.xml,hdfs-site.xml以及hive-site.xml拷贝到这里来,但是我们这里使用软连接的方式会更好

所有节点都要执行ln -s /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/core-site.xml /etc/impala/conf/core-site.xml ln -s /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/hdfs-site.xml /etc/impala/conf/hdfs-site.xml ln -s /export/servers/hive-1.1.0-cdh5.14.0/conf/hive-site.xml /etc/impala/conf/hive-site.xml7.修改impala的配置文件

所有节点更改impala默认配置文件

vim /etc/default/impalaIMPALA_CATALOG_SERVICE_HOST=node03 IMPALA_STATE_STORE_HOST=node03所有节点创建mysql的驱动包的软连接

ln -s /export/servers/hive-1.1.0-cdh5.14.0/lib/mysql-connector-java-5.1.38.jar /usr/share/java/mysql-connector-java.jar

如果提示 ln: 无法创建符号链接"/usr/share/java/mysql-connector-java.jar": 没有那个文件或目录 ,在/usr/share/目录下创建一个java文件夹即可

所有节点修改bigtop的java路径

vim /etc/default/bigtop-utils

export JAVA_HOME=/export/servers/jdk1.8.0_141

8.启动impala服务

在node03启动service impala-state-store start service impala-catalog start service impala-server start

在node01和node02启动service impala-server start

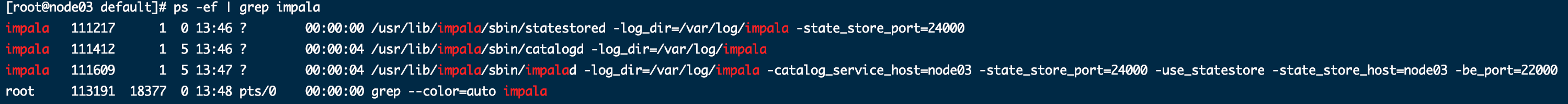

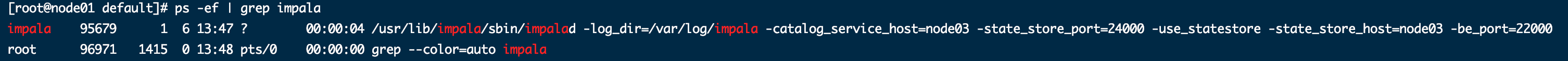

用ps -ef | grep impala 查看进程

node03应该三个

node01和node02各有一个

访问impalad的管理界面

http://node03:25000/

访问statestored的管理界面

http://node03:25010/

访问catalog的管理界面

http://node03:25020