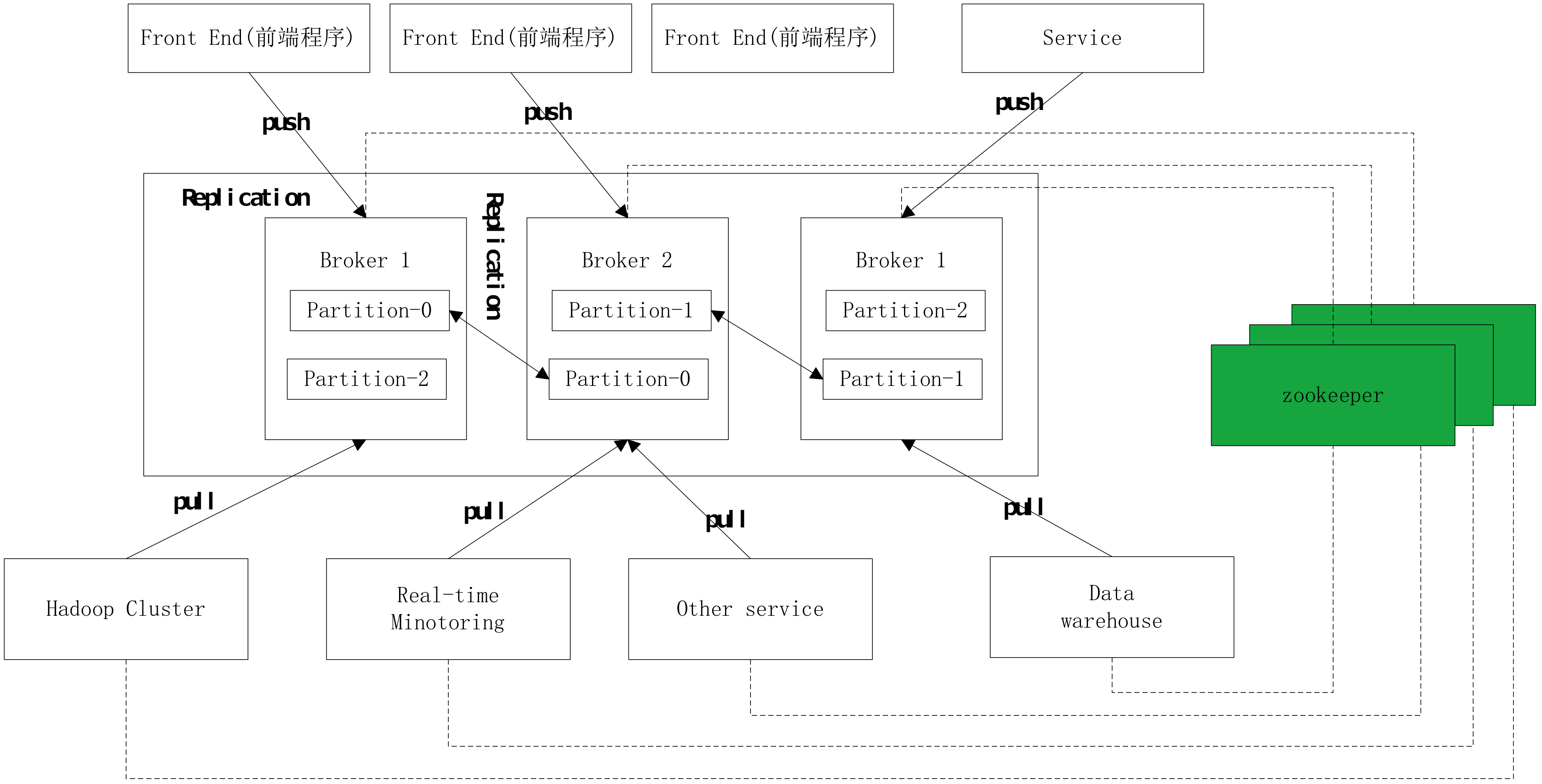

kafka是linkedin用于日志处理的分布式消息队列, 同时支持离线和在线日志处理。 kafka对消息保存时根据Topic进行归类, 发送消息者成为 Producer,消息接受者成为 Consumer,此外 kafka 集群有多个kafka实例组成, 每个实例(server)称为broker。 无论是kafka集群, 还是producer和consumer都依赖于zookeeper来保证系统可用性,为集群保存一些meta信息。

生产者生产消息、kafka集群、消费者获取消息这样一种架构

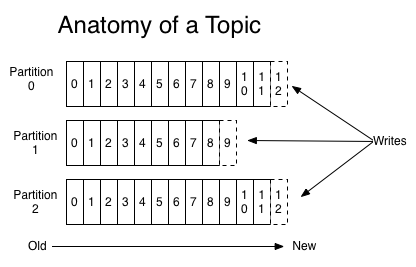

一个 Topic 可以认为是一类消息,每个 topic 将被分成多个partition(区),每个 partition 在存储层面是 append log 文件。任何发布到此 partition 的消息都会被直接追加到log 文件的尾部, 每条消息在文件中的位置称为 offset(偏移量), offset 为一个 long型数字, 它是唯一标记一条消息。 kafka 并没有提供其他额外的索引机制来存储 offset,因为在 kafka 中几乎不允许对消息进行“ 随机读写” 。

在kafka 中, 即使消息被消费,消息仍然不会被立即删除。 日志文件将会根据 broker 中的配置要求,保留一定的时间之后删除;比如log 文件保留 2 天,那么两天后,文件会被清除,无论其中的消息是否被消费。 kafka 通过这种简单的手段,来释放磁盘空间,以及减少消息消费之后对文件内容改动的磁盘IO 开支。

zookeeper在kafak中的作用是用来做软负载均衡的。客户端和服务端通过TCP协议通信。Kafka提供了Java客户端,并且对多种语言都提供了支持。

Kafka集群是把状态保存在Zookeeper中的。

Producer将消息发布到它指定的topic中,并负责决定发布到哪个分区。通常简单的由负载均衡机制随机选择分区,但也可以通过特定的分区函数选择分区。使用的更多的是第二种。

发布消息通常有两种模式:队列模式(queuing)和发布-订阅模式(publish-subscribe)。队列模式中,consumers可以同时从服务端读取消息,每个消息只被其中一个consumer读到;发布-订阅模式中消息被广播到所有的consumer中。

Consumers可以加入一个consumer 组,共同竞争一个topic,topic中的消息将被分发到组中的一个成员中。同一组中的consumer可以在不同的程序中,也可以在不同的机器上。如果所有的consumer都在一个组中,这就成为了传统的队列模式,在各consumer中实现负载均衡。如果所有的consumer都不在不同的组中,这就成为了发布-订阅模式,所有的消息都被分发到所有的consumer中。

更常见的是,每个topic都有若干数量的consumer组,每个组都是一个逻辑上的“订阅者”,为了容错和更好的稳定性,每个组由若干consumer组成。这其实就是一个发布-订阅模式,只不过订阅者是个组而不是单个consumer。

windows环境搭建

修改conf/server.properties

参数详解:

broker.id=0 #当前机器在集群中的唯一标识,和zookeeper的myid性质一样 port=19092 #当前kafka对外提供服务的端口默认是9092 host.name=192.168.7.100 #这个参数默认是关闭的,在0.8.1有个bug,DNS解析问题,失败率的问题。 num.network.threads=3 #这个是borker进行网络处理的线程数 num.io.threads=8 #这个是borker进行I/O处理的线程数 log.dirs=/opt/kafka/kafkalogs/ #消息存放的目录,这个目录可以配置为“,”逗号分割的表达式,上面的num.io.threads要大于这个目录的个数这个目录,如果配置多个目录,新创建的topic他把消息持久化的地方是,当前以逗号分割的目录中,那个分区数最少就放那一个 socket.send.buffer.bytes=102400 #发送缓冲区buffer大小,数据不是一下子就发送的,先回存储到缓冲区了到达一定的大小后在发送,能提高性能 socket.receive.buffer.bytes=102400 #kafka接收缓冲区大小,当数据到达一定大小后在序列化到磁盘 socket.request.max.bytes=104857600 #这个参数是向kafka请求消息或者向kafka发送消息的请请求的最大数,这个值不能超过java的堆栈大小 num.partitions=1 #默认的分区数,一个topic默认1个分区数 log.retention.hours=168 #默认消息的最大持久化时间,168小时,7天 message.max.byte=5242880 #消息保存的最大值5M default.replication.factor=2 #kafka保存消息的副本数,如果一个副本失效了,另一个还可以继续提供服务 replica.fetch.max.bytes=5242880 #取消息的最大直接数 log.segment.bytes=1073741824 #这个参数是:因为kafka的消息是以追加的形式落地到文件,当超过这个值的时候,kafka会新起一个文件 log.retention.check.interval.ms=300000 #每隔300000毫秒去检查上面配置的log失效时间(log.retention.hours=168 ),到目录查看是否有过期的消息如果有,删除 log.cleaner.enable=false #是否启用log压缩,一般不用启用,启用的话可以提高性能 zookeeper.connect=192.168.7.100:12181,192.168.7.101:12181,192.168.7.107:1218 #设置zookeeper的连接端口

实际的修改项为:

broker.id=0 每台服务器的broker.id都不能相同

#hostname

host.name=192.168.7.100

#在log.retention.hours=168 下面新增下面三项

message.max.byte=5242880

default.replication.factor=2

replica.fetch.max.bytes=5242880

#设置zookeeper的连接端口

zookeeper.connect=192.168.7.100:12181,192.168.7.101:12181,192.168.7.107:12181

注意:

- 各节点上的broker.id要配置为不同的值。

- log.dir的值建议配置为绝对路径,避免在不同的工作目录下启动Kafka时,此目录不同.

- zookeeper.connect : 末尾可以加节点名,例:

-

#连接时,会在zk 上自动创建 topics 节点 zookeeper.connect=127.0.0.1:2181/topics #kafka 创建的 topic 就会在 topics 的节点下 kafka-topics.bat --create --zookeeper 127.0.0.1:2181/topics --replication-factor 2 --partitions 1 --topic iii

启动Kafka Server

cd E:midd-softkafkakafka0inwindows

kafka-server-start.bat ....configserver.properties

列出所有的Topic:

kafka-topics.bat --list --zookeeper 127.0.0.1:2181

创建一个Topic:

kafka-topics.bat --create --zookeeper 127.0.0.1:2181/kafka --replication-factor 2 --partitions 1 --topic cheyo-topic

#解释 --replication-factor 2 #复制两份 --partitions 1 #创建1个分区 --topic #主题为cheyo-topic

查询该Topic的现状信息:

kafka-topics.bat --describe --zookeeper 127.0.0.1:2181/kafka --topic cheyo-topic

查看topic的消费偏移量

删除Topic:

kafka-topics.bat --zookeeper 127.0.0.1:2181/kafka --delete --topic cheyo-topic

生产一些该Topic的消息:

kafka-console-producer.bat --broker-list 127.0.0.1:2181 --topic cheyo-topic

在另一个客户端上消费该Topic的消息:

kafka-console-consumer.bat --zookeeper 127.0.0.1:2181/kafka --from-beginning --topic cheyo-topic

日志说明

默认kafka的日志是保存在/opt/kafka/kafka_2.10-0.9.0.0/logs目录下的,这里说几个需要注意的日志

server.log #kafka的运行日志

state-change.log #kafka他是用zookeeper来保存状态,所以他可能会进行切换,切换的日志就保存在这里

controller.log

#kafka选择一个节点作为“controller”,当发现有节点down掉的时候它负责在游泳分区的所有节点中选择新的leader,这使得Kafka可以批量的高效的管理所有分区节点的主从关系。

#如果controller down掉了,活着的节点中的一个会备切换为新的controller.