kafka安装与集群部署

1. 安装

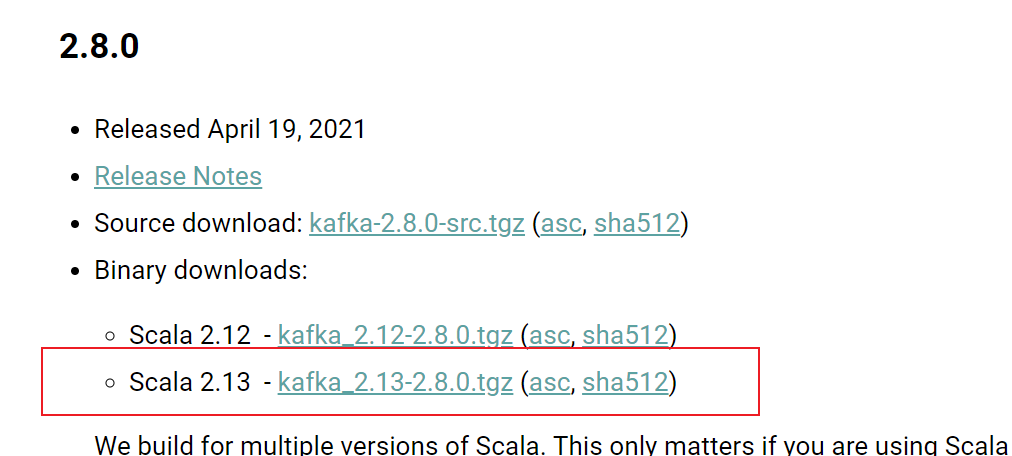

1.1 官网下载安装包

官网下载链接:http://kafka.apache.org/downloads.html (此链接为linux版本)

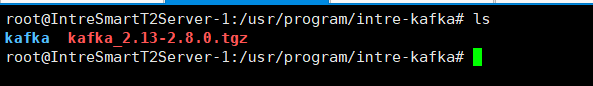

将下载好的安装包上传到linux服务器上指定文件夹下(例如:usr/program/kafka)

1.2 解压并配置文件

解压:tar -zxvf kafka_2.13-2.8.0.tgz

修改文件名:mv kafka_2.13-2.8.0.tgz kafka

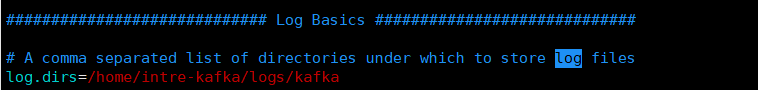

进入config目录下修改server.properties与zookeeper.properties配置文件,主要修改kafka数据存放地址与zookeeper连接地址,集群部署注意brokerId必须不同(例如:0,1,2),以及zookeeper连接地址必须写上所有服务器地址。zookeeper.properties文件主要修改日志存放地址。

server.properties(本人只部署两台服务器):

zookeeper.properties:

2. 启动并测试

2.1 启动kafka

kafka依赖于zookeeper,故必须先启动zookeeper才可启动kafka,加上-daemon是后台启动,且指定启动配置文件,集群模式下另外一台服务器也必须执行相同指令

zookeeper启动命令:bin/zookeeper-server-start.sh -daemon config/zookeeper.properties

kafka启动命令:bin/kafka-server-start.sh -daemon config/server.properties

启动完成后利用 netstat -ntlp 查看是否正常启动

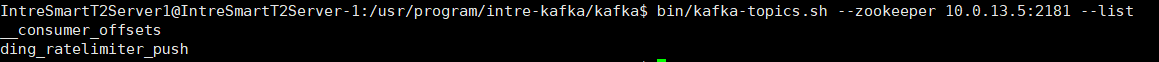

2.2 测试kafka

创建主题:bin/kafka-topics.sh --zookeeper localhost:2181,localhosrt:2181 --create --replication-factor 2 --partitions 2 --topic test

选项说明:

--topic 定义 topic 名

--replication-factor 定义副本数

--partitions 定义分区数

查看主题:bin/kafka-topics.sh --zookeeper localhost:2181 --list

发送消息:bin/kafka-console-producer.sh --broker-list localhost:9092,localhost:9092 --topic test

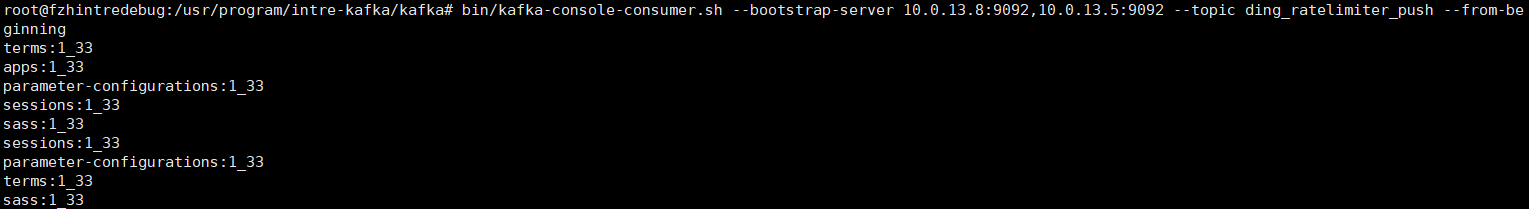

消费消息:bin/kafka-console-consumer.sh --bootstrap-server localhost:9092,localhost:9092 --topic test --from-beginning

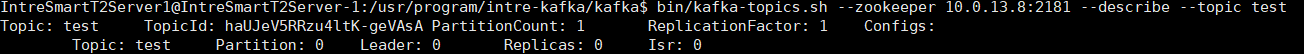

查看某个topic详情:bin/kafka-topics.sh --zookeeper localhost:2181 --describe --topic test

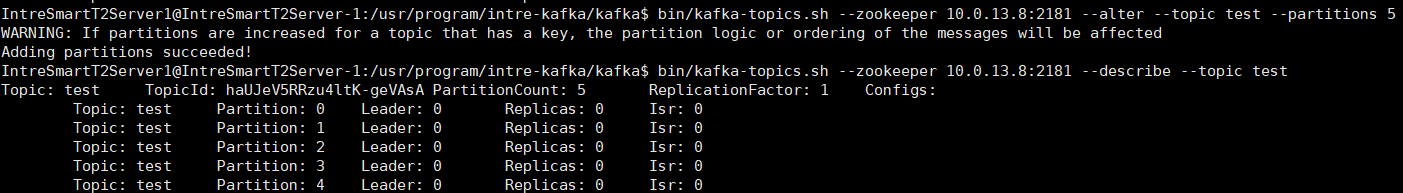

修改分区数:bin/kafka-topics.sh --zookeeper localhost:2181 --alter --topic test --partitions 5

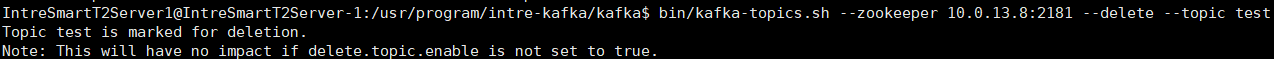

删除主题:bin/kafka-topics.sh --zookeeper localhost:2181 --delete --topic test

3. 配置文件详解

----------------------系统相关-------------------------

#每一个broker在集群中的唯一标示,要求是正数。在改变IP地址,不改变broker.id的话不会影响consumers

broker.id = 1

#kafka数据的存放地址,多个地址的话用逗号分割 /tmp/kafka-eogs-1,/tmp/kafka-logs-2

log.dirs = /tmp/kafka-logs

#提供给客户端响应的端口

port = 6667

#消息体的最大大小,单位是字节

message.max.bytes = 1000000

#broker 处理消息的最大线程数,一般情况下不需要去修改

num.network.threads = 3

#broker处理磁盘IO 的线程数 ,数值应该大于你的硬盘数

num.io.threads = 8

#一些后台任务处理的线程数,例如过期消息文件的删除等,一般情况下不需要去做修改

background.threads = 4

#等待IO线程处理的请求队列最大数,若是等待IO的请求超过这个数值,那么会停止接受外部消息,算是一种自我保护机制

queued.max.requests = 500

#broker的主机地址,若是设置了,那么会绑定到这个地址上,若是没有,会绑定到所有的接口上,并将其中之一发送到ZK,一般不设置

host.name

#打广告的地址,若是设置的话,会提供给producers, consumers,其他broker连接,具体如何使用还未深究

advertised.host.name

#广告地址端口,必须不同于port中的设置

advertised.port

#socket的发送缓冲区,socket的调优参数SO_SNDBUFF

socket.send.buffer.bytes = 100 * 1024

#socket的接受缓冲区,socket的调优参数SO_RCVBUFF

socket.receive.buffer.bytes = 100 * 1024

#socket请求的最大数值,防止serverOOM,message.max.bytes必然要小于socket.request.

max.bytes,会被topic创建时的指定参数覆盖

socket.request.max.bytes = 100 * 1024 * 1024

----------------------LOG相关------------------------

#topic的分区是以一堆segment文件存储的,这个控制每个segment的大小,会被topic创建时的指定参数覆盖

log.segment.bytes = 1024 * 1024 * 1024

#这个参数会在日志segment没有达到log.segment.bytes设置的大小,也会强制新建一个segment 会被 topic创建时的指定参数覆盖

log.roll.hours = 24*7

#日志清理策略 选择有:delete和compact 主要针对过期数据的处理,或是日志文件达到限制的额度,会被 topic创建时的指定参数覆盖

log.cleanup.policy = delete

#数据存储的最大时间 超过这个时间 会根据log.cleanup.policy设置的策略处理数据,也就是消费端能够多久去消费数据

#log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除,会被topic创建时的指定参数覆盖

log.retention.minutes=7 days

#topic每个分区的最大文件大小,一个topic的大小限制 = 分区数 * log.retention.bytes 。-1 没有大小限制

#log.retention.bytes和log.retention.minutes任意一个达到要求,都会执行删除,会被topic创建时的指定参数覆盖

log.retention.bytes=-1

#文件大小检查的周期时间,是否处罚 log.cleanup.policy中设置的策略

log.retention.check.interval.ms=5 minutes

#是否开启日志压缩

log.cleaner.enable=false

#日志压缩运行的线程数

log.cleaner.threads =1

#日志压缩时候处理的最大大小

log.cleaner.io.max.bytes.per.second=None

#日志压缩去重时候的缓存空间 ,在空间允许的情况下,越大越好

log.cleaner.dedupe.buffer.size=500*1024*1024

#日志清理时候用到的IO块大小 一般不需要修改

log.cleaner.io.buffer.size=512*1024

#日志清理中hash表的扩大因子 一般不需要修改

log.cleaner.io.buffer.load.factor = 0.9

#检查是否处罚日志清理的间隔

log.cleaner.backoff.ms =15000

#日志清理的频率控制,越大意味着更高效的清理,同时会存在一些空间上的浪费,会被topic创建时的指定参数覆盖

log.cleaner.min.cleanable.ratio=0.5

#对于压缩的日志保留的最长时间,也是客户端消费消息的最长时间,同log.retention.minutes的区别在于一个控制未压缩数据,一个控制压缩后的数据。会被topic创建时的指定参数覆盖

log.cleaner.delete.retention.ms = 1 day

#对于segment日志的索引文件大小限制,会被topic创建时的指定参数覆盖

log.index.size.max.bytes = 10 * 1024 * 1024

#当执行一个fetch操作后,需要一定的空间来扫描最近的offset大小,设置越大,代表扫描速度越快,但是也更好内存,一般情况下不需要搭理这个参数

log.index.interval.bytes = 4096

#log文件"sync"到磁盘之前累积的消息条数

#因为磁盘IO操作是一个慢操作,但又是一个"数据可靠性"的必要手段

#所以此参数的设置,需要在"数据可靠性"与"性能"之间做必要的权衡.

#如果此值过大,将会导致每次"fsync"的时间较长(IO阻塞)

#如果此值过小,将会导致"fsync"的次数较多,这也意味着整体的client请求有一定的延迟.

#物理server故障,将会导致没有fsync的消息丢失.

log.flush.interval.messages=None

#检查是否需要固化到硬盘的时间间隔

log.flush.scheduler.interval.ms = 3000

#仅仅通过interval来控制消息的磁盘写入时机,是不足的.

#此参数用于控制"fsync"的时间间隔,如果消息量始终没有达到阀值,但是离上一次磁盘同步的时间间隔

#达到阀值,也将触发.

log.flush.interval.ms = None

#文件在索引中清除后保留的时间 一般不需要去修改

log.delete.delay.ms = 60000

#控制上次固化硬盘的时间点,以便于数据恢复 一般不需要去修改

log.flush.offset.checkpoint.interval.ms =60000

----------------------TOPIC相关------------------------------------

#是否允许自动创建topic ,若是false,就需要通过命令创建topic

auto.create.topics.enable =true

#一个topic ,默认分区的replication个数 ,不得大于集群中broker的个数

default.replication.factor =1

#每个topic的分区个数,若是在topic创建时候没有指定的话 会被topic创建时的指定参数覆盖

num.partitions = 1

实例 --replication-factor 3 --partitions 1 --topic replicated-topic :名称replicated-topic有一个分区,分区被复制到三个broker上。

---------------------复制(Leader、replicas) 相关----------------------

#partition leader与replicas之间通讯时,socket的超时时间

controller.socket.timeout.ms = 30000

#partition leader与replicas数据同步时,消息的队列尺寸

controller.message.queue.size=10

#replicas响应partition leader的最长等待时间,若是超过这个时间,就将replicas列入ISR(in-sync replicas),并认为它是死的,不会再加入管理中

replica.lag.time.max.ms = 10000

#如果follower落后与leader太多,将会认为此follower[或者说partition relicas]已经失效.通常,在follower与leader通讯时,因为网络延迟或者链接断开,总会导致replicas中消息同步滞后如果消息之后太多,leader将认为此follower网络延迟较大或者消息吞吐能力有限,将会把此replicas迁移到其他follower中.在broker数量较少,或者网络不足的环境中,建议提高此值.

replica.lag.max.messages = 4000

#follower与leader之间的socket超时时间

replica.socket.timeout.ms= 30 * 1000

#leader复制时候的socket缓存大小

replica.socket.receive.buffer.bytes=64 * 1024

#replicas每次获取数据的最大大小

replica.fetch.max.bytes = 1024 * 1024

#replicas同leader之间通信的最大等待时间,失败了会重试

replica.fetch.wait.max.ms = 500

#fetch的最小数据尺寸,如果leader中尚未同步的数据不足此值,将会阻塞,直到满足条件

replica.fetch.min.bytes =1

#leader 进行复制的线程数,增大这个数值会增加follower的IO

num.replica.fetchers=1

#每个replica检查是否将最高水位进行固化的频率

replica.high.watermark.checkpoint.interval.ms = 5000

#是否允许控制器关闭broker ,若是设置为true,会关闭所有在这个broker上的leader,并转移到其他broker

controlled.shutdown.enable = false

#控制器关闭的尝试次数

controlled.shutdown.max.retries = 3

#每次关闭尝试的时间间隔

controlled.shutdown.retry.backoff.ms = 5000

#是否自动平衡broker之间的分配策略

auto.leader.rebalance.enable = false

#leader的不平衡比例,若是超过这个数值,会对分区进行重新的平衡

leader.imbalance.per.broker.percentage = 10

#检查leader是否不平衡的时间间隔

leader.imbalance.check.interval.seconds = 300

#客户端保留offset信息的最大空间大小

offset.metadata.max.bytes

---------------------ZooKeeper相关-----------------------------

#zookeeper集群的地址,可以是多个,多个之间用逗号分割 hostname1:port1,hostname2:port2,hostname3:port3

zookeeper.connect = localhost:2181

#ZooKeeper的最大超时时间,就是心跳的间隔,若是没有反映,那么认为已经死了,不易过大

zookeeper.session.timeout.ms=6000

#ZooKeeper的连接超时时间

zookeeper.connection.timeout.ms = 6000

#ZooKeeper集群中leader和follower之间的同步实际那

zookeeper.sync.time.ms = 2000