padding

步长

卷积

卷积核(也称“滤波器”,filter)

feature map

归一化算法:x=(x-Min)/(Max-Min); 归一化之后可以保证每一个x都在[0,1]的区间内。

网络结构

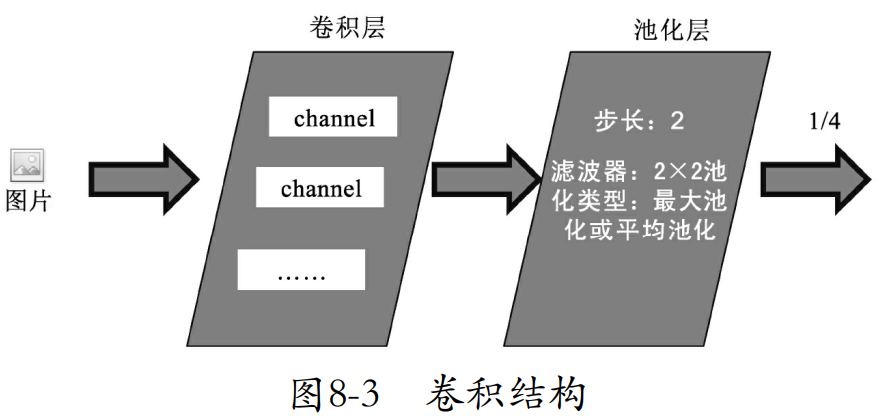

主要包括卷积层、池化层。细节:滤波器、步长、卷积操作、池化操作等。

- 网络结构描述:对于一幅图片一般会使用多个卷积核(滤波器),将它们统一放到卷积层里来操作,这一层中有几个滤波器,就会得出几个feature map,接着经过一个池化层(pooling),将生成的feature map缩小(降维)。下图为神经网络中一个标准的卷积操作组合,channel的个数代表卷积层的深度;池化层只有一个滤波器(filter),主要参数尺寸大小(即步长大小)

- 卷积网络的完整结构

一个卷积网络里包括5部分:输入层、若干个卷积操作和池化层结合的部分、全局平均池化层、输出层

- 输入层:将每个像素代表一个特征点输入进来。

- 卷积操作部分:由多个滤波器组合的卷积层。

- 步长:卷积操作的核心。

- 窄卷积:原始图片N1*N1, 卷积核N2*N2,卷积后图像 [(N1-N2)/S+1]*[(N1-N2)/S+1]

- 同卷积

- 全卷积

- 反向传播

- 核心步骤:(1)反向将误差传到前一层(2)根据当前的误差对应的学习参数表达式,计算出其需要更新的差值。

- 多通道的卷积

- 通道(channel)指图片中每个像素由几个数来表示。

- 在卷积网络中,通道分为输入通道和输出通道

- 输入通道:对于中间层的卷积,输入通道就是上一层的输出通道的个数

- 输出通道:想要输出几个feature map就放几个卷积核,就是几个输出通道

- 池化层:将卷积结果降维

- 池化的主要目的是降维,即在保持原有特征的基础上最大限度地将数组的维数变小。

- 均值池化

- 最大池化

- 反向传播

- 全局平均池化层:对生成的feature map取全局平均值

- 输出层:需要分成几类,相应的就会有几个输出节点。每个输出节点都代表当前样本属于的该类型的概率。

- 池化与卷积的算法不同:

- 卷积是将对应像素上的点相乘,然后再相加

- 池化中只关心滤波器的尺寸,不考虑内部的值。算法是,滤波器映射区域内的像素点取平均值或最大值。