一 下载kafka

下载地址:

记住 千万不能下载源码,下载编译过的

二 Linux安装kafka

将kafka上传到 Linux里面并解压,kafka需要JDK的环境。

解压kafka

tar -zxvf kafka_2.12-2.2.0.tgz

重命名

mv kafka_2.12-2.2.0 kafka

配置config下面的server.properties文件

broker.id=1 改为1

增加ip映射,如果不增加就是locahost。这样没办法使用java连接

host.name=192.168.100.129

三 kafka的一些基本命令

启动zk

bin/zookeeper-server-start.sh config/zookeeper.properties

启动kafka

bin/kafka-server-start.sh config/server.properties

创建tocic

bin/kafka-topics.sh --create --zookeeper 192.168.100.129:2181 --replication-factor 1 --partitions 1 --topic test

查询topic列表

bin/kafka-topics.sh --list --zookeeper 192.168.100.129:2181

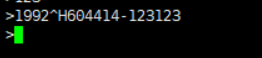

启动 Producer

bin/kafka-console-producer.sh --broker-list 192.168.100.129:9092 --topic test

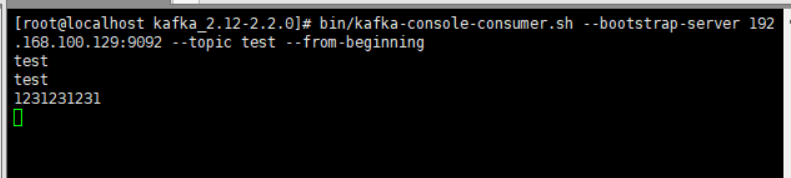

启动 Consumer

bin/kafka-console-consumer.sh --bootstrap-server 192.168.100.129:9092 --topic test --from-beginning

topic的信息

bin/kafka-topics.sh --describe --zookeeper 192.168.100.129:2181 --topic test

四 docker安装kafka

//安装zookeeper

docker pull wurstmeister/zookeeper

docker run -d --name zookeeper -p 2181:2181 -t wurstmeister/zookeeper

//docker exec -it zookeeper /bin/sh

//zookeeper的启动脚本都在bin目录

//安装kafka

docker pull wurstmeister/kafka

docker run -d --name kafka -p 9092:9092 -e KAFKA_BROKER_ID=0 -e KAFKA_ZOOKEEPER_CONNECT=IP:2181/kafka -e KAFKA_ADVERTISED_LISTENERS=PLAINTEXT://IP:9092 -e KAFKA_LISTENERS=PLAINTEXT://0.0.0.0:9092 -v /etc/localtime:/etc/localtime wurstmeister/kafka

//IP为虚拟机的IP地址

//-e KAFKA_BROKER_ID=0 在kafka集群中,每个kafka都有一个BROKER_ID来区分自己

//-e KAFKA_ZOOKEEPER_CONNECT=IP:2181/kafka 配置zookeeper管理kafka的路径

//-e KAFKA_ADVERTISED_LISTENERS=PLAINTEXT://IP:9092 把kafka的地址端口注册给zookeeper

//-e KAFKA_LISTENERS=PLAINTEXT://0.0.0.0:9092 配置kafka的监听端口

//-v /etc/localtime:/etc/localtime 容器时间同步虚拟机的时间

//验证是否成功

//进入容器

docker exec -it kafka /bin/bash

//进入路径/opt/kafka/bin 创建topic

kafka-topics.sh --create --zookeeper IP:2181/kafka --topic test --replication-factor 1 --partitions 2

五 java使用kafka推送和消费消息

使用的pom坐标

<dependency>

<groupId>org.apache.kafka</groupId>

<artifactId>kafka_2.12</artifactId>

</dependency>

Producer代码简单示例

import java.util.Properties;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.ProducerRecord;

public class Producer {

private static KafkaProducer<String, String> producer;

static {

Properties props = new Properties();

//声生产者kafkka地址

props.put("bootstrap.servers", "192.168.100.129:9092");

//key序列化

props.put("key.serializer", "org.apache.kafka.common.serialization.StringSerializer");

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

producer = new KafkaProducer<>(props);

}

//发送消息

private static void send() {

//topic key 推送的消息

ProducerRecord<String, String> record = new ProducerRecord<String, String>("test", "key", "1231231231");

producer.send(record);

producer.close();

}

public static void main(String[] args) {

send();

}

}

Consumer示例代码

import java.util.Collections;

import java.util.Properties;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

public class Consumer {

private static KafkaConsumer<String, String> consumer;

private static Properties props;

static {

props = new Properties();

//声生产者kafkka地址

props.put("bootstrap.servers", "192.168.100.129:9092");

//key反序列化

props.put("key.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

props.put("value.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

//组???????

props.put("group.id", "yangk");

}

private static void ConsumerMessage() {

//允许自动提交位移

props.put("enable.auto.commit", true);

consumer = new KafkaConsumer<String, String>(props);

consumer.subscribe(Collections.singleton("test"));

//使用轮询拉取数据--消费完成之后会根据设置时长来清除消息,被消费过的消息,如果想再次被消费,可以根据偏移量(offset)来获取

try {

while (true) {

ConsumerRecords<String, String> records = consumer.poll(100);

for (ConsumerRecord<String, String> r : records) {

System.out.printf("topic = %s, offset = %s, key = %s, value = %s", r.topic(), r.offset(),

r.key(), r.value());

}

}

} finally {

consumer.close();

}

}

public static void main(String[] args) {

ConsumerMessage();

}

}

六 总结

在启动kafka的时候遇到一个问题,这个问题的原因是因为Linux中的JDK版本低的原因导致。出现错误还是要细心的去看错误日志才能更准确的定位到错误的原因

这里也算是kafka的一个简单入门吧。后面还是需要继续学习kafka,来解决不懂得疑问