1.读取

2.数据预处理

3.数据划分—训练集和测试集数据划分

from sklearn.model_selection import train_test_split

x_train,x_test, y_train, y_test = train_test_split(data, target, test_size=0.2, random_state=0, stratify=y_train)

4.文本特征提取

sklearn.feature_extraction.text.CountVectorizer

sklearn.feature_extraction.text.TfidfVectorizer

from sklearn.feature_extraction.text import TfidfVectorizer

tfidf2 = TfidfVectorizer()

观察邮件与向量的关系

向量还原为邮件

4.模型选择

from sklearn.naive_bayes import GaussianNB

from sklearn.naive_bayes import MultinomialNB

说明为什么选择这个模型?

模型需要根据数据集中特征的特点来进行选取,垃圾邮件分类重点在于文档中单词出现的频率以及文档的重要性,数据并不符合正态分布的特征,并且垃圾邮件判定过程是一个随机事件,单词在邮件中出现的次数并不是固定的,因此不能选择高斯型分布模型,此处选择多项式分布模型。

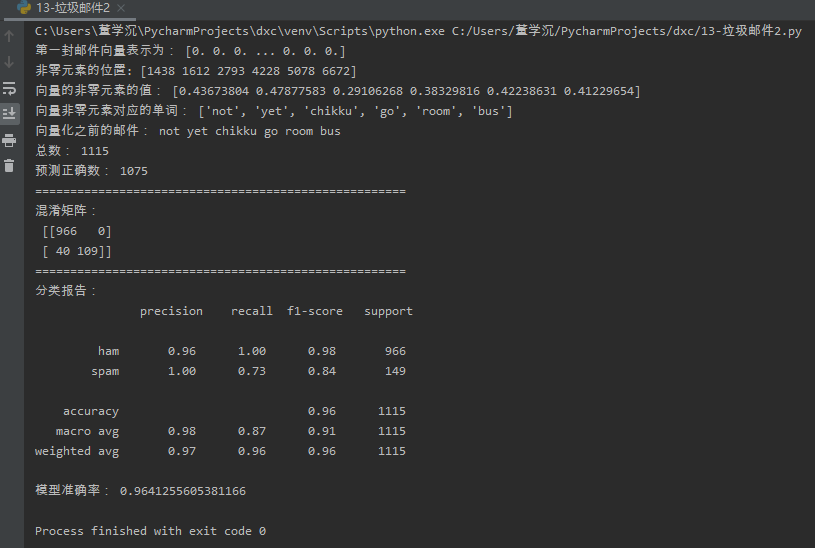

5.模型评价:混淆矩阵,分类报告

from sklearn.metrics import confusion_matrix

confusion_matrix = confusion_matrix(y_test, y_predict)

说明混淆矩阵的含义

高斯分布模型:属正态分布,可以将连续型变量转换成离散型的值;当样本数据中的值大多处于一个相近的区间,而其他区间出现较少时,就较为符合高斯分布模型。

多项式分布模型:多适用于离散型数据的预测。

垃圾邮件分类是以单词在垃圾邮件文本中出现的频率与在其他文本中所出现的频率进行预测,邮件的值是随机散乱的,所以多项式分布模型更为符合。

from sklearn.metrics import classification_report

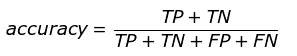

说明准确率、精确率、召回率、F值分别代表的意义

混淆矩阵(confusion-matrix):

TP(True Positive):真实为0,预测也为0

FN(False Negative):真实为0,预测为1

FP(False Positive):真实为1,预测为0

TN(True Negative):真实为1,预测也为1

准确率:代表分类器对整个样本判断正确的比重。

精确率:指被分类器判断正例中的正样本的比重。

召回率:指被预测为正例的占总的正例的比重。

F值:精确率和召回率的调和平均数,最大为1,最小为0。

代码如下:

from nltk.corpus import stopwords

from nltk.stem import WordNetLemmatizer

from sklearn.model_selection import train_test_split

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.naive_bayes import MultinomialNB

from sklearn.metrics import confusion_matrix, classification_report

import nltk

import csv

import numpy as np

# 根据词性,生成还原参数pos

def get_wordnet_pos(treebank_tag):

if treebank_tag.startswith('J'): # 形容词

return nltk.corpus.wordnet.ADJ

elif treebank_tag.startswith('V'): # 动词

return nltk.corpus.wordnet.VERB

elif treebank_tag.startswith('N'): # 名词

return nltk.corpus.wordnet.NOUN

elif treebank_tag.startswith('R'): # 副词

return nltk.corpus.wordnet.ADV

else:

return nltk.corpus.wordnet.NOUN

# 预处理

def preprocessing(text):

tokens = [word for sent in nltk.sent_tokenize(text) for word in nltk.word_tokenize(sent)] # 分词

stops = stopwords.words('english') # 使用英文的停用词表

tokens = [token for token in tokens if token not in stops] # 去除停用词

tokens = [token.lower() for token in tokens if len(token) >= 3] # 大小写,短词

lmtzr = WordNetLemmatizer()

tag = nltk.pos_tag(tokens) # 词性

tokens = [lmtzr.lemmatize(token, pos=get_wordnet_pos(tag[i][1])) for i, token in enumerate(tokens)] # 词性还原

preprocessed_text = ' '.join(tokens)

return preprocessed_text

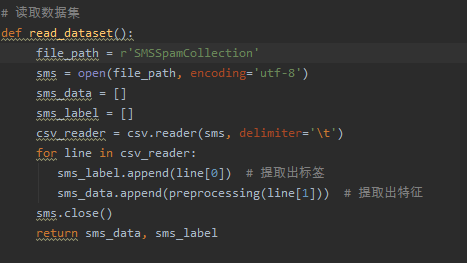

# 读取数据集

def read_dataset():

file_path = r'SMSSpamCollection'

sms = open(file_path, encoding='utf-8')

sms_data = []

sms_label = []

csv_reader = csv.reader(sms, delimiter=' ')

for line in csv_reader:

sms_label.append(line[0]) # 提取出标签

sms_data.append(preprocessing(line[1])) # 提取出特征

sms.close()

return sms_data, sms_label

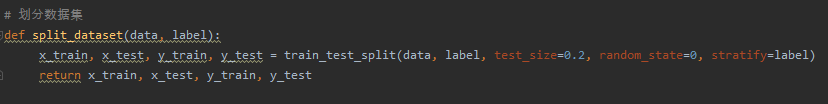

# 划分数据集

def split_dataset(data, label):

x_train, x_test, y_train, y_test = train_test_split(data, label, test_size=0.2, random_state=0, stratify=label)

return x_train, x_test, y_train, y_test

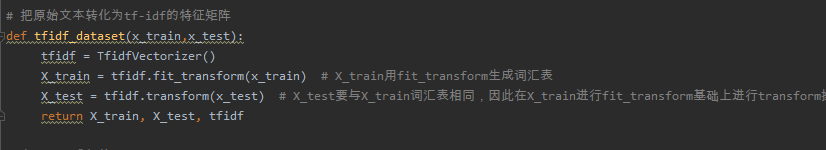

# 把原始文本转化为tf-idf的特征矩阵

def tfidf_dataset(x_train,x_test):

tfidf = TfidfVectorizer()

X_train = tfidf.fit_transform(x_train) # X_train用fit_transform生成词汇表

X_test = tfidf.transform(x_test) # X_test要与X_train词汇表相同,因此在X_train进行fit_transform基础上进行transform操作

return X_train, X_test, tfidf

# 向量还原成邮件

def revert_mail(x_train, X_train, model):

s = X_train.toarray()[0]

print("第一封邮件向量表示为:", s)

# 该函数输入一个矩阵,返回扁平化后矩阵中非零元素的位置(index)

a = np.flatnonzero(X_train.toarray()[0]) # 非零元素的位置(index)

print("非零元素的位置:", a)

print("向量的非零元素的值:", s[a])

b = model.vocabulary_ # 词汇表

key_list = []

for key, value in b.items():

if value in a:

key_list.append(key) # key非0元素对应的单词

print("向量非零元素对应的单词:", key_list)

print("向量化之前的邮件:", x_train[0])

# 模型选择(根据数据特点选择多项式分布)

def mnb_model(x_train, x_test, y_train, y_test):

mnb = MultinomialNB()

mnb.fit(x_train, y_train)

ypre_mnb = mnb.predict(x_test)

print("总数:", len(y_test))

print("预测正确数:", (ypre_mnb == y_test).sum())

return ypre_mnb

# 模型评价:混淆矩阵,分类报告

def class_report(ypre_mnb, y_test):

conf_matrix = confusion_matrix(y_test, ypre_mnb)

print("=====================================================")

print("混淆矩阵: ", conf_matrix)

c = classification_report(y_test, ypre_mnb)

print("=====================================================")

print("分类报告: ", c)

print("模型准确率:", (conf_matrix[0][0] + conf_matrix[1][1]) / np.sum(conf_matrix))

if __name__ == '__main__':

sms_data, sms_label = read_dataset() # 读取数据集

x_train, x_test, y_train, y_test = split_dataset(sms_data, sms_label) # 划分数据集

X_train, X_test,tfidf = tfidf_dataset(x_train, x_test) # 把原始文本转化为tf-idf的特征矩阵

revert_mail(x_train, X_train, tfidf) # 向量还原成邮件

y_mnb = mnb_model(X_train, X_test, y_train,y_test) # 模型选择

class_report(y_mnb, y_test) # 模型评价

6.比较与总结

如果用CountVectorizer进行文本特征生成,与TfidfVectorizer相比,效果如何?

CountVectorizer:只考虑词汇在文本中出现的频率,属于词袋模型特征。

TfidfVectorizer: 除了考量某词汇在文本出现的频率,还关注包含这个词汇的所有文本的数量。能够削减高频没有意义的词汇出现带来的影响, 挖掘更有意义的特征。属于Tfidf特征。

相比之下,文本条目越多,Tfid的效果会越显著。

CountVectorizer与TfidfVectorizer相比,对于负类的预测更加准确,而正类的预测则稍逊色。但总体预测正确率也比TfidfVectorizer稍高,相比之下似乎CountVectorizer更适合进行预测。