分布式文件系统FastDFS架构剖析

第一部分 概念和原理

什么是FastDFS?

FastDFS是一个开源的轻量级分布式文件系统。它解决了大数据量存储和负载均衡等问题。特别适合以中小文件(建议范围:4KB < file_size <500MB)为载体的在线服务,如相册网站、视频网站等等。在UC基于FastDFS开发向用户提供了:网盘,社区,广告和应用下载等业务的存储服务。

FastDFS架构:

FastDFS服务端有三个角色:跟踪服务器(tracker server)、存储服务器(storage server)和客户端(client)。

tracker server:跟踪服务器,主要做调度工作,起负载均衡的作用。在内存中记录集群中所有存储组和存储服务器的状态信息,是客户端和数据服务器交互的枢纽。相比GFS中的master更为精简,不记录文件索引信息,占用的内存量很少。

storage server:存储服务器(又称:存储节点或数据服务器),文件和文件属性(meta data)都保存到存储服务器上。Storage server直接利用OS的文件系统调用管理文件。

client:客户端,作为业务请求的发起方,通过专有接口,使用TCP/IP协议与跟踪器服务器或存储节点进行数据交互。

Tracker Server:跟踪服务器,主要做调度工作,在访问上起负载均衡的作用。

Storage Server:存储服务器(又称数据服务器)

FastDFS是一个应用级分布式文件存储服务,其采用中心型结构(类似GFS、HDFS、TFS等),主要用于大中型网站存储资源文件。FastDFS具有轻量级,支持高并发放访问,负载均衡,可扩展等优点。而FastDFS最大的亮点就是对小文件的存储性能较好,这主要来自于其文件名策略。

1.小文件存储性能优化

小文件的性能瓶颈主要来自于对元数据服务器(如FastDFS中的TrackerServer或TFS中的NameServer)的访问,因为当文件本身大小很小时,元数据存储所占空间与文件内容存储所占空间的比例就变得较大,访问元数据所消耗资源与访问文件内容所消耗资源的比例也变得较大。因此,通常对小文件存储的优化方法主要有两大类思路:一是减少访问元数据的次数,比如Cache预取;二是减少元数据所占的存储空间,比如FastDFS使用的文件名策略。

2. FastDFS文件名策略

FastDFS中的文件名是在向StorageServer存储文件时由系统指定的,文件名中包含了VolumeID和FileID。也就是说,当客户要读取某个文件时,通过在客户端对文件名进行解析,就可以知道该文件存储在哪个Volume上和它在StorageServer中的FileID。但是此时用户还不能读取文件,因为他不知道Volume内各个StorageServer的ip地址,也不知道应该从Volume内的哪个StorageServer中读取。所以用户需手持欲访问的文件的VolumeID向TrackerServer询问,TrackerServe会均衡当前各StorageServer的IO负载状况,返回一个最佳的StorageServer的ip地址。最后用户与该StorageServer连接,出示欲访问文件的FileID,StorageServer上会维持一个FileID对应偏移量的表,从而得到欲访问文件的偏移量。

可见,FastDFS的文件名策略将文件存储位置信息隐含在文件名中,从而减少了元数据量,达到了优化小文件存储性能的作用。

FastDFS是一款类Google FS的开源分布式文件系统,它用纯C语言实现,支持Linux、FreeBSD、AIX等UNIX系统。它只能通过专有API对文件进行存取访问,不支持POSIX接口方式,不能mount使用。准确地讲,Google FS以及FastDFS、mogileFS、HDFS、TFS等类GoogleFS都不是系统级的分布式文件系统,而是应用级的分布式文件存储服务。

FastDFS的设计理念

FastDFS是为互联网应用量身定做的分布式文件系统,充分考虑了冗余备份、负载均衡、线性扩容等机制,并注重高可用、高性能等指标。和现有的类Google FS分布式文件系统相比,FastDFS的架构和设计理念有其独到之处,主要体现在轻量级、分组方式和对等结构三个方面。

轻量级

FastDFS只有两个角色:Tracker server和Storage server。Tracker server作为中心结点,其主要作用是负载均衡和调度。Tracker server在内存中记录分组和Storage server的状态等信息,不记录文件索引信息,占用的内存量很少。另外,客户端(应用)和Storage server访问Tracker server时,Tracker server扫描内存中的分组和Storage server信息,然后给出应答。由此可以看出Tracker server非常轻量化,不会成为系统瓶颈。

FastDFS中的Storage server在其他文件系统中通常称作Trunk server 它直接利用OS的文件系统存储文件。FastDFS不会对文件进行分块存储,众所周知,FastDFS不对文件进行分块存储,与支持文件分块存储的DFS相比,更加简洁高效,并且完全能满足绝大多数互联网应用的实际需要。

在FastDFS中,客户端上传文件时,文件ID不是由客户端指定,而是由Storage server生成后返回给客户端的。文件ID中包含了组名、文件相对路径和文件名,Storage server可以根据文件ID直接定位到文件。因此FastDFS集群中根本不需要存储文件索引信息,这是FastDFS比较轻量级的一个例证。而其他文件系统则需要存储文件索引信息,这样的角色通常称作NameServer。其中mogileFS采用MySQL数据库来存储文件索引以及系统相关的信息,其局限性显而易见,MySQL将成为整个系统的瓶颈。

FastDFS轻量级的另外一个体现是代码量较小。最新的V2.0包括了C客户端API、FastDHT客户端API和PHP extension等,代码行数不到5.2万行。

分组方式

FastDFS采用了分组存储方式。集群由一个或多个组构成,一个组由一台或多台存储服务器组成,同组内的多台Storage server之间是互备关系,同组存储服务器上的文件是完全一致的。文件上传、下载、删除等操作可以在组内任意一台Storage server上进行。类似木桶短板效应,一个组的存储容量为该组内存储服务器容量最小的那个,由此可见组内存储服务器的软硬件配置最好是一致的。

采用分组存储方式的好处是灵活、可控性较强。比如上传文件时,可以由客户端直接指定上传到的组。一个分组的存储服务器访问压力较大时,可以在该组增加存储服务器来扩充服务能力(纵向扩容)。当系统容量不足时,可以增加组来扩充存储容量(横向扩容)。采用这样的分组存储方式,可以使用FastDFS对文件进行管理,使用主流的Web server如Apache、nginx等进行文件下载。

对等结构

FastDFS集群中的Tracker server也可以有多台,Tracker server和Storage server均不存在单点问题。Tracker server之间是对等关系,组内的Storage server之间也是对等关系。传统的Master-Slave结构中的Master是单点,写操作仅针对Master。如果Master失效,需要将Slave提升为Master,实现逻辑会比较复杂。和Master-Slave结构相比,对等结构中所有结点的地位是相同的,每个结点都是Master,不存在单点问题。

FastDFS的架构

图1展示的是FastDFS的系统架构。

从图1可以看出,Tracker server之间相互独立,不存在直接联系。

客户端和Storage server主动连接Tracker server。Storage server主动向Tracker server报告其状态信息,包括磁盘剩余空间、文件同步状况、文件上传下载次数等统计信息。Storage server会连接集群中所有的Tracker server,向他们报告自己的状态。Storage server启动一个单独的线程来完成对一台Tracker server的连接和定时报告。需要说明的是,一个组包含的Storage server不是通过配置文件设定的,而是通过Tracker server获取到的。

不同组的Storage server之间不会相互通信,同组内的Storage server之间会相互连接进行文件同步。

Storage server采用binlog文件记录文件上传、删除等更新操作。binlog中只记录文件名,不记录文件内容。

文件同步只在同组内的Storage server之间进行,采用push方式,即源头服务器同步给目标服务器。只有源头数据才需要同步,备份数据并不需要再次同步,否则就构成环路了。有个例外,就是新增加一台Storage server时,由已有的一台Storage server将已有的所有数据(包括源头数据和备份数据)同步给该新增服务器。

Storage server中由专门的线程根据binlog进行文件同步。为了最大程度地避免相互影响以及出于系统简洁性考虑,Storage server对组内除自己以外的每台服务器都会启动一个线程来进行文件同步。

接下来我们一起看一下文件上传和下载的交互过程。文件上传和下载流程分别如图2、图3所示。文件上传流程的步骤如下:

1. Client询问Tracker server上传到的Storage server;

2. Tracker server返回一台可用的Storage server,返回的数据为该Storage server的IP地址和端口;

3. Client直接和该Storage server建立连接,进行文件上传,Storage server返回新生成的文件ID,文件上传结束。

文件下载流程的步骤如下:

1. Client询问Tracker server可以下载指定文件的Storage server,参数为文件ID(包含组名和文件名);

2. Tracker server返回一台可用的Storage server;

3. Client直接和该Storage server建立连接,完成文件下载。

文件同步延迟问题的提出

客户端将一个文件上传到一台Storage server后,文件上传工作就结束了。由该Storage server根据binlog中的上传记录将这个文件同步到同组的其他Storage server。这样的文件同步方式是异步方式,异步方式带来了文件同步延迟的问题。新上传文件后,在尚未被同步过去的Storage server上访问该文件,会出现找不到文件的现象。FastDFS是如何解决文件同步延迟这个问题的呢?

文件的访问分为两种情况:文件更新和文件下载。文件更新包括设置文件附加属性和删除文件。文件的附加属性包括文件大小、图片宽度、图片高度等。FastDFS中,文件更新操作都会优先选择源Storage server,也就是该文件被上传到的那台Storage server。这样的做法不仅避免了文件同步延迟的问题,而且有效地避免了在多台Storage server上更新同一文件可能引起的时序错乱的问题。

那么文件下载是如何解决文件同步延迟这个问题的呢?

要回答这个问题,需要先了解文件名中包含了什么样的信息。Storage server生成的文件名中,包含了源Storage server的IP地址和文件创建时间等字段。文件创建时间为UNIX时间戳,后面称为文件时间戳。从文件名或文件ID中,可以反解出这两个字段。

然后我们再来看一下,Tracker server是如何准确地知道一个文件已被同步到一台Storage server上的。前面已经讲过,文件同步采用主动推送的方式。另外,每台storage server都会定时向tracker server报告它向同组的其他storage server同步到的文件时间戳。当tracker server收到一台storage server的文件同步报告后,它会依次找出该组内各个storage server(后称作为S)被同步到的文件时间戳最小值,作为S的一个属性记录到内存中。

FastDFS对文件同步延迟问题的解决方案

下面我们来看一下FastDFS采取的解决方法。

一个最简单的解决办法,和文件更新一样,优先选择源Storage server下载文件即可。这可以在Tracker server的配置文件中设置,对应的参数名为download_server。

另外一种选择Storage server的方法是轮流选择(round-robin)。当Client询问Tracker server有哪些Storage server可以下载指定文件时,Tracker server返回满足如下四个条件之一的Storage server:

该文件上传到的源Storage server,文件直接上传到该服务器上的;

文件创建时间戳 < Storage server被同步到的文件时间戳,这意味着当前文件已经被同步过来了;

文件创建时间戳=Storage server被同步到的文件时间戳,且(当前时间—文件创建时间戳) > 一个文件同步完成需要的最大时间(如5分钟);

(当前时间—文件创建时间戳) > 文件同步延迟阈值,比如我们把阈值设置为1天,表示文件同步在一天内肯定可以完成。

结束语

看了上面的介绍,你是否认为FastDFS比较简洁高效呢?原雅虎同事——一位比较资深的系统架构师听完FastDFS介绍后,作出这样的评价:“FastDFS是穷人的解决方案”。他的意思是说FastDFS把简洁和高效做到了极致,非常节约资源,中小网站完全用得起,这是对FastDFS的极大认可和褒奖。

FastDFS从2008年7月发布至今,已推出31个版本,后续完善和优化工作正在持续进行中。目前已有多家公司在生产环境中使用FastDFS,相信通过我们的不懈努力,FastDFS一定会越来越好!

第二部分 fdfs安装和实战

基础环境说明,centos 6.6 系统,6台服务器,其中两台tracker 4台 storages

|

hd01 |

tracker服务器 |

192.168.1.11 |

|

hd02 |

tracker服务器 |

192.168.1.12 |

|

hd03 |

storages服务器 |

192.168.1.13 |

|

hd04 |

storages服务器 |

192.168.1.14 |

|

hd05 |

storages服务器 |

192.168.1.15 |

|

hd06 |

storages服务器 |

192.168.1.16 |

1. 配置每台服务器的主机名,以hd1为例 配置如下

[root@hd1 ~]# cat /etc/hosts

127.0.0.1 hd01 localhost

192.168.1.11 hd01

192.168.1.12 hd02

192.168.1.13 hd03

192.168.1.14 hd04

192.168.1.15 hd05

192.168.1.16 hd06

[root@hd2 ~]# cat /etc/hosts

127.0.0.1 hd02 localhost

192.168.1.11 hd01

192.168.1.12 hd02

192.168.1.13 hd03

192.168.1.14 hd04

192.168.1.15 hd05

192.168.1.16 hd06

其他主机的/etc/hosts 忽略

2.安装依赖包(在所有服务器上)

[root@hd1 ~]# yum -y install perl-devel make gcc cmake

3.安装fastdfs所需要的common库(在所有的服务器)

unzip libfastcommon-master.zip

cd libfastcommon-master

./make.sh

./make.sh install

4.安装fastdfs(在所有机器)

unzip fastdfs-master.zip

cd fastdfs-master

./make.sh

./make.sh install

5.修改配置文件(在所有tracker服务器上)

[root@hd1 ~]# cp /etc/fdfs/client.conf.sample /etc/fdfs/client.conf

[root@hd1 ~]# cp /etc/fdfs/tracker.conf.sample /etc/fdfs/tracker.conf

[root@hd2 ~]# cp /etc/fdfs/client.conf.sample /etc/fdfs/client.conf

[root@hd2 ~]# cp /etc/fdfs/tracker.conf.sample /etc/fdfs/tracker.conf

修改配置文件

vim /etc/fdfs/tracker.conf

base_path=/data/fdfs/Tracker #第22行

http.server_port=80 #第260行

创建目录

mkdir /data/fdfs/Tracker -p

修改配置文件

vim /etc/fdfs/client.conf

base_path=/data/fdfs/client #第10行

tracker_server=192.168.1.11:22122 #第14行

tracker_server=192.168.1.12:22122

创建目录

mkdir /data/fdfs/client -p

启动服务

service fdfs_trackerd start

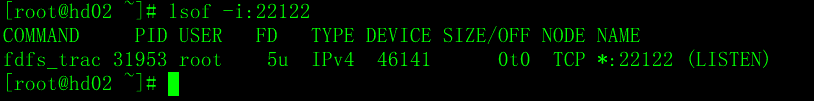

[root@hd1 ~]# lsof -i :22122

COMMAND PID USER FD TYPE DEVICE SIZE/OFF NODE NAME

fdfs_trac 36821 root 5u IPv4 255518 0t0 TCP *:22122 (LISTEN)

在storage上操作(四台storage,192.168.1.13,192.168.1.14为同一个组)进行如下操作:

cp /etc/fdfs/storage.conf.sample /etc/fdfs/storage.conf

vim /etc/fdfs/storage.conf

group_name=group1 #第3行

base_path=/data/fdfs/storage #第41行

store_path0=/data/fdfs/storage #第109行

tracker_server=192.168.1.11:22122 #第118行

tracker_server=192.168.1.12:22122

#结束!!!

在storage上操作(四台storage,192.168.1.15,192.168.1.16为同一个组)进行如下操作:

vim /etc/fdfs/storage.conf

group_name=group2 #第3行

base_path=/data/fdfs/storage #第41行

store_path0=/data/fdfs/storage #第109行

tracker_server=192.168.1.11:22122 #第118行

tracker_server=192.168.1.12:22122

#结束!!!

创建目录

mkdir /data/fdfs/storage -p

启动storage端的服务

service fdfs_storaged start

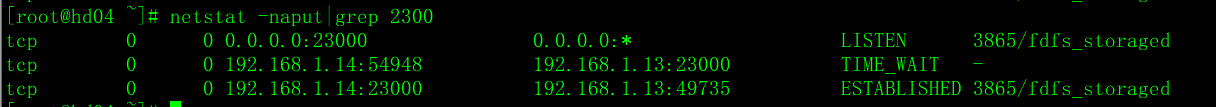

检查Tracker hd01 的服务器的状态

[root@hd1 ~]# fdfs_monitor /etc/fdfs/client.conf

Storage 1:

id = 192.168.1.13

ip_addr = 192.168.1.13 (hd03) ACTIVE

Storage 2:

id = 192.168.1.14

ip_addr = 192.168.1.14 (hd04) ACTIVE

#以上表示192.168.1.11跟踪服务器上有两个storage服务器192.168.1.13和192.168.1.14

测试上传

[root@hd1 ~]# echo abcd >11.txt

[root@hd1 ~]# fdfs_test /etc/fdfs/client.conf upload /root/11.txt

group_name=group1, remote_filename=M00/00/00/wKgBDVkCHIaAQfRtAAAABXWItN4729_big.txt

source ip address: 192.168.1.13

#我们紧接着,继续上传

[root@hd1 ~]# echo 1234 >22.txt

[root@hd1 ~]# fdfs_test /etc/fdfs/client.conf upload /root/22.txt

group_name=group1, remote_filename=M00/00/00/wKgBDlkCHJ2AKpdHAAAABVCR-FM269.txt

source ip address: 192.168.1.14

#以上说明会将上传任务负载分担到两个不同的storage服务器上

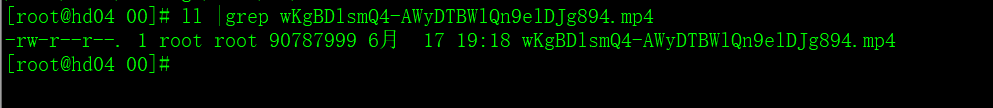

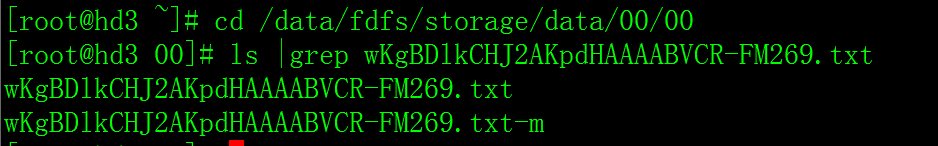

那么这两个storage服务器上的文件会不会同步呢?

我们去192.168.1.13上查找有没有wKgBDlkCHJ2AKpdHAAAABVCR-FM269.txt文件,如果有说明,192.168.1.14 把22.txt同步到192.168.1.13上了

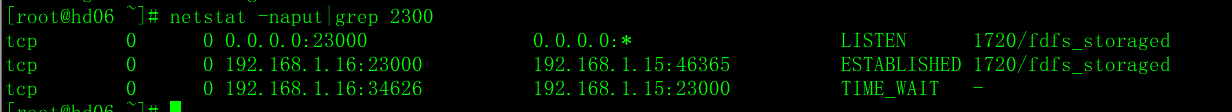

检查另外一个跟踪服务器的状态

[root@hd2 ~]# fdfs_monitor /etc/fdfs/client.conf

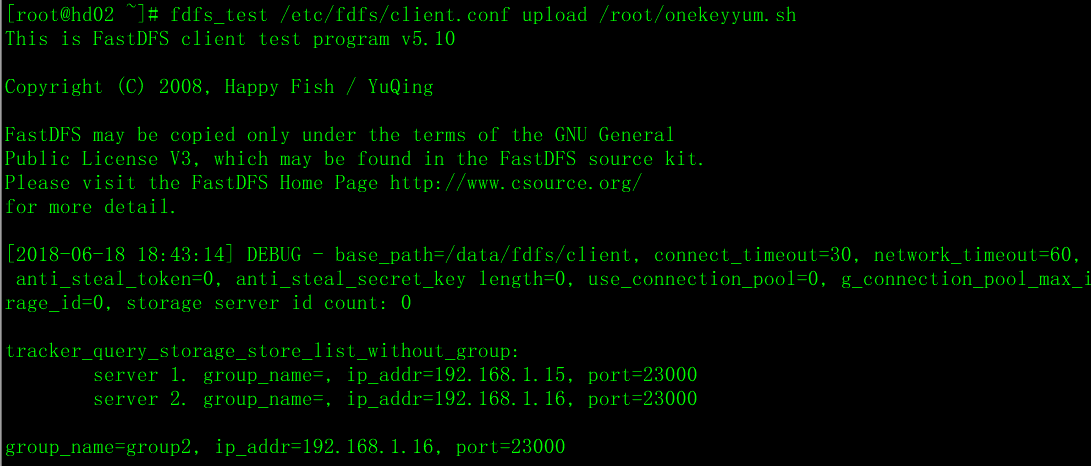

测试上传1

[root@hd2 ~]# fdfs_test /etc/fdfs/client.conf upload /root/onekeyyum.sh

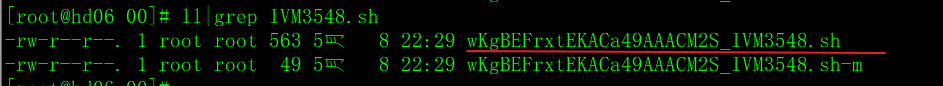

从上面的输出可以看到文件被上传到了hd06 的下面,可以查看一下

测试上传2

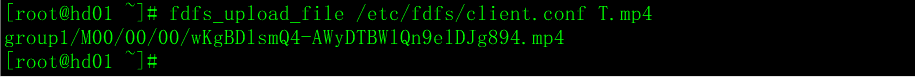

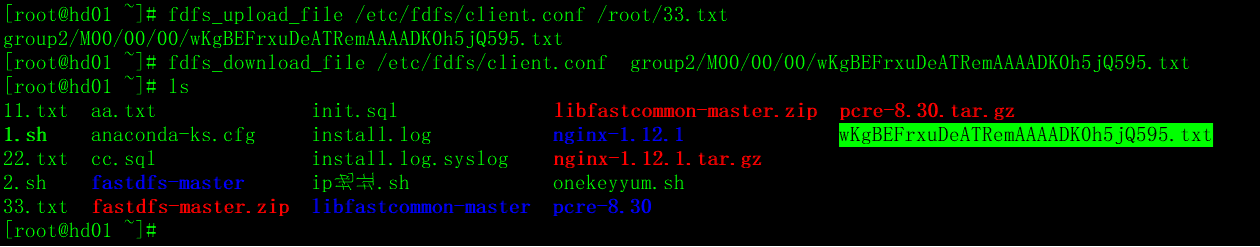

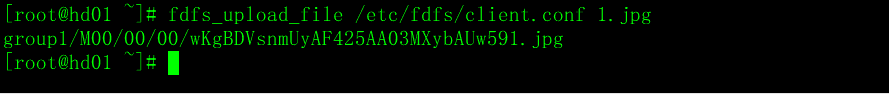

[root@hd1 ~]# fdfs_upload_file /etc/fdfs/client.conf /root/33.txt

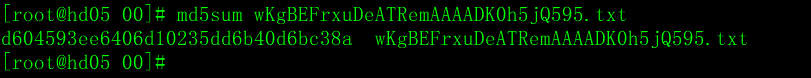

做md5验证:

OK

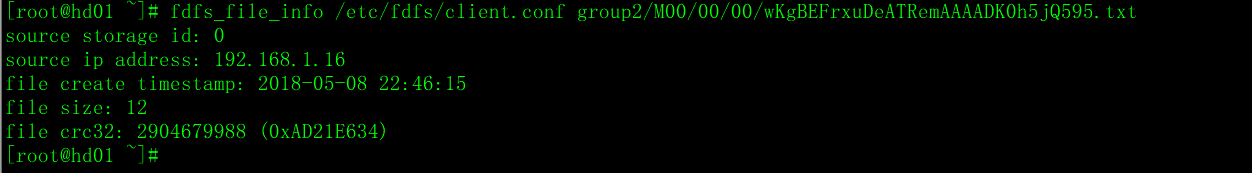

查看文件信息

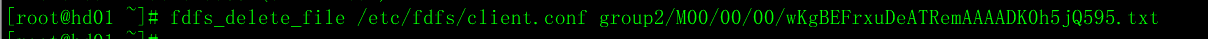

删除文件

#删除之后没有信息提示,我们进行查找,结果如下

#上面表示没有这个文件了

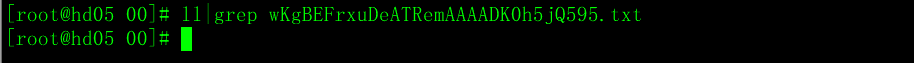

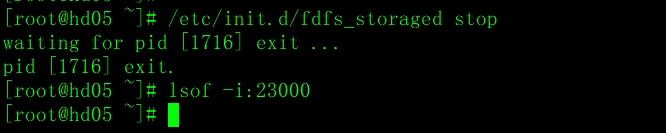

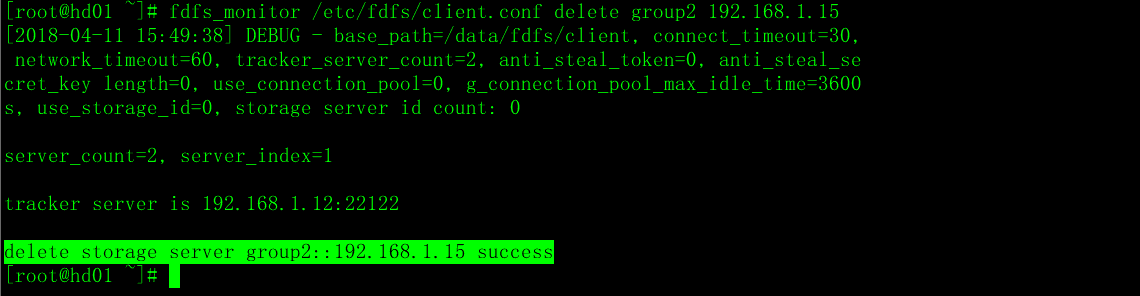

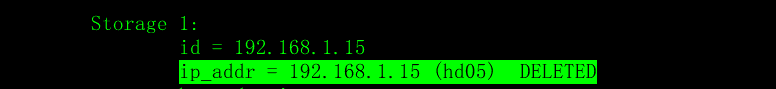

移除故障节点

加入节点上的fastdfs出了问题,我们需要将它从组中移除,可根据下面的命令操作

1)停掉fastdfs上的storage服务

/etc/init.d/fdfs_storaged stop

2)将问题节点(hd5)从组中移除

fdfs_monitor /etc/fdfs/client.conf delete group2 192.168.1.15

1)移除成功后,再次查看

[root@hd1 ~]# fdfs_monitor /etc/fdfs/client.conf

当hd05上的fastdfs修复后,可以再把它加入到fastdfs组中,加入的操作只需要把hd05上的fastdfs服务正常启动就好,因为配置文件已经做了配置,如果服务正常的话,修复后的节点可以自动加入到fastdfs组中。

启动fastdfs_storaged服务

[root@hd5 ~]# /etc/init.d/fdfs_storaged start

再次查看,恢复正常

总结:group机制本身可用来做负载均衡,但这只是一种静态的负载均衡机制,需要预先知道应用的访问特性;同时group机制也导致不可能在group之间迁移数据来做动态负载均衡

第三部分 配置nginx为storage server提供http访问接口

在大多数业务场景中,往往需要为FastDFS存储的文件提供http下载服务,而尽管FastDFS在其storage及tracker都内置了http服务, 但性能表现却不尽如人意;通过增加基于当前主流web服务器的扩展模块(包括nginx/apache),利用web服务器直接对本机storage数据文件提供http服务,以提高文件下载的性能,同时避免了同组storage服务器同步延迟导致不能访问的问题。

描述:

nginx 配置在storage节点上;

因为 nginx 要想连接 fastdfs 就必须要有相应的模块,所以要编译安装 nginx 把fastdfs-nginx-module 模块编译进去

#nginx 安装(Tracker节点)

#Nginx缓存和反向代理

[root@hd1 ~]# yum install -y pcre pcre-devel openssl-devel openssl

[root@hd1 ~]# tar -xf ngx_cache_purge-2.3.tar.gz

[root@hd1 nginx-1.10.1]# ./configure --prefix=/usr/local/nginx --add-module=/root/ngx_cache_purge-2.3 --with-http_stub_status_module --with-http_ssl_module

[root@hd1 nginx-1.10.1]#make && make install

[root@hd1 ~]# cd /usr/local/nginx/conf/

[root@hd1 conf]# cat nginx.conf

user root;

worker_processes 1;

events {

worker_connections 1024;

}

http {

include mime.types;

default_type application/octet-stream;

sendfile on;

tcp_nopush on;

keepalive_timeout 65;

proxy_cache_path /usr/local/nginx/proxy_cache_path levels=1:2 keys_zone=cache_one:500m inactive=1d max_size=10g;

proxy_temp_path /usr/local/nginx/proxy_tmp_path;

gzip on;

gzip_min_length 1k;

gzip_buffers 4 16k;

gzip_types text/plain application/x-javascript text/css application/xml text/javascript application/x-httpd-php;

gzip_vary on;

upstream fdfs {

server 192.168.1.13:80 max_fails=3 fail_timeout=30s weight=1;

server 192.168.1.14:80 max_fails=3 fail_timeout=30s weight=1;

}

server {

listen 80;

server_name localhost;

location / {

root html;

index index.html index.htm;

}

location /group1/M00 {

proxy_next_upstream error timeout invalid_header http_500 http_503 http_404;

proxy_pass http://fdfs;

proxy_set_header Host $host;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_connect_timeout 300;

proxy_send_timeout 300;

proxy_read_timeout 600;

proxy_max_temp_file_size 10m;

proxy_busy_buffers_size 256k;

proxy_buffer_size 256k;

proxy_buffers 4 256k;

proxy_cache_valid 200 304 12h ;

proxy_cache_valid 301 302 1m ;

proxy_cache_valid any 1m;

proxy_cache cache_one;

proxy_cache_key $host$uri$is_args$args;

}

location ~ /purge(/.*) {

allow 127.0.0.1 ;

allow 192.168.1.0/24 ;

deny all ;

proxy_cache_purge cache_one $host$1$is_args$args ;

}

error_page 500 502 503 504 /50x.html;

location = /50x.html {

root html;

}

}

}

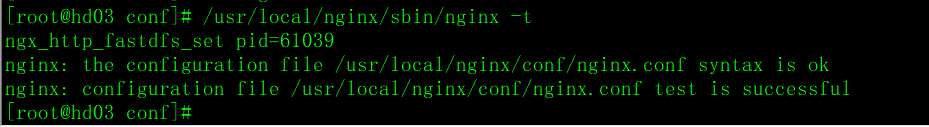

检查语法

[root@hd1 conf]# /usr/local/nginx/sbin/nginx -t

nginx: the configuration file /usr/local/nginx/conf/nginx.conf syntax is ok

nginx: configuration file /usr/local/nginx/conf/nginx.conf test is successful

创建缓存目录

[root@hd1 conf]# mkdir -p /usr/local/nginx/proxy_temp_path

[root@hd1 conf]# mkdir -p /usr/local/nginx/proxy_cache_path

启动服务

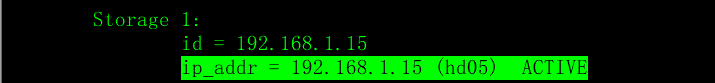

[root@hd1 ~]# /usr/local/nginx/sbin/nginx

[root@hd1 ~]# netstat -lntup | grep 80

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 71571/nginx

#nginx 安装(两台Storage节点)

[root@hd3 ~]#wget -c https://nginx.org/download/nginx-1.12.1.tar.gz

[root@hd3 ~]#wget https://github.com/happyfish100/fastdfs-nginx-module/archive/master.zip

[root@hd3 ~]#tar -xf nginx-1.12.1.tar.gz

[root@hd4 ~]# unzip master.zip

[root@hd3 ~]# yum install -y pcre pcre-devel openssl-devel openssl

[root@hd3 ~]# cd nginx-1.12.1

[root@hd3 ~]#./configure --prefix=/usr/local/nginx --add-module=/root/fastdfs-nginx-module-master/src --with-http_stub_status_module --with-http_ssl_module

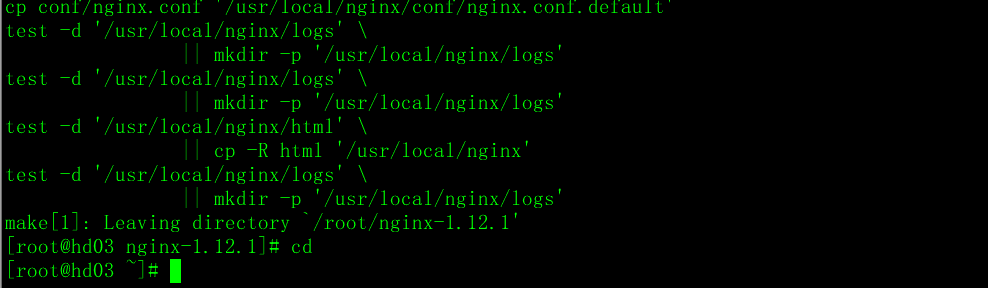

root@hd3 ~]#make && make install

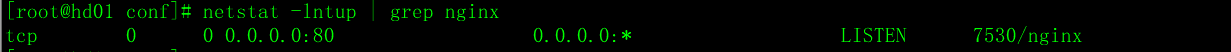

此处编译 出错

解决方法

解决办法:

https://github.com/happyfish100/fastdfs/issues/126

修改/root/fastdfs-nginx-module-master/src/common.c第1245行

把(pContext-> range_count> 1 &&!g_http_params.support_multi_range))最后面的条件

去掉了改成(pContext-> range_count > 1))

重新make就好了

目前看没有什么问题

make install 成功

[root@hd3 ~]# cp /root/fastdfs-nginx-module-master/src/mod_fastdfs.conf /etc/fdfs/

[root@hd3 ~]# cp /root/fastdfs-master/conf/http.conf /etc/fdfs/

[root@hd3 ~]# cp /root/fastdfs-master/conf/mime.types /etc/fdfs/

[root@hd3 ~]# mkdir /data/fdfs/storage/data/group1

[root@hd3 ~]#ln -s /data/fdfs/storage/data/ /data/fdfs/storage/data/group1/M00

[root@hd03 ~]# cat /etc/fdfs/mod_fastdfs.conf

tracker_server=192.168.1.11:22122

url_have_group_name = true

store_path0=/data/fdfs/storage/

log_filename=/usr/local/nginx/logs/mod_fastdfs.log

#只列出 需要修改的

然后

[root@hd3 ~]# vim /usr/local/nginx/conf/nginx.conf

user root; # 第一行内容改成root

location /group1/M00 { #在server标签内的location

root /data/fdfs/storage/data;

ngx_fastdfs_module;

}

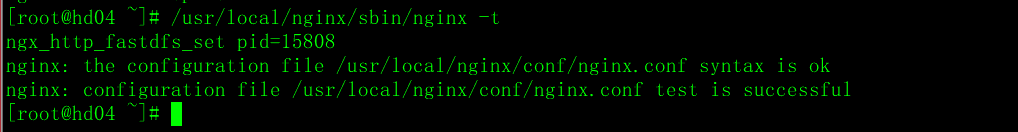

测试配置文件

[root@hd3 ~]# /usr/local/nginx/sbin/nginx -t

启动服务

[root@hd3 ~]# /usr/local/nginx/sbin/nginx

[root@hd4 ~]# /usr/local/nginx/sbin/nginx

[root@hd3 ~]# curl -I 192.168.1.13

[root@hd4 ~]# curl -I 192.168.1.14

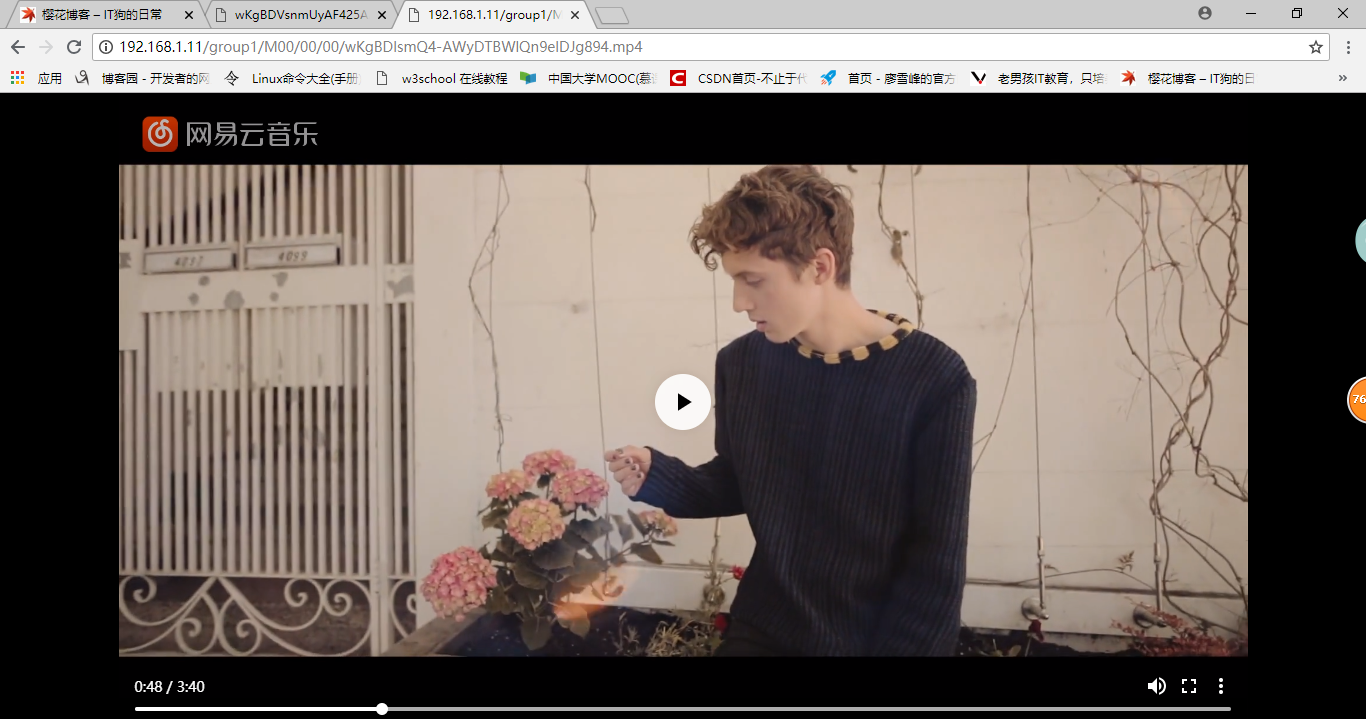

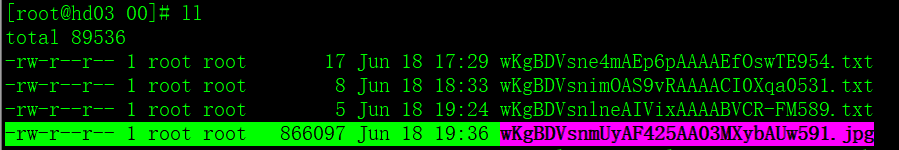

在tracker上 上传文件

.txt文件

[root@hd1 ~]# echo "hello" > test.txt

[root@hd1 ~]# fdfs_upload_file /etc/fdfs/client.conf test.txt

查看

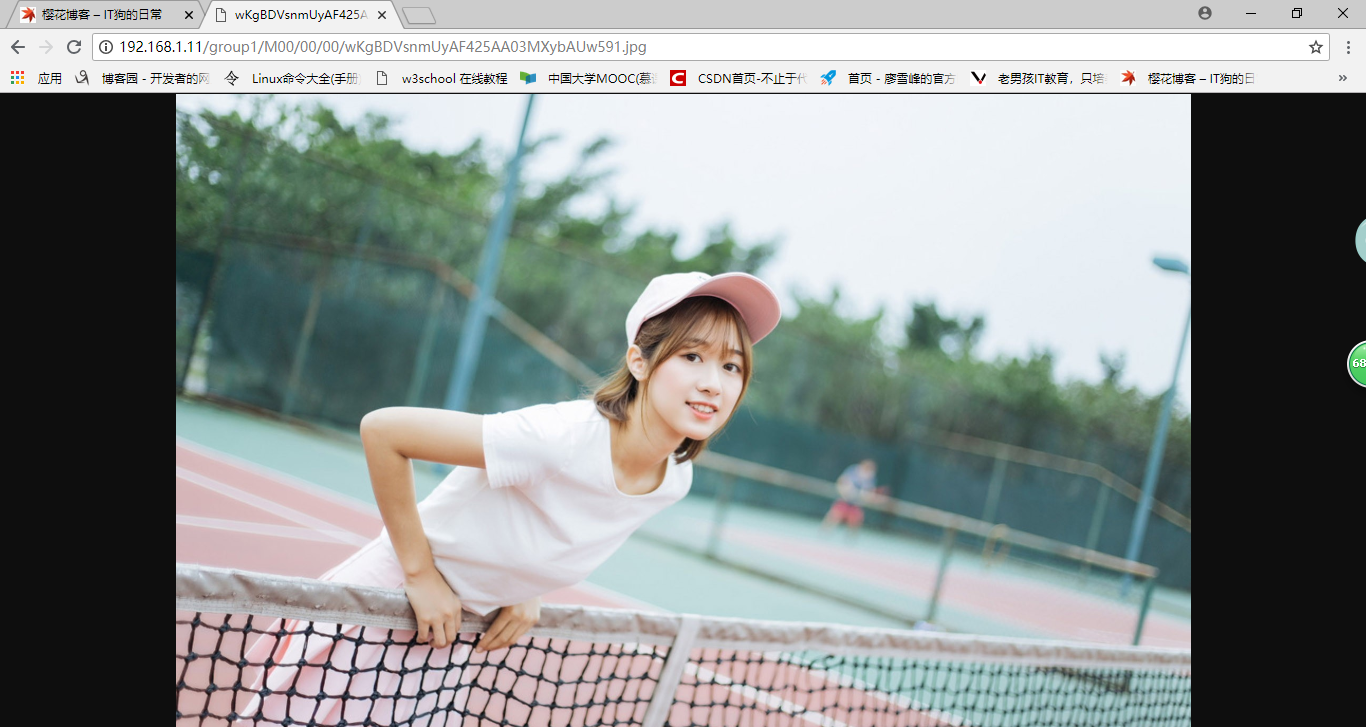

.jpg图片

.mp4视频