用到的软件:Hadoop-2.4.0、scala-2.10.4、spark-1.1.0

jdk我用的1.6,支持哪些jdk可以从发放文档中查找

一、预备工作

修改主机名字(名字比ip好使)、安装Orcal版的jdk、关闭防火墙、配好ssh,此外python系统已经自带不用二外安装

二、配置工作

首先配置Hadoop 这个可以参考官方网站电接点配置http://hadoop.apache.org/docs/r2.5.1/hadoop-project-dist/hadoop-common/SingleCluster.html

1、Hadoop2的配置文件在etc/hadoop目录下,需要修改的文件有core-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xml、hadoop-env.sh、slaves

- core-site.xml

<configuration> <property> <name>fs.defaultFS</name> <value>hdfs://master:9000</value> //我的主节点的机名就叫做master

</property> </configuration>

- hdfs-site.xml

<configuration> <property> <name>dfs.replication</name> <value>1</value> //副本数量,一般设置为3个,但在这里,因为机子有限我只设置了一个 </property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/home/zkpk/hadoop_name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/home/zkpk/hadoop_data</value>

</property> </configuration>

- mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value> //资源管理器指向yarn

</property>

</configuration>

- yarn-site.xml

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

- hadoop-env.sh

修改该文件中的JAVA_HOME

- slaves

直接在文件中输入如下

master

slave

详细的按需配置,可以到官方查看集群配置的方法到此Hadoop配置完成

初始化完成之后可以使用sbin/start-all.sh启动集群,使用sbin/stop-all.sh结束集群2、scala 安装解压包之后,配置下环境变量即可

3、安装spark

解压好文件之后,需要到conf文件夹下修改一下配置文件slaves、spark-env.sh

- slaves

在该文件中填写如下内容(是两台主机的名字)

master

slave

- spark-env.sh

export JAVA_HOME=/usr/java/latest

export SCALA_HOME=/opt/scala-2.10.4

export HADOOP_PREFIX=/opt/hadoop-2.4.0

export SPARK_MASTER_IP=master

export HADOOP_CONF_DIR=$HADOOP_PREFIX/etc/hadoop

export YARN_CONF_DIR=$HADOOP_PREFIX/etc/hadoop

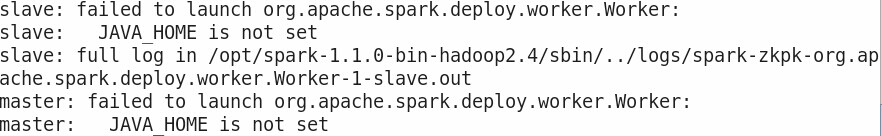

这里需要注意,有的时候这个spark-evn.sh不配置也不会出现问题,但有时候不配置就会出现如下问题

4、配置环境变量

使用命令 vi /etc/profile 注意是在root权限下才可以修改,当然也可以修改本地的环境便令 文件是主目录下的 .bash_profile

使环境变量生效使用命令 source /etc/profile 使配置文件生效

环境变量里的内容如下

export JAVA_HOME=/usr/java/latest

export SCALA_HOME=/opt/scala-2.10.4

export HADOOP_PREFIX=/opt/hadoop-2.4.0

export SPARK_HOME=/opt/spark-1.1.0-bin-hadoop2.4

export HADOOP_COMMON_LIB_NATIVE_DIR=${HADOOP_PREFIX}/lib/native

export HADOOP_OPTS="-Djava.library.path=$HADOOP_PREFIX/lib"

export HADOOP_CONF_DIR=$HADOOP_PREFIX/etc/hadoop export YARN_CONF_DIR=$HADOOP_PREFIX/etc/hadoop

export PATH=$PATH:$JAVA_HOME:$JAVA_HOME/bin:$HADOOP_PREFIX/bin:$SCALA_HOME/bin:$SPARK_HOME/bin

最后要记得将配好的Hadoop、Scale、Spark、profile文件复制到slave节点上