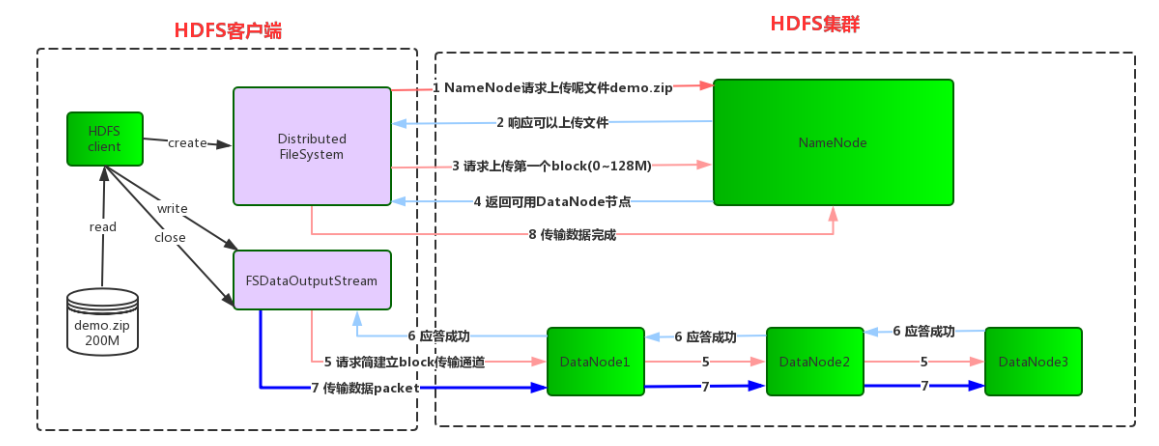

HDFS写数据流程

1.客户端通过Distributed FileSystem模块向NameNode请求上传文件,NameNode检查目标文件是否已经存在,父目录是否存在;

2.NameNode返回是否可以上传文件;

3.客户端请求一个block上传到指定的那个DataNode服务器上;

4.NameNode返回三个DataNode节点,分别为DN1,DN2,DN3;

5.客户端通过FSDataOutputStream模块请求DN1上传数据,DN1收到请求会继续调用DN2,然后DN2调用DN3,将这通信管道建立成功;

6.DN1,DN2,DN3逐级应答客户端;

7.客户端开始往DN1上传第一个block(从磁盘读取数据放到一个本地内存缓存),以packet为单位,DN1收到一个packet就会传给DN2,DN2传给DN3,DN1每传一个packet会放入一个应答队列等待应答;

8.当一个block传输完成之后,客户端再次请求NameNode上传第二个block的服务器;

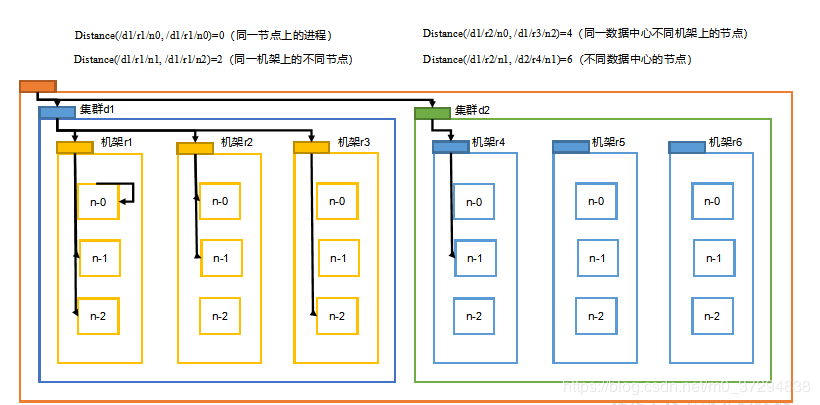

网络拓扑-节点距离计算

在HDFS写数据的过程中,NameNode会选择距离上传数据最近距离的DataNode接收数据;

节点距离:两个节点达到最近的共同祖先的距离总和;

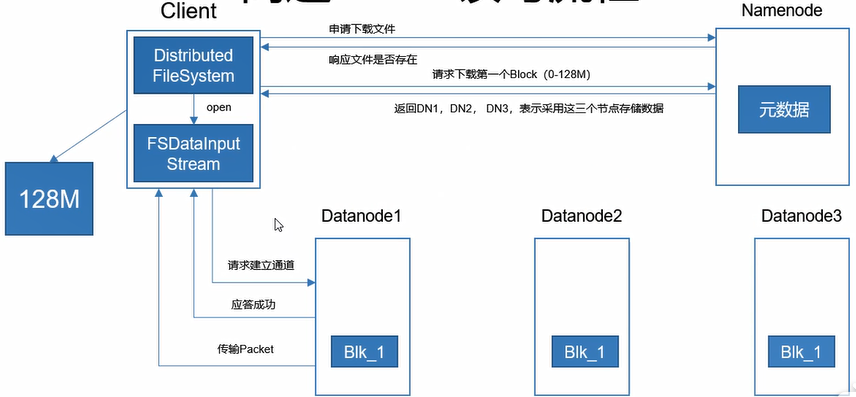

HDFS读数据流程

1.客户端通过Distributed FileSystem向NameNode请求下载文件,NameNode通过查询元数据,找到文件块所在的DataNode地址;

2.挑选一台DataNode服务器(就近原则,然后随机),请求读取数据;

3.DataNode开始传输给客户端(从磁盘里面读取数据输入流,以packet为单位);

4.客户端以packet为单位接收,先在本地缓存,然后写入目标文件;