第零章 三大数据结构

Spark 计算框架为了能够进行高并发和高吞吐的数据处理,封装了三大数据结构,用于处理不同的应用场景。三大数据结构分别是:

- RDD : 弹性分布式数据集

- 累加器:分布式共享只写变量

- 广播变量:分布式共享只读变量

简单的分布式计模型架构:

Driver将任务分发给多个Executora

Driver

import java.io.{ObjectOutputStream, OutputStream}

import java.net.Socket

object Driver {

def main(args: Array[String]): Unit = {

// 连接服务器

val client1 = new Socket("localhost", 9999)

val client2 = new Socket("localhost", 8888)

val task = new Task()

val out1: OutputStream = client1.getOutputStream

val objOut1 = new ObjectOutputStream(out1)

val subTask = new SubTask()

subTask.logic = task.logic

// 取两个数据

subTask.datas = task.datas.take(2)

objOut1.writeObject(subTask)

objOut1.flush()

objOut1.close()

client1.close()

val out2: OutputStream = client2.getOutputStream

val objOut2 = new ObjectOutputStream(out2)

val subTask1 = new SubTask()

subTask1.logic = task.logic

subTask1.datas = task.datas.takeRight(2)

objOut2.writeObject(subTask1)

objOut2.flush()

objOut2.close()

client2.close()

println("客户端数据发送完毕")

}

}

Executor

import java.io.{InputStream, ObjectInputStream}

import java.net.{ServerSocket, Socket}

object Executor {

def main(args: Array[String]): Unit = {

// 启动服务器,接收数据

val server = new ServerSocket(9999)

println("服务器启动,等待接收数据")

// 等待客户端的连接

val client: Socket = server.accept()

val in: InputStream = client.getInputStream

val objIn = new ObjectInputStream(in)

val task: SubTask = objIn.readObject().asInstanceOf[SubTask]

val ints: List[Int] = task.compute()

println("计算节点[9999]计算的结果为:" + ints)

objIn.close()

client.close()

server.close()

}

}

Executor2

import java.io.{InputStream, ObjectInputStream}

import java.net.{ServerSocket, Socket}

object Executor2 {

def main(args: Array[String]): Unit = {

// 启动服务器,接收数据

val server = new ServerSocket(8888)

println("服务器启动,等待接收数据")

// 等待客户端的连接

val client: Socket = server.accept()

val in: InputStream = client.getInputStream

val objIn = new ObjectInputStream(in)

val task: SubTask = objIn.readObject().asInstanceOf[SubTask]

val ints: List[Int] = task.compute()

println("计算节点[8888]计算的结果为:" + ints)

objIn.close()

client.close()

server.close()

}

}

Task

class Task extends Serializable {

val datas = List(1,2,3,4)

//val logic = ( num:Int )=>{ num * 2 }

val logic : (Int)=>Int = _ * 2

}

SubTask

// 特质(接口) 序列化

class SubTask extends Serializable {

var datas : List[Int] = _

var logic : (Int)=>Int = _

// 计算

def compute() = {

datas.map(logic)

}

}

第一章 RDD

RDD 在整个流程中主要用于将逻辑进行封装,并生成 Task 发送给Executor 节点执行计算,及RDD就是一种把数据和逻辑准备好一种结构。

1.1 什么是 RDD

说RDD是最小计算单元是因为,一般项目的逻辑计算都是相对复杂的,为了方便编码和以后的扩展,把复杂的逻辑拆分开来就形成了一个个RDD

回到之前wordcount例子中

// 创建 Spark 运行配置对象

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("WordCount")

// 创建 Spark 上下文环境对象(连接对象)

val sc : SparkContext = new SparkContext(sparkConf)

// 读取文件数据

val fileRDD: RDD[String] = sc.textFile("input/word.txt")

// 将文件中的数据进行分词

val wordRDD: RDD[String] = fileRDD.flatMap( _.split(" ") )

// 转换数据结构 word => (word, 1)

val word2OneRDD: RDD[(String, Int)] = wordRDD.map((_,1))

// 将转换结构后的数据按照相同的单词进行分组聚合

val word2CountRDD: RDD[(String, Int)] = word2OneRDD.reduceByKey(_+_)

// 将数据聚合结果采集到内存中

val word2Count: Array[(String, Int)] = word2CountRDD.collect()

// 打印结果

word2Count.foreach(println)

//关闭 Spark 连接

sc.stop()

一次map/atMap就是一个RDD

RDD的数据处理方式类似于IO流,也有装饰者设计模式

RDD的数据只有在调用collect方法时,才会真正执行业务逻辑操作。之前的封装全部都是功能的扩展

RDD是不保存数据的,但是IO可以临时保存一部分数据

RDD(Resilient Distributed Dataset)叫做弹性分布式数据集,是 Spark 中最基本的数据处理模型。代码中是一个抽象类,它代表一个弹性的、不可变、可分区、里面的元素可并行计算的集合。

弹性

- 存储的弹性:内存与磁盘的自动切换;

- 容错的弹性:数据丢失可以自动恢复;

- 计算的弹性:计算出错重试机制;

- 分片的弹性:可根据需要重新分片。

- 分布式:数据存储在大数据集群不同节点上

数据集:RDD 封装了计算逻辑,并不保存数据

数据抽象:RDD 是一个抽象类,需要子类具体实现

不可变:RDD 封装了计算逻辑,是不可以改变的,想要改变,只能产生新的RDD,在新的RDD 里面封装计算逻辑

可分区、并行计算

1.2 核心属性

* Internally, each RDD is characterized by five main properties:

*

* - A list of partitions 分区列表

* - A function for computing each split 分区计算函数

* - A list of dependencies on other RDDs RDD之间的依赖关系

* - Optionally, a Partitioner for key-value RDDs (e.g. to say that the RDD is hash-partitioned) 分区器

* - Optionally, a list of preferred locations to compute each split on (e.g. block locations for an HDFS file) 首选位置

分区列表

RDD 数据结构中存在分区列表,用于执行任务时并行计算,是实现分布式计算的重要属性。

/**

* Implemented by subclasses to return the set of partitions in this RDD. This method will only

* be called once, so it is safe to implement a time-consuming computation in it.

*

* The partitions in this array must satisfy the following property:

* `rdd.partitions.zipWithIndex.forall { case (partition, index) => partition.index == index }`

*/

protected def getPartitions: Array[Partition]

每个分区的计算逻辑

Spark 在计算时,是使用分区函数对每一个分区进行计算

/**

* :: DeveloperApi ::

* Implemented by subclasses to compute a given partition.

*/

@DeveloperApi

def compute(split: Partition, context: TaskContext): Iterator[T]

RDD 之间的依赖关系

RDD 是计算模型的封装,当需求中需要将多个计算模型进行组合时,就需要将多个 RDD 建立依赖关系

/**

* Implemented by subclasses to return how this RDD depends on parent RDDs. This method will only

* be called once, so it is safe to implement a time-consuming computation in it.

*/

protected def getDe pendencies: Seq[Dependency[_]] = deps

分区器(可选)

RDD 数据分区策略选择器

当数据为 KV 类型数据时,可以通过设定分区器自定义数据的分区

/**

* Optionally overridden by subclasses to specify placement preferences.

*/

protected def getPreferredLocations(split: Partition): Seq[String] = Nil

/** Optionally overridden by subclasses to specify how they are partitioned. */

@transient val partitioner: Option[Partitioner] = None

首选位置(可选)

首选位置及task任务优先选择分配的节点的位置

就近原则

计算数据时,可以根据计算节点的状态选择不同的节点位置进行计算

/**

* Optionally overridden by subclasses to specify placement preferences.

*/

protected def getPreferredLocations(split: Partition): Seq[String] = Nil

1.3 执行原理

从计算的角度来讲,数据处理过程中需要计算资源(内存 & CPU)和计算模型(逻辑)。执行时,需要将计算资源和计算模型进行协调和整合。

Spark 框架在执行时,先申请资源,然后将应用程序的数据处理逻辑分解成一个一个的计算任务。然后将任务发到已经分配资源的计算节点上, 按照指定的计算模型进行数据计算。最后得到计算结果。

RDD 是 Spark 框架中用于数据处理的核心模型,接下来我们看看,在 Yarn 环境中,RDD 的工作原理:

1)启动 Yarn 集群环境

2)Spark 通过申请资源创建调度节点和计算节点

3)Spark 框架根据需求将计算逻辑根据分区划分成不同的任务

4)调度节点将任务根据计算节点状态发送到对应的计算节点进行计算

从以上流程可以看出 RDD 在整个流程中主要用于将逻辑进行封装,并生成 Task 发送给Executor 节点执行计算,接下来我们就一起看看 Spark 框架中RDD 是具体是如何进行数据处理的。

1.4 基础编程

RDD 创建

在 Spark 中创建RDD 的创建方式可以分为四种:

1)从集合(内存)中创建 RDD

从集合中创建RDD,Spark 主要提供了两个方法:parallelize 和 makeRDD

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_RDD_Memory {

def main(args: Array[String]): Unit = {

// TODO 准备环境

// [*]表示当前系统有几核 ,模拟集合并行计算 直接写local表示只使用1核模拟计算

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("RDD")

val sc = new SparkContext(sparkConf)

// TODO 创建RDD

// 从内存中创建RDD,将内存中集合的数据作为处理的数据源

val seq = Seq[Int](1,2,3,4)

// parallelize : 并行

//val rdd: RDD[Int] = sc.parallelize(seq)

// makeRDD方法在底层实现时其实就是调用了rdd对象的parallelize方法。

// RDD的并行度 & 分区

// makeRDD方法可以传递第二个参数,这个参数表示分区的数量

// 第二个参数可以不传递的,那么makeRDD方法会使用默认值 : defaultParallelism(默认并行度)

// scheduler.conf.getInt("spark.default.parallelism", totalCores)

// spark在默认情况下,从配置对象中获取配置参数:spark.default.parallelism

// 如果获取不到,那么使用totalCores属性,这个属性取值为当前运行环境的最大可用核数

val rdd: RDD[Int] = sc.makeRDD(seq)

rdd.collect().foreach(println)

// TODO 关闭环境

sc.stop()

}

}

从底层代码实现来讲,makeRDD 方法其实就是parallelize 方法

2)从外部存储(文件)创建RDD

由外部存储系统的数据集创建RDD 包括:本地的文件系统,所有Hadoop 支持的数据集, 比如HDFS、HBase 等。

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark02_RDD_File {

def main(args: Array[String]): Unit = {

// TODO 准备环境

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("RDD")

val sc = new SparkContext(sparkConf)

// TODO 创建RDD

// 从文件中创建RDD,将文件中的数据作为处理的数据源

// path路径默认以当前环境的根路径为基准。可以写绝对路径,也可以写相对路径

//sc.textFile("D:\\mineworkspace\\idea\\classes\\atguigu-classes\\datas\\1.txt")

//val rdd: RDD[String] = sc.textFile("datas/1.txt")

// path路径可以是文件的具体路径,也可以目录名称

//val rdd = sc.textFile("datas")

// path路径还可以使用通配符 *

//val rdd = sc.textFile("datas/1*.txt")

// path还可以是分布式存储系统路径:HDFS

val rdd = sc.textFile("hdfs://linux1:8020/test.txt")

rdd.collect().foreach(println)

// TODO 关闭环境

sc.stop()

}

}

3)从其他 RDD 创建

主要是通过一个RDD 运算完后,再产生新的RDD。详情请参考后续章节

4)直接创建 RDD(new)

RDD 并行度与分区

默认情况下,Spark 可以将一个作业切分多个任务后,发送给 Executor 节点并行计算,而能够并行计算的任务数量我们称之为并行度。这个数量可以在构建RDD 时指定。记住,这里的并行执行的任务数量,并不是指的切分任务的数量,不要混淆了。

集合(内存)分区:

// RDD的并行度 & 分区

// makeRDD方法可以传递第二个参数,这个参数表示分区的数量

// 第二个参数可以不传递的,那么makeRDD方法会使用默认值 : defaultParallelism(默认并行度)

// scheduler.conf.getInt(“spark.default.parallelism”, totalCores)

// spark在默认情况下,从配置对象中获取配置参数:spark.default.parallelism

// 如果获取不到,那么使用totalCores属性,这个属性取值为当前运行环境的最大可用核数

val rdd = sc.makeRDD(List(1,2,3,4),2)//集合中的数据划分成2个分区

// val rdd = sc.makeRDD(List(1,2,3,4))//使用默认并行度,配置的使用配置的值,不配置的话使用系统cpu的核数

配置文件没有配置,RDD第二个参数也没有传递的话,使用系统CPU的核数作为分区数,我的电脑是8核16线程的,所以会有16个分区。

如果配置文件配置了并行度

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_RDD_Memory_Par {

def main(args: Array[String]): Unit = {

// TODO 准备环境

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("RDD")

sparkConf.set("spark.default.parallelism", "5")

val sc = new SparkContext(sparkConf)

// TODO 创建RDD

// RDD的并行度 & 分区

// makeRDD方法可以传递第二个参数,这个参数表示分区的数量

// 第二个参数可以不传递的,那么makeRDD方法会使用默认值 : defaultParallelism(默认并行度)

// scheduler.conf.getInt("spark.default.parallelism", totalCores)

// spark在默认情况下,从配置对象中获取配置参数:spark.default.parallelism

// 如果获取不到,那么使用totalCores属性,这个属性取值为当前运行环境的最大可用核数

//val rdd = sc.makeRDD(List(1,2,3,4),2)

val rdd = sc.makeRDD(List(1,2,3,4))

// 将处理的数据保存成分区文件

rdd.saveAsTextFile("output")

// TODO 关闭环境

sc.stop()

}

}

读取内存数据时,数据可以按照并行度的设定进行数据的分区操作,数据分区规则的

Spark 核心源码如下:

def positions(length: Long, numSlices: Int): Iterator[(Int, Int)] = {

(0 until numSlices).iterator.map { i =>

val start = ((i * length) / numSlices).toInt

val end = (((i + 1) * length) / numSlices).toInt

(start, end)

}

以数据个数 len为5 , 分区num为3为例

分区编号 0,1,2

数据 1,2,3,4,5

| 分区 | 范围 | 数据 |

|---|---|---|

| 0 | (0,1] | 1 |

| 1 | (1,3] | 2、3 |

| 2 | (3,5] | 4、5 |

读取文件数据时,数据是按照Hadoop 文件读取的规则进行切片分区,而切片规则和数据读取的规则有些差异,具体 Spark 核心源码如下

public InputSplit[] getSplits(JobConf job, int numSplits)

throws IOException {

long totalSize = 0; // compute total size

for (FileStatus file: files) { // check we have valid files

if (file.isDirectory()) {

throw new IOException("Not a file: "+ file.getPath());

}

totalSize += file.getLen();

}

long goalSize = totalSize / (numSplits == 0 ? 1 : numSplits);

long minSize = Math.max(job.getLong(org.apache.hadoop.mapreduce.lib.input.

FileInputFormat.SPLIT_MINSIZE, 1), minSplitSize);

...

for (FileStatus file: files) {

...

if (isSplitable(fs, path)) {

long blockSize = file.getBlockSize();

long splitSize = computeSplitSize(goalSize, minSize, blockSize);

...

}

protected long computeSplitSize(long goalSize, long minSize,

long blockSize) {

return Math.max(minSize, Math.min(goalSize, blockSize));

}

1.5 算子

算子 : Operator(操作)

RDD的方法和Scala集合对象的方法不一样

Scala集合对象的方法都是在同一个节点的内存中完成的。

RDD的方法可以将计算逻辑发送到Executor端(分布式节点)执行, 为了和Scala集合对象区分不同的处理效果,所以将RDD的方法称之为算子。

RDD的方法外部的操作都是在Driver端执行的,而方法内部的逻辑代码是在Executor端执行。

1.6 Lazy Loda 懒加载

概念:Spark 中的所有Transformation(转换)都是懒加载的,即Transformation 操作不会立即执行,而是先记录RDD 之间的转换关系,仅当Action(动作)触发时才会执行RDD 的转换操作并将计算结果返回给驱动程序

好处:这种懒加载的设计使Spark 能够更好的对任务进行优化,避免不必要的计算,从而使得Spark 运行更加合理高效。

第二章 RDD 转换算子

RDD 根据数据处理方式的不同将算子整体上分为 Value 类型、双 Value 类型和 Key-Value类型

按分区加载数据

2.1 Value 类型

map

函数签名

def map[U: ClassTag](f: T => U): RDD[U]

map(func):返回每个元素经过func 方法处理后所生成的新元素所组成的数据集合。这里输入的参数为一个数据对象,输出可以是另外一个数据对象,可以是tuple,可以是List 等任意类型对象。

map操作只能是来一个计算一个,出去一个

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - map

val rdd = sc.makeRDD(List(1,2,3,4))

// 1,2,3,4

// 2,4,6,8

// 转换函数

def mapFunction(num:Int): Int = {

num * 2

}

//val mapRDD: RDD[Int] = rdd.map(mapFunction)

// 使用匿名函数

//val mapRDD: RDD[Int] = rdd.map((num:Int)=>{num*2})

//使用至减原则

//如果函数体只有一行代码,可以省略花括号

//val mapRDD: RDD[Int] = rdd.map((num:Int)=>num*2)

//参数类型如果能够推断出来,那么可以省略

//val mapRDD: RDD[Int] = rdd.map((num)=>num*2)

//如果函数没有参数列表,那么小括号可以省略

//val mapRDD: RDD[Int] = rdd.map(num=>num*2)

//参数只出现过一次 并且按顺序出现 用_代替

val mapRDD: RDD[Int] = rdd.map(_*2)

mapRDD.collect().foreach(println)

sc.stop()

}

}

小功能:从服务器日志数据 apache.log 中获取用户请求 URL 资源路径

代码实现

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark02_RDD_Operator_Transform_Test {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - mapPartitions

val rdd = sc.makeRDD(List(1,2,3,4), 2)

// 【1,2】,【3,4】

// 【2】,【4】

val mpRDD = rdd.mapPartitions(

iter => {

List(iter.max).iterator

}

)

mpRDD.collect().foreach(println)

sc.stop()

}

}

执行顺序

-

rdd的计算一个分区内的数据是一个一个执行逻辑

只使用一个分区,只有前面一个数据全部的逻辑执行完毕后,才会执行下一个数据。

分区内数据的执行是有序的。 -

不同分区数据计算是无序的。

RDD所有算子转换操作转换后的数据分区不变,除分组之外

不因为算子操作后数据进去其他分区,提高计算效率。

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_RDD_Operator_Transform_Part {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - map

val rdd = sc.makeRDD(List(1,2,3,4),2)

// 【1,2】,【3,4】

rdd.saveAsTextFile("output")

val mapRDD = rdd.map(_*2)

// 【2,4】,【6,8】

mapRDD.saveAsTextFile("output1")

sc.stop()

}

}

mapValues

功能:对键值对每个value都应用一个函数,但是,key不会发生变化。

示例

val list = List("hadoop","spark","hive","spark")

val rdd = sc.parallelize(list)

val pairRdd = rdd.map(x => (x,1))

pairRdd.mapValues(_+1).collect.foreach(println)//对每个value进行+1

结果

(hadoop,2)

(spark,2)

(hive,2)

(spark,2)

mapPartitions

- map操作只能是来一个计算一个,出去一个,没有缓存的概念及来一批数据处理数据性能不高。

- mapPartitions是先拿到一个分区内的所有数据再做处理

- mapPartitions可以以分区为单位进行数据转换操作, 但是会将整个分区的数据加载到内存进行引用, 如果处理完的数据是不会被释放掉,存在对象的引用。 在内存较小,数据量较大的场合下,容易出现内存溢出。

- MapPartitions 算子需要传递一个迭代器,返回一个迭代器

函数签名

def mapPartitions[U: ClassTag](

f: Iterator[T] => Iterator[U],

preservesPartitioning: Boolean = false): RDD[U]

函数说明

将待处理的数据以分区为单位发送到计算节点进行处理,这里的处理是指可以进行任意的处理,哪怕是过滤数据。

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark02_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - mapPartitions

val rdd = sc.makeRDD(List(1,2,3,4), 2)

// mapPartitions : 可以以分区为单位进行数据转换操作

// 但是会将整个分区的数据加载到内存进行引用

// 如果处理完的数据是不会被释放掉,存在对象的引用。

// 在内存较小,数据量较大的场合下,容易出现内存溢出。

val mpRDD: RDD[Int] = rdd.mapPartitions(

iter => {

println(">>>>>>>>>>")

iter.map(_ * 2)

}

)

mpRDD.collect().foreach(println)

sc.stop()

}

}

map 和 mapPartitions 的区别

- 数据处理角度

Map 算子是分区内一个数据一个数据的执行,类似于串行操作。而 mapPartitions 算子是以分区为单位进行批处理操作。

- 功能的角度

Map 算子主要目的将数据源中的数据进行转换和改变。但是不会减少或增多数据。MapPartitions 算子需要传递一个迭代器,返回一个迭代器,没有要求的元素的个数保持不变, 所以可以增加或减少数据

- 性能的角度

Map 算子因为类似于串行操作,所以性能比较低,而是 mapPartitions 算子类似于批处理,所以性能较高。但是mapPartitions 算子会长时间占用内存,那么这样会导致内存可能不够用,出现内存溢出的错误。所以在内存有限的情况下,不推荐使用。使用 map 操作。完成比完美更重要。

mapPartitionsWithIndex

根据分区号选择计算哪个分区数据

函数签名

def mapPartitionsWithIndex[U: ClassTag]( f: (Int, Iterator[T]) => Iterator[U],

preservesPartitioning: Boolean = false): RDD[U]

函数说明

将待处理的数据以分区为单位发送到计算节点进行处理,这里的处理是指可以进行任意的处理,哪怕是过滤数据,在处理时同时可以获取当前分区索引。

val dataRDD1 = dataRDD.mapPartitionsWithIndex(

(index, datas) => {

datas.map(index, _)

} )

小功能:获取第二个数据分区的数据

import org.apache.spark.{SparkConf, SparkContext}

object Spark03_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - mapPartitions

val rdd = sc.makeRDD(List(1,2,3,4), 2)

// 【1,2】,【3,4】

val mpiRDD = rdd.mapPartitionsWithIndex(

(index, iter) => {

if ( index == 1 ) {

iter

} else {

Nil.iterator

}

}

)

mpiRDD.collect().foreach(println)

sc.stop()

}

}

查看数据在哪个分区

import org.apache.spark.{SparkConf, SparkContext}

object Spark03_RDD_Operator_Transform1 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - mapPartitions

val rdd = sc.makeRDD(List(1,2,3,4))

val mpiRDD = rdd.mapPartitionsWithIndex(

(index, iter) => {

// 1, 2, 3, 4

//(0,1)(2,2),(4,3),(6,4)

iter.map(

num => {

(index, num)

}

)

}

)

mpiRDD.collect().foreach(println)

sc.stop()

}

}

flatMap 扁平化映射

flatMap: 把一条数据拆分成一个一个个体使用

函数签名

def flatMap[U: ClassTag](f: T => TraversableOnce[U]): RDD[U]

函数说明

将处理的数据进行扁平化后再进行映射处理,所以算子也称之为扁平映射

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark04_RDD_Operator_Transform1 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - flatMap

val rdd: RDD[String] = sc.makeRDD(List(

"Hello Scala", "Hello Spark"

))

val flatRDD: RDD[String] = rdd.flatMap(

s => {

s.split(" ")

}

)

flatRDD.collect().foreach(println)

sc.stop()

}

}

小功能:将 List(List(1,2),3,List(4,5))进行扁平化操作

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark04_RDD_Operator_Transform2 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - flatMap

val rdd = sc.makeRDD(List(List(1,2),3,List(4,5)))

val flatRDD = rdd.flatMap(

data => {

data match {

// 如果是集合类型

case list:List[_] => list

// 如果不是集合 变成集合

case dat => List(dat)

}

}

)

flatRDD.collect().foreach(println)

sc.stop()

}

}

glom 聚合

glomg和flatMap的作用相反

- flatMap把一个拆成多个 list->int

- glomg把多个合成一个 int -> array

函数签名

def glom(): RDD[Array[T]]

函数说明

将同一个分区的数据直接转换为相同类型的内存数组进行处理,分区不变

val dataRDD = sparkContext.makeRDD(List( 1,2,3,4),1)

val dataRDD1:RDD[Array[Int]] = dataRDD.glom()

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark05_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - glom

val rdd : RDD[Int] = sc.makeRDD(List(1,2,3,4), 2)

// List => Int

// Int => Array

// 返回的是一个数组

val glomRDD: RDD[Array[Int]] = rdd.glom()

glomRDD.collect().foreach(data=> println(data.mkString(",")))

sc.stop()

}

}

小功能:计算所有分区最大值求和(分区内取最大值,分区间最大值求和)

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark05_RDD_Operator_Transform_Test {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - glom

val rdd : RDD[Int] = sc.makeRDD(List(1,2,3,4), 2)

// 【1,2】,【3,4】

// 【2】,【4】

// 【6】

val glomRDD: RDD[Array[Int]] = rdd.glom()

val maxRDD: RDD[Int] = glomRDD.map(

array => {

array.max

}

)

println(maxRDD.collect().sum)

sc.stop()

}

}

groupBy 分组

函数签名

def groupBy[K](f: T => K)(implicit kt: ClassTag[K]): RDD[(K, Iterable[T])]

函数说明

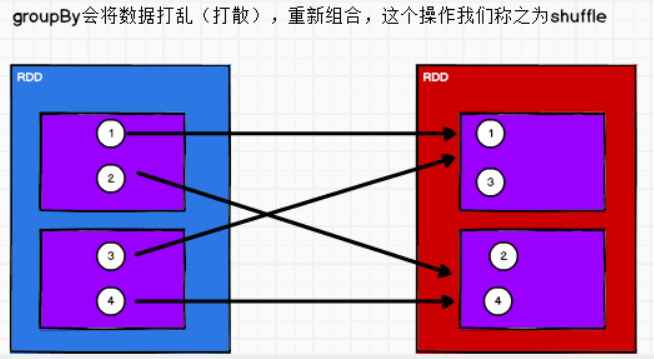

将数据根据指定的规则进行分组, 分区默认不变,但是数据会被打乱重新组合,我们将这样的操作称之为shuffle。极限情况下,数据可能被分在同一个分区中

一个组的数据在一个分区中,但是并不是说一个分区中只有一个组

奇偶分组

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark06_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - groupBy

val rdd : RDD[Int] = sc.makeRDD(List(1,2,3,4), 2)

// groupBy会将数据源中的每一个数据进行分组判断,根据返回的分组key进行分组

// 相同的key值的数据会放置在一个组中

def groupFunction(num:Int) = {

num % 2

}

val groupRDD: RDD[(Int, Iterable[Int])] = rdd.groupBy(groupFunction)

groupRDD.collect().foreach(println)

sc.stop()

}

}

运行结果

(0,CompactBuffer(2, 4))

(1,CompactBuffer(1, 3))

小功能:将 List("Hello", "hive", "hbase", "Hadoop")根据单词首写字母进行分组。

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark06_RDD_Operator_Transform1 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - groupBy

val rdd = sc.makeRDD(List("Hello", "Spark", "Scala", "Hadoop"), 2)

// 分组和分区没有必然的关系

val groupRDD = rdd.groupBy(_.charAt(0))

groupRDD.collect().foreach(println)

sc.stop()

}

}

运行结果

(H,CompactBuffer(Hello, Hadoop))

(S,CompactBuffer(Spark, Scala))

小功能:从服务器日志数据 apache.log 中获取每个时间段访问量。

import java.text.SimpleDateFormat

import java.util.Date

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark06_RDD_Operator_Transform_Test {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - groupBy

val rdd = sc.textFile("datas/apache.log")

val timeRDD: RDD[(String, Iterable[(String, Int)])] = rdd.map(

line => {

val datas = line.split(" ")

val time = datas(3)

//time.substring(0, )

val sdf = new SimpleDateFormat("dd/MM/yyyy:HH:mm:ss")

val date: Date = sdf.parse(time)

val sdf1 = new SimpleDateFormat("HH")

val hour: String = sdf1.format(date)

(hour, 1)

}

// tuple => tuple._1 至简原则

).groupBy(_._1)

timeRDD.map{

// 元组组成集合 模式匹配

case ( hour, iter ) => {

(hour, iter.size)

}

}.collect.foreach(println)

sc.stop()

}

}

filter 过滤

函数签名

def filter(f: T => Boolean): RDD[T]

函数说明

将数据根据指定的规则进行筛选过滤,符合规则的数据保留,不符合规则的数据丢弃。

当数据进行筛选过滤后,分区不变,但是分区内的数据可能不均衡,生产环境下,可能会出现数据倾斜。

val dataRDD = sparkContext.makeRDD(List(

1,2,3,4

),1)

val dataRDD1 = dataRDD.filter(_%2 == 0)

小功能:从服务器日志数据 apache.log 中获取 2015 年 5 月 17 日的请求路径

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark07_RDD_Operator_Transform_Test {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - filter

val rdd = sc.textFile("datas/apache.log")

rdd.filter(

line => {

val datas = line.split(" ")

val time = datas(3)

time.startsWith("17/05/2015")

}

).collect().foreach(println)

sc.stop()

}

}

sample 抽样

函数签名

def sample(

withReplacement: Boolean,

fraction: Double,

seed: Long = Utils.random.nextLong): RDD[T]

函数说明

根据指定的规则从数据集中抽取数据

val dataRDD = sparkContext.makeRDD(List(

1,2,3,4

),1)

// 抽取数据不放回(伯努利算法)

// 伯努利算法:又叫 0、1 分布。例如扔硬币,要么正面,要么反面。

// 具体实现:根据种子和随机算法算出一个数和第二个参数设置几率比较,小于第二个参数要,大于不

要

// 第一个参数:抽取的数据是否放回,false:不放回

// 第二个参数:抽取的几率,范围在[0,1]之间,0:全不取;1:全取;

// 第三个参数:随机数种子

val dataRDD1 = dataRDD.sample(false, 0.5)

// 抽取数据放回(泊松算法)

// 第一个参数:抽取的数据是否放回,true:放回;false:不放回

// 第二个参数:重复数据的几率,范围大于等于 0.表示每一个元素被期望抽取到的次数

// 第三个参数:随机数种子

val dataRDD2 = dataRDD.sample(true, 2)

思考一个问题:有啥用,抽奖吗?

import org.apache.spark.{SparkConf, SparkContext}

object Spark08_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - filter

val rdd = sc.makeRDD(List(1,2,3,4,5,6,7,8,9,10))

// sample算子需要传递三个参数

// 1. 第一个参数表示,抽取数据后是否将数据返回 true(放回),false(丢弃)

// 2. 第二个参数表示,

// 如果抽取不放回的场合:数据源中每条数据被抽取的概率,基准值的概念

// 如果抽取放回的场合:表示数据源中的每条数据被抽取的可能次数

// 3. 第三个参数表示,抽取数据时随机算法的种子

// 如果不传递第三个参数,那么使用的是当前系统时间

// println(rdd.sample(

// false,

// 0.4

// //1

// ).collect().mkString(","))

println(rdd.sample(

true,

2

//1

).collect().mkString(","))

sc.stop()

}

}

distinct 去重

函数签名

def distinct()(implicit ord: Ordering[T] = null): RDD[T]

def distinct(numPartitions: Int)(implicit ord: Ordering[T] = null): RDD[T]

函数说明

将数据集中重复的数据去重

val dataRDD = sparkContext.makeRDD(List(

1,2,3,4,1,2

),1)

val dataRDD1 = dataRDD.distinct()

val dataRDD2 = dataRDD.distinct(2)

思考一个问题:如果不用该算子,你有什么办法实现数据去重?

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark09_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - filter

val rdd = sc.makeRDD(List(1,2,3,4,1,2,3,4))

// map(x => (x, null)).reduceByKey((x, _) => x, numPartitions).map(_._1)

// (1, null),(2, null),(3, null),(4, null),(1, null),(2, null),(3, null),(4, null)

// (1, null)(1, null)(1, null)

// (null, null) => null

// (1, null) => 1

val rdd1: RDD[Int] = rdd.distinct()

rdd1.collect().foreach(println)

sc.stop()

}

}

coalesce 缩减分区

函数签名

def coalesce(numPartitions: Int, shuffle: Boolean = false, partitionCoalescer: Option[PartitionCoalescer] = Option.empty) (implicit ord: Ordering[T] = null) : RDD[T]s

函数说明

根据数据量缩减分区,用于大数据集过滤后,提高小数据集的执行效率

当 spark 程序中,存在过多的小任务的时候,可以通过 coalesce 方法,收缩合并分区,减少分区的个数,减小任务调度成本

val dataRDD = sparkContext.makeRDD(List(

1,2,3,4,1,2

),6)

val dataRDD1 = dataRDD.coalesce(2)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark10_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - filter

val rdd = sc.makeRDD(List(1,2,3,4,5,6), 3)

// coalesce方法默认情况下不会将分区的数据打乱重新组合

// 这种情况下的缩减分区可能会导致数据不均衡,出现数据倾斜

// 如果想要让数据均衡,可以进行shuffle处理

//val newRDD: RDD[Int] = rdd.coalesce(2)

val newRDD: RDD[Int] = rdd.coalesce(2,true)

newRDD.saveAsTextFile("output")

sc.stop()

}

}

coalesce 默认情况是缩减分区,不打乱原有数据的顺序,有可能导致缩减分区后数据不均衡, 如果想要让数据均衡,可以进行shuffle处理,参数 shuffle 的默认值为 false

思考一个问题:我想要扩大分区,怎么办?

repartition 增大分区

函数签名

def repartition(numPartitions: Int)(implicit ord: Ordering[T] = null): RDD[T]

函数说明

该操作内部其实执行的是 coalesce 操作,参数 shuffle 的默认值为 true。无论是将分区数多的RDD 转换为分区数少的RDD,还是将分区数少的 RDD 转换为分区数多的RDD,repartition 操作都可以完成,因为无论如何都会经 shuffle 过程。

val dataRDD = sparkContext.makeRDD(List(1,2,3,4,1,2),2)

val dataRDD1 = dataRDD.repartition(4)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark11_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - filter

val rdd = sc.makeRDD(List(1,2,3,4,5,6), 2)

// coalesce算子可以扩大分区的,但是如果不进行shuffle操作,是没有意义,不起作用。

// 所以如果想要实现扩大分区的效果,需要使用shuffle操作

// spark提供了一个简化的操作

// 缩减分区:coalesce,如果想要数据均衡,可以采用shuffle

// 扩大分区:repartition, 底层代码调用的就是coalesce,而且肯定采用shuffle

//val newRDD: RDD[Int] = rdd.coalesce(3, true)

val newRDD: RDD[Int] = rdd.repartition(3)

newRDD.saveAsTextFile("output")

sc.stop()

}

}

sortBy 根据指定规则排序

函数签名

def sortBy[K](

f: (T) => K,

ascending: Boolean = true,

numPartitions: Int = this.partitions.length)

(implicit ord: Ordering[K], ctag: ClassTag[K]): RDD[T]

函数说明

该操作用于排序数据。在排序之前,可以将数据通过 f 函数进行处理,之后按照 f 函数处理的结果进行排序,默认为升序排列。排序后新产生的 RDD 的分区数与原RDD 的分区数一致。中间存在 shuffle 的过程

val dataRDD = sparkContext.makeRDD(List(

1,2,3,4,1,2

),2)

//根据num排序

val dataRDD1 = dataRDD.sortBy(num=>num, false, 4)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark12_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - sortBy

val rdd = sc.makeRDD(List(6,2,4,5,3,1), 2)

val newRDD: RDD[Int] = rdd.sortBy(num=>num)

newRDD.saveAsTextFile("output")

sc.stop()

}

}

思考一个问题:coalesce 和 repartition 区别?

2.2 双 Value类型

双 Value 类型指的是两个数据源之间的关联操作

intersection union subtract 要求两个数据流的类型一致,zip可以不一致

- 交集,并集和差集要求两个数据源数据类型保持一致

- 拉链操作两个数据源的类型可以不一致,但要求两个数据源要求分区数量和每个分区中的数据要保持一致

intersection 交集

函数签名

def intersection(other: RDD[T]): RDD[T]

函数说明

对源RDD 和参数RDD 求交集后返回一个新的RDD

val dataRDD1 = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD2 = sparkContext.makeRDD(List(3,4,5,6))

val dataRDD = dataRDD1.intersection(dataRDD2)

union 交集

函数签名

def union(other: RDD[T]): RDD[T]

函数说明

对源RDD 和参数RDD 求并集后返回一个新的RDD

val dataRDD1 = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD2 = sparkContext.makeRDD(List(3,4,5,6))

val dataRDD = dataRDD1.union(dataRDD2)

与数学中的并集不同的是 相同的数据不会只保留一个,spark中的并集只是把两个数据源直接放在一起。

1,2,3,4,3,4,5,6

subtract 差集

函数签名

def subtract(other: RDD[T]): RDD[T]

函数说明

以一个 RDD 元素为主,去除两个 RDD 中重复元素,将其他元素保留下来。求差集

val dataRDD1 = sparkContext.makeRDD(List(1,2,3,4))

val dataRDD2 = sparkContext.makeRDD(List(3,4,5,6))

val dataRDD = dataRDD1.subtract(dataRDD2)

zip 拉链

两个数据源要求分区数量要保持一致

// Can only zip RDDs with same number of elements in each partition

两个数据源要求分区中数据数量保持一致

函数签名

def zip[U: ClassTag](other: RDD[U]): RDD[(T, U)]

函数说明

将两个 RDD 中的元素,以键值对的形式进行合并。其中,键值对中的Key 为第 1 个 RDD中的元素,Value 为第 2 个 RDD 中的相同位置的元素。

Spark中 拉链操作与scala中不同的是两个数据源要求分区中数据数量保持一致

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark13_RDD_Operator_Transform1 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

//scala 中的拉链操作,数据长度可以不一致

val ids = List[Long](1,2,3,4,5,6,7)

val ids1 = List[Long](2,3,4,5,6,7)

//ids.tail=(2,3,4,5,6,7)

val okflowIds: List[(Long, Long)] = ids.zip(ids1)

// TODO 算子 - 双Value类型

// Can't zip RDDs with unequal numbers of partitions: List(2, 4)

// 两个数据源要求分区数量要保持一致

// Can only zip RDDs with same number of elements in each partition

// 两个数据源要求分区中数据数量保持一致

val rdd1 = sc.makeRDD(List(1,2,3,4,5,6),2)

val rdd2 = sc.makeRDD(List(3,4,5,6),2)

// 运行报错

val rdd6: RDD[(Int, Int)] = rdd1.zip(rdd2)

println(rdd6.collect().mkString(","))

sc.stop()

}

}

交集+并集+差集+拉链

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark13_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - 双Value类型

// 交集,并集和差集要求两个数据源数据类型保持一致

// 拉链操作两个数据源的类型可以不一致

val rdd1 = sc.makeRDD(List(1,2,3,4))

val rdd2 = sc.makeRDD(List(3,4,5,6))

val rdd7 = sc.makeRDD(List("3","4","5","6"))

// 交集 : 【3,4】

val rdd3: RDD[Int] = rdd1.intersection(rdd2)

//val rdd8 = rdd1.intersection(rdd7)

println(rdd3.collect().mkString(","))

// 并集 : 【1,2,3,4,3,4,5,6】

val rdd4: RDD[Int] = rdd1.union(rdd2)

println(rdd4.collect().mkString(","))

// 差集 : 【1,2】

val rdd5: RDD[Int] = rdd1.subtract(rdd2)

println(rdd5.collect().mkString(","))

// 拉链 : 【1-3,2-4,3-5,4-6】

val rdd6: RDD[(Int, Int)] = rdd1.zip(rdd2)

val rdd8 = rdd1.zip(rdd7)

println(rdd6.collect().mkString(","))

sc.stop()

}

}

2.3 Key - Value 类型

要求数据流式(key, value)类型

partitionBy

实现改变数据所在分区的位置

函数签名

def partitionBy(partitioner: Partitioner): RDD[(K, V)]

函数说明

将数据按照指定Partitioner 重新进行分区。Spark 默认的分区器是HashPartitioner

val rdd: RDD[(Int, String)] =

sc.makeRDD(Array((1,"aaa"),(2,"bbb"),(3,"ccc")),3)

import org.apache.spark.HashPartitioner

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{HashPartitioner, SparkConf, SparkContext}

object Spark14_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(1,2,3,4),2)

val mapRDD:RDD[(Int, Int)] = rdd.map((_,1))

// RDD => PairRDDFunctions

// 隐式转换(二次编译)

// partitionBy根据指定的分区规则对数据进行重分区

val newRDD = mapRDD.partitionBy(new HashPartitioner(2))

newRDD.partitionBy(new HashPartitioner(2))

newRDD.saveAsTextFile("output")

sc.stop()

}

}

如果重分区的分区器和当前 RDD 的分区器一样(分区器的类型和分区的数量一样)怎么办?

直接返回RDD 不会创建新的RDD

Spark 还有其他分区器吗?

hash分区器和range(范围)分区器

reduceByKey

函数签名

def reduceByKey(func: (V, V) => V): RDD[(K, V)]

def reduceByKey(func: (V, V) => V, numPartitions: Int): RDD[(K, V)]

函数说明

可以将数据按照相同的Key 对Value 进行聚合

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = dataRDD1.reduceByKey(_+_)

val dataRDD3 = dataRDD1.reduceByKey(_+_, 2)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{HashPartitioner, SparkConf, SparkContext}

object Spark15_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(

("a", 1), ("a", 2), ("a", 3), ("b", 4)

))

// reduceByKey : 相同的key的数据进行value数据的聚合操作

// scala语言中一般的聚合操作都是两两聚合,spark基于scala开发的,所以它的聚合也是两两聚合

// 【1,2,3】

// 【3,3】

// 【6】

// reduceByKey中如果key的数据只有一个,是不会参与运算的。

val reduceRDD: RDD[(String, Int)] = rdd.reduceByKey( (x:Int, y:Int) => {

println(s"x = ${x}, y = ${y}")

x + y

} )

reduceRDD.collect().foreach(println)

sc.stop()

}

}

groupByKey

相同的key放的一个group

函数签名

def groupByKey(): RDD[(K, Iterable[V])]

def groupByKey(numPartitions: Int): RDD[(K, Iterable[V])]

def groupByKey(partitioner: Partitioner): RDD[(K, Iterable[V])]

函数说明

将数据源的数据根据 key 对 value 进行分组

val dataRDD1 =

sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = dataRDD1.groupByKey()

val dataRDD3 = dataRDD1.groupByKey(2)

val dataRDD4 = dataRDD1.groupByKey(new HashPartitioner(2))

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark16_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(

("a", 1), ("a", 2), ("a", 3), ("b", 4)

))

// groupByKey : 将数据源中的数据,相同key的数据分在一个组中,形成一个对偶元组

// 元组中的第一个元素就是key,

// 元组中的第二个元素就是相同key的value的集合

val groupRDD: RDD[(String, Iterable[Int])] = rdd.groupByKey()

groupRDD.collect().foreach(println)

val groupRDD1: RDD[(String, Iterable[(String, Int)])] = rdd.groupBy(_._1)

sc.stop()

}

}

思考一个问题:reduceByKey 和 groupByKey 的区别?

groupByky和reduceByKey的区别,reduceByKey有聚合(求相同keyd的数量)的作用,groupByky是把key放在一组

- groupByKey:

(a,CompactBuffer(1, 2, 3))

(b,CompactBuffer(4))

- reduceByKey:

(a,6)

(b,4

从 shuffle 的角度:reduceByKey 和 groupByKey 都存在 shuffle 的操作,但是reduceByKey 可以在 shuffle 前对分区内相同 key 的数据进行预聚合(combine)功能,这样会减少落盘的数据量,而groupByKey 只是进行分组,不存在数据量减少的问题,reduceByKey 性能比较高。

从功能的角度:reduceByKey 其实包含分组和聚合的功能。GroupByKey 只能分组,不能聚合,所以在分组聚合的场合下,推荐使用 reduceByKey,如果仅仅是分组而不需要聚合。那么还是只能使用groupByKey

aggregateByKey

函数签名

def aggregateByKey[U: ClassTag](zeroValue: U)(seqOp: (U, V) => U,

combOp: (U, U) => U): RDD[(K, U)]

函数说明

将数据根据不同的规则进行分区内计算和分区间计算

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = dataRDD1.aggregateByKey(0)(_+_,_+_)

取出每个分区内相同 key 的最大值然后分区间相加

// TODO : 取出每个分区内相同 key 的最大值然后分区间相加

// aggregateByKey 算子是函数柯里化,存在两个参数列表

// 1. 第一个参数列表中的参数表示初始值

// 2. 第二个参数列表中含有两个参数

// 2.1 第一个参数表示分区内的计算规则

// 2.2 第二个参数表示分区间的计算规则

val rdd =

sc.makeRDD(List(

("a",1),("a",2),("c",3),

("b",4),("c",5),("c",6)

),2)

// 0:("a",1),("a",2),("c",3) => (a,10)(c,10)

// => (a,10)(b,10)(c,20)

// 1:("b",4),("c",5),("c",6) => (b,10)(c,10)

val resultRDD =

rdd.aggregateByKey(10)(

(x, y) => math.max(x,y),

(x, y) => x + y

)

resultRDD.collect().foreach(println)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark17_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(

("a", 1), ("a", 2), ("a", 3), ("a", 4)

),2)

// (a,【1,2】), (a, 【3,4】)

// (a, 2), (a, 4)

// (a, 6)

// aggregateByKey存在函数柯里化,有两个参数列表

// 第一个参数列表,需要传递一个参数,表示为初始值

// 主要用于当碰见第一个key的时候,和value进行分区内计算

// 第二个参数列表需要传递2个参数

// 第一个参数表示分区内计算规则

// 第二个参数表示分区间计算规则

// math.min(x, y)

// math.max(x, y)

rdd.aggregateByKey(0)(

(x, y) => math.max(x, y),

(x, y) => x + y

).collect.foreach(println)

sc.stop()

}

}

reduceByKey和aggregateByKey的区别

reduceByKey:分区内和分区间的计算规则一样

aggregateByKey:分区内和分区间的计算规则不一样

思考一个问题:分区内计算规则和分区间计算规则相同怎么办?(WordCount)

aggregateByKey最终的返回数据结果应该和初始值的类型保持一致:

获取相同key的数据的平均值

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark18_RDD_Operator_Transform3 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(

("a", 1), ("a", 2), ("b", 3),

("b", 4), ("b", 5), ("a", 6)

),2)

// aggregateByKey最终的返回数据结果应该和初始值的类型保持一致

//val aggRDD: RDD[(String, String)] = rdd.aggregateByKey("")(_ + _, _ + _)

//aggRDD.collect.foreach(println)

// 获取相同key的数据的平均值 => (a, 3),(b, 4)

val newRDD : RDD[(String, (Int, Int))] = rdd.aggregateByKey( (0,0) )(

( t, v ) => {

(t._1 + v, t._2 + 1)

},

(t1, t2) => {

(t1._1 + t2._1, t1._2 + t2._2)

}

)

val resultRDD: RDD[(String, Int)] = newRDD.mapValues {

case (num, cnt) => {

num / cnt

}

}

resultRDD.collect().foreach(println)

sc.stop()

}

}

foldByKey

函数签名

def foldByKey(zeroValue: V)(func: (V, V) => V): RDD[(K, V)]

函数说明

当分区内计算规则和分区间计算规则相同时,aggregateByKey 就可以简化为foldByKey

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = dataRDD1.foldByKey(0)(_+_)

测试

import org.apache.spark.{SparkConf, SparkContext}

object Spark17_RDD_Operator_Transform2 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(

("a", 1), ("a", 2), ("b", 3),

("b", 4), ("b", 5), ("a", 6)

),2)

//rdd.aggregateByKey(0)(_+_, _+_).collect.foreach(println)

// 如果聚合计算时,分区内和分区间计算规则相同,spark提供了简化的方法

rdd.foldByKey(0)(_+_).collect.foreach(println)

sc.stop()

}

}

combineByKey

函数签名

def combineByKey[C]( createCombiner: V => C, mergeValue: (C, V) => C,

mergeCombiners: (C, C) => C): RDD[(K, C)]

函数说明

最通用的对key-value 型 rdd 进行聚集操作的聚集函数(aggregation function)。类似于aggregate(),combineByKey()允许用户返回值的类型与输入不一致。

val list: List[(String, Int)] = List(("a", 88), ("b", 95), ("a", 91), ("b", 93),

("a", 95), ("b", 98))

val input: RDD[(String, Int)] = sc.makeRDD(list, 2)

val combineRdd: RDD[(String, (Int, Int))] = input.combineByKey(

(_, 1),

(acc: (Int, Int), v) => (acc._1 + v, acc._2 + 1),

(acc1: (Int, Int), acc2: (Int, Int)) => (acc1._1 + acc2._1, acc1._2 + acc2._2)

)

reduceByKey、foldByKey、aggregateByKey、combineByKey 的区别?

- reduceByKey: 相同 key 的第一个数据不进行任何计算,分区内和分区间计算规则相同

- FoldByKey: 相同 key 的第一个数据和初始值进行分区内计算,分区内和分区间计算规则相同

- AggregateByKey:相同 key 的第一个数据和初始值进行分区内计算,分区内和分区间计算规则可以不相同

- CombineByKey:当计算时,发现数据结构不满足要求时,可以让第一个数据转换结构。分区内和分区间计算规则不相同。

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark20_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd = sc.makeRDD(List(

("a", 1), ("a", 2), ("b", 3),

("b", 4), ("b", 5), ("a", 6)

),2)

/*

reduceByKey:

combineByKeyWithClassTag[V](

(v: V) => v, // 第一个值不会参与计算

func, // 分区内计算规则

func, // 分区间计算规则

)

aggregateByKey :

combineByKeyWithClassTag[U](

(v: V) => cleanedSeqOp(createZero(), v), // 初始值和第一个key的value值进行的分区内数据操作

cleanedSeqOp, // 分区内计算规则

combOp, // 分区间计算规则

)

foldByKey:

combineByKeyWithClassTag[V](

(v: V) => cleanedFunc(createZero(), v), // 初始值和第一个key的value值进行的分区内数据操作

cleanedFunc, // 分区内计算规则

cleanedFunc, // 分区间计算规则

)

combineByKey :

combineByKeyWithClassTag(

createCombiner, // 相同key的第一条数据进行的处理函数

mergeValue, // 表示分区内数据的处理函数

mergeCombiners, // 表示分区间数据的处理函数

)

*/

rdd.reduceByKey(_+_) // wordcount

rdd.aggregateByKey(0)(_+_, _+_) // wordcount

rdd.foldByKey(0)(_+_) // wordcount

rdd.combineByKey(v=>v,(x:Int,y)=>x+y,(x:Int,y:Int)=>x+y) // wordcount

sc.stop()

}

}

sorByKey

函数签名

def sortByKey(ascending: Boolean = true, numPartitions: Int = self.partitions.length): RDD[(K, V)]

函数说明

在一个(K,V)的 RDD 上调用,K 必须实现 Ordered 接口(特质),返回一个按照 key 进行排序的

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3))) val dataRDD2 = dataRDD1.foldByKey(0)(_+_)

join

相当于sql表的内连接

函数签名

def join[W](other: RDD[(K, W)]): RDD[(K, (V, W))]

函数说明

在类型为(K,V)和(K,W)的RDD 上调用,返回一个相同 key 对应的所有元素连接在一起的(K,(V,W))的RDD

val rdd: RDD[(Int, String)] = sc.makeRDD(Array((1, "a"), (2, "b"), (3, "c")))

val rdd1: RDD[(Int, Int)] = sc.makeRDD(Array((1, 4), (2, 5), (3, 6))) rdd.join(rdd1).collect().foreach(println)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark21_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd1 = sc.makeRDD(List(

("a", 1), ("a", 2), ("c", 3)

))

val rdd2 = sc.makeRDD(List(

("a", 5), ("c", 6),("a", 4)

))

// join : 两个不同数据源的数据,相同的key的value会连接在一起,形成元组

// 如果两个数据源中key没有匹配上,那么数据不会出现在结果中

// 如果两个数据源中key有多个相同的,会依次匹配,可能会出现笛卡尔乘积,数据量会几何性增长,会导致性能降低。

val joinRDD: RDD[(String, (Int, Int))] = rdd1.join(rdd2)

joinRDD.collect().foreach(println)

sc.stop()

}

}

如果两个数据源中key没有匹配上,那么数据不会出现在结果中

val rdd1 = sc.makeRDD(List(

("a", 1), ("b", 2), ("c", 3)

))

val rdd2 = sc.makeRDD(List(

("a", 5), ("c", 6),("d", 4)

))

// join :

// 如果两个数据源中key没有匹配上,那么数据不会出现在结果中

val joinRDD: RDD[(String, (Int, Int))] = rdd1.join(rdd2)

结果

(a,(1,5))

(c,(3,6))

如果两个数据源中key有多个相同的,会依次匹配,可能会出现笛卡尔乘积,数据量会几何性增长,会导致性能降低。

val rdd1 = sc.makeRDD(List(

("a", 1), ("a", 2), ("c", 3)

))

val rdd2 = sc.makeRDD(List(

("a", 5), ("c", 6),("a", 4)

))

// 如果两个数据源中key有多个相同的,会依次匹配,可能会出现笛卡尔乘积,数据量会几何性增长,会导致性能降低。

val joinRDD: RDD[(String, (Int, Int))] = rdd1.join(rdd2)

结果

(a,(1,5))

(a,(1,4))

(a,(2,5))

(a,(2,4))

(c,(3,6))

leftOuterJoin

相当于sql表的外连接,即以一条数据流为主

函数签名

def leftOuterJoin[W](other: RDD[(K, W)]): RDD[(K, (V, Option[W]))]

函数说明

类似于 SQL 语句的左外连接

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val dataRDD2 = sparkContext.makeRDD(List(("a",1),("b",2),("c",3)))

val rdd: RDD[(String, (Int, Option[Int]))] = dataRDD1.leftOuterJoin(dataRDD2)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark22_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd1 = sc.makeRDD(List(

("a", 1), ("b", 2)//, ("c", 3)

))

val rdd2 = sc.makeRDD(List(

("a", 4), ("b", 5),("c", 6)

))

val leftJoinRDD = rdd1.leftOuterJoin(rdd2)

//val rightJoinRDD = rdd1.rightOuterJoin(rdd2)

leftJoinRDD.collect().foreach(println)

//rightJoinRDD.collect().foreach(println)

sc.stop()

}

}

运行结果

(a,(1,Some(4)))

(b,(2,Some(5)))

(c,(3,None))

右外连接

val rdd1 = sc.makeRDD(List(

("a", 1), ("b", 2)//, ("c", 3)

))

val rdd2 = sc.makeRDD(List(

("a", 4), ("b", 5),("c", 6)

))

// val leftJoinRDD = rdd1.leftOuterJoin(rdd2)

val rightJoinRDD = rdd1.rightOuterJoin(rdd2)

rightJoinRDD.collect().foreach(println)

结果

(a,(Some(1),4))

(b,(Some(2),5))

(c,(None,6))

cogroup

函数签名

def cogroup[W](other: RDD[(K, W)]): RDD[(K, (Iterable[V], Iterable[W]))]

函数说明

在类型为(K,V)和(K,W)的RDD 上调用,返回一个(K,(Iterable

val dataRDD1 = sparkContext.makeRDD(List(("a",1),("a",2),("c",3)))

val dataRDD2 = sparkContext.makeRDD(List(("a",1),("c",2),("c",3)))

val value: RDD[(String, (Iterable[Int], Iterable[Int]))] =

dataRDD1.cogroup(dataRDD2)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark23_RDD_Operator_Transform {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 算子 - (Key - Value类型)

val rdd1 = sc.makeRDD(List(

("a", 1), ("b", 2)//, ("c", 3)

))

val rdd2 = sc.makeRDD(List(

("a", 4), ("b", 5),("c", 6),("c", 7)

))

// cogroup : connect + group (分组,连接)

val cgRDD: RDD[(String, (Iterable[Int], Iterable[Int]))] = rdd1.cogroup(rdd2)

cgRDD.collect().foreach(println)

sc.stop()

}

}

即使数据没有也会对其统计,所cogroup不要求两个流中必须存在相同的key

(a,(CompactBuffer(1),CompactBuffer(4)))

(b,(CompactBuffer(2),CompactBuffer(5)))

(c,(CompactBuffer(),CompactBuffer(6, 7)))

2.4 案例实操

1)数据准备

agent.log:时间戳,省份,城市,用户,广告,中间字段使用空格分隔。

2)需求描述

统计出每一个省份每个广告被点击数量排行的 Top3

3)需求分析

4)功能实现

数据agent.log

1516609143867 6 7 64 16

1516609143869 9 4 75 18

1516609143869 1 7 87 12

1516609143869 2 8 92 9

1516609143869 6 7 84 24

1516609143869 1 8 95 5

1516609143869 8 1 90 29

1516609143869 3 3 36 16

1516609143869 3 3 54 22

1516609143869 7 6 33 5

1516609143869 8 2 91 27

1516609143869 0 5 66 5

1516609143869 1 3 33 6

1516609143869 6 2 97 21

1516609143869 5 2 95 24

1516609143869 8 9 73 11

1516609143869 4 8 62 15

1516609143869 5 5 40 23

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark24_RDD_Req {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("Operator")

val sc = new SparkContext(sparkConf)

// TODO 案例实操

// 1. 获取原始数据:时间戳,省份,城市,用户,广告

val dataRDD = sc.textFile("datas/agent.log")

// 2. 将原始数据进行结构的转换。方便统计

// 时间戳,省份,城市,用户,广告

// =>

// ( ( 省份,广告 ), 1 )

val mapRDD = dataRDD.map(

line => {

val datas = line.split(" ")

(( datas(1), datas(4) ), 1)

}

)

// 3. 将转换结构后的数据,进行分组聚合

// ( ( 省份,广告 ), 1 ) => ( ( 省份,广告 ), sum )

val reduceRDD: RDD[((String, String), Int)] = mapRDD.reduceByKey(_+_)

// 4. 将聚合的结果进行结构的转换

// ( ( 省份,广告 ), sum ) => ( 省份, ( 广告, sum ) )

val newMapRDD = reduceRDD.map{

case ( (prv, ad), sum ) => {

(prv, (ad, sum))

}

}

// 5. 将转换结构后的数据根据省份进行分组

// ( 省份, 【( 广告A, sumA ),( 广告B, sumB )】 )

val groupRDD: RDD[(String, Iterable[(String, Int)])] = newMapRDD.groupByKey()

// 6. 将分组后的数据组内排序(降序),取前3名

val resultRDD = groupRDD.mapValues(

iter => {

iter.toList.sortBy(_._2)(Ordering.Int.reverse).take(3)

}

)

// 7. 采集数据打印在控制台

resultRDD.collect().foreach(println)

sc.stop()

}

}

第三章 RDD 行动算子

所谓的行动算子,其实就是触发作业(Job)执行的方法

底层代码调用的是环境对象的runJob方法

底层代码中会创建ActiveJob,并提交执行。

reduce

函数签名

def reduce(f: (T, T) => T): T

函数说明

聚集 RDD 中的所有元素,先聚合分区内数据,再聚合分区间数据

val rdd: RDD[Int] = sc.makeRDD(List(1,2,3,4))

// 聚合数据

val reduceResult: Int = rdd.reduce(_+_)

collect

函数签名

def collect(): Array[T]

函数说明

在驱动程序中,以数组 Array 的形式返回数据集的所有元素

val rdd: RDD[Int] = sc.makeRDD(List(1,2,3,4))

// 收集数据到 Driver

rdd.collect().foreach(println)

count

函数签名

def count(): Long

函数说明

返回 RDD 中元素的个数

val rdd: RDD[Int] = sc.makeRDD(List(1,2,3,4))

// 返回 RDD 中元素的个数

val countResult: Long = rdd.count()

first

函数签名

def first(): T

函数说明

返回 RDD 中的第一个元素

val rdd: RDD[Int] = sc.makeRDD(List(1,2,3,4))

// 返回 RDD 中元素的个数

val firstResult: Int = rdd.first()

println(firstResult)

take

函数签名

def take(num: Int): Array[T]

函数说明

返回一个由 RDD 的前 n 个元素组成的数组

val rdd: RDD[Int] = sc.makeRDD(List(1,2,3,4))

// 返回 RDD 中元素的个数

val takeResult: Array[Int] = rdd.take(2)

println(takeResult.mkString(","))

takeOrdered

函数签名

def takeOrdered(num: Int)(implicit ord: Ordering[T]): Array[T]

函数说明

返回该 RDD 排序后的前 n 个元素组成的数组

val rdd: RDD[Int] = sc.makeRDD(List(1,3,2,4))

// 返回 RDD 中元素的个数

val result: Array[Int] = rdd.takeOrdered(2)

aggregate

函数签名

def aggregate[U: ClassTag](zeroValue: U)(seqOp: (U, T) => U, combOp: (U, U) => U): U

函数说明

分区的数据通过初始值和分区内的数据进行聚合,然后再和初始值进行分区间的数据聚合

val rdd: RDD[Int] = sc.makeRDD(List(1, 2, 3, 4), 8)

// 将该 RDD 所有元素相加得到结果

//val result: Int = rdd.aggregate(0)(_ + _, _ + _)

val result: Int = rdd.aggregate(10)(_ + _, _ + _)

fold

函数签名

def fold(zeroValue: T)(op: (T, T) => T): T

函数说明

折叠操作,aggregate 的简化版操作

val rdd: RDD[Int] = sc.makeRDD(List(1, 2, 3, 4))

val foldResult: Int = rdd.fold(0)(_+_)

countByKey

函数签名

def countByKey(): Map[K, Long]

函数说明

统计每种 key 的个数

val rdd: RDD[(Int, String)] = sc.makeRDD(List((1, "a"), (1, "a"), (1, "a"), (2, "b"), (3, "c"), (3, "c")))

// 统计每种 key 的个数

val result: collection.Map[Int, Long] = rdd.countByKey()

save 相关算子

函数签名

def saveAsTextFile(path: String): Unit

def saveAsObjectFile(path: String): Unit

def saveAsSequenceFile(

path: String,

codec: Option[Class[_ <: CompressionCodec]] = None): Unit

函数说明

将数据保存到不同格式的文件中

// 保存成 Text 文件

rdd.saveAsTextFile("output")

// 序列化成对象保存到文件

rdd.saveAsObjectFile("output1")

// 保存成 Sequencefile 文件

rdd.map((_,1)).saveAsSequenceFile("output2")

foreach

函数签名

def foreach(f: T => Unit): Unit = withScope {

val cleanF = sc.clean(f)

sc.runJob(this, (iter: Iterator[T]) => iter.foreach(cleanF))

}

函数说明

分布式遍历 RDD 中的每一个元素,调用指定函数

val rdd: RDD[Int] = sc.makeRDD(List(1,2,3,4))

// 收集后打印

rdd.map(num=>num).collect().foreach(println)

println("****************")

// 分布式打印

rdd.foreach(println)

第四章 RDD 序列化

4.1 闭包检查

从计算的角度, 算子以外的代码都是在 Driver 端执行, 算子里面的代码都是在 Executor端执行。那么在 scala 的函数式编程中,就会导致算子内经常会用到算子外的数据,这样就形成了闭包的效果,如果使用的算子外的数据无法序列化,就意味着无法传值给 Executor端执行,就会发生错误,所以需要在执行任务计算前,检测闭包内的对象是否可以进行序列化,这个操作我们称之为闭包检测。Scala2.12 版本后闭包编译方式发生了改变

4.2 序列化方法和属性

从计算的角度, 算子以外的代码都是在 Driver 端执行, 算子里面的代码都是在 Executor端执行,看如下代码:

object serializable02_function {

def main(args: Array[String]): Unit = {

//1.创建 SparkConf 并设置 App 名称

val conf: SparkConf = new

SparkConf().setAppName("SparkCoreTest").setMaster("local[*]")

//2.创建 SparkContext,该对象是提交 Spark App 的入口

val sc: SparkContext = new SparkContext(conf)

//3.创建一个 RDD

val rdd: RDD[String] = sc.makeRDD(Array("hello world", "hello spark",

"hive", "atguigu"))

//3.1 创建一个 Search 对象

val search = new Search("hello")

//3.2 函数传递,打印:ERROR Task not serializable

search.getMatch1(rdd).collect().foreach(println)

//3.3 属性传递,打印:ERROR Task not serializable

search.getMatch2(rdd).collect().foreach(println)

//4.关闭连接

sc.stop()

}

}

class Search(query:String) extends Serializable {

def isMatch(s: String): Boolean = {

s.contains(query)

}

// 函数序列化案例

def getMatch1 (rdd: RDD[String]): RDD[String] = {

//rdd.filter(this.isMatch)

rdd.filter(isMatch)

}

// 属性序列化案例

def getMatch2(rdd: RDD[String]): RDD[String] = {

//rdd.filter(x => x.contains(this.query))

rdd.filter(x => x.contains(query))

//val q = query

//rdd.filter(x => x.contains(q))

}

}

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_RDD_Serial {

def main(args: Array[String]): Unit = {

val sparConf = new SparkConf().setMaster("local").setAppName("WordCount")

val sc = new SparkContext(sparConf)

val rdd: RDD[String] = sc.makeRDD(Array("hello world", "hello spark", "hive", "atguigu"))

val search = new Search("h")

//search.getMatch1(rdd).collect().foreach(println)

search.getMatch2(rdd).collect().foreach(println)

sc.stop()

}

// 查询对象

// 类的构造参数其实是类的属性, 构造参数需要进行闭包检测,其实就等同于类进行闭包检测

class Search(query:String){

def isMatch(s: String): Boolean = {

s.contains(this.query)

}

// 函数序列化案例

def getMatch1 (rdd: RDD[String]): RDD[String] = {

rdd.filter(isMatch)

}

// 属性序列化案例

def getMatch2(rdd: RDD[String]): RDD[String] = {

val s = query

rdd.filter(x => x.contains(s))

}

}

}

4.3 Kryo 序列化框架

参考地址: https://github.com/EsotericSoftware/kryo

Java 的序列化能够序列化任何的类。但是比较重(字节多),序列化后,对象的提交也比较大。Spark 出于性能的考虑,Spark2.0 开始支持另外一种 Kryo 序列化机制。Kryo 速度是 Serializable 的 10 倍。当 RDD 在 Shuffle 数据的时候,简单数据类型、数组和字符串类型已经在 Spark 内部使用 Kryo 来序列化。

注意:即使使用 Kryo 序列化,也要继承 Serializable 接口。

object serializable_Kryo {

def main(args: Array[String]): Unit = {

val conf: SparkConf = new SparkConf()

.setAppName("SerDemo")

.setMaster("local[*]")

// 替换默认的序列化机制

.set("spark.serializer", "org.apache.spark.serializer.KryoSerializer")

// 注册需要使用 kryo 序列化的自定义类

.registerKryoClasses(Array(classOf[Searcher]))

val sc = new SparkContext(conf)

val rdd: RDD[String] = sc.makeRDD(Array("hello world", "hello atguigu", "atguigu", "hahah"), 2)

val searcher = new Searcher("hello")

val result: RDD[String] = searcher.getMatchedRDD1(rdd)

result.collect.foreach(println)

}

}

case class Searcher(val query: String) {

def isMatch(s: String) = {

s.contains(query)

}

def getMatchedRDD1(rdd: RDD[String]) = {

rdd.filter(isMatch)

}

}

D 依赖关系

5.1 RDD 血缘关系

RDD 只支持粗粒度转换,即在大量记录上执行的单个操作。将创建 RDD 的一系列 Lineage(血统)记录下来,以便恢复丢失的分区。RDD 的 Lineage 会记录 RDD 的元数据信息和转换行为,当该 RDD 的部分分区数据丢失时,它可以根据这些信息来重新运算和恢复丢失的数据分区。

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.spark.rdd.RDD

object Spark01_RDD_Dep {

def main(args: Array[String]): Unit = {

val sparConf = new SparkConf().setMaster("local").setAppName("WordCount")

val sc = new SparkContext(sparConf)

val lines: RDD[String] = sc.textFile("datas/word.txt")

println(lines.toDebugString)

println("*************************")

val words: RDD[String] = lines.flatMap(_.split(" "))

println(words.toDebugString)

println("*************************")

val wordToOne = words.map(word=>(word,1))

println(wordToOne.toDebugString)

println("*************************")

val wordToSum: RDD[(String, Int)] = wordToOne.reduceByKey(_+_)

println(wordToSum.toDebugString)

println("*************************")

val array: Array[(String, Int)] = wordToSum.collect()

array.foreach(println)

sc.stop()

}

}

这里所谓的依赖关系,其实就是两个相邻 RDD 之间的关系

val sc: SparkContext = new SparkContext(conf)

val fileRDD: RDD[String] = sc.textFile("input/1.txt")

println(fileRDD.dependencies)

println("----------------------")

val wordRDD: RDD[String] = fileRDD.flatMap(_.split(" "))

println(wordRDD.dependencies)

println("----------------------")

val mapRDD: RDD[(String, Int)] = wordRDD.map((_,1))

println(mapRDD.dependencies)

println("----------------------")

val resultRDD: RDD[(String, Int)] = mapRDD.reduceByKey(_+_)

println(resultRDD.dependencies)

resultRDD.collect()

5.2 RDD 窄依赖(一对一)

窄依赖表示每一个父(上游)RDD 的 Partition 最多被子(下游)RDD 的一个 Partition 使用,窄依赖我们形象的比喻为独生子女。

class OneToOneDependency[T](rdd: RDD[T]) extends NarrowDependency[T](rdd)

5.3 RDD 宽依赖(一对多)

宽依赖表示同一个父(上游)RDD 的 Partition 被多个子(下游)RDD 的 Partition 依赖,会引起 Shuffle,总结:宽依赖我们形象的比喻为多生。

窄依赖和宽依赖的区别

class ShuffleDependency[K: ClassTag, V: ClassTag, C: ClassTag](

@transient private val _rdd: RDD[_ <: Product2[K, V]],

val partitioner: Partitioner,

val serializer: Serializer = SparkEnv.get.serializer,

val keyOrdering: Option[Ordering[K]] = None,

val aggregator: Option[Aggregator[K, V, C]] = None,

val mapSideCombine: Boolean = false)

extends Dependency[Product2[K, V]]

5.4 RDD 阶段划分

依赖关系oneToOne不需要划分阶段

依赖关系一对多(shuffle)需要划分阶段

DAG(Directed Acyclic Graph)有向无环图是由点和线组成的拓扑图形,该图形具有方向,不会闭环。例如,DAG 记录了 RDD 的转换过程和任务的阶段。

RDD 阶段划分源码

try {

// New stage creation may throw an exception if, for example, jobs are run on

a

// HadoopRDD whose underlying HDFS files have been deleted.

finalStage = createResultStage(finalRDD, func, partitions, jobId, callSite)

} catch {

case e: Exception =>

logWarning("Creating new stage failed due to exception - job: " + jobId, e)

listener.jobFailed(e)

return

}

……

private def createResultStage(

rdd: RDD[_],

func: (TaskContext, Iterator[_]) => _,

partitions: Array[Int],

jobId: Int,

callSite: CallSite): ResultStage = {

val parents = getOrCreateParentStages(rdd, jobId)

val id = nextStageId.getAndIncrement()

val stage = new ResultStage(id, rdd, func, partitions, parents, jobId, callSite)

stageIdToStage(id) = stage

updateJobIdStageIdMaps(jobId, stage)

stage

}

……

private def getOrCreateParentStages(rdd: RDD[_], firstJobId: Int): List[Stage]

= {

getShuffleDependencies(rdd).map { shuffleDep =>

getOrCreateShuffleMapStage(shuffleDep, firstJobId)

}.toList

}

……

private[scheduler] def getShuffleDependencies(

rdd: RDD[_]): HashSet[ShuffleDependency[_, _, _]] = {

val parents = new HashSet[ShuffleDependency[_, _, _]]

val visited = new HashSet[RDD[_]]

val waitingForVisit = new Stack[RDD[_]]

waitingForVisit.push(rdd)

while (waitingForVisit.nonEmpty) {

val toVisit = waitingForVisit.pop()

if (!visited(toVisit)) {

visited += toVisit

toVisit.dependencies.foreach {

case shuffleDep: ShuffleDependency[_, _, _] =>

parents += shuffleDep

case dependency =>

waitingForVisit.push(dependency.rdd)

}

} }

parents

}

5.5 RDD 任务划分

RDD 任务切分中间分为:Application、Job、Stage 和 Task

- Application:初始化一个 SparkContext 即生成一个 Application;

- Job:一个 Action 算子就会生成一个 Job;

- Stage:Stage 等于宽依赖(ShuffleDependency)的个数加 1;

- Task:一个 Stage 阶段中,最后一个 RDD 的分区个数就是 Task 的个数。

注意:Application->Job->Stage->Task 每一层都是 1 对 n 的关系。

第六章 RDD 持久化

6.1 Cache 缓存

RDD 通过 Cache 或者 Persist 方法将前面的计算结果缓存,默认情况下会把数据以缓存在 JVM 的堆内存中。但是并不是这两个方法被调用时立即缓存,而是触发后面的 action 算子时,该 RDD 将会被缓存在计算节点的内存中,并供后面重用。

// cache 操作会增加血缘关系,不改变原有的血缘关系

println(wordToOneRdd.toDebugString)

// 数据缓存。

wordToOneRdd.cache()

// 可以更改存储级别

//mapRdd.persist(StorageLevel.MEMORY_AND_DISK_2)

cache(内存中) :

- 将数据临时存储在内存中进行数据重用

- 会在血缘关系中添加新的依赖。一旦出现问题,可以重头读取数据

persist(临时存储在磁盘) :

将数据临时存储在磁盘文件中进行数据重用

涉及到磁盘IO,性能较低,但是数据安全

- 如果作业执行完毕,临时保存的数据文件就会丢失

- 会在血缘关系中添加新的依赖。一旦出现问题,可以重头读取数据

存储级别

object StorageLevel {

val NONE = new StorageLevel(false, false, false, false)

val DISK_ONLY = new StorageLevel(true, false, false, false)

val DISK_ONLY_2 = new StorageLevel(true, false, false, false, 2)

val MEMORY_ONLY = new StorageLevel(false, true, false, true)

val MEMORY_ONLY_2 = new StorageLevel(false, true, false, true, 2)

val MEMORY_ONLY_SER = new StorageLevel(false, true, false, false)

val MEMORY_ONLY_SER_2 = new StorageLevel(false, true, false, false, 2)

val MEMORY_AND_DISK = new StorageLevel(true, true, false, true)

val MEMORY_AND_DISK_2 = new StorageLevel(true, true, false, true, 2)

val MEMORY_AND_DISK_SER = new StorageLevel(true, true, false, false)

val MEMORY_AND_DISK_SER_2 = new StorageLevel(true, true, false, false, 2)

val OFF_HEAP = new StorageLevel(true, true, true, false, 1)

持久化原则:

缓存有可能丢失,或者存储于内存的数据由于内存不足而被删除,RDD 的缓存容错机制保证了即使缓存丢失也能保证计算的正确执行。通过基于 RDD 的一系列转换,丢失的数据会被重算,由于 RDD 的各个 Partition 是相对独立的,因此只需要计算丢失的部分即可,并不需要重算全部 Partition。

Spark 会自动对一些 Shuffle 操作的中间数据做持久化操作(比如:reduceByKey)。这样做的目的是为了当一个节点 Shuffle 失败了避免重新计算整个输入。但是,在实际使用的时候,如果想重用数据,仍然建议调用 persist 或 cache。

6.2 CheckPoint 检查点

所谓的检查点其实就是通过将 RDD 中间结果写入磁盘

由于血缘依赖过长会造成容错成本过高,这样就不如在中间阶段做检查点容错,如果检查点之后有节点出现问题,可以从检查点开始重做血缘,减少了开销。

对 RDD 进行 checkpoint 操作并不会马上被执行,必须执行 Action 操作才能触发。

// 设置检查点路径

sc.setCheckpointDir("./checkpoint1")

// 创建一个 RDD,读取指定位置文件:hello atguigu atguigu

val lineRdd: RDD[String] = sc.textFile("input/1.txt")

// 业务逻辑

val wordRdd: RDD[String] = lineRdd.flatMap(line => line.split(" "))

val wordToOneRdd: RDD[(String, Long)] = wordRdd.map {

word => {

(word, System.currentTimeMillis())

} }

// 增加缓存,避免再重新跑一个 job 做 checkpoint

wordToOneRdd.cache()

// 数据检查点:针对 wordToOneRdd 做检查点计算

wordToOneRdd.checkpoint()

// 触发执行逻辑

wordToOneRdd.collect().foreach(println)

测试

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext}

object Spark06_RDD_Persist {

def main(args: Array[String]): Unit = {

// cache : 将数据临时存储在内存中进行数据重用

// 会在血缘关系中添加新的依赖。一旦,出现问题,可以重头读取数据

// persist : 将数据临时存储在磁盘文件中进行数据重用

// 涉及到磁盘IO,性能较低,但是数据安全

// 如果作业执行完毕,临时保存的数据文件就会丢失

// checkpoint : 将数据长久地保存在磁盘文件中进行数据重用

// 涉及到磁盘IO,性能较低,但是数据安全

// 为了保证数据安全,所以一般情况下,会独立执行作业

// 为了能够提高效率,一般情况下,是需要和cache联合使用

// 执行过程中,会切断血缘关系。重新建立新的血缘关系

// checkpoint等同于改变数据源

val sparConf = new SparkConf().setMaster("local").setAppName("Persist")

val sc = new SparkContext(sparConf)

sc.setCheckpointDir("cp")

val list = List("Hello Scala", "Hello Spark")

val rdd = sc.makeRDD(list)

val flatRDD = rdd.flatMap(_.split(" "))

val mapRDD = flatRDD.map(word=>{

(word,1)

})

//mapRDD.cache()

mapRDD.checkpoint()

println(mapRDD.toDebugString)

val reduceRDD: RDD[(String, Int)] = mapRDD.reduceByKey(_+_)

reduceRDD.collect().foreach(println)

println("**************************************")

println(mapRDD.toDebugString)

sc.stop()

}

}

6.3 缓存和检查点区别

1)Cache 缓存只是将数据保存起来,不切断血缘依赖。Checkpoint 检查点切断血缘依赖。

2)Cache 缓存的数据通常存储在磁盘、内存等地方,可靠性低。Checkpoint 的数据通常存储在 HDFS 等容错、高可用的文件系统,可靠性高。

3)建议对 checkpoint()的 RDD 使用 Cache 缓存,这样 checkpoint 的 job 只需从 Cache 缓存中读取数据即可,否则需要再从头计算一次 RDD。

第七章 RDD 分区器

Spark 目前支持 Hash 分区和 Range 分区,和用户自定义分区。Hash 分区为当前的默认分区。分区器直接决定了 RDD 中分区的个数、RDD 中每条数据经过 Shuffle 后进入哪个分区,进而决定了 Reduce 的个数。

- 只有 Key-Value 类型的 RDD 才有分区器,非 Key-Value 类型的 RDD 分区的值是 None

- 每个 RDD 的分区 ID 范围:0 ~ (numPartitions - 1),决定这个值是属于那个分区的。

7.1 Hash分区和Range分区

HashPartitioner:对于给定的 key,计算其 hashCode,并除以分区个数取余

class HashPartitioner(partitions: Int) extends Partitioner {

require(partitions >= 0, s"Number of partitions ($partitions) cannot be negative.")

def numPartitions: Int = partitions

def getPartition(key: Any): Int = key match {

case null => 0

case _ => Utils.nonNegativeMod(key.hashCode, numPartitions)

}

override def equals(other: Any): Boolean = other match {

case h: HashPartitioner =>

h.numPartitions == numPartitions

case _ =>

false

}

override def hashCode: Int = numPartitions

}

RangePartitioner:将一定范围内的数据映射到一个分区中,尽量保证每个分区数据均匀,而且分区间有序

class RangePartitioner[K : Ordering : ClassTag, V](partitions: Int, rdd: RDD[_ <: Product2[K, V]], private var ascending: Boolean = true) extends Partitioner {

// We allow partitions = 0, which happens when sorting an empty RDD under the default settings.

require(partitions >= 0, s"Number of partitions cannot be negative but found $partitions.")

private var ordering = implicitly[Ordering[K]]

// An array of upper bounds for the first (partitions - 1) partitions

private var rangeBounds: Array[K] = {

...

}

def numPartitions: Int = rangeBounds.length + 1

private var binarySearch: ((Array[K], K) => Int) = CollectionsUtils.makeBinarySearch[K]

def getPartition(key: Any): Int = {

val k = key.asInstanceOf[K]

var partition = 0

if (rangeBounds.length <= 128) {

// If we have less than 128 partitions naive search

while (partition < rangeBounds.length && ordering.gt(k,

rangeBounds(partition))) {

partition += 1

}

} else {

// Determine which binary search method to use only once.

partition = binarySearch(rangeBounds, k)

// binarySearch either returns the match location or -[insertion point]-1

if (partition < 0) {

partition = -partition-1

}

if (partition > rangeBounds.length) {

partition = rangeBounds.length

}

}

if (ascending) {

partition

} else {

rangeBounds.length - partition

}

}

override def equals(other: Any): Boolean = other match {

...

}

override def hashCode(): Int = {

...

}

@throws(classOf[IOException])

private def writeObject(out: ObjectOutputStream): Unit =

Utils.tryOrIOException {

...

}

@throws(classOf[IOException])

private def readObject(in: ObjectInputStream): Unit = Utils.tryOrIOException

{

...

}

}

7.2 分区测试

import org.apache.spark.rdd.RDD

import org.apache.spark._

object SparkPartitioner {

def main(args: Array[String]): Unit = {

//1:初始化SparkContext

val conf=new SparkConf().setAppName("partitioner").setMaster("local")

val sc=new SparkContext(conf)

val list = List("1","2","3","4","5","6");

//2:初始数据到RDD,执行map计算,构造(key,value)数据1->(1,value_1)

val rdd = sc.parallelize(list).map(x=>(x,"value_"+x))

rdd.foreachPartition(t => {

val id = TaskContext.get.partitionId

println("base partitionNum:" + id)

t.foreach( data => {

println(data)

})

})

//3:并对数据进行HashPartitioner分区

rdd.partitionBy(new HashPartitioner(3)).foreachPartition(t => {

val id = TaskContext.get.partitionId

println("HashPartitioner partitionNum:" + id)

t.foreach( data => {

println(data)

})

})

//4:并对数据进行RangePartitioner分区

rdd.partitionBy(new RangePartitioner(3,rdd,true,3)).foreachPartition(t => {

val id = TaskContext.get.partitionId

println("RangePartitioner partitionNum:" + id)

t.foreach( data => {

println(data)

})

})

//4:停止SparkContext

sc.stop()

}

}

7.3 自定义分区

import org.apache.spark.rdd.RDD

import org.apache.spark.{Partitioner, SparkConf, SparkContext, TaskContext}

class SelfPartitioner(numParts:Int) extends Partitioner {

//覆盖分区数

override def numPartitions: Int = numParts

//覆盖分区号获取函数

override def getPartition(key: Any): Int = {

//以"-"分割数据,将前缀相同的数据放在一个分区

val prex = key.toString.split("-").apply(0)

val code = (prex.hashCode % numPartitions)

if (code < 0) {

code + numPartitions

} else {

code

}

}

}

object SparkSelfPartitioner {

def main(args: Array[String]): Unit = {

//1:初始化SparkContext

val conf=new SparkConf().setAppName("partitioner").setMaster("local")

val sc=new SparkContext(conf)

var list = List("beijing-1","beijing-2","beijing-3","shanghai-1","shanghai-2","tianjing-1","tianjing-2");

//2:初始数据到RDD

val rdd: RDD[String] = sc.parallelize(list)

rdd.cache()

rdd.persist()

//3:执行map计算,使用自定义分区,将key中前缀相同的数据分配在同一个分区中计算

// beijing-1 ->(beijing-1,1)

//rdd.map((_,1)).partitionBy(new SelfPartitioner(3)).foreachPartition(t => {

rdd.map((_,1)).partitionBy(new SelfPartitioner(3)).foreachPartition(t => {

val id = TaskContext.get.partitionId

println("partitionNum:" + id)

t.foreach( data => {

println(data)

})

})

//4:停止SparkContext

sc.stop()

}

}

第八章 RDD 文件读取与保存

Spark 的数据读取及数据保存可以从两个维度来作区分:文件格式以及文件系统。

- 文件格式分为:text 文件、csv 文件、sequence 文件以及 Object 文件;

- 文件系统分为:本地文件系统、HDFS、HBASE 以及数据库。

8.1 text 文件

// 读取输入文件 可以设置分区数

val inputRDD: RDD[String] = sc.textFile("input/1.txt",2)

// 保存数据

inputRDD.saveAsTextFile("output")

8.2 sequence 文件

SequenceFile 文件是 Hadoop 用来存储二进制形式的 key-value 对而设计的一种平面文件(Flat File)。在 SparkContext 中,可以调用 sequenceFilekeyClass, valueClass。

// 保存数据为 SequenceFile

dataRDD.saveAsSequenceFile("output")

// 读取 SequenceFile 文件

sc.sequenceFile[Int,Int]("output").collect().foreach(println)

8.3 object 对象文件

对象文件是将对象序列化后保存的文件,采用 Java 的序列化机制。可以通过 objectFileT: ClassTag函数接收一个路径,读取对象文件,返回对应的 RDD,也可以通过调用saveAsObjectFile()实现对对象文件的输出。因为是序列化所以要指定类型。

// 保存数据

dataRDD.saveAsObjectFile("output")

// 读取数据

sc.objectFile[Int]("output").collect().foreach(println)

读取

package com.atguigu.bigdata.spark.core.rdd.io

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_RDD_IO_Load {

def main(args: Array[String]): Unit = {

val sparConf = new SparkConf().setMaster("local").setAppName("WordCount")

val sc = new SparkContext(sparConf)

val rdd = sc.textFile("output1")

println(rdd.collect().mkString(","))

val rdd1 = sc.objectFile[(String, Int)]("output2")

println(rdd1.collect().mkString(","))

val rdd2 = sc.sequenceFile[String, Int]("output3")

println(rdd2.collect().mkString(","))

sc.stop()

}

}

保存

package com.atguigu.bigdata.spark.core.rdd.io

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_RDD_IO_Save {

def main(args: Array[String]): Unit = {

val sparConf = new SparkConf().setMaster("local").setAppName("WordCount")

val sc = new SparkContext(sparConf)

val rdd = sc.makeRDD(

List(

("a", 1),

("b", 2),

("c", 3)

)

)

rdd.saveAsTextFile("output1")

rdd.saveAsObjectFile("output2")

rdd.saveAsSequenceFile("output3")

sc.stop()

}

}

第九章 累加器

分布式共享只写变量

9.1 实现原理

累加器用来把 Executor 端变量信息聚合到 Driver 端。在 Driver 程序中定义的变量,在Executor 端的每个 Task 都会得到这个变量的一份新的副本,每个 task 更新这些副本的值后,

传回 Driver 端进行 merge。

9.2 基础编程

系统累加器

import org.apache.spark.{SparkConf, SparkContext}

object Spark01_Acc {

def main(args: Array[String]): Unit = {

val sparConf = new SparkConf().setMaster("local").setAppName("Acc")

val sc = new SparkContext(sparConf)

val rdd = sc.makeRDD(List(1,2,3,4))

// reduce : 分区内计算,分区间计算

//val i: Int = rdd.reduce(_+_)

//println(i)

var sum = 0

rdd.foreach(

num => {

sum += num

}

)

println("sum = " + sum)

sc.stop()

}

}

Spark提供的累加器

val rdd = sc.makeRDD(List(1,2,3,4,5))

// 声明累加器

var sum = sc.longAccumulator("sum");

rdd.foreach(

num => {

// 使用累加器

sum.add(num)

} )

// 获取累加器的值

println("sum = " + sum.value)

测试

import org.apache.spark.{SparkConf, SparkContext}

object Spark02_Acc {

def main(args: Array[String]): Unit = {

val sparConf = new SparkConf().setMaster("local").setAppName("Acc")

val sc = new SparkContext(sparConf)