学习机器学习有一段时间了,却连这个最基本的理论问题都没弄懂,这里我简单的阐述一下。

比如这里我有L个度量值集合{X1, X2, X3, ... XL};

特征选择:从已有的L个度量值中按照一定的标准选择m(m<L)个子集,{X1, X2, X3,... Xm};这m个度量值就是作为降维后的特征。

特征提取:使这L个度量值通过某种变换H(*), 产生新的m(m<L)个子集,{X1, X2, X3,... Xm}。新的m个子集,就是进行特征提取后降维的特征。

下面用一个通俗的例子进行说明:

例:特征选择与特征提取的区别:对一个条形和圆进行识别。

解:[法1]

① 特征提取:测量三个结构特征

(a) 周长

(b) 面积

(c)两个互相垂直的内径比

分析: (c)是具有分类能力的特征,故选(c),

扔掉(a) 、 (b) 。

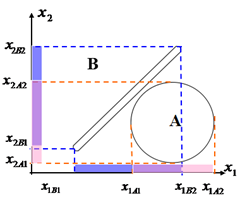

[法2]:① 特征提取取:测量物体向两个坐标轴的投影

值,则A、B各有2个值域区间。可以看出,两个物体的投影有重叠, 直接使用投影值无法将两者区分开。

② 特征选择:将坐标系按逆时针方向做一旋转变化,或物体按顺时针方向变,并适当平移等。根据物体在 轴上投影的坐标值的正负可区分两个物体。