Redis知识网络

作者:运维君莫笑

链接:https://www.zhihu.com/question/470465324/answer/2006650219

Redis为什么这么快?

-

根据官方数据。官方的基准程序测试,Redis 的 QPS 可以达到约 100000(每秒请求数)

-

基于内存实现 。Redis 是基于内存的数据库,不论读写操作都是在内存上完成的,跟磁盘数据库相比,完全吊打磁盘的速度。

-

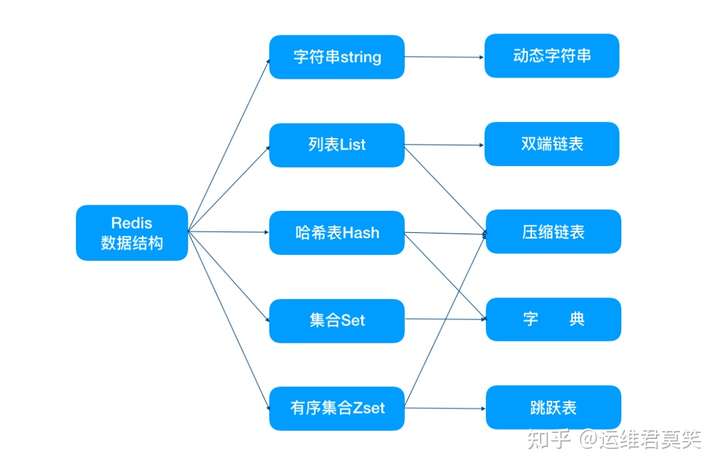

高效的数据结构。MySQL为了提高检索效率用的是B+树数据结构。而Redis提供5种数据类型String、List、Hash、Set、SortedSet。

String:存储数字的话,采用int类型的编码,如果是非数字的话,采用 raw 编码;

1、简单动态字符串

这个名词可能你不熟悉,换成 SDS肯定就知道了。 这是用来处理字符串的。了解 C 语言的都知道,它是有处理字符串方法的。而 Redis 就是 C 语言实现的,那为什么还要重复造轮子?我们从以下几点来看:

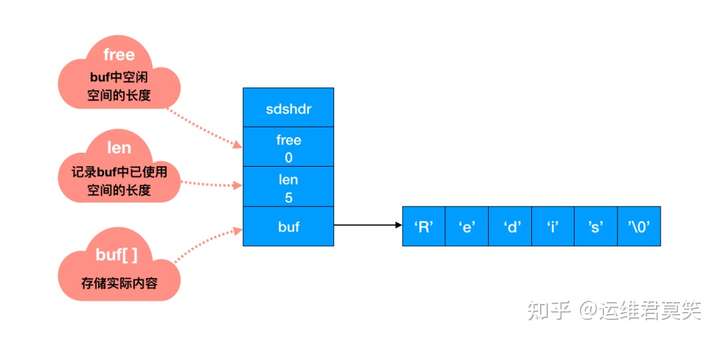

(1)字符串长度处理

这个图是字符串在 C 语言中的存储方式,想要获取 「Redis」的长度,需要从头开始遍历,直到遇到 '0' 为止。

Redis 中怎么操作呢?用一个 len 字段记录当前字符串的长度。想要获取长度只需要获取 len 字段即可。你看,差距不言自明。前者遍历的时间复杂度为 O(n),Redis 中 O(1) 就能拿到,速度明显提升。

(2)内存重新分配

C 语言中涉及到修改字符串的时候会重新分配内存。修改地越频繁,内存分配也就越频繁。而内存分配是会消耗性能的,那么性能下降在所难免。

而 Redis 中会涉及到字符串频繁的修改操作,这种内存分配方式显然就不适合了。于是 SDS 实现了两种优化策略:

- 空间预分配

对 SDS 修改及空间扩充时,除了分配所必须的空间外,还会额外分配未使用的空间。

具体分配规则是这样的:SDS 修改后,len 长度小于 1M,那么将会额外分配与 len 相同长度的未使用空间。如果修改后长度大于 1M,那么将分配1M的使用空间。

- 惰性空间释放

当然,有空间分配对应的就有空间释放。

SDS 缩短时,并不会回收多余的内存空间,而是使用 free 字段将多出来的空间记录下来。如果后续有变更操作,直接使用 free 中记录的空间,减少了内存的分配。

(3)二进制安全

你已经知道了 Redis 可以存储各种数据类型,那么二进制数据肯定也不例外。但二进制数据并不是规则的字符串格式,可能会包含一些特殊的字符,比如 '0' 等。

前面我们提到过,C 中字符串遇到 '0'会结束,那 '0' 之后的数据就读取不上了。但在 SDS 中,是根据 len 长度来判断字符串结束的。

看,二进制安全的问题就解决了。

List:字符串长度及元素个数小于一定范围使用 ziplist 编码,任意条件不满足,则转化为 linkedlist 编码;

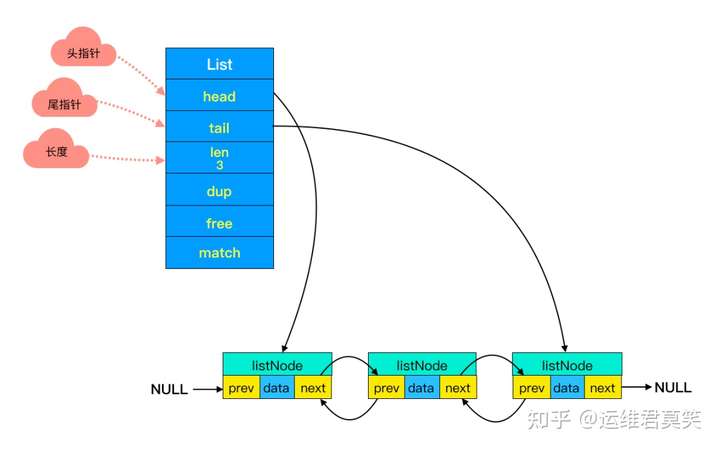

列表 List 更多是被当作队列或栈来使用的。队列和栈的特性一个先进先出,一个先进后出。双端链表很好的支持了这些特性。

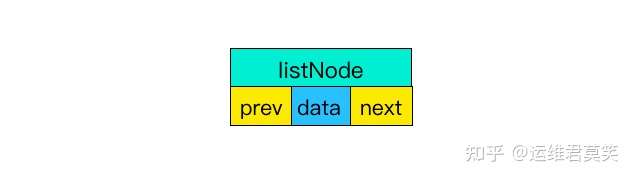

(1)前后节点

链表里每个节点都带有两个指针,prev 指向前节点,next 指向后节点。这样在 时间复杂度为 O(1)内就能获取到前后节点。

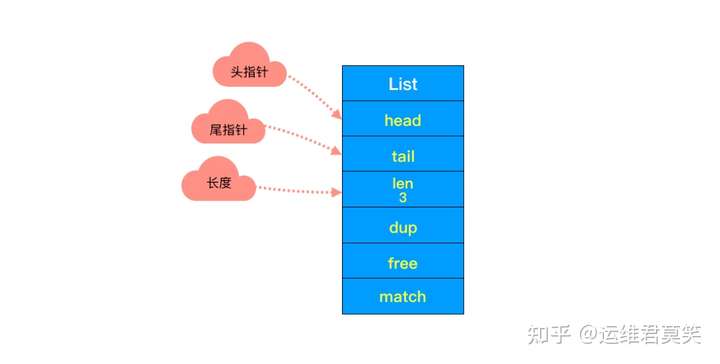

(2)头尾节点

你可能注意到了,头节点里有 head 和 tail 两个参数,分别指向头节点和尾节点。这样的设计能够对双端节点的处理时间复杂度降至 O(1),对于队列和栈来说再适合不过。同时链表迭代时从两端都可以进行。

(3)链表长度

头节点里同时还有一个参数 len,和上边提到的 SDS 里类似,这里是用来记录链表长度的。因此获取链表长度时不用再遍历整个链表,直接拿到 len 值就可以了,这个时间复杂度是 O(1)。

你看,这些特性都降低了 List 使用时的时间开销。

Hash:hash 对象保存的键值对内的键和值字符串长度小于一定值及键值对;

Set:保存元素为整数及元素个数小于一定范围使用 intset 编码,任意条件不满足,则使用 hashtable 编码;

Zset:zset 对象中保存的元素个数小于及成员长度小于一定值使用 ziplist 编码,任意条件不满足,则使用 skiplist 编码。

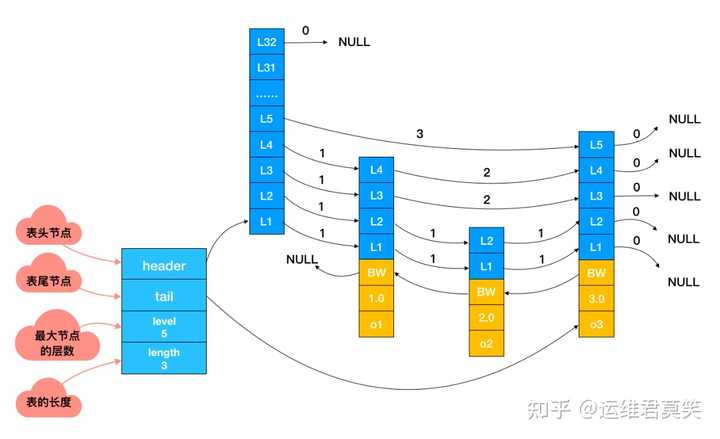

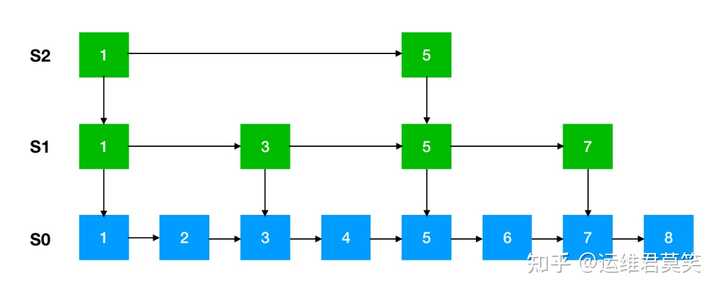

作为 Redis 中特有的数据结构-跳跃表,其在链表的基础上增加了多级索引来提升查找效率。

这是跳跃表的简单原理图,每一层都有一条有序的链表,最底层的链表包含了所有的元素。这样跳跃表就可以支持在 O(logN) 的时间复杂度里查找到对应的节点。

下面这张是跳表真实的存储结构,和其它数据结构一样,都在头节点里记录了相应的信息,减少了一些不必要的系统开销。