Elastic Stack简介

如果你没有听说过Elastic Stack,那你一定听说过ELK,实际上ELK是三款软件的简称,分别是Elasticsearch、

Logstash、Kibana组成,在发展的过程中,又有新成员Beats的加入,所以就形成了Elastic Stack。所以说,ELK是

旧的称呼,Elastic Stack是新的名字。

全系

全系的Elastic Stack技术栈包括:

Elasticsearch

Elasticsearch 基于java,是个开源分布式搜索引擎,它的特点有:分布式,零配置,自动发现,索引自动分片,索引

副本机制,restful风格接口,多数据源,自动搜索负载等。

Logstash

Logstash 基于java,是一个开源的用于收集,分析和存储日志的工具。

Kibana

Kibana 基于nodejs,也是一个开源和免费的工具,Kibana可以为 Logstash 和 ElasticSearch 提供的日志分析友好的

Web 界面,可以汇总、分析和搜索重要数据日志。

Beats

Beats是elastic公司开源的一款采集系统监控数据的代理agent,是在被监控服务器上以客户端形式运行的数据收集

器的统称,可以直接把数据发送给Elasticsearch或者通过Logstash发送给Elasticsearch,然后进行后续的数据分析活

动。

Beats由如下组成:

- Packetbeat:是一个网络数据包分析器,用于监控、收集网络流量信息,Packetbeat嗅探服务器之间的流量,

解析应用层协议,并关联到消息的处理,其支 持ICMP (v4 and v6)、DNS、HTTP、Mysql、PostgreSQL、

Redis、MongoDB、Memcache等协议; - Filebeat:用于监控、收集服务器日志文件,其已取代 logstash forwarder;

- Metricbeat:可定期获取外部系统的监控指标信息,其可以监控、收集 Apache、HAProxy、MongoDB

MySQL、Nginx、PostgreSQL、Redis、System、Zookeeper等服务; - Winlogbeat:用于监控、收集Windows系统的日志信息;

Elasticsearch

简介

官网:https://www.elastic.co/cn/products/elasticsearch

安装

地址:https://www.elastic.co/cn/downloads/elasticsearch

#创建elsearch用户,Elasticsearch不支持root用户运行

useradd elsearch

#解压安装包

tar -xvf elasticsearch-6.5.4.tar.gz -C /itcast/es/

#修改itcast文件夹为elsearch角色所有

chmod elsearch:elsearch itcast/ -R

#修改配置文件

vim conf/elasticsearch.yml

network.host: 0.0.0.0 #设置ip地址,任意网络均可访问

#说明:在Elasticsearch中如果,network.host不是localhost或者127.0.0.1的话,就会认为是生产环境,

会对环境的要求比较高,我们的测试环境不一定能够满足,一般情况下需要修改2处配置,如下:

#1:修改jvm启动参数

vim conf/jvm.options

-Xms128m #根据自己机器情况修改

-Xmx128m

#2:一个进程在VMAs(虚拟内存区域)创建内存映射最大数量

vim /etc/sysctl.conf

vm.max_map_count=655360

sysctl -p #配置生效

#启动ES服务

su - elsearch

cd bin

./elasticsearch 或 ./elasticsearch -d #后台启动

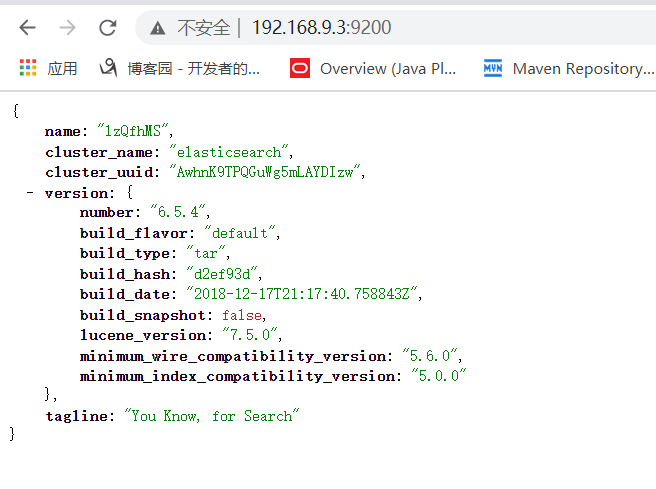

#通过访问进行测试,看到如下信息,就说明ES启动成功了

{

"name": "dSQV6I8",

"cluster_name": "elasticsearch",

"cluster_uuid": "v5GPTWAtT5emxFdjigFg-w",

"version": {

"number": "6.5.4",

"build_flavor": "default",

"build_type": "tar",

"build_hash": "d2ef93d",

"build_date": "2018-12-17T21:17:40.758843Z",

"build_snapshot": false,

"lucene_version": "7.5.0",

"minimum_wire_compatibility_version": "5.6.0",

"minimum_index_compatibility_version": "5.0.0"

},

"tagline": "You Know, for Search"

}

#停止服务

root@itcast:~# jps

68709 Jps

68072 Elasticsearch

kill 68072 #通过kill结束进程

错误的情况

#启动出错,环境:Centos6

[1]: max file descriptors [4096] for elasticsearch process is too low, increase to at

least [65536]

#解决:切换到root用户,编辑limits.conf 添加类似如下内容

vi /etc/security/limits.conf

#添加如下内容:

* soft nofile 65536

* hard nofile 131072

* soft nproc 2048

* hard nproc 4096

[2]: max number of threads [1024] for user [elsearch] is too low, increase to at least

[4096]

#解决:切换到root用户,进入limits.d目录下修改配置文件。

vi /etc/security/limits.d/90-nproc.conf

#修改如下内容:

* soft nproc 1024

#修改为

* soft nproc 4096

[3]: system call filters failed to install; check the logs and fix your configuration

or disable system call filters at your own risk

#解决:Centos6不支持SecComp,而ES5.2.0默认bootstrap.system_call_filter为true

vim config/elasticsearch.yml

#添加:

bootstrap.system_call_filter: false

成功搭建es的页面

elasticsearch-head

由于ES官方并没有为ES提供界面管理工具,仅仅是提供了后台的服务。elasticsearch-head是一个为ES开发的一个页

面客户端工具,其源码托管于GitHub,地址为:https://github.com/mobz/elasticsearch-head

head提供了4种安装方式:

- 源码安装,通过npm run start启动(不推荐)

- 通过docker安装(推荐)

- 通过chrome插件安装(推荐)

- 通过ES的plugin方式安装(不推荐)

通过docker安装

#拉取镜像

docker pull mobz/elasticsearch-head:5

#创建容器

docker create --name elasticsearch-head -p 9100:9100 mobz/elasticsearch-head:5

#启动容器

docker start elasticsearch-head

通过浏览器进行访问:

注意:

由于前后端分离开发,所以会存在跨域问题,需要在服务端做CORS的配置,如下:

vim elasticsearch.yml

http.cors.enabled: true http.cors.allow-origin: "*"

通过chrome插件的方式安装不存在该问题。

chrome插件的方式安装

打开chrome的应用商店,搜索ElasticSearch Head,安装!

该方法需要网络环境允许

基本概念

索引

- 索引(index)是Elasticsearch对逻辑数据的逻辑存储,所以它可以分为更小的部分。

- 可以把索引看成关系型数据库的表,索引的结构是为快速有效的全文索引准备的,特别是它不存储原始值。

- Elasticsearch可以把索引存放在一台机器或者分散在多台服务器上,每个索引有一或多个分片(shard),每个分片可以有多个副本(replica)。

文档

- 存储在Elasticsearch中的主要实体叫文档(document)。用关系型数据库来类比的话,一个文档相当于数据库

表中的一行记录。 - Elasticsearch和MongoDB中的文档类似,都可以有不同的结构,但Elasticsearch的文档中,相同字段必须有相

同类型。 - 文档由多个字段组成,每个字段可能多次出现在一个文档里,这样的字段叫多值字段(multivalued)。

- 每个字段的类型,可以是文本、数值、日期等。字段类型也可以是复杂类型,一个字段包含其他子文档或者数组。

映射

- 所有文档写进索引之前都会先进行分析,如何将输入的文本分割为词条、哪些词条又会被过滤,这种行为叫做

映射(mapping)。一般由用户自己定义规则。

文档类型

- 在Elasticsearch中,一个索引对象可以存储很多不同用途的对象。例如,一个博客应用程序可以保存文章和评

论。 - 每个文档可以有不同的结构。

- 不同的文档类型不能为相同的属性设置不同的类型。例如,在同一索引中的所有文档类型中,一个叫title的字段

必须具有相同的类型。

RESTful API

在Elasticsearch中,提供了功能丰富的RESTful API的操作,包括基本的CRUD、创建索引、删除索引等操作。

创建非结构化索引

在Lucene中,创建索引是需要定义字段名称以及字段的类型的,在Elasticsearch中提供了非结构化的索引,就是不

需要创建索引结构,即可写入数据到索引中,实际上在Elasticsearch底层会进行结构化操作,此操作对用户是透明

的。

创建空索引:

PUT /haoke

{

"settings": {

"index": {

"number_of_shards": "2", #分片数

"number_of_replicas": "0" #副本数

}

}

}

#删除索引

DELETE /haoke

插入数据

URL规则:

POST /{索引}/{类型}/{id}

POST /haoke/user/1001

#数据

{

"id":1001,

"name":"张三",

"age":20,

"sex":"男"

}

#响应

{

"_index": "haoke",

"_type": "user",

"_id": "1",

"_version": 1,

"result": "created",

"_shards": {

"total": 1,

"successful": 1,

"failed": 0

},

"_seq_no": 0,

"_primary_term": 1

}

说明:非结构化的索引,不需要事先创建,直接插入数据默认创建索引。

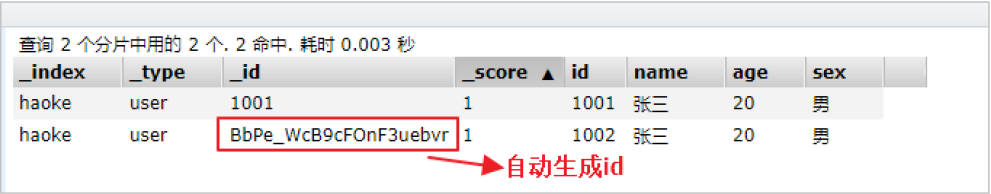

不指定id插入数据:

POST /haoke/user/

{

"id":1002,

"name":"张三",

"age":20,

"sex":"男"

}

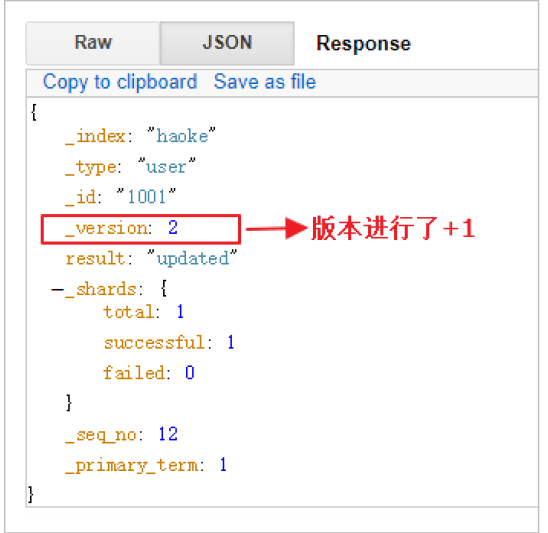

更新数据

在Elasticsearch中,文档数据是不为修改的,但是可以通过覆盖的方式进行更新。

PUT /haoke/user/1001

{

"id":1001,

"name":"张三",

"age":21,

"sex":"女"

}

更新结果如下:

可以看到数据已经被覆盖了。

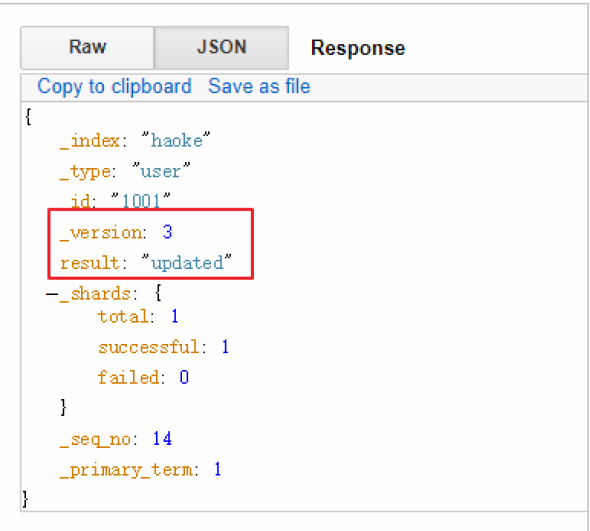

问题来了,可以局部更新吗? -- 可以的。

前面不是说,文档数据不能更新吗? 其实是这样的:

在内部,依然会查询到这个文档数据,然后进行覆盖操作,步骤如下:

- 从旧文档中检索JSON

- 修改它

- 删除旧文档

- 索引新文档

示例:

#注意:这里多了_update标识

POST /haoke/user/1001/_update

{

"doc":{

"age":23

}

}

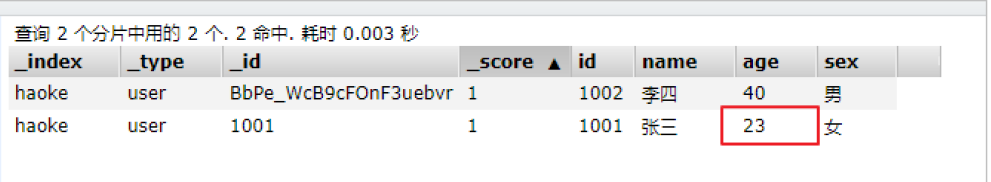

可以看到数据已经被局部更新了。

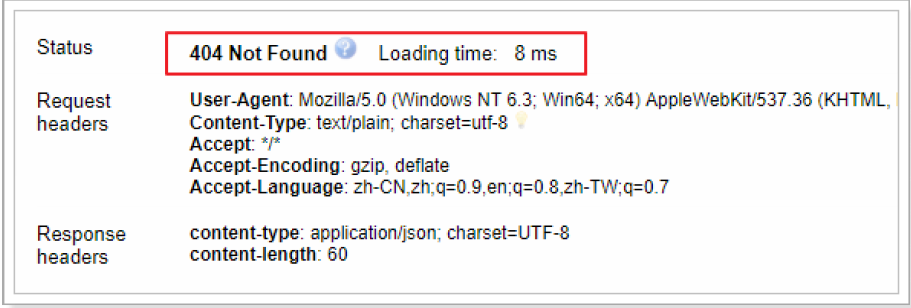

删除数据

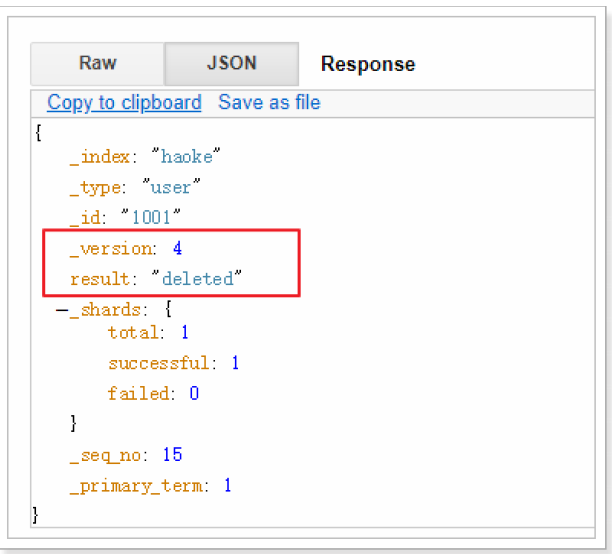

在Elasticsearch中,删除文档数据,只需要发起DELETE请求即可。

DELETE 1 /haoke/user/1001

需要注意的是,result表示已经删除,version也更加了。

如果删除一条不存在的数据,会响应404:

说明:

删除一个文档也不会立即从磁盘上移除,它只是被标记成已删除。Elasticsearch将会在你之后添加更多索引的

时候才会在后台进行删除内容的清理。

搜索数据

根据id搜索数据

GET /haoke/user/BbPe_WcB9cFOnF3uebvr

#返回的数据如下

{

"_index": "haoke",

"_type": "user",

"_id": "BbPe_WcB9cFOnF3uebvr",

"_version": 8,

"found": true,

"_source": { #原始数据在这里

"id": 1002,

"name": "李四",

"age": 40,

"sex": "男"

}

}

搜索全部数据

GET /haoke/user/_search

响应:(默认返回10条数据)

{

"took": 26,

"timed_out": false,

"_shards": {

"total": 2,

"successful": 2,

"skipped": 0,

"failed": 0

},

"hits": {

"total": 4,

"max_score": 1,

"hits": [

{

"_index": "haoke",

"_type": "user",

"_id": "BbPe_WcB9cFOnF3uebvr",

"_score": 1,

"_source": {

"id": 1002,

"name": "李四",

"age": 40,

"sex": "男"

}

},

{

"_index": "haoke",

"_type": "user",

"_id": "1001",

"_score": 1,

"_source": {

"id": 1001,

"name": "张三",

"age": 20,

"sex": "男"

}

},

{

"_index": "haoke",

"_type": "user",

"_id": "1003",

"_score": 1,

"_source": {

"id": 1003,

"name": "王五",

"age": 30,

"sex": "男"

}

},

{

"_index": "haoke",

"_type": "user",

"_id": "1004",

"_score": 1,

"_source": {

"id": 1004,

"name": "赵六",

"age": 30,

"sex": "男"

}

}

]

}

}

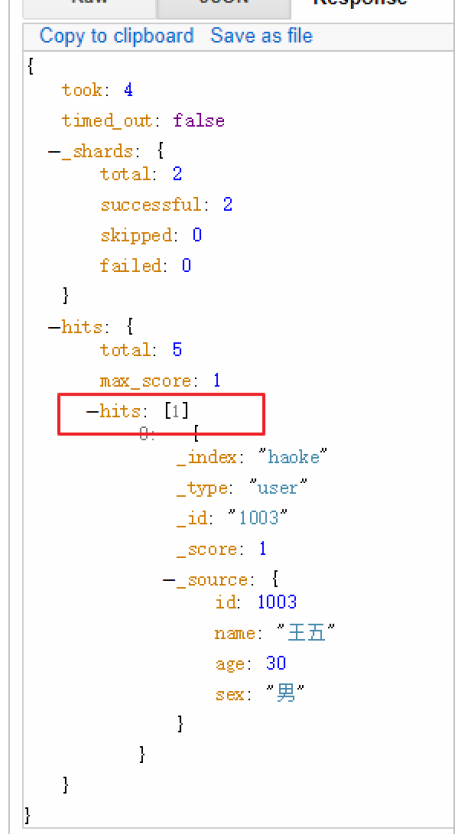

关键字搜素数据

#查询年龄等于20的用户

GET /haoke/user/_search?q=age:20

结果:

DSL搜索

Elasticsearch提供丰富且灵活的查询语言叫做DSL查询(Query DSL),它允许你构建更加复杂、强大的查询。

DSL(Domain Specific Language特定领域语言)以JSON请求体的形式出现。

POST /haoke/user/_search

#请求体

{

"query" : {

"match" : { #match只是查询的一种

"age" : 20

}

}

}

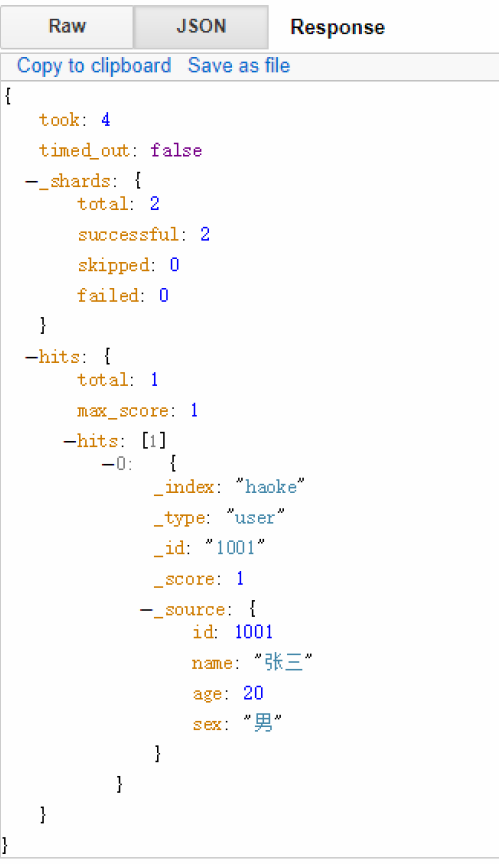

响应数据:

实现:查询年龄大于30岁的男性用户

现有数据:

POST /haoke/user/_search

#请求数据

{

"query": {

"bool": {

"filter": {

"range": {

"age": {

"gt": 30

}

}

},

"must": {

"match": {

"sex": "男"

}

}

}

}

}

查询结果:

全文搜索

POST /haoke/user/_search

#请求数据

{

"query": {

"match": {

"name": "张三 李四"

}

}

}

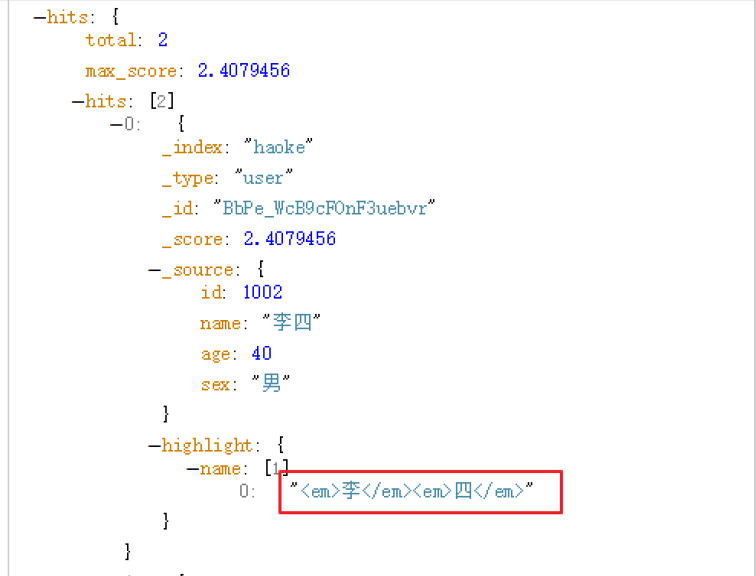

高亮显示

POST /haoke/user/_search

{

"query": {

"match": {

"name": "张三 李四"

}

},

"highlight": {

"fields": {

"name": {}

}

}

}

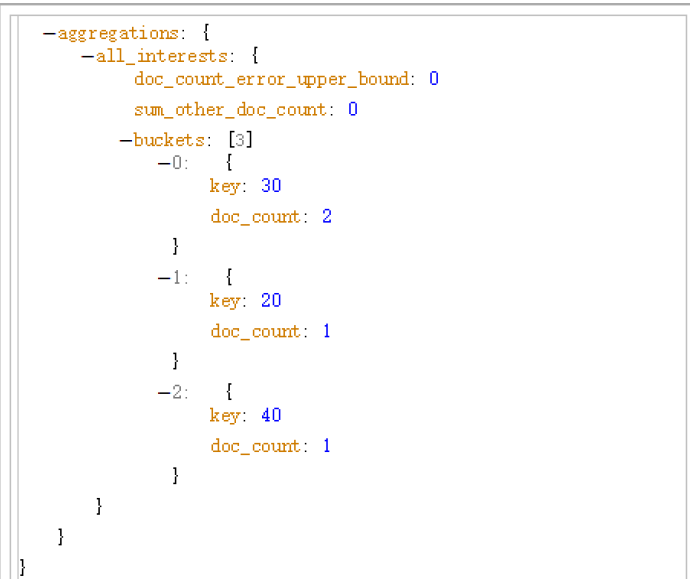

聚合

在Elasticsearch中,支持聚合操作,类似SQL中的group by操作。

POST /haoke/user/_search

{

"aggs": {

"all_interests": {

"terms": {

"field": "age"

}

}

}

}

结果:

从结果可以看出,年龄30的有2条数据,20的有一条,40的一条。

核心详解

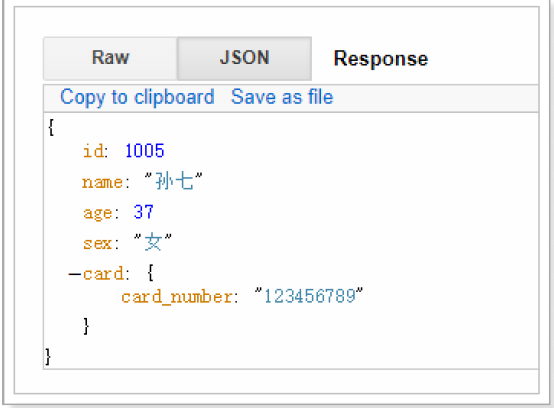

文档

在Elasticsearch中,文档以JSON格式进行存储,可以是复杂的结构,如:

{

"_index": "haoke",

"_type": "user",

"_id": "1005",

"_version": 1,

"_score": 1,

"_source": {

"id": 1005,

"name": "孙七",

"age": 37,

"sex": "女",

"card": {

"card_number": "123456789"

}

}

}

其中,card是一个复杂对象,嵌套的Card对象。

元数据(metadata)

一个文档不只有数据。它还包含了元数据(metadata)——关于文档的信息。三个必须的元数据节点是:

| 节点 | 说明 |

|---|---|

_index |

文档存储的地方 |

_type |

文档代表的对象的类 |

_id |

文档的唯一标识 |

_index

索引(index)类似于关系型数据库里的“数据库”——它是我们存储和索引关联数据的地方。

提示:

事实上,我们的数据被存储和索引在分片(shards)中,索引只是一个把一个或多个分片分组在一起的逻辑空

间。然而,这只是一些内部细节——我们的程序完全不用关心分片。对于我们的程序而言,文档存储在索引

(index)中。剩下的细节由Elasticsearch关心既可。

_type

在应用中,我们使用对象表示一些“事物”,例如一个用户、一篇博客、一个评论,或者一封邮件。每个对象都属于一

个类(class),这个类定义了属性或与对象关联的数据。user 类的对象可能包含姓名、性别、年龄和Email地址。

在关系型数据库中,我们经常将相同类的对象存储在一个表里,因为它们有着相同的结构。同理,在Elasticsearch

中,我们使用相同类型(type)的文档表示相同的“事物”,因为他们的数据结构也是相同的。

每个类型(type)都有自己的映射(mapping)或者结构定义,就像传统数据库表中的列一样(字段)。所有类型下的文档被存储

在同一个索引下,但是类型的映射(mapping)会告诉Elasticsearch不同的文档如何被索引。

_type 的名字可以是大写或小写,不能包含下划线或逗号。我们将使用blog 做为类型名。

查询响应

指定响应字段

在响应的数据中,如果我们不需要全部的字段,可以指定某些需要的字段进行返回。

GET /haoke/user/1005?_source=id,name

#响应

{

"_index": "haoke",

"_type": "user",

"_id": "1005",

"_version": 1,

"found": true,

"_source": {

"name": "孙七",

"id": 1005

}

}

如不需要返回元数据,仅仅返回原始数据,可以这样:

GET /haoke/1 user/1005/_source

还可以这样:

GET /haoke/user/1005/_source?_1 source=id,name

判断文档是否存在

如果我们只需要判断文档是否存在,而不是查询文档内容,那么可以这样:

HEAD /haoke/user/1005

HEAD 1 /haoke/user/1006

当然,这只表示你在查询的那一刻文档不存在,但并不表示几毫秒后依旧不存在。另一个进程在这期间可能创

建新文档。

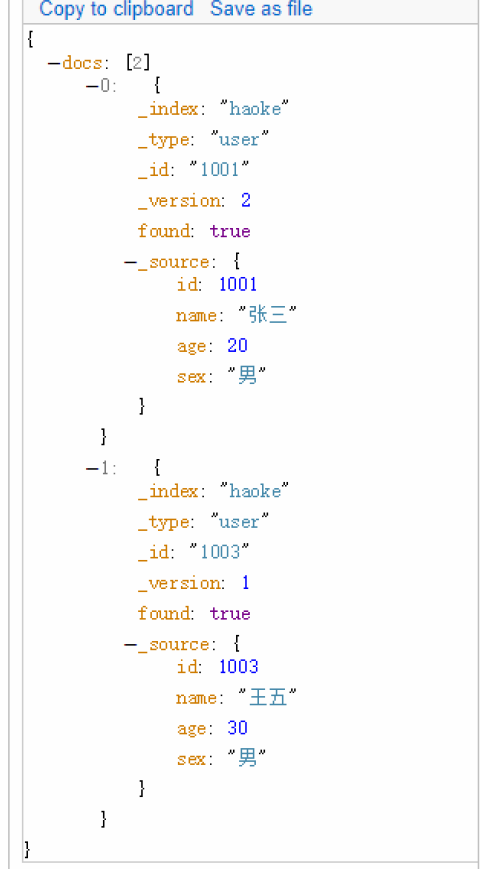

批量操作

有些情况下可以通过批量操作以减少网络请求。如:批量查询、批量插入数据。

批量查询

POST /haoke/user/_mget

{

"ids" : [ "1001", "1003" ]

}

结果:

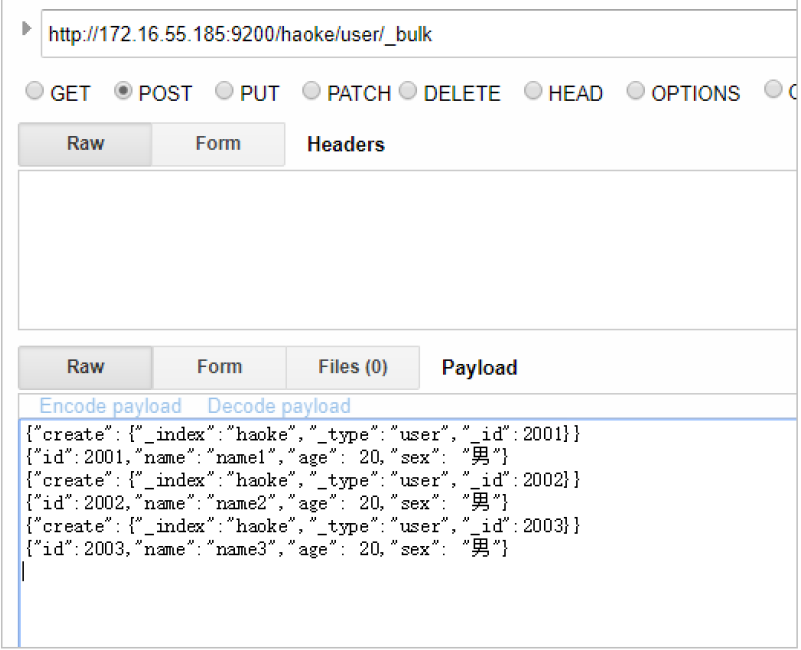

_bulk操作

在Elasticsearch中,支持批量的插入、修改、删除操作,都是通过_bulk的api完成的。

请求格式如下:(请求格式不同寻常)

{ action: { metadata }}

{ request body }

{ action: { metadata }}

{ request body }

...

批量插入数据:

{"create":{"_index":"haoke","_type":"user","_id":2001}}

{"id":2001,"name":"name1","age": 20,"sex": "男"}

{"create":{"_index":"haoke","_type":"user","_id":2002}}

{"id":2002,"name":"name2","age": 20,"sex": "男"}

{"create":{"_index":"haoke","_type":"user","_id":2003}}

{"id":2003,"name":"name3","age": 20,"sex": "男"}

注意最后一行的回车

批量删除:

{"delete":{"_index":"haoke","_type":"user","_id":2001}}

{"delete":{"_index":"haoke","_type":"user","_id":2002}}

{"delete":{"_index":"haoke","_type":"user","_id":2003}}

由于delete没有请求体,所以,action的下一行直接就是下一个action。

其他操作就类似了。

一次请求多少性能最高?

- 整个批量请求需要被加载到接受我们请求节点的内存里,所以请求越大,给其它请求可用的内存就越小。有一

个最佳的bulk请求大小。超过这个大小,性能不再提升而且可能降低。 - 最佳大小,当然并不是一个固定的数字。它完全取决于你的硬件、你文档的大小和复杂度以及索引和搜索的负

载。 - 幸运的是,这个最佳点(sweetspot)还是容易找到的:试着批量索引标准的文档,随着大小的增长,当性能开始

降低,说明你每个批次的大小太大了。开始的数量可以在1000~5000个文档之间,如果你的文档非常大,可以

使用较小的批次。 - 通常着眼于你请求批次的物理大小是非常有用的。一千个1kB的文档和一千个1MB的文档大不相同。一个好的

批次最好保持在5-15MB大小间。

分页

和SQL使用LIMIT 关键字返回只有一页的结果一样,Elasticsearch接受from 和size 参数:

size: 结果数,默认10

from: 跳过开始的结果数,默认0

如果你想每页显示5个结果,页码从1到3,那请求如下:

GET /_search?size=5

GET /_search?size=5&from=5

GET /_search?size=5&from=10

应该当心分页太深或者一次请求太多的结果。结果在返回前会被排序。但是记住一个搜索请求常常涉及多个分

片。每个分片生成自己排好序的结果,它们接着需要集中起来排序以确保整体排序正确。

GET /haoke/user/_1 search?size=1&from=2

在集群系统中深度分页

为了理解为什么深度分页是有问题的,让我们假设在一个有5个主分片的索引中搜索。当我们请求结果的第一

页(结果1到10)时,每个分片产生自己最顶端10个结果然后返回它们给请求节点(requesting node),它再

排序这所有的50个结果以选出顶端的10个结果。

现在假设我们请求第1000页——结果10001到10010。工作方式都相同,不同的是每个分片都必须产生顶端的

10010个结果。然后请求节点排序这50050个结果并丢弃50040个!你可以看到在分布式系统中,排序结果的花费随着分页的深入而成倍增长。这也是为什么网络搜索引擎中任何

语句不能返回多于1000个结果的原因。

映射

前面我们创建的索引以及插入数据,都是由Elasticsearch进行自动判断类型,有些时候我们是需要进行明确字段类型

的,否则,自动判断的类型和实际需求是不相符的。

自动判断的规则如下:

| JSON type | Field type |

|---|---|

Boolean: true or false |

"boolean" |

Whole number:123 |

"long" |

Floating point: 123.45 |

"double" |

String, valid date: "2014-09-15" |

"date" |

String: "foo bar" |

"string" |

Elasticsearch中支持的类型如下:

| 类型 | 表示的数据类型 |

|---|---|

| String | string , text , keyword |

| Whole number | byte , short , integer , long |

| Floating point | float , double |

| Boolean | boolean |

| Date | date |

-

string类型在ElasticSearch 旧版本中使用较多,从ElasticSearch 5.x开始不再支持string,由text和

keyword类型替代。 -

text 类型(会被分词),当一个字段是要被全文搜索的,比如Email内容、产品描述,应该使用text类型。设置text类型

以后,字段内容会被分析,在生成倒排索引以前,字符串会被分析器分成一个一个词项。text类型的字段

不用于排序,很少用于聚合。 -

keyword类型(不会分词)适用于索引结构化的字段,比如email地址、主机名、状态码和标签。如果字段需要进行过

滤(比如查找已发布博客中status属性为published的文章)、排序、聚合。keyword类型的字段只能通过精

确值搜索到。

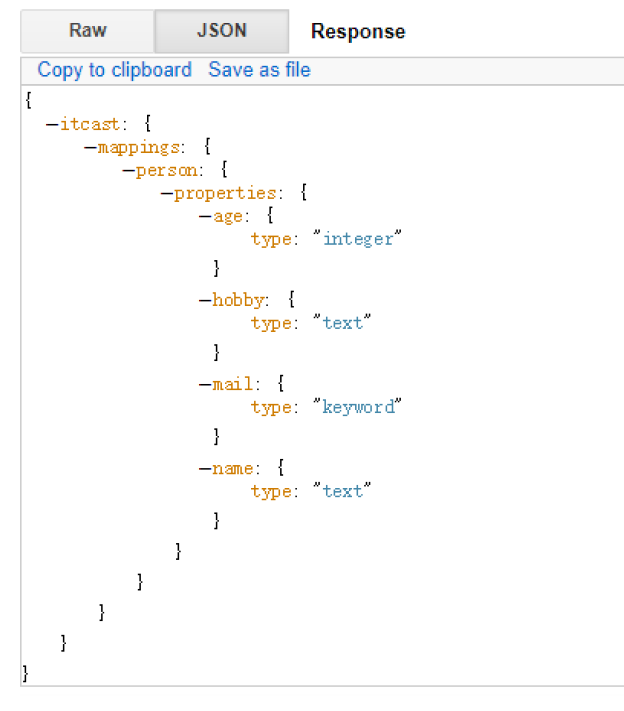

创建明确类型的索引:

PUT /itcast

{

"settings": {

"index": {

"number_of_shards": "2",

"number_of_replicas": "0"

}

},

"mappings": {

"person": {

"properties": {

"name": {

"type": "text"

},

"age": {

"type": "integer"

},

"mail": {

"type": "keyword"

},

"hobby": {

"type": "text"

}

}

}

}

}

查看映射:

GET /itcast/_mapping

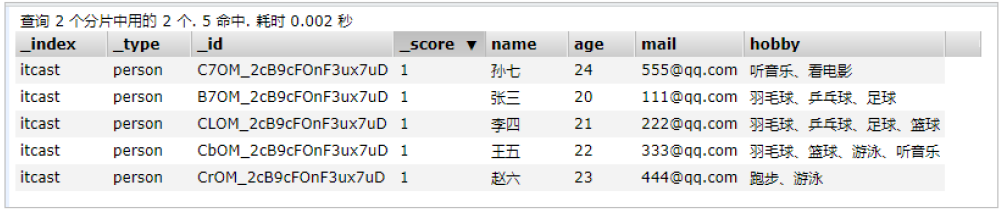

插入数据:

POST /itcast/_bulk

{"index":{"_index":"itcast","_type":"person"}}

{"name":"张三","age": 20,"mail": "111@qq.com","hobby":"羽毛球、乒乓球、足球"}

{"index":{"_index":"itcast","_type":"person"}}

{"name":"李四","age": 21,"mail": "222@qq.com","hobby":"羽毛球、乒乓球、足球、篮球"}

{"index":{"_index":"itcast","_type":"person"}}

{"name":"王五","age": 22,"mail": "333@qq.com","hobby":"羽毛球、篮球、游泳、听音乐"}

{"index":{"_index":"itcast","_type":"person"}}

{"name":"赵六","age": 23,"mail": "444@qq.com","hobby":"跑步、游泳"}

{"index":{"_index":"itcast","_type":"person"}}

{"name":"孙七","age": 24,"mail": "555@qq.com","hobby":"听音乐、看电影"}

测试搜索:

POST /itcast/person/_search

{

"query" : {

"match" : {

"hobby" : "音乐"

}

}

}