第一篇文章,就从一个简单爬虫开始吧。

这只虫子的功能很简单,抓取到”煎蛋网xxoo”网页(http://jandan.net/ooxx/page-1537),解析出其中的妹子图,保存至本地。

先放结果:

从程序来讲,分为三个步骤:

1、发起一个http请求,获取返回的response内容;

2、解析内容,分离出有效图片的url;

3、根据这些图片的url,生成图片保存至本地。

开始详细说明:

准备工作:HttpClient的Jar包,访问http://hc.apache.org/ 自行下载。

主程序内容:

public class SimpleSpider { //起始页码 private static final int page = 1538; public static void main(String[] args) { //HttpClient 超时配置 RequestConfig globalConfig = RequestConfig.custom().setCookieSpec(CookieSpecs.STANDARD).setConnectionRequestTimeout(6000).setConnectTimeout(6000).build(); CloseableHttpClient httpClient = HttpClients.custom().setDefaultRequestConfig(globalConfig).build(); System.out.println("5秒后开始抓取煎蛋妹子图……"); for (int i = page; i > 0; i--) { //创建一个GET请求 HttpGet httpGet = new HttpGet("http://jandan.net/ooxx/page-" + i); httpGet.addHeader("User-Agent","Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/42.0.2311.152 Safari/537.36"); httpGet.addHeader("Cookie","_gat=1; nsfw-click-load=off; gif-click-load=on; _ga=GA1.2.1861846600.1423061484"); try { //不敢爬太快 Thread.sleep(5000); //发送请求,并执行 CloseableHttpResponse response = httpClient.execute(httpGet); InputStream in = response.getEntity().getContent(); String html = Utils.convertStreamToString(in); //网页内容解析 new Thread(new JianDanHtmlParser(html, i)).start(); } catch (Exception e) { e.printStackTrace(); } } } }

HttpClient是一个非常强大的工具,属于apache下项目。如果只是创建一个默认的httpClient实例,代码很简单,官网手册上有详细说明。

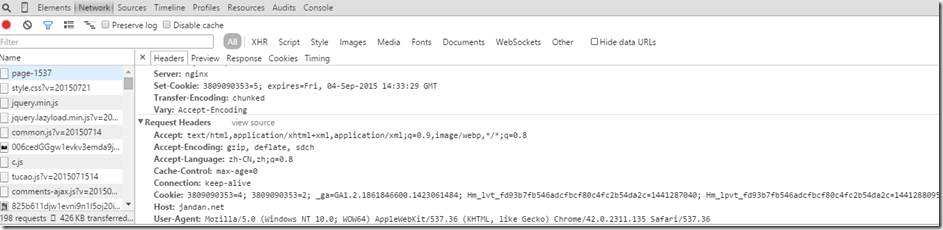

可以看到在创建一个GET请求时,加入了请求头。第一个User-Agent代表所使用浏览器。有些网站需要明确了解用户所使用的浏览器,而有些不需要。个人猜测,部分网站根据用户使用浏览器不同显示不一样。这里的煎蛋网,就必须得加入请求头。第二个Cookie则代表了一些用户设置,可以没有。使用chrome的开发者工具就能清楚看到。如果是https加密后的,则需要特殊的抓包工具。

网页内容解析

public class JianDanHtmlParser implements Runnable { private String html; private int page; public JianDanHtmlParser(String html,int page) { this.html = html; this.page = page; } @Override public void run() { System.out.println("==========第"+page+"页============"); List<String> list = new ArrayList<String>(); html = html.substring(html.indexOf("commentlist")); String[] images = html.split("li>"); for (String image : images) { String[] ss = image.split("br"); for (String s : ss) { if (s.indexOf("<img src=") > 0) { try{ int i = s.indexOf("<img src="") + "<img src="".length(); list.add(s.substring(i, s.indexOf(""", i + 1))); }catch (Exception e) { System.out.println(s); } } } } for(String imageUrl : list){ if(imageUrl.indexOf("sina")>0){ new Thread(new JianDanImageCreator(imageUrl,page)).start(); } } } }

这段代码看起来凌乱,但实际上却特别简单。简单说便是,将response返回的html字符串解析,截取,找到真正需要的内容(图片url),存入到临时容器中。

生成图片类

public class JianDanImageCreator implements Runnable { private static int count = 0; private String imageUrl; private int page; //存储路径,自定义 private static final String basePath = "E:/jiandan"; public JianDanImageCreator(String imageUrl,int page) { this.imageUrl = imageUrl; this.page = page; } @Override public void run() { File dir = new File(basePath); if(!dir.exists()){ dir.mkdirs(); System.out.println("图片存放于"+basePath+"目录下"); } String imageName = imageUrl.substring(imageUrl.lastIndexOf("/")+1); try { File file = new File( basePath+"/"+page+"--"+imageName); OutputStream os = new FileOutputStream(file); //创建一个url对象 URL url = new URL(imageUrl); InputStream is = url.openStream(); byte[] buff = new byte[1024]; while(true) { int readed = is.read(buff); if(readed == -1) { break; } byte[] temp = new byte[readed]; System.arraycopy(buff, 0, temp, 0, readed); //写入文件 os.write(temp); } System.out.println("第"+(count++)+"张妹子:"+file.getAbsolutePath()); is.close(); os.close(); } catch (Exception e) { e.printStackTrace(); } } }

根据每个图片的src地址创建一个URL对象,再使用字节流,生成本地文件。

这个程序相对来说比较简单,纯属娱乐。如果能让那些不了解HttpClient的同学对这个库产生兴趣,则功德无量。

github地址:https://github.com/nbsa/SimpleSpider

PS:这个博客只提供抓取图片的方法,图片版权属于原网站及其网友。请大家尊重原网劳动成果,避免分发、传播图片内容。