-

-

循环网络的基本应用

-

语音问答,机器翻译,股票预测,作词机,作诗,模仿写论文,图像理解

-

-

循环神经网络(RNN)vs卷积神经网络

-

传统神经网络,卷积神经网络,输入输出相互独立

-

RNN可以更好的处理具有时序关系的任务

-

RNN通过其循环结构引入“记忆”的概念:输出不仅依赖于输入,还依赖“记忆”,将同一个结构循环利用

-

-

-

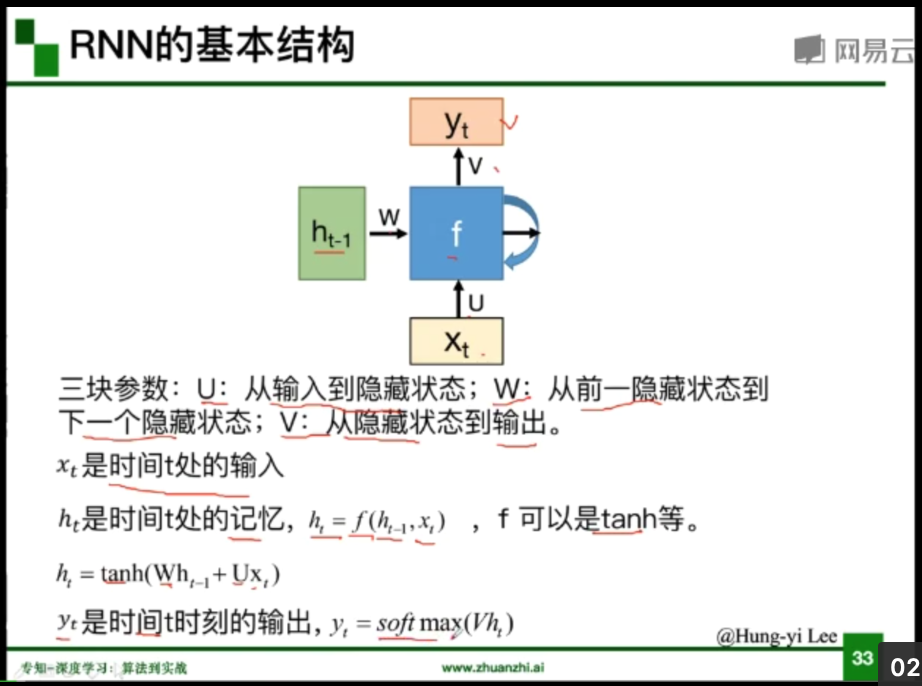

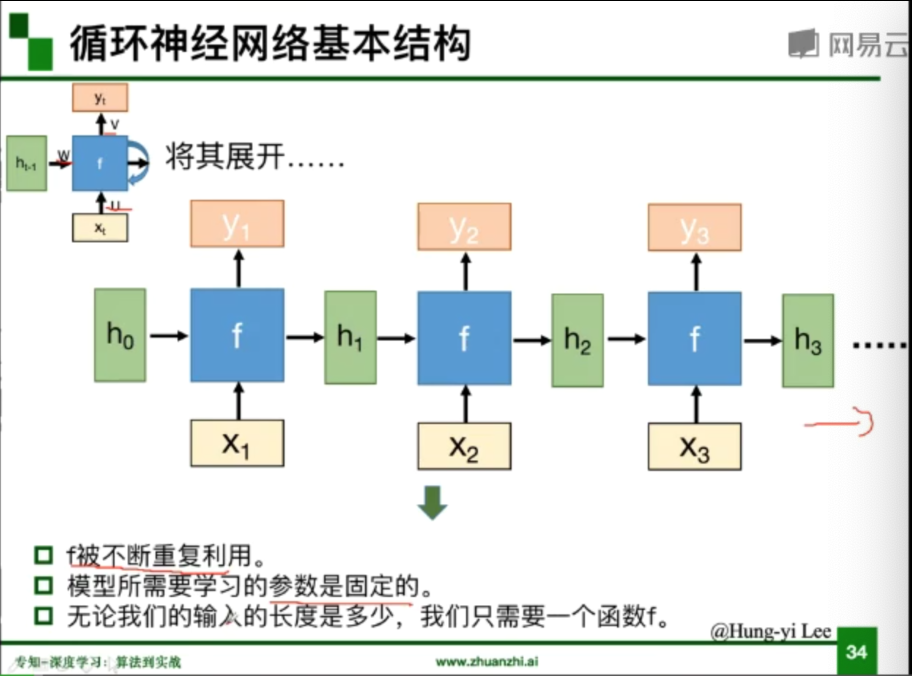

RNN基本组成结构

-

RNN的基本结构

-

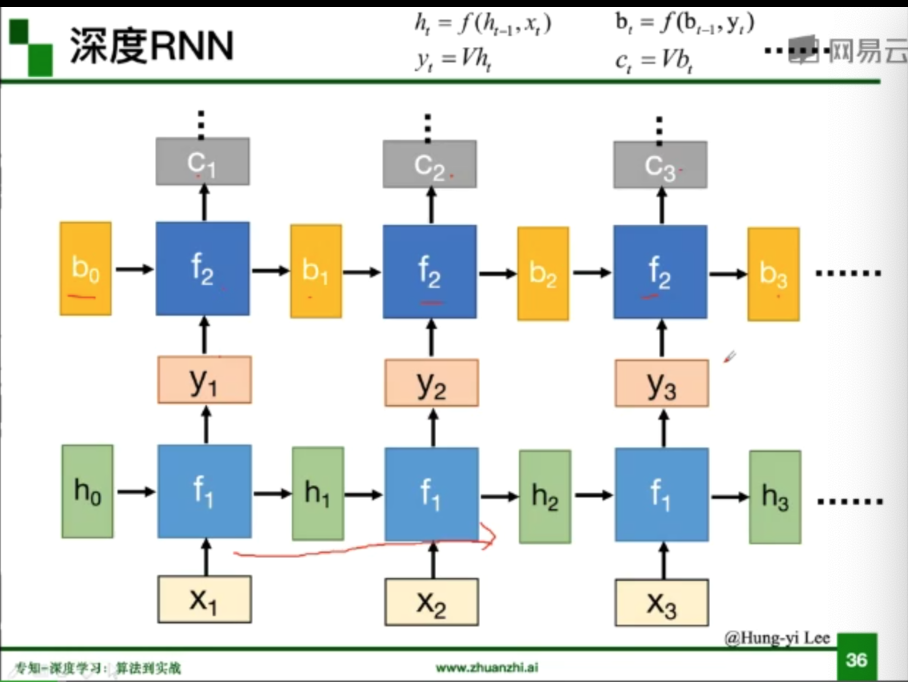

深度RNN

-

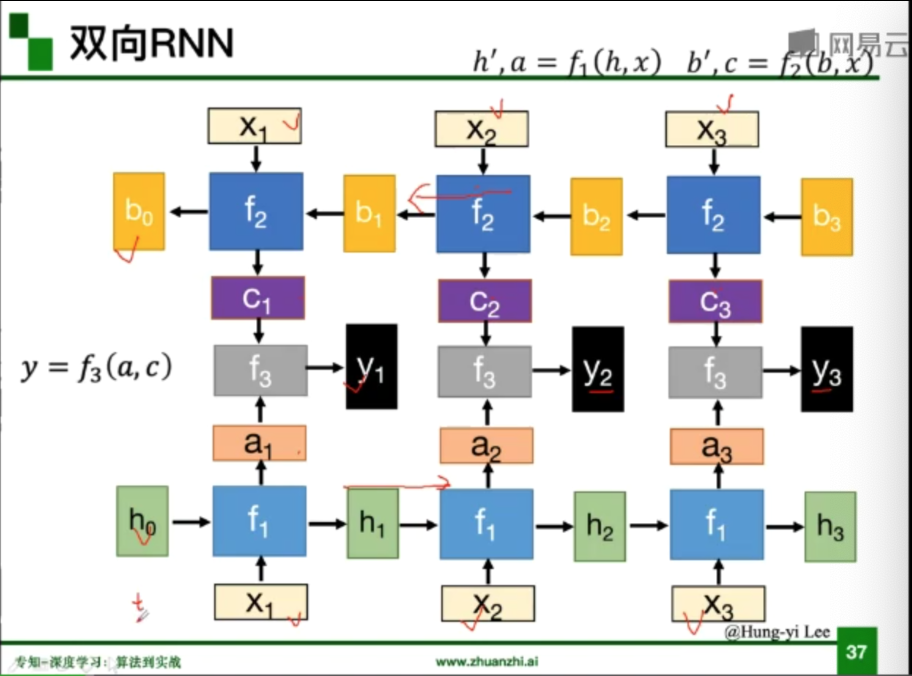

双向RNN

-

总结

-

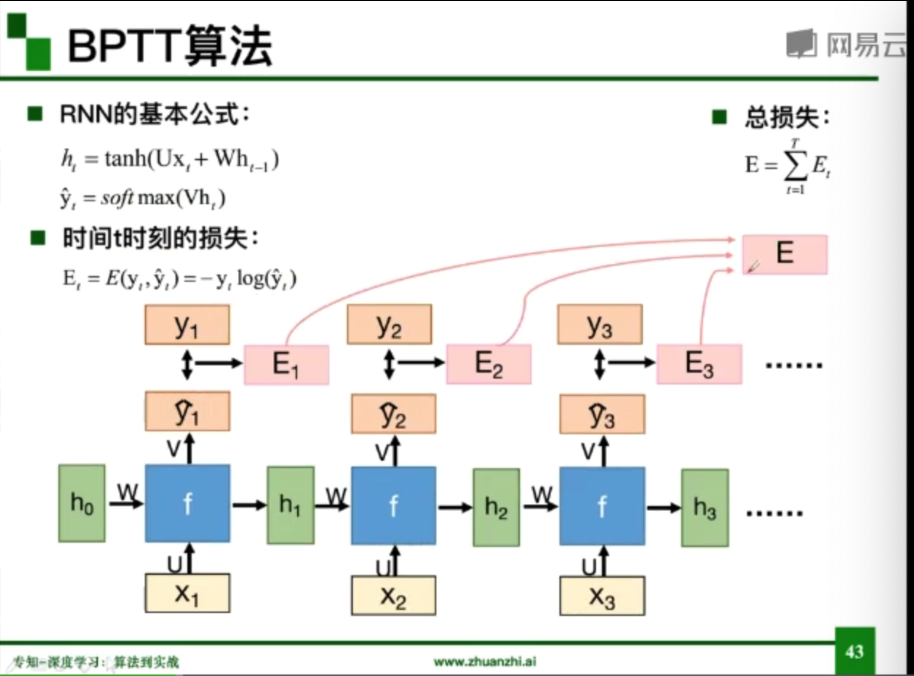

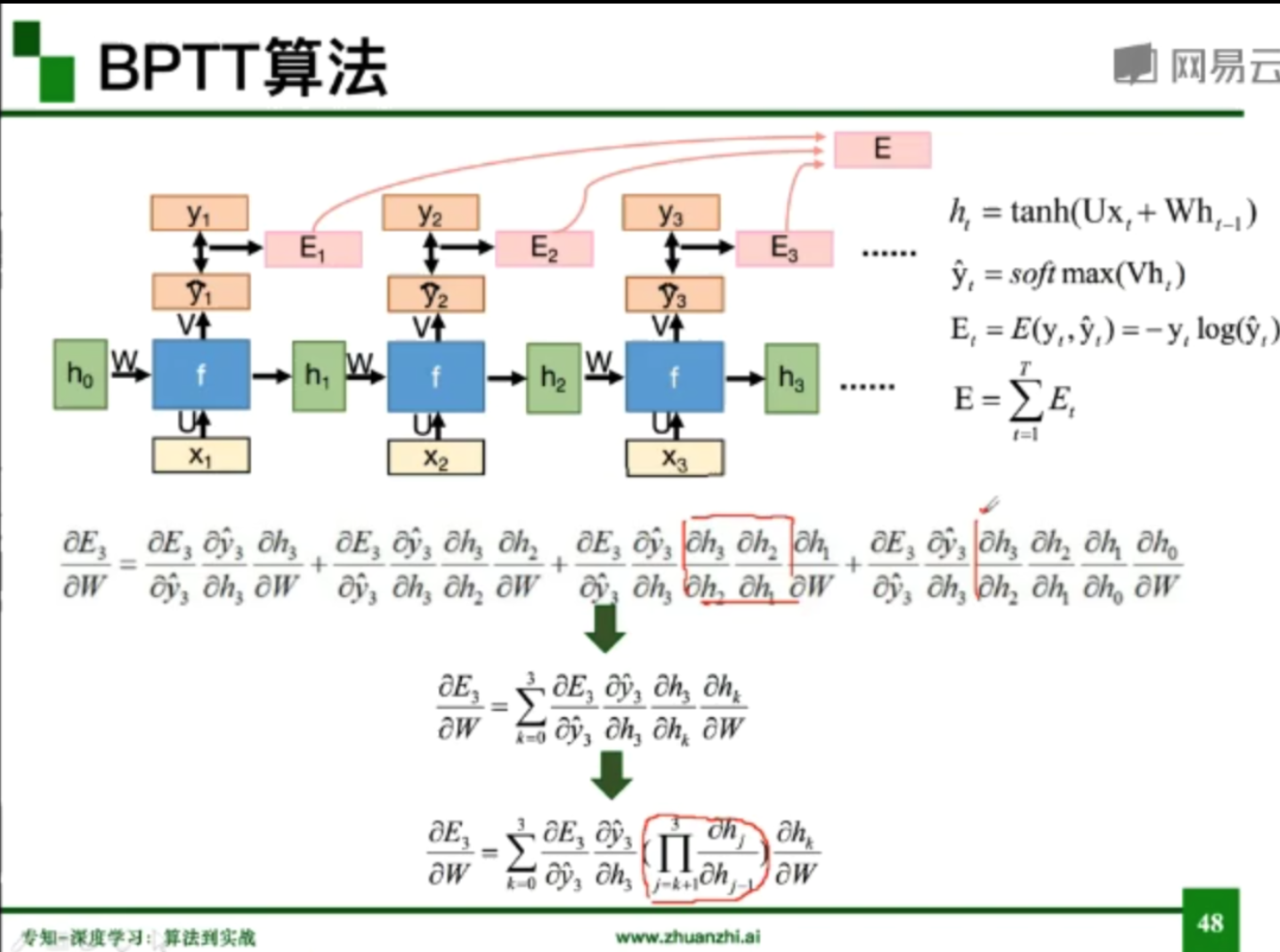

BPTT算法

-

-

循环神经网络的变种

-

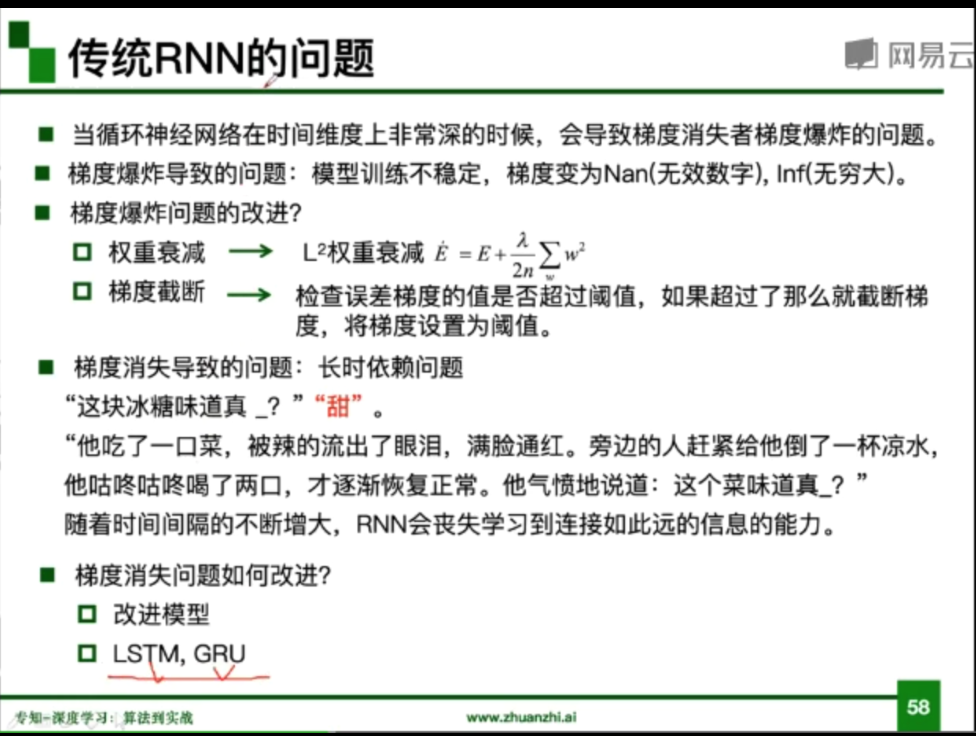

传统RNN的问题

-

当循环神经网络在时间维度上非常深的时候,会导致梯度消失或者梯度爆炸的问题

-

-

LSTM(长短期记忆模型)

遗忘门(forget gate)

输入门(input gate)

输出门(output gate )

一个初始化技巧就是将输出门的bias置为正数(例如1或5),这样模型刚开始训练时遗忘门的值接近于1,不会发生梯度消失。

-

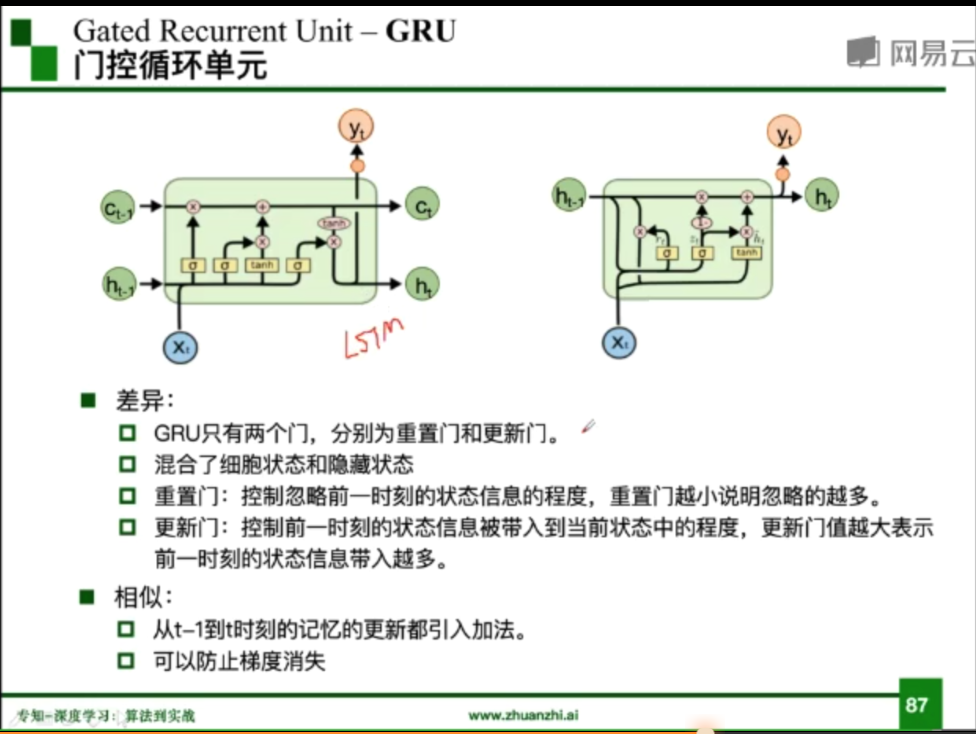

GRU(解决LSTM运算复杂)

-