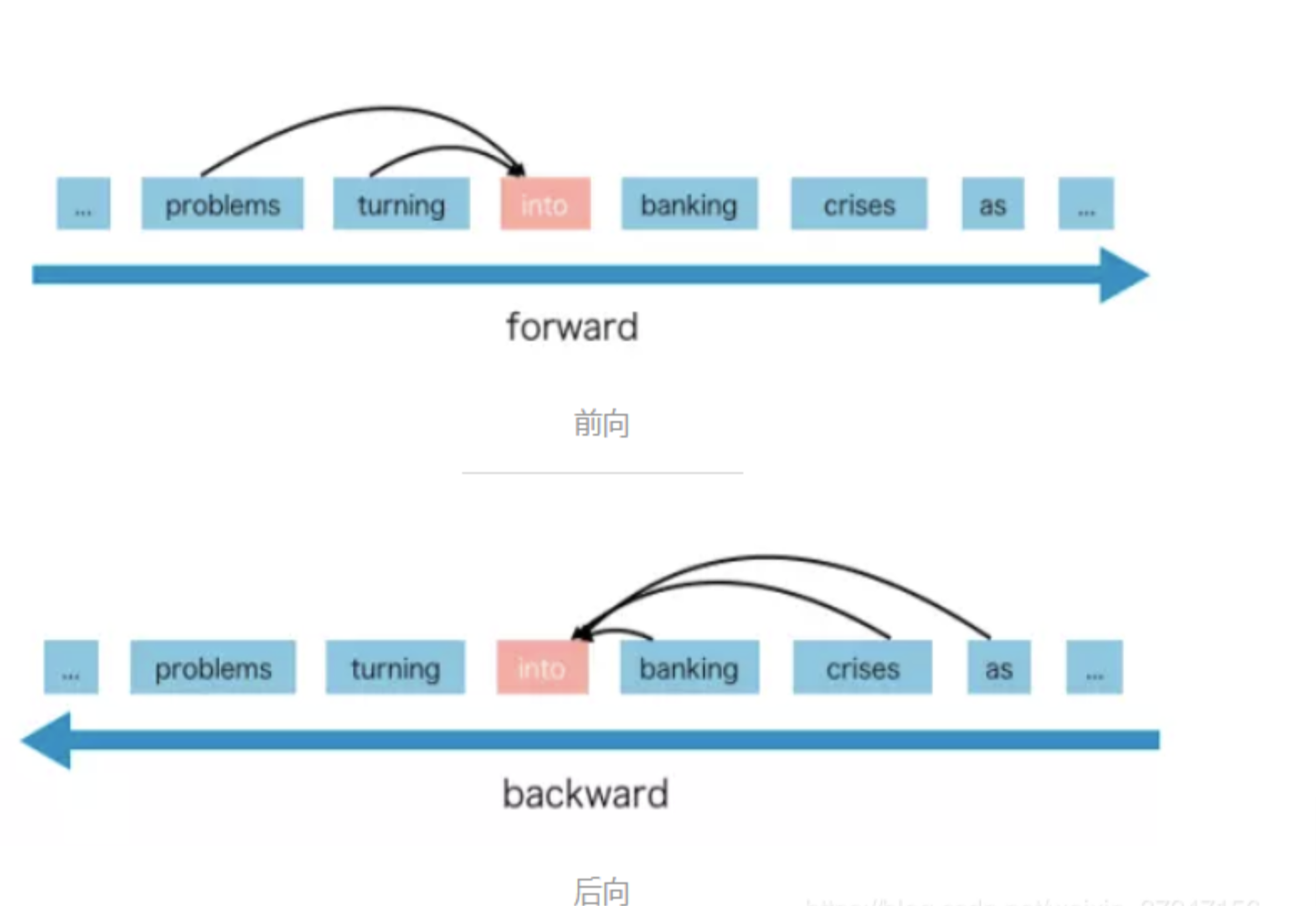

AR语言模型(AutoRegressive LM):只能获取单向信息,即只能前向读取信息并预测t位置的单词或者从后向读取信息并预测t位置的单词,却不能同时获取双向信息,代表例子是GPT,GPT2,XLNet,ELMO

AR LM的优点:比较擅长生成类任务

缺点:只能获取单向信息,不能获取双向信息。

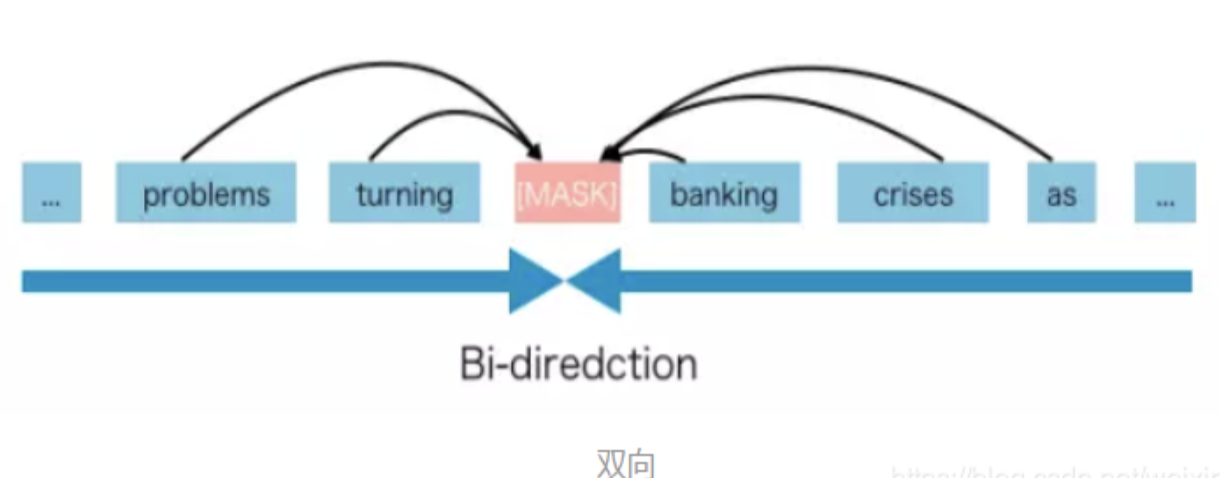

AE语言模型(AutoEncoder LM):获取双向信息进行预测,如想要预测位置t的单词,既可以前向获取信息也可以后向获取信息,代表例子是Bert

AE LM的优点:可以获取双向信息,能同时看到预测位置的上文和下文

缺点:如bert,它在预训练过程中会增加输入噪声,如对输入序列会随机mask掉一部分的单词,而在微调时却不会增加输入噪声,这种预训练-微调步骤中产生的差异,会产生一部分的人为误差