一.环境准备

Ubuntu16.04 ROS-kinetic opencv3.3.1 video-stream-opencv(Python)

或者usb_cam (c++) 一个USB摄像头

video-stream-opencv是USB摄像头驱动,关于它的介绍,请看github:https://github.com/ros-drivers/video_stream_opencv

二. 在ROS下创建工作空间

在欢迎界面, 点击“新建工作区”按钮(或选择“文件 - 新建工作区” ) , 选择路径并

填写工作区名称, 如“catkin_ws”, 则会创建一个名为“catkin_ws”工作区, 并显示在资源管理

器窗口:

三、在工作空间下创建程序包

1、安装video-stream-opencv

$ cd ~/catkin_ws/src/ $ git clone https://github.com/ros-drivers/video_stream_opencv.git

$ cd ..

$ catkin_make

2、编译好之后,添加编译好的文件到环境变量:

$ source devel/setup.bash

3、测试是否安装成功

在终端输入:

$ rosrun video_stream_opencv test_video_resource.py 0 #后面的0是摄像头编号

https://yq.aliyun.com/ziliao/203675

https://blog.csdn.net/Gpwner/article/details/78961362

1、安装usb_cam

进入创建好的工作空间:

cd ~/catkin_ws/src git clone https://github.com/bosch-ros-pkg/usb_cam.git

然后退回到工作空间,编译代码:

cd ~/catkin_ws

catkin_make

编译好之后,添加编译好的文件到环境变量:

source devel/setup.bash

2、然后接下来测试usb_cam:

先运行usb_cam节点:

rosrun usb_cam usb_cam_node

运行上面命令发现没有显示图像,只看到摄像头打开了。这是因为ros发布的topic是/usb_cam/image_raw。新打开一个终端,可以通过如下命令查看:

rostopic list

所以我们需要运行如下命令才可以看到图像:

rosrun image_view image_view image:=/usb_cam/image_raw

或者直接写launch文件,这样就不用一个终端运行node,一个终端看图像。新建usb_cam_test.launch:

<launch> <node name="usb_cam" pkg="usb_cam" type="usb_cam_node" output="screen" > <param name="video_device" value="/dev/video0" /> <param name="image_width" value="640" /> <param name="image_height" value="480" /> <param name="pixel_format" value="yuyv" /> <param name="camera_frame_id" value="usb_cam" /> <param name="io_method" value="mmap"/> </node> <node name="image_view" pkg="image_view" type="image_view" respawn="false" output="screen"> <remap from="image" to="/usb_cam/image_raw"/> <param name="autosize" value="true" /> </node> </launch>

然后终端直接运行:

roslaunch usb_cam usb_cam_test.launch

右键点击 ROS 工作区下的“src”, 选择“新建 ROS 包”,输入包名称及其依赖包的名

称,如:

“robot_vision roscpp std_msgs cv_bridge image_transport sensor_msgs”

回车后,会创建名为“robot_vision ”、以“roscpp std_msgs cv_bridge image_transport sensor_msgs”为依赖的 ROS 包:

3、创建.cpp源文件

在创建的程序包的src文件中创建一个文本文件,并命名为opencv_test.cpp,选择添加到可执行文件中。具体代码和注释如下:

#include<ros/ros.h> //ros标准库头文件 #include<image_transport/image_transport.h>/* image_transport 头文件用来在ROS系统中的话题上发布和订阅图象消息*/ #include<cv_bridge/cv_bridge.h>/* cv_bridge中包含CvBridge库 */ #include<sensor_msgs/image_encodings.h>/* ROS图象类型的编码函数*/ #include<iostream> //C++标准输入输出库 //OpenCV3标准头文件 #include<opencv2/opencv.hpp> static const std::string OPENCV_WINDOW = "Image window"; //定义输入窗口名称 //定义一个转换的类 class ImageConverter { private: ros::NodeHandle nh_; //定义ROS句柄 image_transport::ImageTransport it_; //定义一个image_transport实例 image_transport::Subscriber image_sub_; //定义ROS图象接收器 image_transport::Publisher image_pub_; //定义ROS图象发布器 public: ImageConverter() :it_(nh_) //构造函数 { //这里是usb摄像头的topic,官网默认是/camera/image_raw,这里修改为usb摄像头/usb_cam/image_raw。 //定义图象接受器,订阅话题是“/usb_cam/image_raw” image_sub_ = it_.subscribe("/usb_cam/image_raw", 1, &ImageConverter::convert_callback, this); image_pub_ = it_.advertise("/image_converter/output_video", 1); //定义图象发布器 //初始化输入输出窗口 cv::namedWindow(OPENCV_WINDOW); } ~ImageConverter() //析构函数 { cv::destroyWindow(OPENCV_WINDOW); } /*这是一个ROS和OpenCV的格式转换回调函数,将图象格式从sensor_msgs/Image--->cv::Mat*/ void convert_callback(const sensor_msgs::ImageConstPtr& msg) { cv_bridge::CvImagePtr cv_ptr; // 声明一个CvImage指针的实例 try { //将ROS消息中的图象信息提取,生成新cv类型的图象,复制给CvImage指针 cv_ptr = cv_bridge::toCvCopy(msg, sensor_msgs::image_encodings::BGR8); } catch(cv_bridge::Exception& e) //异常处理 { ROS_ERROR("cv_bridge exception: %s", e.what()); return; } image_process(cv_ptr->image); //得到了cv::Mat类型的图象,在CvImage指针的image中,将结果传送给处理函数 // Output modified video stream image_pub_.publish(cv_ptr->toImageMsg()); } /*这是图象处理的主要函数,一般会把图像处理的主要程序写在这个函数中。这里的例子只是一个彩色图象到灰度图象的转化 到时候要修改就修改这里的函数即可 */ void image_process(cv::Mat& img) { // Draw an example circle on the video stream if (img.rows > 60 && img.cols > 60) { cv::circle(img, cv::Point(50, 50), 10, CV_RGB(255,0,0)); } // Update GUI Window cv::imshow(OPENCV_WINDOW, img); cv::waitKey(5); } }; //主函数 int main(int argc, char** argv) { ros::init(argc, argv, "image_converter"); ImageConverter ic; ros::spin(); return 0; }

4.CMakeLists.txt

进入包的目录,修改CmakeList.txt,在文件最后添加:

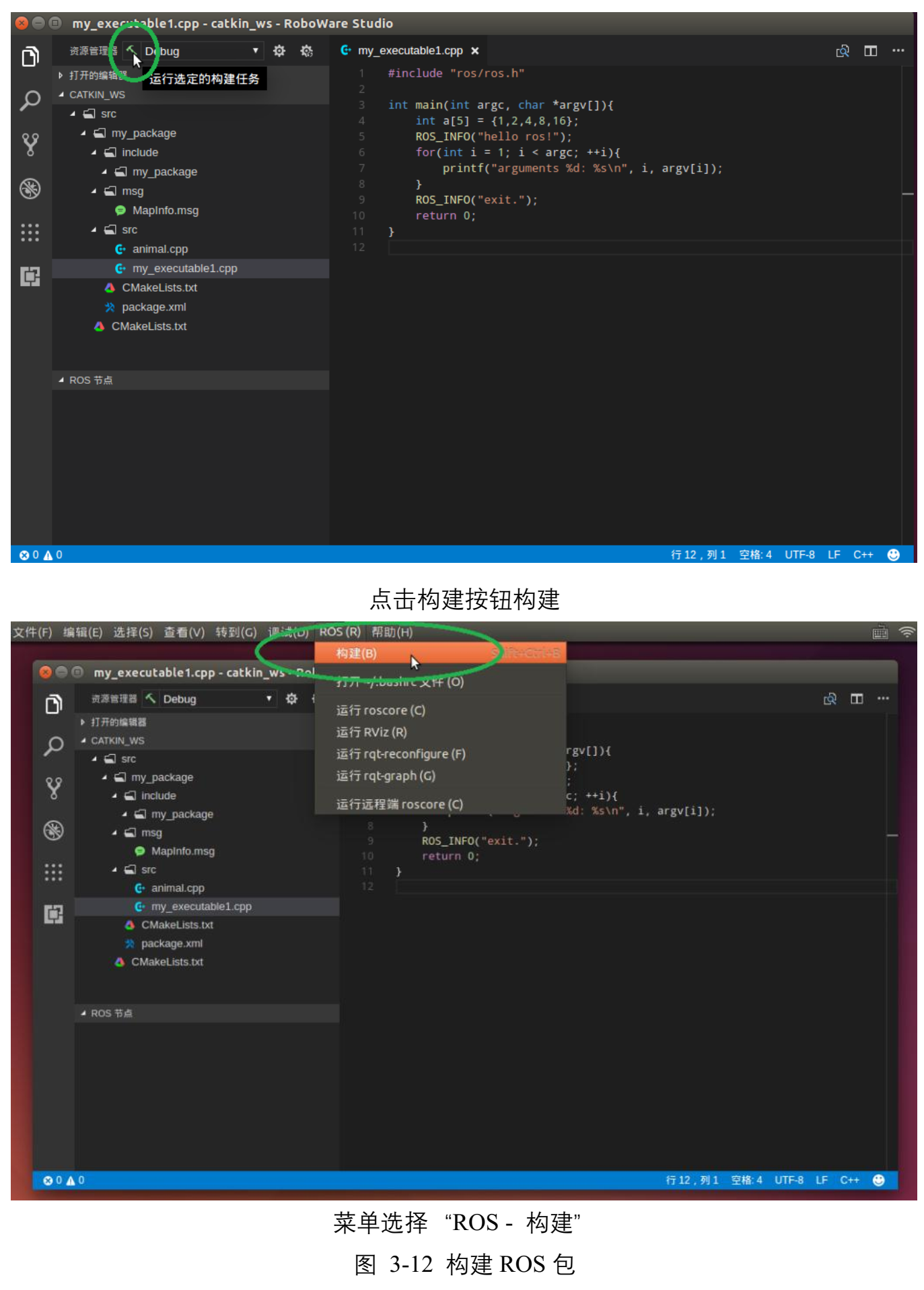

其中, Debug 和 Release 选项分别表示构建调试版和发布版, 默认构建方式为本地构建 。

有两种构建方法:

编译完成后,执行:

source devel/setup.bash

先打开一个终端运行roscore,用以节点之间的通信交互。

再打开一个终端运行rosrun usbcam usbcam_node

再打开一个终端运行rosrun opencvtest opencv_testcam

之后即可看到opencv处理后摄像头的图像。

如果找不到包,执行命令

rospack profile

source ~/catkin_ws/devel/setup.bash