作业要求来自于:https://edu.cnblogs.com/campus/gzcc/GZCC-16SE2/homework/3075

一.把爬取的内容保存取MySQL数据库

- import pandas as pd

- import pymysql

- from sqlalchemy import create_engine

- conInfo = "mysql+pymysql://user:passwd@host:port/gzccnews?charset=utf8"

- engine = create_engine(conInfo,encoding='utf-8')

- df = pd.DataFrame(allnews)

- df.to_sql(name = ‘news', con = engine, if_exists = 'append', index = False)

二.爬虫综合大作业

- 选择一个热点或者你感兴趣的主题。

- 选择爬取的对象与范围。

- 了解爬取对象的限制与约束。

- 爬取相应内容。

- 做数据分析与文本分析。

- 形成一篇文章,有说明、技术要点、有数据、有数据分析图形化展示与说明、文本分析图形化展示与说明。

- 文章公开发布。

参考:

爬了一下天猫上的Bra购买记录,有了一些羞羞哒的发现...

Python做了六百万字的歌词分析,告诉你中国Rapper都在唱些啥

分析了42万字歌词后,终于搞清楚民谣歌手唱什么了

十二星座的真实面目

唐朝诗人之间的关系到底是什么样的?

中国姓氏排行榜

三.爬虫注意事项

1.设置合理的爬取间隔,不会给对方运维人员造成压力,也可以防止程序被迫中止。

- import time

- import random

- time.sleep(random.random()*3)

2.设置合理的user-agent,模拟成真实的浏览器去提取内容。

- 首先打开你的浏览器输入:about:version。

- 用户代理:

- 收集一些比较常用的浏览器的user-agent放到列表里面。

- 然后import random,使用随机获取一个user-agent

- 定义请求头字典headers={’User-Agen‘:}

- 发送request.get时,带上自定义了User-Agen的headers

3.需要登录

发送request.get时,带上自定义了Cookie的headers

headers={’User-Agen‘:

'Cookie': }

4.使用代理IP

通过更换IP来达到不断高 效爬取数据的目的。

headers = {

"User-Agent": "",

}

proxies = {

"http": " ",

"https": " ",

}

response = requests.get(url, headers=headers, proxies=proxies)

# encoding=utf-8 import requests import time import re import csv import json from bs4 import BeautifulSoup as bs # 获取一页数据 def get_one_page(offset): # 设置请求头 headers={ 'Referer':'https://movie.douban.com/top250?start=0&filter=', 'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/67.0.3396.99 Safari/537.36' } url='https://movie.douban.com/top250?start='+str(offset)+'&filter=' try: time.sleep(1) response=requests.get(url,headers=headers) # 判断相应状态,200表示请求成功 if response.status_code == 200: return response.content except Exception as e: print('出错!') return None # 解析网页 def parse_page(offset): response=get_one_page(offset) if response: # print(response.decode('utf-8')) html=bs(response.decode('utf-8'),'html.parser') items=html.find_all('div',{'class':'item'}) if items: for item in items: a=item.find('div',{'class':'hd'}).a s=item.find('div',{'class':'star'}) bd=item.find('div',{'class':'bd'}) href=a.attrs['href'] title=a.span.get_text() quote=bd.find('p',{'class':'quote'}).span.get_text() star=s.find('span',{'class':'rating_num'}).get_text() conment_people=re.search(r'[0-9].*[^人评价</span>]',str(s.contents[len(s.contents)-2])).group() yield{ 'title':title, 'href':href, 'star':star, 'quote':quote, 'number':conment_people } else: print('没有找到该节点') # 保存数据到csv文件里面 def save_csv_files(contents,i): with open('douban_top250.csv','a',encoding='utf-8',newline='')as f: # 将python中的字典转换为json格式,并对输出中文指定ensure_ascii=False csvFile=csv.writer(f) if i ==0: csvFile.writerow(['名称','链接','星级','引言','评论人数']) datalist=[] for data in contents: csvList=[] csvList.append(data['title']) csvList.append(data['href']) csvList.append(data['star']) csvList.append(data['quote']) csvList.append(data['number']) datalist.append(csvList) csvFile.writerows(datalist) # 程序主入口 def main(offset,i): save_csv_files(parse_page(offset),i) if __name__=='__main__': for i in range(10): main(i*25,i)

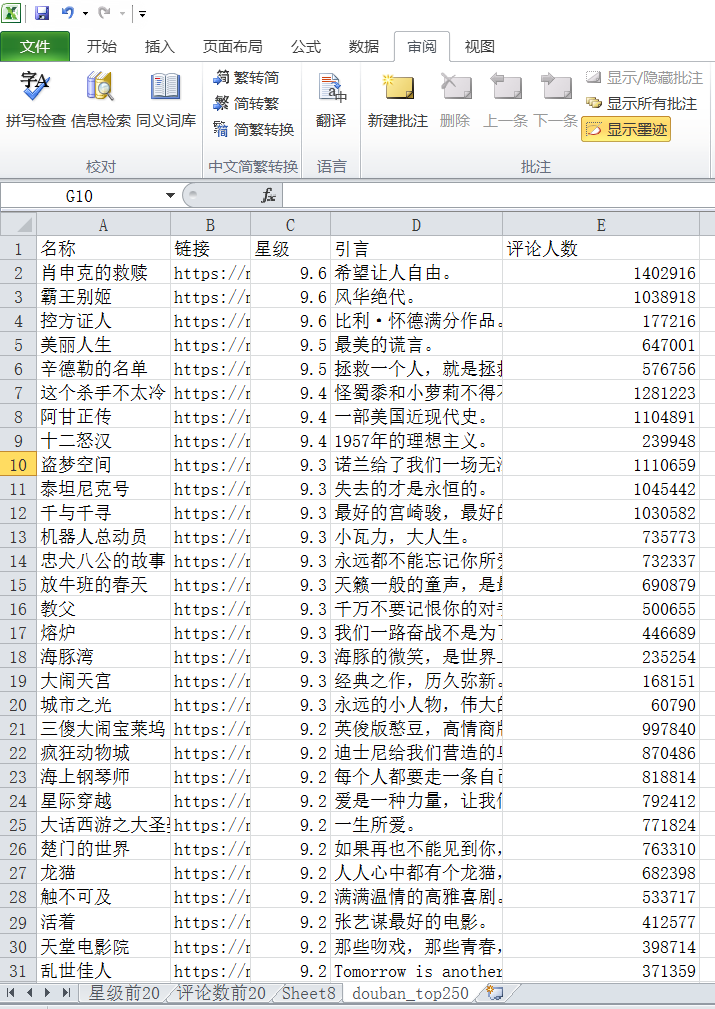

爬出来的CSV文件如下图所示

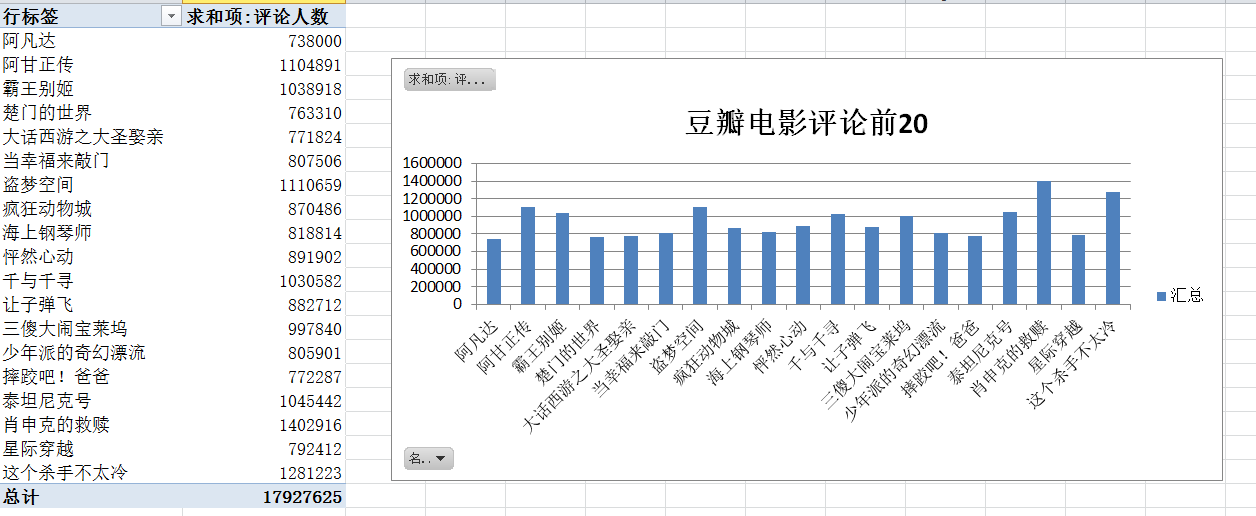

爬出来的豆瓣电影评论前20,如下图所示:

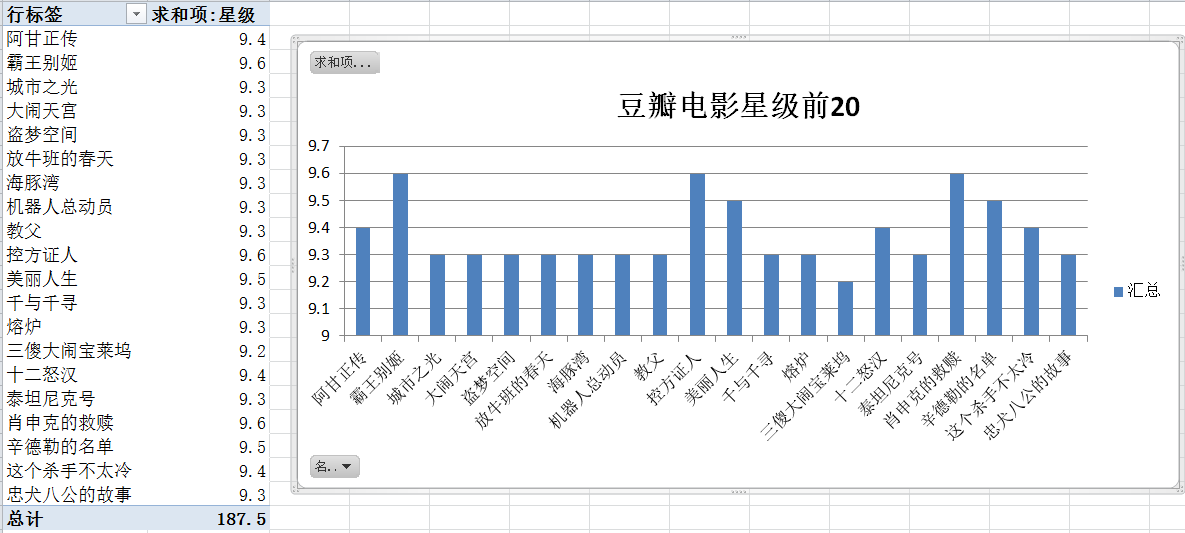

爬出来的豆瓣电影星级前20,如下图所示:

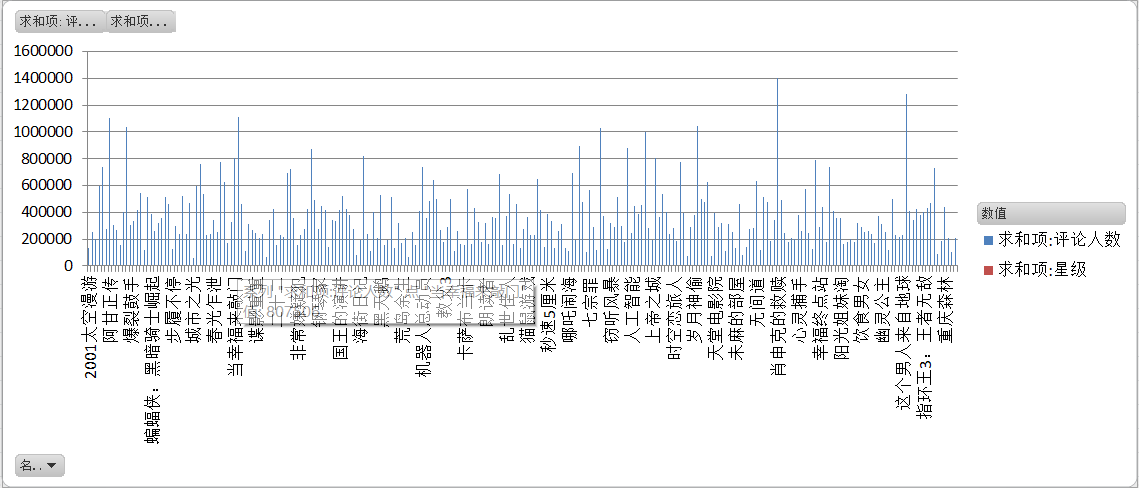

爬取星级数还有评论人数较高的数据,如下图所示:

按评论在词云制作出的词云统计如下图所示: