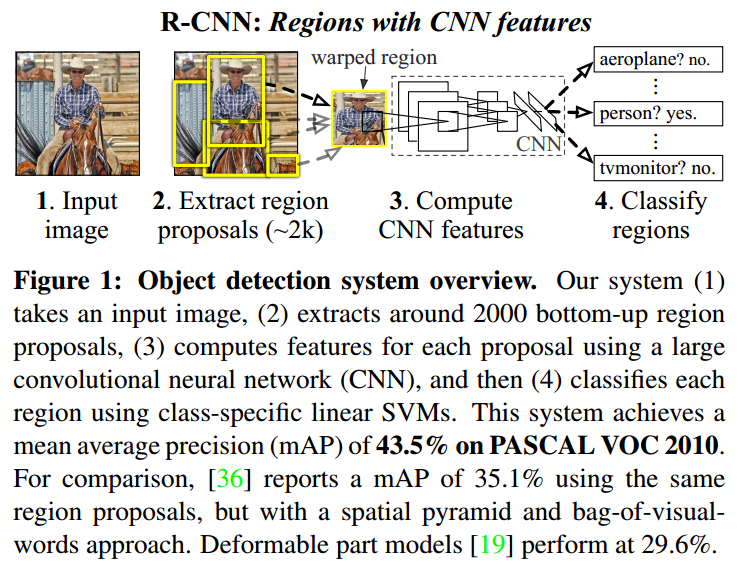

目标检测系列 --- RCNN: Rich feature hierarchies for accurate object detection and semantic segmentation Tech report

1. Architecture:

- Region proposals: 使用selective search获取region proposals,对于每一幅图像获取约2000个region proposals,并将每一个proposal wrap到需要的size,论文中为224*224,之所以要wrap到同一size,是因为Feature extraction网络的输入需要固定的size

- Feature extraction: 使用AlexNet获取每一个region proposal的feature vector(4096维)。

- SVM: 对于每一个类别,使用SVM分类器对feature map进行打分,以判断当前region proposal是所对应的物体类别还是background。图像中的每个region都会给出对应的score,并对这些region使用贪心的非极大值抑制(non-maximum suppression)来获取具有较高IOU的region,如保留IOU大于threshold=0.3的region。

在Inference阶段,作者指出了两个关键属性:

- 对于每种类别,所有的CNN参数共享

- 和其他的方法相比,此模型的feature vector的维度相对较低

2. Training:

- pre-training: 在ILSVRC 2012的数据集上进行分类训练,feature map的输出为4096维,全连接层的输出为1000(1000类)。

- fine-tuning: 主要是对Architecture中的model进行稍微的改动。训练数据集为PASCAL VOC 2007,将最后一层全连接层的输出换成21(20类+背景)。并通过selective search得到的region proposal作为网络的输入。

- 物体类别分类器:对于一个二值的分类器,需要有包含正负标签的样本,本模型的方法是当region proposal的IOU大于threshold(比如:0.5)时,将其标记为positive,其余的为negative,以此来对每个类别训练一个linear SVM。