问题描述

先来看看问题描述。

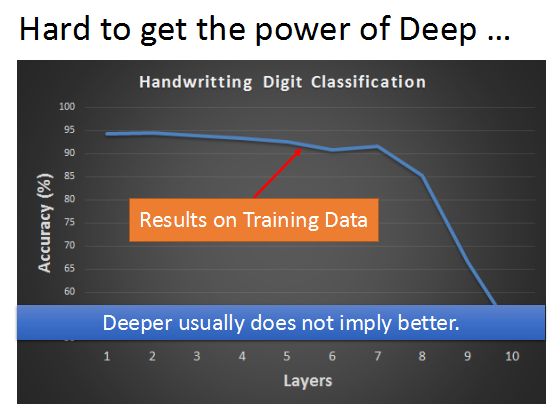

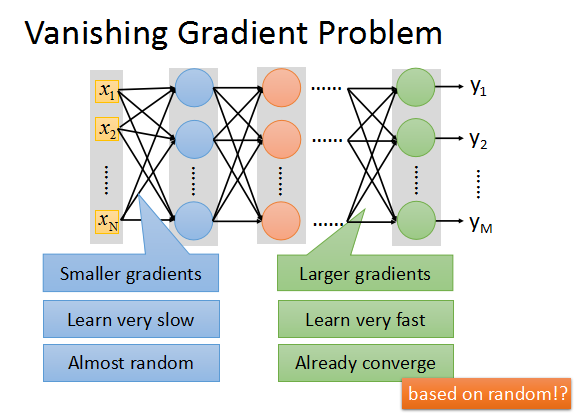

当我们使用sigmoid funciton 作为激活函数时,随着神经网络hidden layer层数的增加,训练误差反而加大了,如上图所示。

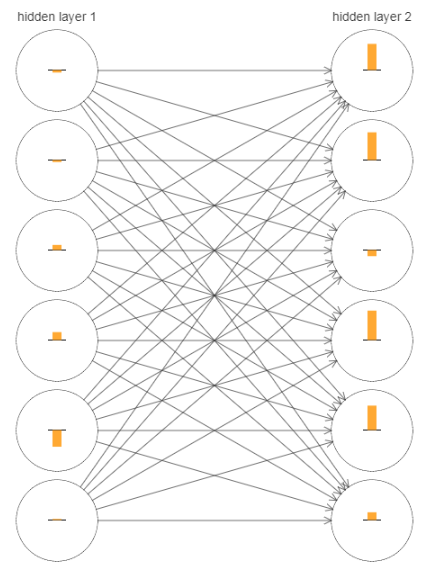

下面以2层隐藏层神经网络为例,进行说明。

结点中的柱状图表示每个神经元参数的更新速率(梯度)大小,有图中可以看出,layer2整体速度都要大于layer1.

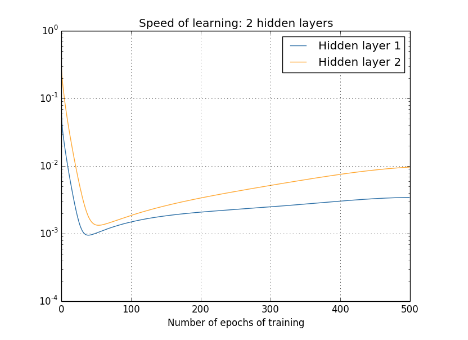

我们又取每层layer中参数向量的长度来粗略的估计该层的更新速率,得到下图。

可以看出,layer2的速率都要大于layer1.

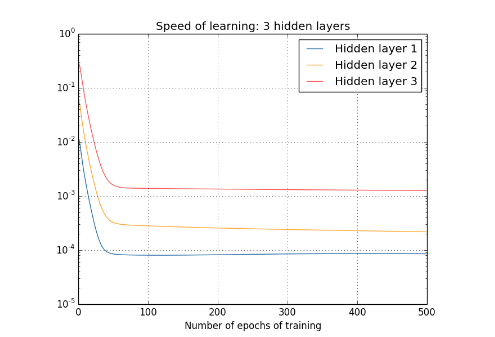

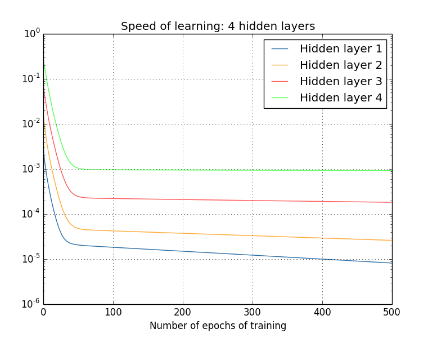

然后我们继续加深神经网络的层数。

可以得到下面的结论:

靠近输出层的hidden layer 梯度大,参数更新快,所以很快就会收敛;

而靠近输入层的hidden layer 梯度小,参数更新慢,几乎就和初始状态一样,随机分布。

在上面的四层隐藏层网络结构中,第一层比第四层慢了接近100倍!!

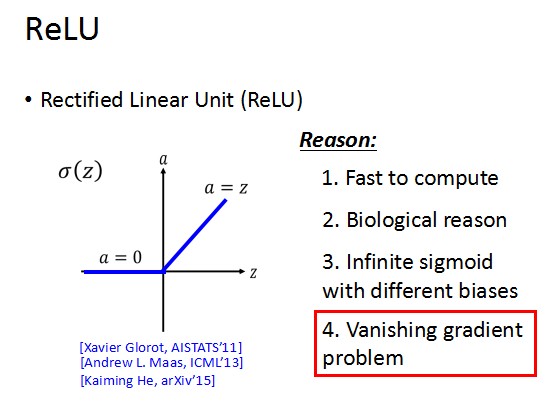

这种现象就是梯度弥散(vanishing gradient problem)。而在另一种情况中,前面layer的梯度通过训练变大,而后面layer的梯度指数级增大,这种现象又叫做梯度爆炸(exploding gradient problem)。

总的来说,就是在这个深度网络中,梯度相当不稳定(unstable)。

直观说明

那么为何会出现这种情况呢?

现在我们来直观的说明一下。

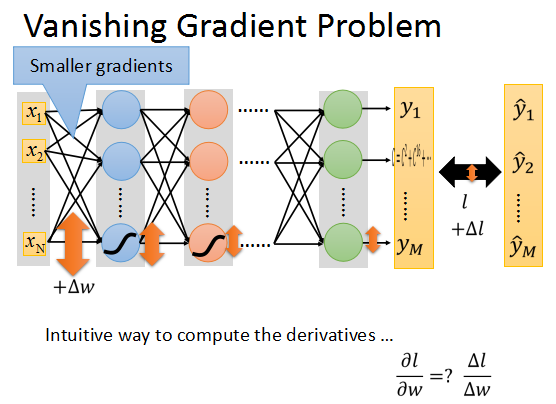

在上面的升级网络中,我们随意更新一个参数,加上一个Δw,(我们知道可以使用参数变化量来估计偏导数的大小)这个参数的更新会随着网络向前传播。

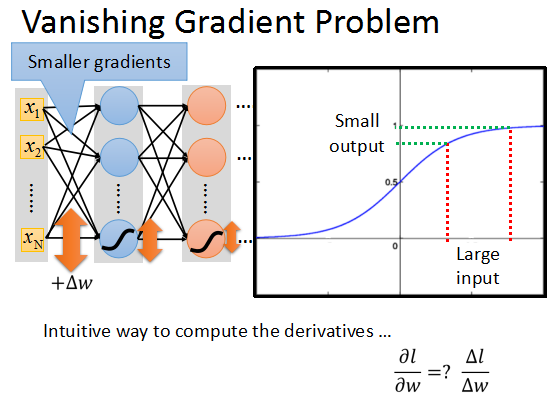

而根据sigmoid的特点,它会将+∞~-∞之间的输入压缩到0~1之间。当input的值更新时,output会有很小的更新。

又因为上一层的输出将作为后一层的输入,而输出经过sigmoid后更新速率会逐步衰减,直到输出层只会有微乎其微的更新。

数学说明

如果上面的例子还不够清楚,下面我们来看看,不是很严密的数学证明。

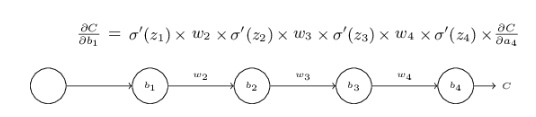

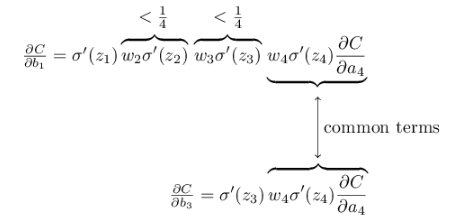

假设上面是一个三层hidden layer的神经网络,每一层只有一个neuron,我们下面的分析仅仅针对bias,w也是可以类比的。

C是损失函数。

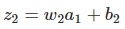

每一层的输入为z,输出为a,其中有z = w*a + b。

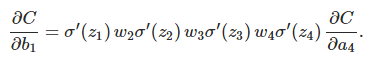

上面的等式∂c/∂b1由每一层的导数乘上对应的w最后乘上∂c/∂a4组成。

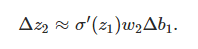

我们给b1一个小的改变Δb1,它会在神经网络中起连锁反应,影响最后的C。

我们使用变化率∂c/∂b1~Δc/Δb1来估计梯度。接下来可以进行递推了。

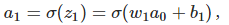

先来计算Δb1对a1的影响。σ(z)为sigmoid函数。

结果正好是上面∂c/∂b1等式的第一项,然后影响下一层的输出。

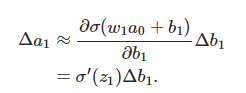

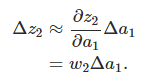

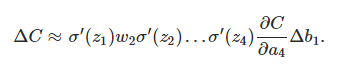

将上面推导出来的两个式子联合起来,就得到b1对于z2的影响:

再和∂c/∂b1等式对比一下,惊喜!!

然后的推导就是完全一样了,每个neuron的导数,乘上w,最终得到C的变化量:

两边除以Δb1:

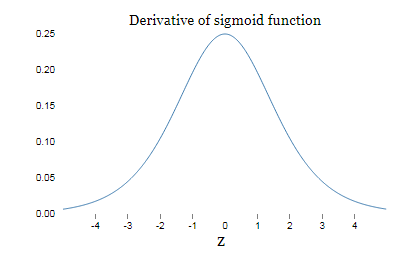

sigmoid导数图像:

sigmoid导数在0取得最大值1/4。

如果我们使用均值为0,方差为1的高斯分布初始化参数w,有|w| < 1,所以有:

可以看出随着网络层数的加深 的term也会变多,最后的乘积会指数级衰减,

的term也会变多,最后的乘积会指数级衰减,

这就是梯度弥散的根本原因。

而有人要问在train的时候如果参数w变得足够大,就可能使|w|>1, 就不满足了。

就不满足了。

的确这样不会有梯度弥散问题,根据我们之前的分析,当|W|>1时,会使后面的layer参数指数级增加,从而引发梯度爆炸。

解决方法

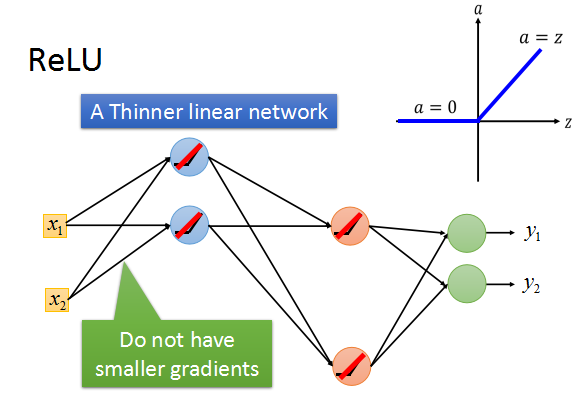

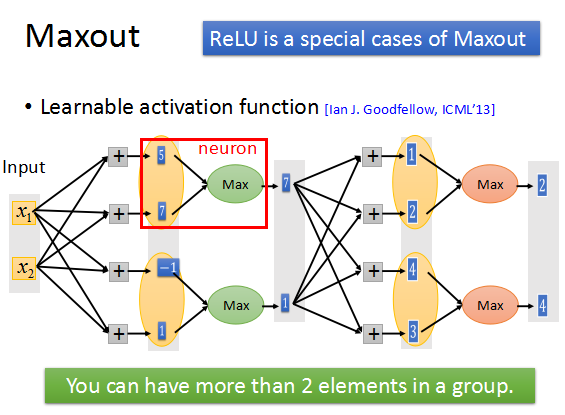

梯度不稳定的方法就是,使用其他激活函数替代sigmoid,比如Relu等等,这里就不细说了。