这里就不手动实现了,因为其实大同小异,把代码看懂了,下次要用的时候直接抄就行了。

vocab

class Vocab:

def __init__(self, tokens=None, min_freq=0, reserved_tokens=None):

counter = count_corpus(tokens)

if reserved_tokens == None:

reserved_tokens = []

self.uniq_token = ['unk'] + reserved_tokens

self.unk = 0

self.idx_to_token, self.token_to_idx = [], {}

counter = sorted(counter.items(), key =lambda x: x[1], reverse=True)

self.token_freqs = counter

self.uniq_token += [token for token, freq in counter if freq>=min_freq and token not in self.uniq_token]

for token in self.uniq_token:

self.idx_to_token.append(token)

self.token_to_idx[token] = len(self.idx_to_token) -1

def __getitem__(self, tokens):

if not isinstance(tokens, (list, tuple)):

return self.token_to_idx.get(tokens, 0)

return [self.__getitem__(token) for token in tokens]

def __len__(self):

return len(self.idx_to_token)

def to_tokens(self, indices):

if not isinstance(indices, (list, tuple)):

return self.token_to_idx.get(indices, 0)

return [self.to_tokens(indice) for indice in indices]

导入数据

import os

import torch

from d2l import torch as d2l

d2l.DATA_HUB['fra-eng'] = (d2l.DATA_URL + 'fra-eng.zip',

'94646ad1522d915e7b0f9296181140edcf86a4f5')

#@save

def read_data_nmt():

"""载入“英语-法语”数据集。"""

data_dir = d2l.download_extract('fra-eng')

with open(os.path.join(data_dir, 'fra.txt'), 'r',

encoding='utf-8') as f:

return f.read()

raw_text = read_data_nmt()

print(raw_text[:75])

用read函数直接把所有字符都读出来。

处理数据

预处理

拿到的数据还有一些问题,比如大小写,空格等问题,这里必须先做一个预处理。

def preprocess_nmt(text):

"""预处理“英语-法语”数据集。"""

def no_space(char, prev_char):

return char in set(',.!?') and prev_char != ' '

# 使用空格替换不间断空格

# 使用小写字母替换大写字母

text = text.replace('u202f', ' ').replace('xa0', ' ').lower()

# 在单词和标点符号之间插入空格

out = [' ' + char if i > 0 and no_space(char, text[i - 1]) else char

for i, char in enumerate(text)]

return ''.join(out)

text = preprocess_nmt(raw_text)

print(text[:80])

词元化

这里因为是机器翻译,所以我们选择用单词作为词元。

def tokenize_nmt(text, num_examples=None):

"""词元化“英语-法语”数据数据集。"""

source, target = [], []

for i, line in enumerate(text.split('

')):

if num_examples and i > num_examples:

break

parts = line.split(' ')

if len(parts) == 2:

source.append(parts[0].split(' '))

target.append(parts[1].split(' '))

return source, target

source, target = tokenize_nmt(text)

source[:6], target[:6]

注意,这里得到的source其实是一个二维数据,第二维是一个句子所有词元组成的list。

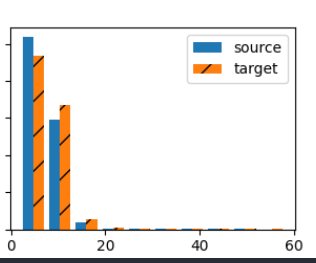

查看句子的长度分布

d2l.set_figsize()

_, _, patches = d2l.plt.hist(

[[len(l) for l in source], [len(l) for l in target]],

label=['source', 'target'])

for patch in patches[1].patches:

patch.set_hatch('/')

d2l.plt.legend(loc='upper right')

d2l.plt.savefig('test.png')

可以看到绝大部分句子都是在20个词以下的。

截断与填充

因为句子的长度不一样,所以我们需要做处理——如果小于给定的时间步长,就做填充,如果大于给定的时间步长就截断。

def truncate_pad(line, num_steps, padding_token):

"""截断或填充文本序列。"""

if len(line) > num_steps:

return line[:num_steps] # 截断

return line + [padding_token] * (num_steps - len(line)) # 填充

truncate_pad(src_vocab[source[0]], 10, src_vocab['<pad>'])

批量读取数据

def build_array_nmt(lines, vocab, num_steps):

"""将机器翻译的文本序列转换成小批量。"""

lines = [vocab[l] for l in lines]

lines = [l + [vocab['<eos>']] for l in lines]

array = torch.tensor([truncate_pad(

l, num_steps, vocab['<pad>']) for l in lines])

valid_len = (array != vocab['<pad>']).type(torch.int32).sum(1)

return array, valid_len

我们需要句子的实际长度,注意这个实际长度里实际上也包括了<eos>终止词。

返回data_iter

def load_data_nmt(batch_size, num_steps, num_examples=600):

"""返回翻译数据集的迭代器和词汇表。"""

text = preprocess_nmt(read_data_nmt())

source, target = tokenize_nmt(text, num_examples)

src_vocab = d2l.Vocab(source, min_freq=2,

reserved_tokens=['<pad>', '<bos>', '<eos>'])

tgt_vocab = d2l.Vocab(target, min_freq=2,

reserved_tokens=['<pad>', '<bos>', '<eos>'])

src_array, src_valid_len = build_array_nmt(source, src_vocab, num_steps)

tgt_array, tgt_valid_len = build_array_nmt(target, tgt_vocab, num_steps)

data_arrays = (src_array, src_valid_len, tgt_array, tgt_valid_len)

data_iter = d2l.load_array(data_arrays, batch_size)

return data_iter, src_vocab, tgt_vocab

train_iter, src_vocab, tgt_vocab = load_data_nmt(batch_size=2, num_steps=8)

总结

以后遇到句子这种情况就按照这种方式一步步处理下来。