①爬取工具:MySQL数据库

Navicat for mysql

编程语言python3

集成开发环境pycharm(community)

Python包管理器Anaconda3

②基本知识:(1)request库:

requests库的七个主要方法

requests.request() ==> 构造一个请求,支撑以下各方法的基础方法

requests.get() ==> 获取HTML网页的主要方法,对应于HTTP的GET

requests.head() ==> 获取HTML网页头信息的方法,对应于HTTP的HEAD

requests.post() ==> 向HTML网页提交POST请求的方法,对应于HTTP的POST

requests.put() ==> 向HTML网页提交PUT请求的方法,对应于HTTP的PUT

requests.patch() ==> 向HTML网页提交局部修改请求,对应于HTTP的PATCH

requests.delete() ==> 向HTML页面提交删除请求,对应于HTTP的DELETE

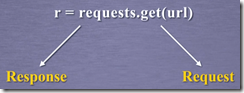

Requests库的两个重要对象分别是Response和Request

其中Response对象包含爬虫返回的全部信息

Response对象的属性

r.status_code ==> HTTP请求的返回状态,200表示连接成功,404表示连接失败

r.text ==> HTTP响应内容的字符串形式,即,url对应的页面内容

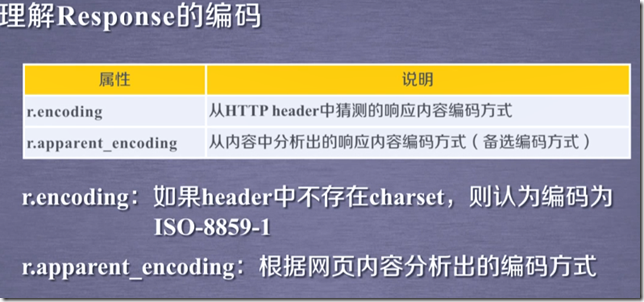

r.encoding ==> 从HTTP header中猜测的响应内容编码方式

r.apparent_encoding ==> 从内容中分析出的响应内容编码方式(备选编码方式)

r.content ==> HTTP响应内容的二进制形式

Response的编码

Requests库的异常

requests.ConnectionError ==> 网络连接错误异常,如DNS查询失败、拒绝连接等

requests.HTTPError ==> HTTP错误异常

requests.URLRequired ==> URL缺失异常

requests.TooManyRedirects ==> 超过最大重定向次数,产生重定向异常

requests.ConnectTimeout ==> 连接远程服务器超时异常

requests.Timeout ==> 请求URL超时,产生超时异常

爬取网页的通用代码框架

import requests def getHTMLText(url): try: r=requests.get(url,timeout=30) r.raise_for_status() #如果状态不是200,引发HTTPError异常 r.encoding=r.apparent_encodinng return r.text except: return "产生异常" if _name_ == "_main_": url="http://www.baidu.com" print(getHTMLText(url))

Requests函数包括十三个访问控制参数

requests.request(method,url,**kwargs)

**kwargs: 控制访问的参数,均为可选项

①params: 字典或字节序列,作为参数增加到url中

>>>kv={'key1':'value1','key2':'value2'}

>>>r=requests.request('GET','http://python123.io/ws',params=kv)

>>>print(r,url)

http://python123.io/ws?key1=value1&key2=value2

②data: 字典、字节序列或文件对象,作为Request的内容

>>>kv=('key1':'value1','key2':'value2') >>>r=requests.request('POST','http://python123.io/ws',data=kv) >>>body='主体内容' >>>r=requests.request('POST','http://python123.io/ws',data=body)

③json: JSON格式的数据,作为Request的内容

>>>kv={'key1':'value1'}

>>>r=requests.request('POST','http://python123.io/ws',json=kv)

④headers: 字典,HTTP定制头

>>>hd={'user-agent';'Chrome/10'}

>>>r=requests.request('POST','http://python123.io/ws',headers=hd)

⑤cookies(是request库的高级功能): 字典或Cookie.Jar , Request中的cookie

⑥auth(是request库的高级功能): 元组, 支持HTTP认证功能

⑦files: 字典类型,传输文件

>>>fs={'file': open('data.xls','rb')}

>>>r=requests.request('POST','http://python123.io/ws',files=fs)

⑧timeout: 设定超时时间,秒为单位

>>>r=requests.request('GET','http://www.baidu.com',timeout=10)

⑨proxies: 字典类型,设定访问代理服务器,可以增加登录认证

>>>pxs={'http':'http://user:pass@10.10.1:1234'

'https':'https://10.10.10.1:4321'}

>>>r=requests.request('GET','http://www.baidu.com',proxies=pxs)

⑩allow_redirects: True/False,默认为True,重定向开关

⑪stream: True/False,默认为True,获取内容立即下载开关

⑫verify: True/False,默认为True,认证SSL证书开关

⑬cert: 本地SSL证书路径

Requests库网络爬取简单实例

①百度360搜索关键词提交:

搜索引擎关键词提交接口:

百度的关键词接口:http://www.baidu.com/s?wd=keyword

360的关键词接口:http://www.so.com/s?q=keyword

百度搜索全代码:

import requests keyword="Python" try: kv={'wd':keyword} r=requests.get("http://www.baidu.com/s" , params=kv) print(r.request.url) r.raise_for_status() print(len(r.text)) except: print("爬取失败")

360搜索全代码:

import requests keyword="Python" try: kv={'q':keyword} r=requests.get(http://www.so.com/s , params=kv) print(r.request.url) r.raise_for_status() print(len(r.text)) except: print("爬取失败")

②网络图片的爬取和存储:

网络图片链接的格式:

http://www.example.com/picture.jpg

图片爬取全代码:

import requests import os url="http://image.ngchina.com.cn/2019/0707/20190707123014213.jpg" root="D://pictures//" path=root+url.split('/')[-1] try: if not os.path.exists(root): os.mkdir(root) if not os.path.exists(path): r=requests.get(url) with open(path,'wb') as f: f.write(r.content) f.close() print("文件保存成功") else: print("文件已存在") except: print("爬取失败")

③IP地址归属地的自动查询:

IP地址查询的全代码:

import requests url="http://m.ip138.com/ip.asp?ip=" try: r=requests.get(url+'202.204.80.112') r.raise_for_status() r.encoding=r.apparent_encoding print(r.text[-500:]) except: print("爬取失败")

-

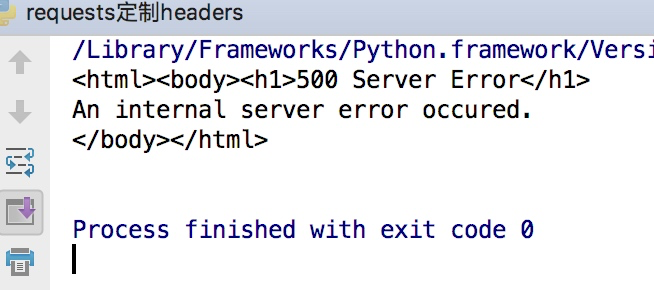

④添加headers:

-

和前面我们将urllib模块的时候一样,我们同样可以定制headers的信息,如当我们直接通过requests请求知乎网站的时候,默认是无法访问的,会得到如下错误:

因为访问知乎需要头部信息,这个时候我们在谷歌浏览器里输入chrome://version,就可以看到用户代理,将用户代理添加到头部信息

import requests headers = { "User-Agent":"Mozilla/5.0 (Macintosh; Intel Mac OS X 10_12_4) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.36" } response =requests.get("https://www.zhihu.com",headers=headers) print(response.text)