1:经典卷积神经网络

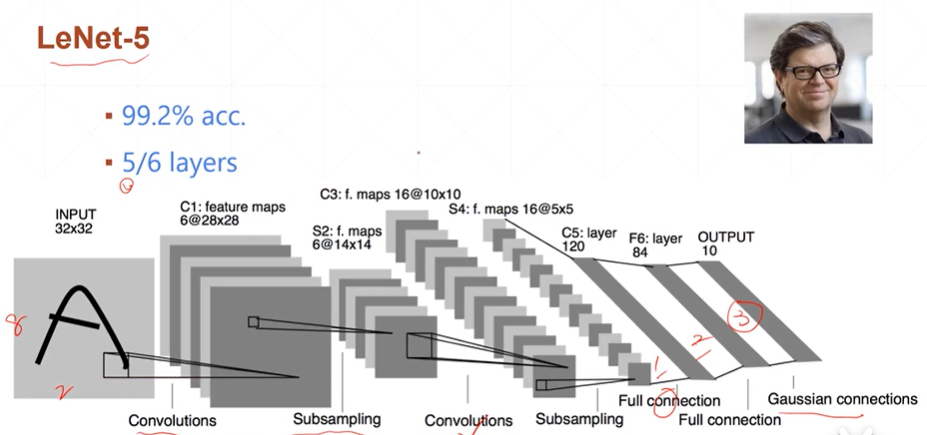

(1)LeNet-5

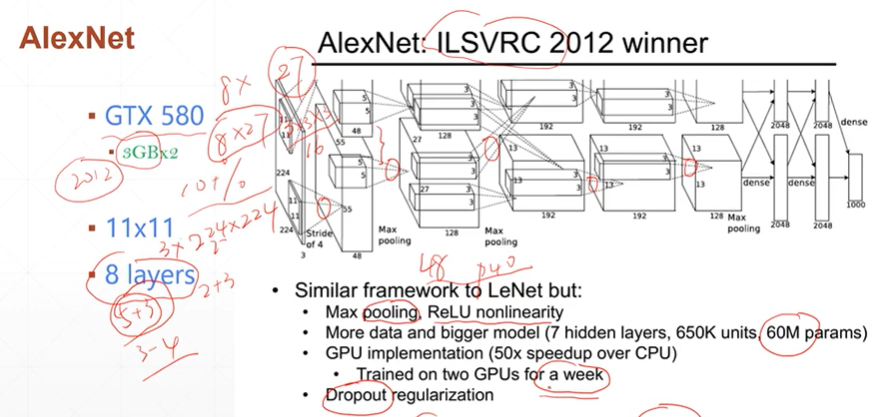

(2)AlexNet

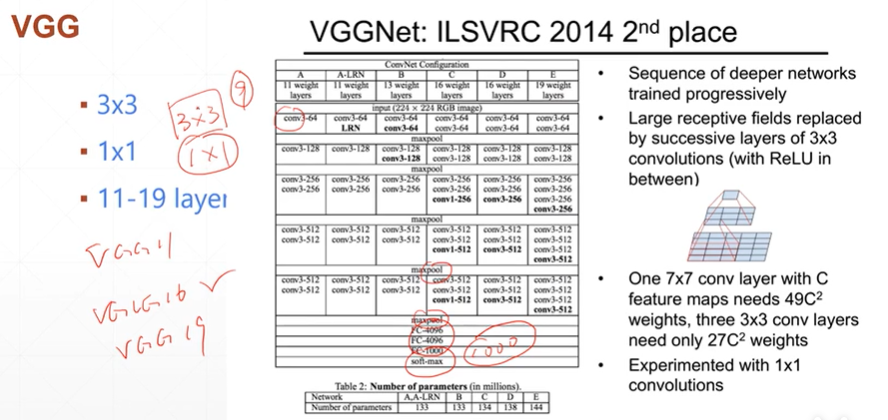

(3)VGG

【注】VGG发现更小的卷积核有更好的效果

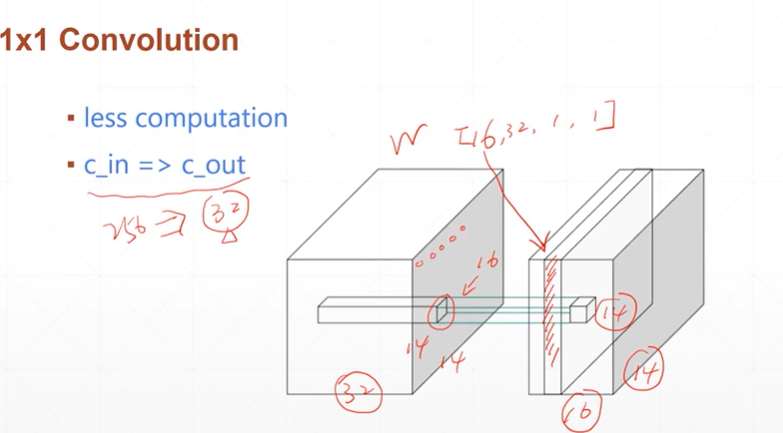

[注]c为channel

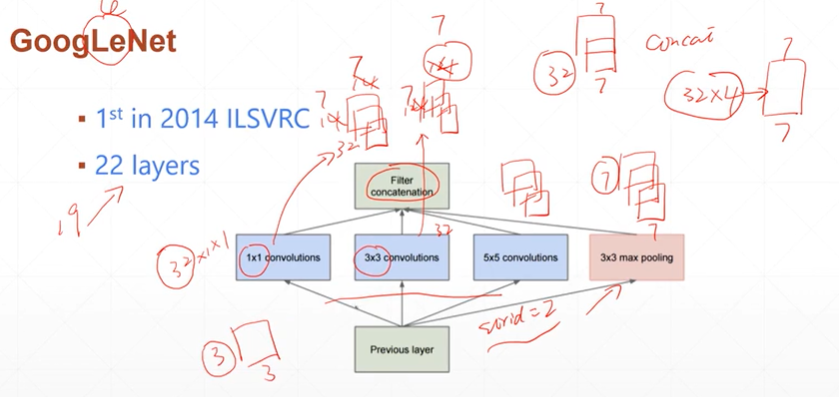

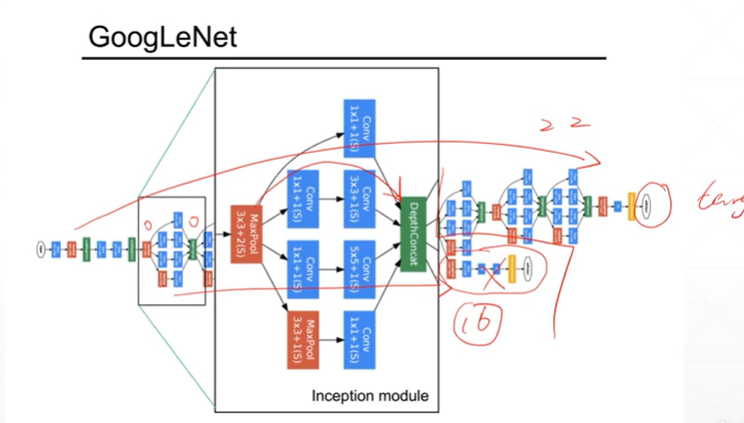

(4)GoogLeNet

inception网络结构

[注]Inception module主要是使用多个不同大小的卷积核,使得GoogLeNet在同一层实现了不多个不同大小且不同类型的卷积核的使用。(之前的卷积核都是大小相同类型不同)

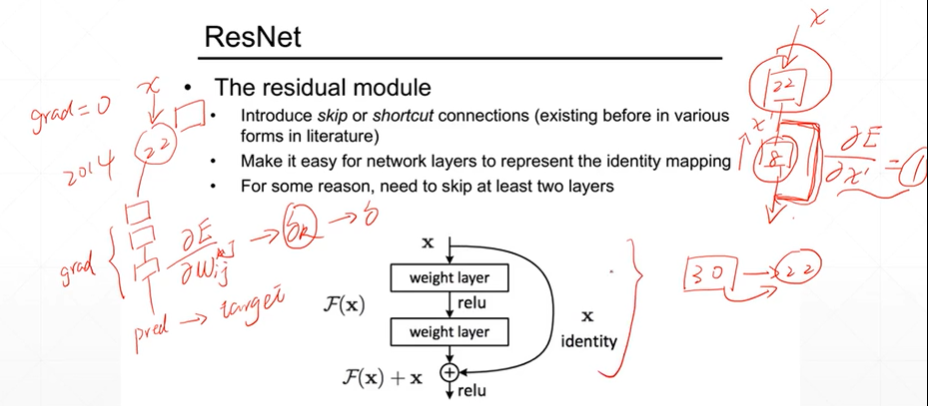

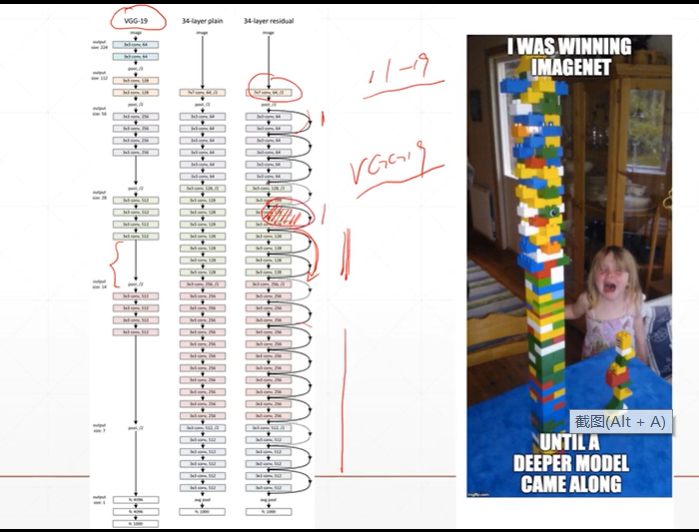

(5)ResNet深度残差网络

(5.1.1)residual module模块的介绍

【注】当一个34层的网络,使用以上图中的shortcut connection module则会退化成一个19层的VGG卷积神经网络

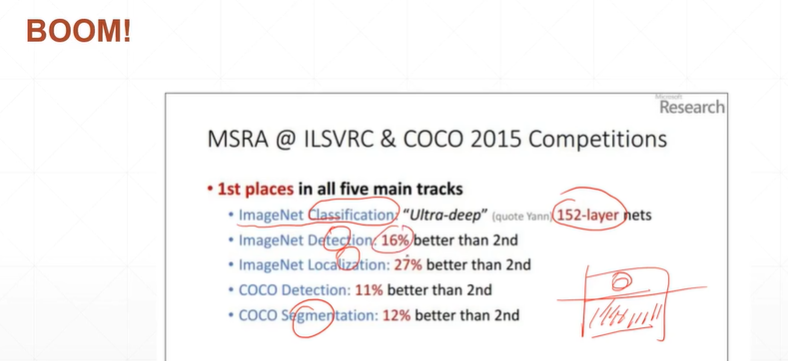

(5.1.2)残差网络在应用中的提升

(5.1.3)为什么叫做残差网络

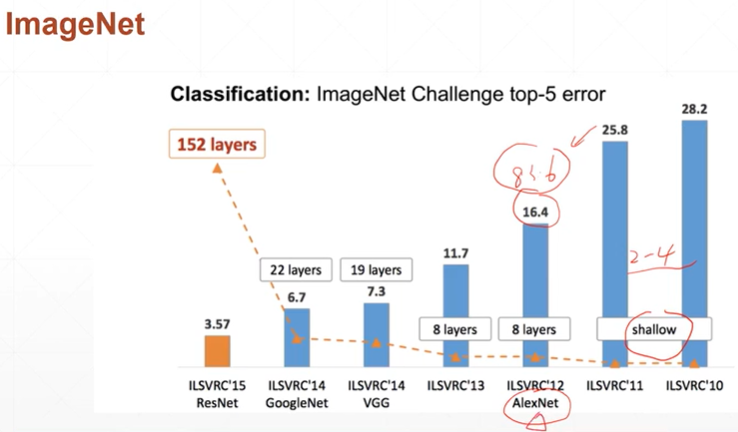

2:经典卷积神经网络的对比

[注]从中可以发现inceptionV3和inceptionV4以及ResNet网络的计算量小且效果较好

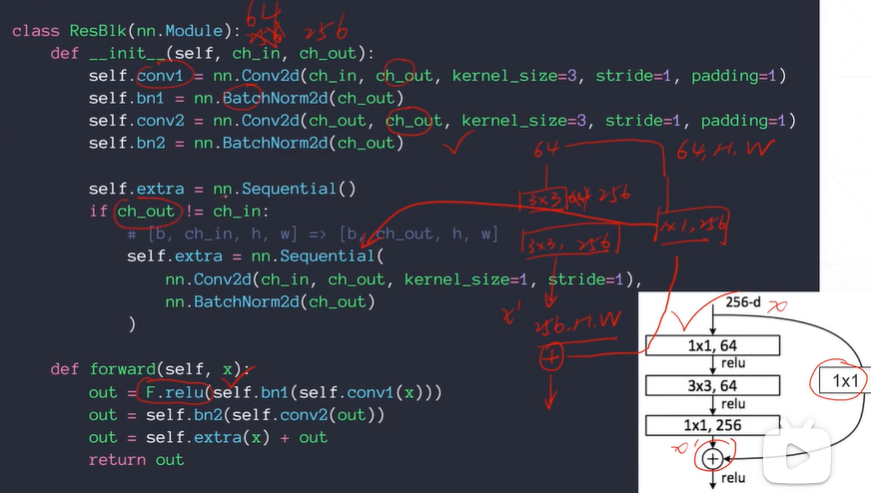

3:实现

【注】__int__()主要是实现基本单元的建立,其中的nn.Sequential主要是为了实现out和输入x的维度保持一致。