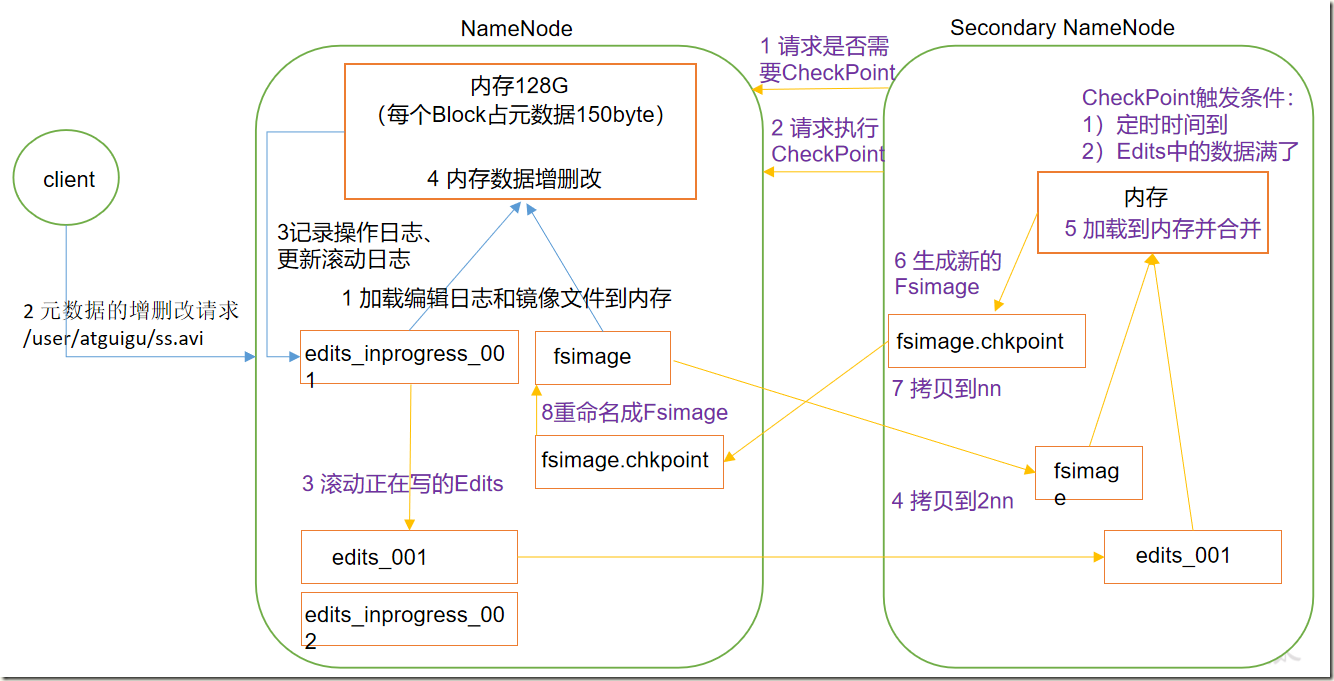

一、NameNode和SecondaryNameNode

1.1、NN和2NN工作机制

思考:NameNode中的元数据是存储在哪里的?

首先,我们做个假设,如果存储在NameNode节点的磁盘中,因为经常需要进行随机访问,还有响应客户请求,必然是效率过低。因此,元数据需要存放在内存中。但如果只存在内存中,一旦断电,元数据丢失,整个集群就无法工作了。因此产生在磁盘中备份元数据的FsImage。

这样又会带来新的问题,当在内存中的元数据更新时,如果同时更新FsImage,就会导致效率过低,但如果不更新,就会发生一致性问题,一旦NameNode节点断电,就会产生数据丢失。因此,引入Edits文件(只进行追加操作,效率很高)。每当元数据有更新或者添加元数据时,修改内存中的元数据并追加到Edits中。这样,一旦NameNode节点断电,可以通过FsImage和Edits的合并,合成元数据。

但是,如果长时间添加数据到Edits中,会导致该文件数据过大,效率降低,而且一旦断电,恢复元数据需要的时间过长。因此,需要定期进行FsImage和Edits的合并,如果这个操作由NameNode节点完成,又会效率过低。因此,引入一个新的节点SecondaryNamenode,专门用于FsImage和Edits的合并。

1. 第一阶段:NameNode启动

(1)第一次启动NameNode格式化后,创建Fsimage和Edits文件。如果不是第一次启动,直接加载编辑日志和镜像文件到内存。

(2)客户端对元数据进行增删改的请求。

(3)NameNode记录操作日志,更新滚动日志。

(4)NameNode在内存中对数据进行增删改。

2. 第二阶段:Secondary NameNode工作

(1)Secondary NameNode询问NameNode是否需要CheckPoint。直接带回NameNode是否检查结果。

(2)Secondary NameNode请求执行CheckPoint。

(3)NameNode滚动正在写的Edits日志。

(4)将滚动前的编辑日志和镜像文件拷贝到Secondary NameNode。

(5)Secondary NameNode加载编辑日志和镜像文件到内存,并合并。

(6)生成新的镜像文件fsimage.chkpoint。

(7)拷贝fsimage.chkpoint到NameNode。

(8)NameNode将fsimage.chkpoint重新命名成fsimage。

NN和2NN工作机制详解:

Fsimage:NameNode内存中元数据序列化后形成的文件。

Edits:记录客户端更新元数据信息的每一步操作(可通过Edits运算出元数据)。

NameNode启动时,先滚动Edits并生成一个空的edits.inprogress,然后加载Edits和Fsimage到内存中,此时NameNode内存就持有最新的元数据信息。Client开始对NameNode发送元数据的增删改的请求,这些请求的操作首先会被记录到edits.inprogress中(查询元数据的操作不会被记录在Edits中,因为查询操作不会更改元数据信息),如果此时NameNode挂掉,重启后会从Edits中读取元数据的信息。然后,NameNode会在内存中执行元数据的增删改的操作。

由于Edits中记录的操作会越来越多,Edits文件会越来越大,导致NameNode在启动加载Edits时会很慢,所以需要对Edits和Fsimage进行合并(所谓合并,就是将Edits和Fsimage加载到内存中,照着Edits中的操作一步步执行,最终形成新的Fsimage)。SecondaryNameNode的作用就是帮助NameNode进行Edits和Fsimage的合并工作。

SecondaryNameNode首先会询问NameNode是否需要CheckPoint(触发CheckPoint需要满足两个条件中的任意一个,定时时间到和Edits中数据写满了)。直接带回NameNode是否检查结果。SecondaryNameNode执行CheckPoint操作,首先会让NameNode滚动Edits并生成一个空的edits.inprogress,滚动Edits的目的是给Edits打个标记,以后所有新的操作都写入edits.inprogress,其他未合并的Edits和Fsimage会拷贝到SecondaryNameNode的本地,然后将拷贝的Edits和Fsimage加载到内存中进行合并,生成fsimage.chkpoint,然后将fsimage.chkpoint拷贝给NameNode,重命名为Fsimage后替换掉原来的Fsimage。NameNode在启动时就只需要加载之前未合并的Edits和Fsimage即可,因为合并过的Edits中的元数据信息已经被记录在Fsimage中。

1.2、Fsimage和Edits解析

1.2.1、Fsimage和Edits概念

NameNode被格式化之后,将在/opt/module/hadoop-2.7.2/data/tmp/dfs/name/current目录中产生如下文件:

-rw-rw-r-- 1 hadoop hadoop 352 Jan 19 16:39 fsimage_0000000000000000000 -rw-rw-r-- 1 hadoop hadoop 62 Jan 19 16:39 fsimage_0000000000000000000.md5 -rw-rw-r-- 1 hadoop hadoop 2 Jan 19 16:39 seen_txid -rw-rw-r-- 1 hadoop hadoop 202 Jan 19 16:39 VERSION [hadoop@hadoop102 current]$ cat seen_txid 0 [hadoop@hadoop102 current]$ cat VERSION #Tue Jan 19 16:39:03 CST 2021 namespaceID=104954187 clusterID=CID-5d41c1f7-5c1a-4644-ac9a-e38d371b292e cTime=0 storageType=NAME_NODE blockpoolID=BP-1130304447-10.0.0.102-1611045543710 layoutVersion=-63

(1)Fsimage文件:HDFS文件系统元数据的一个永久性的检查点,其中包含HDFS文件系统的所有目录和文件inode的序列化信息。

(2)Edits文件:存放HDFS文件系统的所有更新操作的路径,文件系统客户端执行的所有写操作首先会被记录到Edits文件中。

(3)seen_txid文件保存的是一个数字,就是最后一个edits_的数字

(4)每次NameNode启动的时候都会将Fsimage文件读入内存,加载Edits里面的更新操作,保证内存中的元数据信息是最新的、同步的,可以看成NameNode启动的时候就将Fsimage和Edits文件进行了合并。

1.2.2、oiv查看Fsimage文件

(1)查看oiv和oev命令

[hadoop@hadoop102 current]$ hdfs oiv apply the offline fsimage viewer to an fsimage oev apply the offline edits viewer to an edits file

(2)基本语法

hdfs oiv -p 文件类型 -i镜像文件 -o 转换后文件输出路径

(3)案例实操

[hadoop@hadoop102 current]$ pwd /opt/module/hadoop-2.7.2/data/tmp/dfs/name/current [hadoop@hadoop102 current]$ hdfs oiv -p XML -i fsimage_0000000000000000025 -o /opt/module/hadoop-2.7.2/fsimage.xml [hadoop@hadoop102 current]$ cat /opt/module/hadoop-2.7.2/fsimage.xml

将显示的xml文件内容拷贝到Idea中创建的xml文件中,并格式化,部分显示如下:

<inode> <id>16386</id> <type>DIRECTORY</type> <name>user</name> <mtime>1512722284477</mtime> <permission>atguigu:supergroup:rwxr-xr-x</permission> <nsquota>-1</nsquota> <dsquota>-1</dsquota> </inode> <inode> <id>16387</id> <type>DIRECTORY</type> <name>atguigu</name> <mtime>1512790549080</mtime> <permission>atguigu:supergroup:rwxr-xr-x</permission> <nsquota>-1</nsquota> <dsquota>-1</dsquota> </inode> <inode> <id>16389</id> <type>FILE</type> <name>wc.input</name> <replication>3</replication> <mtime>1512722322219</mtime> <atime>1512722321610</atime> <perferredBlockSize>134217728</perferredBlockSize> <permission>atguigu:supergroup:rw-r--r--</permission> <blocks> <block> <id>1073741825</id> <genstamp>1001</genstamp> <numBytes>59</numBytes> </block> </blocks> </inode >

可以看出,Fsimage中没有记录块所对应DataNode。在集群启动后,要求DataNode上报数据块信息,并间隔一段时间后再次上报。

1.2.3、oev查看Edits文件

(1)基本语法

hdfs oev -p 文件类型 -i编辑日志 -o 转换后文件输出路径

(2)案例实操

[hadoop@hadoop102 current]$ hdfs oev -p XML -i edits_0000000000000000012-0000000000000000013 -o /opt/module/hadoop-2.7.2/edits.xml [hadoop@hadoop102 current]$ cat /opt/module/hadoop-2.7.2/edits.xml

将显示的xml文件内容拷贝到Eclipse中创建的xml文件中,并格式化。显示结果如下。

<?xml version="1.0" encoding="UTF-8"?> <EDITS> <EDITS_VERSION>-63</EDITS_VERSION> <RECORD> <OPCODE>OP_START_LOG_SEGMENT</OPCODE> <DATA> <TXID>129</TXID> </DATA> </RECORD> <RECORD> <OPCODE>OP_ADD</OPCODE> <DATA> <TXID>130</TXID> <LENGTH>0</LENGTH> <INODEID>16407</INODEID> <PATH>/hello7.txt</PATH> <REPLICATION>2</REPLICATION> <MTIME>1512943607866</MTIME> <ATIME>1512943607866</ATIME> <BLOCKSIZE>134217728</BLOCKSIZE> <CLIENT_NAME>DFSClient_NONMAPREDUCE_-1544295051_1</CLIENT_NAME> <CLIENT_MACHINE>192.168.1.5</CLIENT_MACHINE> <OVERWRITE>true</OVERWRITE> <PERMISSION_STATUS> <USERNAME>atguigu</USERNAME> <GROUPNAME>supergroup</GROUPNAME> <MODE>420</MODE> </PERMISSION_STATUS> <RPC_CLIENTID>908eafd4-9aec-4288-96f1-e8011d181561</RPC_CLIENTID> <RPC_CALLID>0</RPC_CALLID> </DATA> </RECORD> <RECORD> <OPCODE>OP_ALLOCATE_BLOCK_ID</OPCODE> <DATA> <TXID>131</TXID> <BLOCK_ID>1073741839</BLOCK_ID> </DATA> </RECORD> <RECORD> <OPCODE>OP_SET_GENSTAMP_V2</OPCODE> <DATA> <TXID>132</TXID> <GENSTAMPV2>1016</GENSTAMPV2> </DATA> </RECORD> <RECORD> <OPCODE>OP_ADD_BLOCK</OPCODE> <DATA> <TXID>133</TXID> <PATH>/hello7.txt</PATH> <BLOCK> <BLOCK_ID>1073741839</BLOCK_ID> <NUM_BYTES>0</NUM_BYTES> <GENSTAMP>1016</GENSTAMP> </BLOCK> <RPC_CLIENTID></RPC_CLIENTID> <RPC_CALLID>-2</RPC_CALLID> </DATA> </RECORD> <RECORD> <OPCODE>OP_CLOSE</OPCODE> <DATA> <TXID>134</TXID> <LENGTH>0</LENGTH> <INODEID>0</INODEID> <PATH>/hello7.txt</PATH> <REPLICATION>2</REPLICATION> <MTIME>1512943608761</MTIME> <ATIME>1512943607866</ATIME> <BLOCKSIZE>134217728</BLOCKSIZE> <CLIENT_NAME></CLIENT_NAME> <CLIENT_MACHINE></CLIENT_MACHINE> <OVERWRITE>false</OVERWRITE> <BLOCK> <BLOCK_ID>1073741839</BLOCK_ID> <NUM_BYTES>25</NUM_BYTES> <GENSTAMP>1016</GENSTAMP> </BLOCK> <PERMISSION_STATUS> <USERNAME>atguigu</USERNAME> <GROUPNAME>supergroup</GROUPNAME> <MODE>420</MODE> </PERMISSION_STATUS> </DATA> </RECORD> </EDITS >

NameNode如何确定下次开机启动的时候合并哪些Edits?seen_txid记录最新位置

1.3、CheckPoint时间设置

(1)通常情况下,SecondaryNameNode每隔一小时执行一次。可以在hdfs-default.xml中配置

<property> <name>dfs.namenode.checkpoint.period</name> <value>3600</value> </property>

(2)一分钟检查一次操作次数,当操作次数达到1百万时,SecondaryNameNode执行一次。

<property> <name>dfs.namenode.checkpoint.txns</name> <value>1000000</value> <description>操作动作次数</description> </property> <property> <name>dfs.namenode.checkpoint.check.period</name> <value>60</value> <description> 1分钟检查一次操作次数</description> </property >

1.4、NameNode故障处理

1.4.1、方法一

将SecondaryNameNode中数据拷贝到NameNode存储数据的目录,可能会丢数据

1) kill -9 NameNode进程

2) 删除NameNode存储的数据(/opt/module/hadoop-2.7.2/data/tmp/dfs/name)

[hadoop@hadoop102 name]# rm -fr /opt/module/hadoop-2.7.2/data/tmp/dfs/name/*

3. 拷贝SecondaryNameNode中数据到原NameNode存储数据目录

[hadoop@hadoop102 dfs]$ pwd /opt/module/hadoop-2.7.2/data/tmp/dfs [hadoop@hadoop102 dfs]$ scp -r hadoop@hadoop104:/opt/module/hadoop-2.7.2/data/tmp/dfs/namesecondary/* ./name/

4. 重新启动NameNode

[hadoop@hadoop102 hadoop-2.7.2]$ sbin/hadoop-daemon.sh start namenode starting namenode, logging to /opt/module/hadoop-2.7.2/logs/hadoop-hadoop-namenode-hadoop102.out [hadoop@hadoop102 hadoop-2.7.2]$ jps 6900 DataNode 6021 NodeManager 7975 NameNode 8047 Jps

1.4.2、方法二

使用-importCheckpoint选项启动NameNode守护进程,从而将SecondaryNameNode中数据拷贝到NameNode目录中。

1)修改hdfs-site.xml中的

<property> <name>dfs.namenode.checkpoint.period</name> <value>120</value> </property> <property> <name>dfs.namenode.name.dir</name> <value>/opt/module/hadoop-2.7.2/data/tmp/dfs/name</value> </property>

2) kill -9 NameNode进程

3) 删除NameNode存储的数据(/opt/module/hadoop-2.7.2/data/tmp/dfs/name)

[hadoop@hadoop102 hadoop-2.7.2]$ rm -rf /opt/module/hadoop-2.7.2/data/tmp/dfs/name/*

4. 如果SecondaryNameNode不和NameNode在一个主机节点上,需要将SecondaryNameNode存储数据的目录拷贝到NameNode存储数据的平级目录,并删除in_use.lock文件

[hadoop@hadoop102 dfs]$ scp -r hadoop@hadoop104:/opt/module/hadoop-2.7.2/data/tmp/dfs/namesecondary ./ [hadoop@hadoop102 namesecondary]$ rm -rf in_use.lock [hadoop@hadoop102 dfs]$ pwd /opt/module/hadoop-2.7.2/data/tmp/dfs [hadoop@hadoop102 dfs]$ ls data name namesecondary

5. 导入检查点数据(等待一会ctrl+c结束掉)

[hadoop@hadoop102 hadoop-2.7.2]$ bin/hdfs namenode -importCheckpoint

6. 启动NameNode

[hadoop@hadoop102 hadoop-2.7.2]$ sbin/hadoop-daemon.sh start namenode

1.5、集群安全模式

1.5.1、概述

1)NameNode启动

NameNode启动时,首先将镜像文件(Fsimage)载入内存,并执行编辑日志(Edits)中的各项操作。一旦在内存中成功建立文件系统元数据的映像,则创建一个新的Fsimage文件和一个空的编辑日志。此时,NameNode开始监听DataNode请求。这个过程期间,NameNode一直运行在安全模式,即NameNode的文件系统对于客户端来说是只读的。

2)DataNode启动

系统中的数据块的位置并不是由NameNode维护的,而是以块列表的形式存储在DataNode中。在系统的正常操作期间,NameNode会在内存中保留所有块位置的映射信息。在安全模式下,各个DataNode会向NameNode发送最新的块列表信息,NameNode了解到足够多的块位置信息之后,即可高效运行文件系统。

3)安全模式退出判断

如果满足“最小副本条件”,NameNode会在30秒钟之后就退出安全模式。所谓的最小副本条件指的是在整个文件系统中99.9%的块满足最小副本级别(默认值:dfs.replication.min=1)。在启动一个刚刚格式化的HDFS集群时,因为系统中还没有任何块,所以NameNode不会进入安全模式。

1.5.2、基本语法

集群处于安全模式,不能执行重要操作(写操作)。集群启动完成后,自动退出安全模式。

(1)bin/hdfs dfsadmin -safemode get (功能描述:查看安全模式状态)

(2)bin/hdfs dfsadmin -safemode enter (功能描述:进入安全模式状态)

(3)bin/hdfs dfsadmin -safemode leave (功能描述:离开安全模式状态)

(4)bin/hdfs dfsadmin -safemode wait (功能描述:等待安全模式状态)

[hadoop@hadoop102 hadoop-2.7.2]$ bin/hdfs dfsadmin -safemode get Safe mode is OFF [hadoop@hadoop102 hadoop-2.7.2]$ bin/hdfs dfsadmin -safemode enter Safe mode is ON #安全模式下不能写 [hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -put ./zaiyiqi.txt / put: Cannot create file/zaiyiqi.txt._COPYING_. Name node is in safe mode. [hadoop@hadoop102 hadoop-2.7.2]$ bin/hdfs dfsadmin -safemode leave Safe mode is OFF

1.5.3、模拟等待安全模式

(1)查看当前模式

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfsadmin -safemode get

Safe mode is OFF

(2)先进入安全模式

[hadoop@hadoop102 hadoop-2.7.2]$ bin/hdfs dfsadmin -safemode enter

(3)创建并执行下面的脚本

在/opt/module/hadoop-2.7.2路径上,编辑一个脚本safemode.sh

[hadoop@hadoop102 hadoop-2.7.2]$ touch safemode.sh

[hadoop@hadoop102 hadoop-2.7.2]$ vim safemode.sh

#!/bin/bash

hdfs dfsadmin -safemode wait

hdfs dfs -put /opt/module/hadoop-2.7.2/README.txt /

[hadoop@hadoop102 hadoop-2.7.2]$ chmod 777 safemode.sh

[hadoop@hadoop102 hadoop-2.7.2]$ ./safemode.sh

(4)再打开一个窗口,执行

[hadoop@hadoop102 hadoop-2.7.2]$ bin/hdfs dfsadmin -safemode leave

(5)观察

(a)再观察上一个窗口

Safe mode is OFF

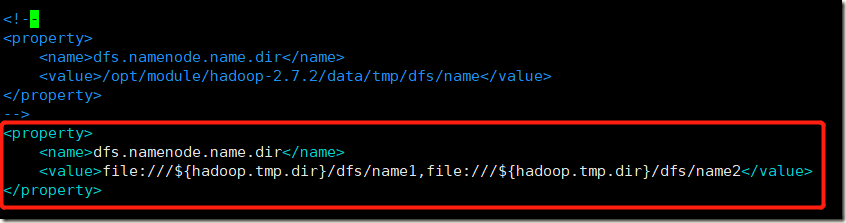

(b)HDFS集群上已经有上传的数据了。1.6、NameNode多目录配置

NameNode的本地目录可以配置成多个,且每个目录存放内容相同,增加了可靠性。具体配置如下

1)在hdfs-site.xml文件中增加如下内容

<property> <name>dfs.namenode.name.dir</name> <value>file:///${hadoop.tmp.dir}/dfs/name1,file:///${hadoop.tmp.dir}/dfs/name2</value> </property>

2)停止集群,删除data和logs中所有数据

[hadoop@hadoop102 hadoop-2.7.2]$ rm -rf data/ logs/ [hadoop@hadoop103 hadoop-2.7.2]$ rm -rf data/ logs/ [hadoop@hadoop104 hadoop-2.7.2]$ rm -rf data/ logs/

3)格式化集群并启动。

[hadoop@hadoop102 hadoop-2.7.2]$ bin/hdfs namenode -format [hadoop@hadoop102 hadoop-2.7.2]$ sbin/start-dfs.sh [hadoop@hadoop103 hadoop-2.7.2]$ sbin/start-yarn.sh

4)查看结果

[hadoop@hadoop102 dfs]$ ll total 0 drwxrwxr-x 3 hadoop hadoop 21 Jan 20 11:31 name1 drwxrwxr-x 3 hadoop hadoop 21 Jan 20 11:31 name2

二、DataNode

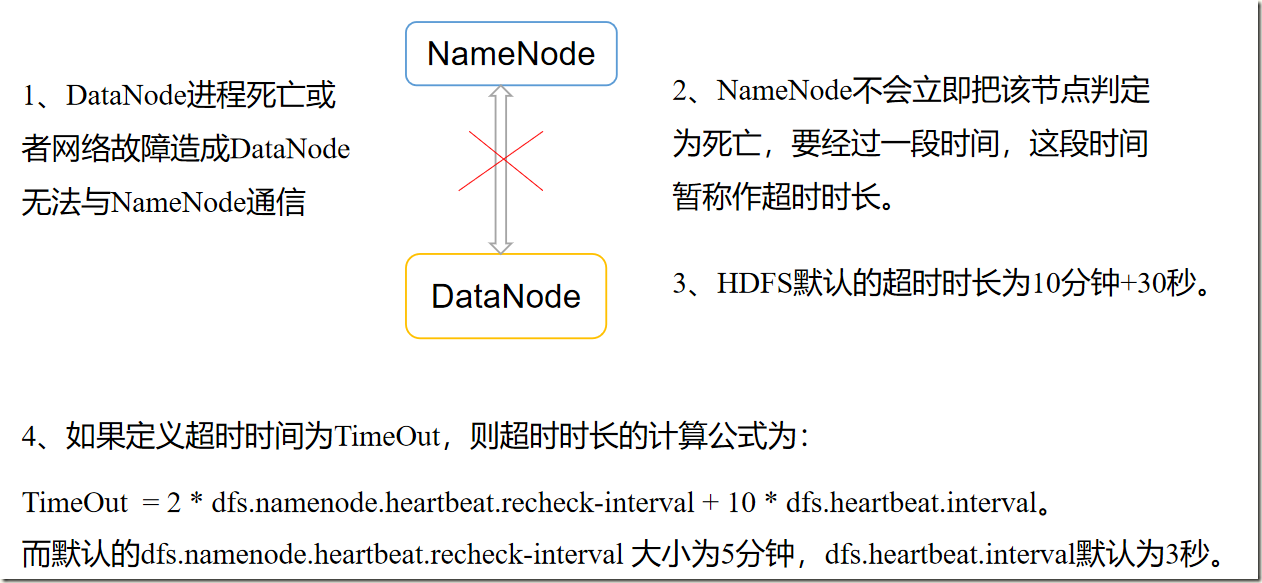

2.1、DataNode工作机制

1)一个数据块在DataNode上以文件形式存储在磁盘上,包括两个文件,一个是数据本身,一个是元数据包括数据块的长度,块数据的校验和,以及时间戳。

2)DataNode启动后向NameNode注册,通过后,周期性(1小时)的向NameNode上报所有的块信息。

3)心跳是每3秒一次,心跳返回结果带有NameNode给该DataNode的命令如复制块数据到另一台机器,或删除某个数据块。如果超过10分钟没有收到某个DataNode的心跳,则认为该节点不可用。

4)集群运行中可以安全加入和退出一些机器。

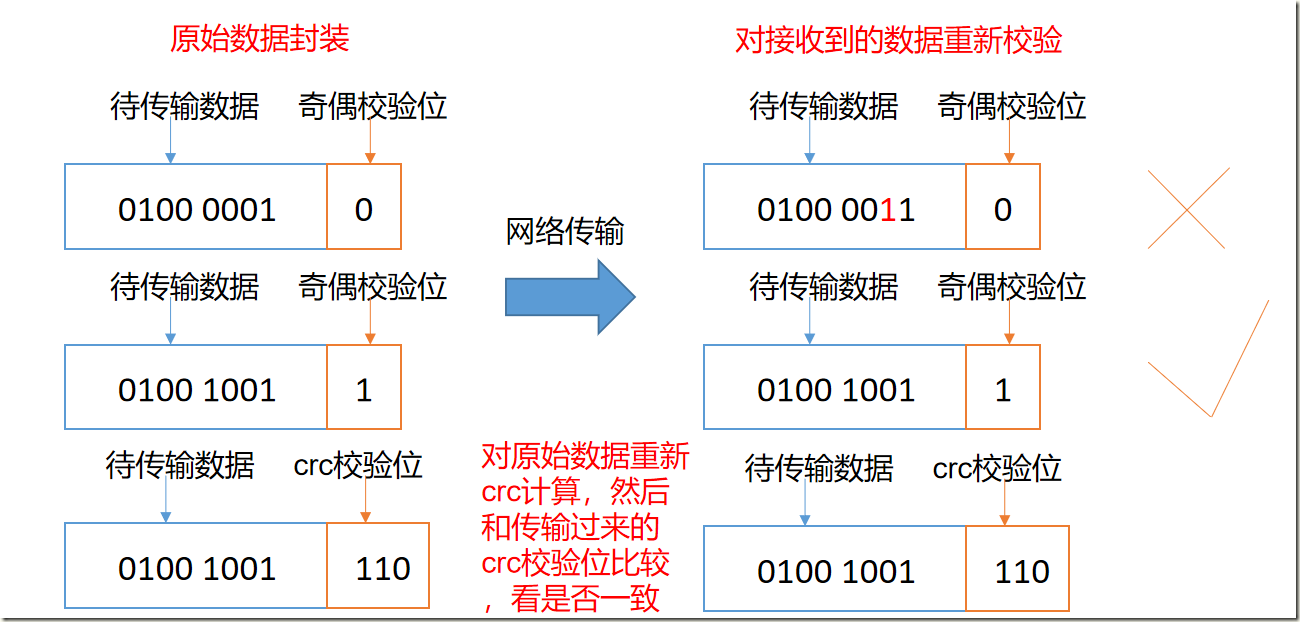

2.2、数据完整性

如下是DataNode节点保证数据完整性的方法。

1)当DataNode读取Block的时候,它会计算CheckSum。

2)如果计算后的CheckSum,与Block创建时值不一样,说明Block已经损坏。

3)Client读取其他DataNode上的Block。

4)DataNode在其文件创建后周期验证CheckSum

2.3、掉线时限参数设置

需要注意的是hdfs-site.xml 配置文件中的heartbeat.recheck.interval的单位为毫秒,dfs.heartbeat.interval的单位为秒。

<property> <name>dfs.namenode.heartbeat.recheck-interval</name> <value>300000</value> </property> <property> <name>dfs.heartbeat.interval</name> <value>3</value> </property>

2.4、服役新数据节点

随着公司业务的增长,数据量越来越大,原有的数据节点的容量已经不能满足存储数据的需求,需要在原有集群基础上动态添加新的数据节点。

1) 环境准备

(1)在hadoop104主机上再克隆一台hadoop105主机

(2)修改IP地址和主机名称

(3)删除原来HDFS文件系统留存的文件(/opt/module/hadoop-2.7.2/data和log)

(4)source一下配置文件

[hadoop@hadoop105 hadoop-2.7.2]$ source /etc/profile

2)直接启动DataNode,即可关联到集群

[hadoop@hadoop105 hadoop-2.7.2]$ sbin/hadoop-daemon.sh start datanode [hadoop@hadoop105 hadoop-2.7.2]$ sbin/yarn-daemon.sh start nodemanager [hadoop@hadoop105 hadoop-2.7.2]$ jps 1441 Jps 1317 NodeManager 1212 DataNode

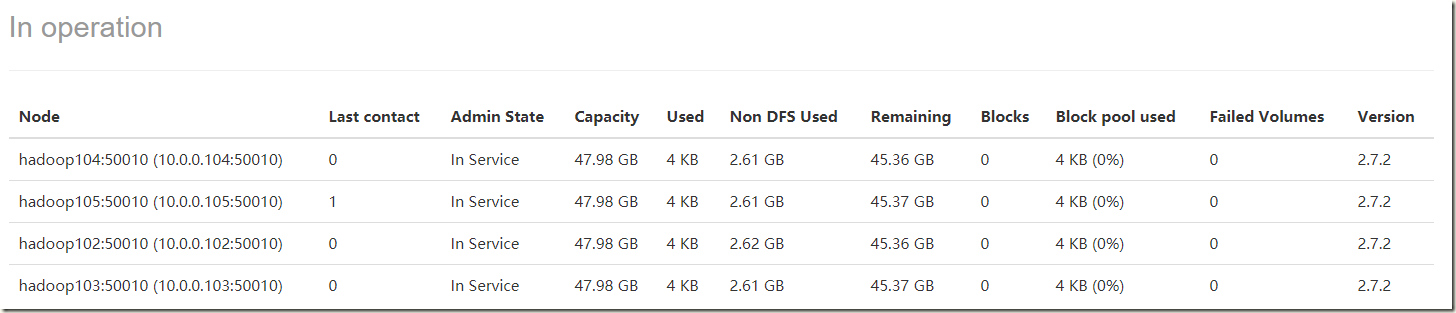

http://hadoop102:50070/dfshealth.html#tab-datanode

3)在hadoop105上上传文件

[hadoop@hadoop105 hadoop-2.7.2]$ hadoop fs -put /opt/module/hadoop-2.7.2/README.txt /

4)如果数据不均衡,可以用命令实现集群的再平衡

[hadoop@hadoop102 hadoop-2.7.2]$ sbin/start-balancer.sh starting balancer, logging to /opt/module/hadoop-2.7.2/logs/hadoop-hadoop-balancer-hadoop102.out Time Stamp Iteration# Bytes Already Moved Bytes Left To Move Bytes Being Moved

2.5、退役旧数据节点

注意:不允许白名单和黑名单中同时出现同一个主机名称。

2.5.1、白名单机制

添加到白名单的主机节点,都允许访问NameNode,不在白名单的主机节点,都会被退出。

配置白名单的具体步骤如下:

1)在NameNode的/opt/module/hadoop-2.7.2/etc/hadoop目录下创建dfs.hosts文件

[hadoop@hadoop102 hadoop]$ pwd /opt/module/hadoop-2.7.2/etc/hadoop [hadoop@hadoop102 hadoop]$ touch dfs.hosts [hadoop@hadoop102 hadoop]$ vi dfs.hosts #添加如下主机名称(不添加hadoop105) hadoop102 hadoop103 hadoop104

2)在NameNode的hdfs-site.xml配置文件中增加dfs.hosts属性

<property> <name>dfs.hosts</name> <value>/opt/module/hadoop-2.7.2/etc/hadoop/dfs.hosts</value> </property>

3)配置文件分发

[hadoop@hadoop102 hadoop]$ xsync hdfs-site.xml

4)刷新NameNode

[hadoop@hadoop102 hadoop]$ hdfs dfsadmin -refreshNodes Refresh nodes successful

5)更新ResourceManager节点

[hadoop@hadoop102 hadoop]$ yarn rmadmin -refreshNodes 21/01/20 14:44:35 INFO client.RMProxy: Connecting to ResourceManager at hadoop103/10.0.0.103:8033

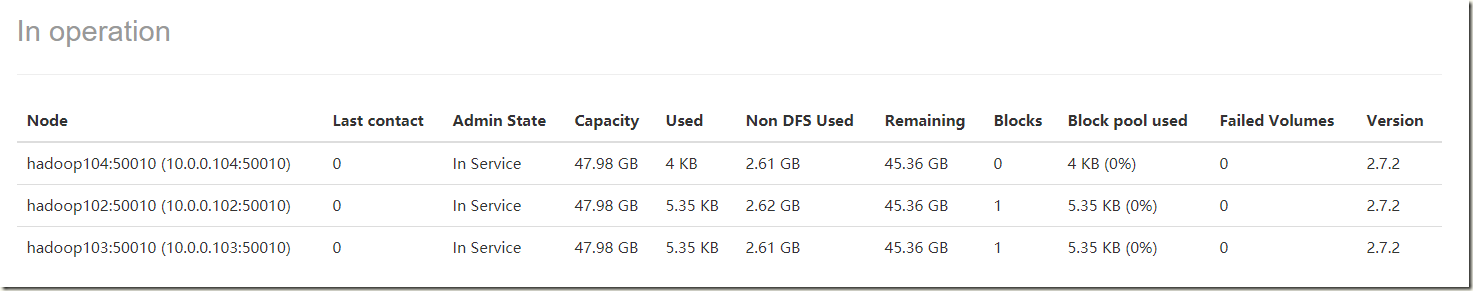

6)在web浏览器上查看

如果数据不均衡,可以用命令实现集群的再平衡

[hadoop@hadoop102 hadoop-2.7.2]$ sbin/start-balancer.sh

2.5.2、黑名单机制

在黑名单上面的主机都会被强制退出。

1)在NameNode的/opt/module/hadoop-2.7.2/etc/hadoop目录下创建dfs.hosts.exclude文件

[hadoop@hadoop102 hadoop]$ pwd /opt/module/hadoop-2.7.2/etc/hadoop [hadoop@hadoop102 hadoop]$ touch dfs.hosts.exclude [hadoop@hadoop102 hadoop]$ vi dfs.hosts.exclude #添加如下主机名称(要退役的节点) hadoop105

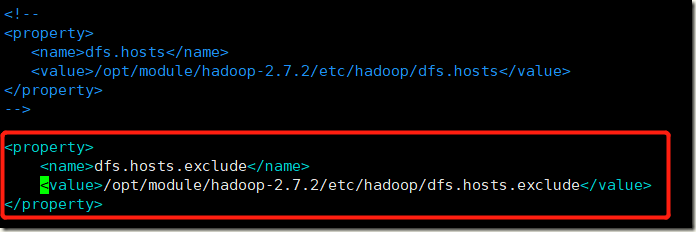

2)在NameNode的hdfs-site.xml配置文件中增加dfs.hosts.exclude属性

<property> <name>dfs.hosts.exclude</name> <value>/opt/module/hadoop-2.7.2/etc/hadoop/dfs.hosts.exclude</value> </property>

3)配置文件分发

[hadoop@hadoop102 hadoop]$ xsync hdfs-site.xml

4)刷新NameNode、刷新ResourceManager

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfsadmin -refreshNodes [hadoop@hadoop102 hadoop-2.7.2]$ yarn rmadmin -refreshNodes

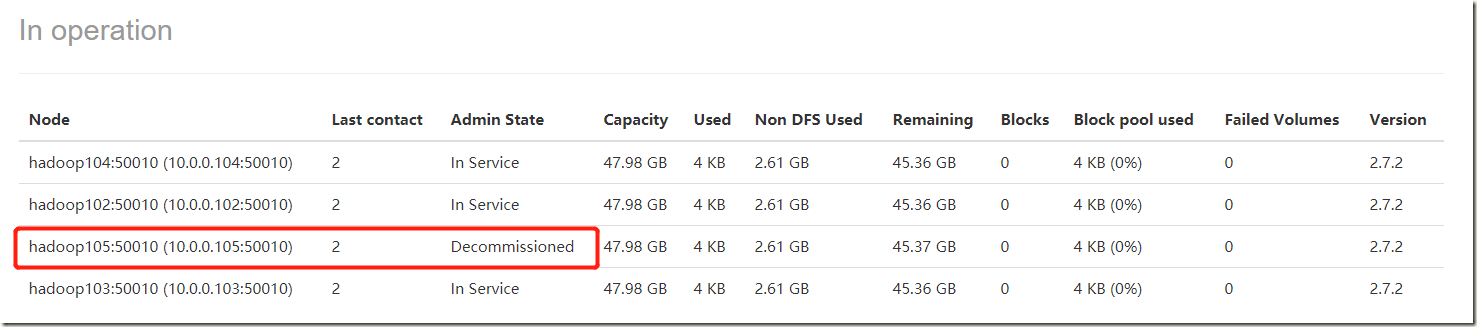

5)检查Web浏览器,退役节点的状态为decommission in progress(退役中),说明数据节点正在复制块到其他节点。等待退役节点状态为decommissioned(所有块已经复制完成),停止该节点及节点资源管理器。注意:如果副本数是3,服役的节点小于等于3,是不能退役成功的,需要修改副本数后才能退役

[hadoop@hadoop105 hadoop-2.7.2]$ sbin/hadoop-daemon.sh stop datanode stopping datanode [hadoop@hadoop105 hadoop-2.7.2]$ sbin/yarn-daemon.sh stop nodemanager stopping nodemanager

6)如果数据不均衡,可以用命令实现集群的再平衡

[hadoop@hadoop102 hadoop-2.7.2]$ sbin/start-balancer.sh

2.6、Datanode多目录配置

1)DataNode也可以配置成多个目录,每个目录存储的数据不一样。即:数据不是副本

2)具体配置如下:hdfs-site.xml

<property> <name>dfs.datanode.data.dir</name> <value>file:///${hadoop.tmp.dir}/dfs/data1,file:///${hadoop.tmp.dir}/dfs/data2</value> </property>

三、HDFS 2.X新特性

3.1、集群间数据拷贝

采用distcp命令实现两个Hadoop集群之间的递归数据复制

[hadoop@hadoop102 hadoop-2.7.2]$ bin/hadoop distcp hdfs://haoop102:9000/user/atguigu/hello.txt hdfs://hadoop103:9000/user/atguigu/hello.txt

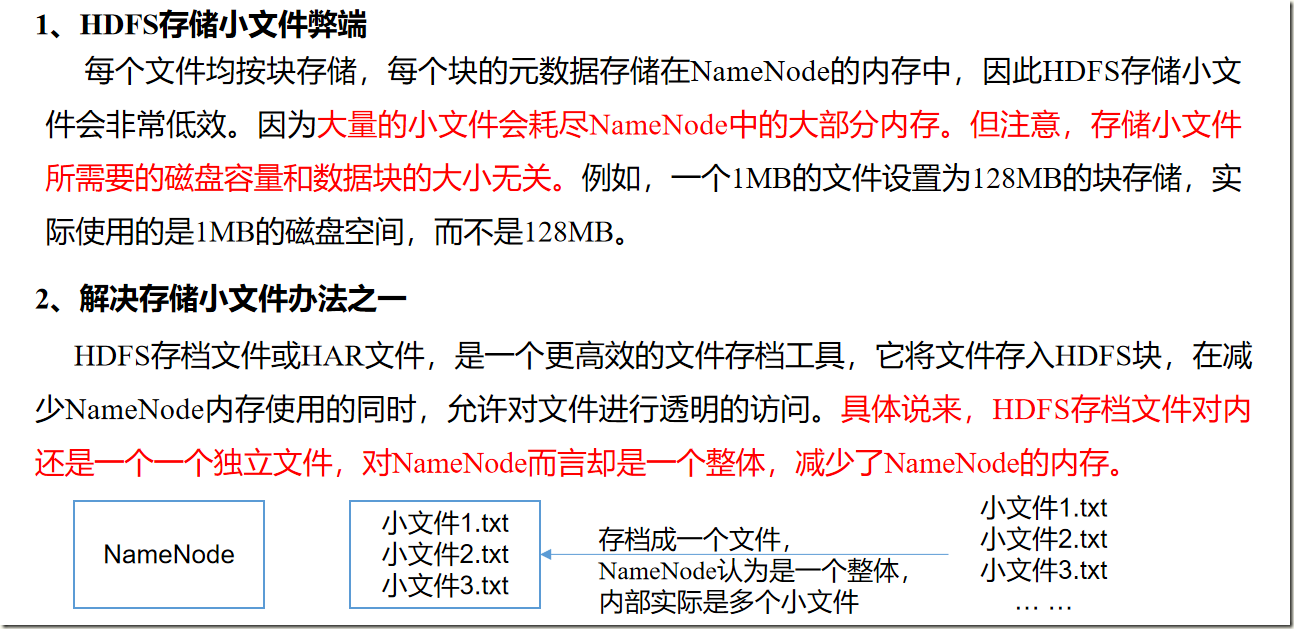

3.2、小文件存档

1)需要启动YARN进程

[hadoop@hadoop102 hadoop-2.7.2]$ start-yarn.sh

2)归档文件

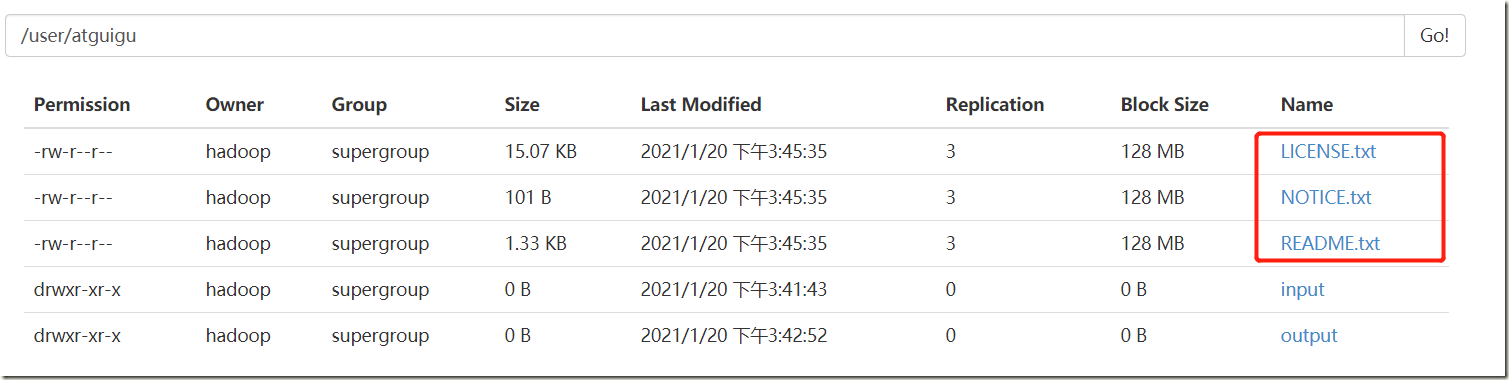

把/user/atguigu/input目录里面的所有文件归档成一个叫input.har的归档文件,并把归档后文件存储到/user/atguigu/output路径下。

[hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -mkdir -p /user/atguigu/input [hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -put ./README.txt /user/atguigu/input [hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -put ./NOTICE.txt /user/atguigu/input [hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -put ./LICENSE.txt /user/atguigu/input #归档 [hadoop@hadoop102 hadoop-2.7.2]$ bin/hadoop archive -archiveName input.har -p /user/atguigu/input /user/atguigu/output

3)查看归档

[hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -ls -R /user/atguigu/output/input.har -rw-r--r-- 3 hadoop supergroup 0 2021-01-20 15:43 /user/atguigu/output/input.har/_SUCCESS -rw-r--r-- 5 hadoop supergroup 302 2021-01-20 15:43 /user/atguigu/output/input.har/_index -rw-r--r-- 5 hadoop supergroup 23 2021-01-20 15:43 /user/atguigu/output/input.har/_masterindex -rw-r--r-- 3 hadoop supergroup 16896 2021-01-20 15:42 /user/atguigu/output/input.har/part-0 [hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -ls -R har:///user/atguigu/output/input.har -rw-r--r-- 3 hadoop supergroup 15429 2021-01-20 15:41 har:///user/atguigu/output/input.har/LICENSE.txt -rw-r--r-- 3 hadoop supergroup 101 2021-01-20 15:41 har:///user/atguigu/output/input.har/NOTICE.txt -rw-r--r-- 3 hadoop supergroup 1366 2021-01-20 15:41 har:///user/atguigu/output/input.har/README.txt

4)解归档文件

[hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -cp har:///user/atguigu/output/input.har/* /user/atguigu

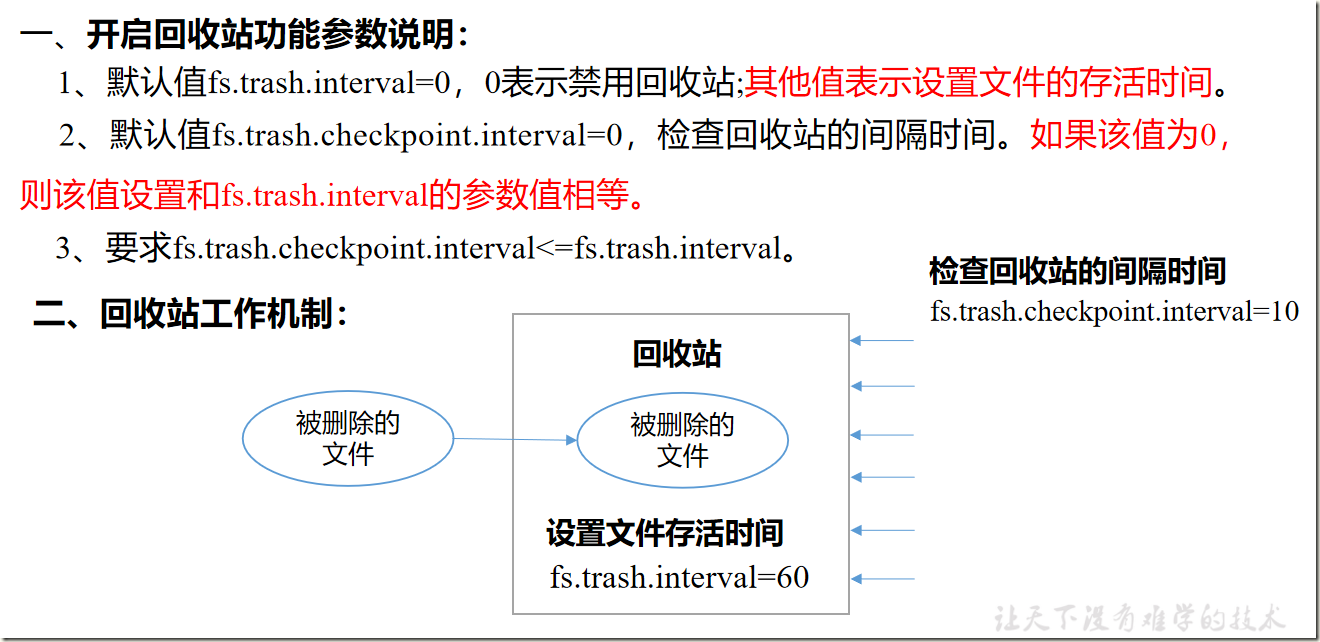

3.3、回收站

开启回收站功能,可以将删除的文件在不超时的情况下,恢复原数据,起到防止误删除、备份等作用

1)启用回收站,修改访问垃圾回收站用户名称

<property> <name>fs.trash.interval</name> <value>1</value> </property> <property> <name>hadoop.http.staticuser.user</name> <value>hadoop</value> </property>

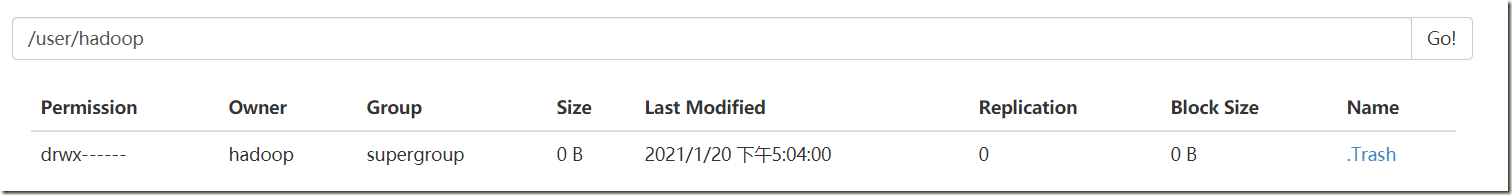

2)查看回收站

回收站在集群中的路径:/user/hadoop/.Trash/….

3)通过程序删除的文件不会经过回收站,需要调用moveToTrash()才进入回收站

Trash trash = New Trash(conf); trash.moveToTrash(path);

4)测试

[hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -put ./README.txt / [hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -rm -f /README.txt 21/01/20 17:07:30 INFO fs.TrashPolicyDefault: Namenode trash configuration: Deletion interval = 1 minutes, Emptier interval = 0 minutes. Moved: 'hdfs://hadoop102:9000/README.txt' to trash at: hdfs://hadoop102:9000/user/hadoop/.Trash/Current #从回收站恢复 [hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs -mv /user/hadoop/.Trash/Current/README.txt /README.txt

5)清空回收站

[hadoop@hadoop102 hadoop-2.7.2]$ hadoop fs –expunge

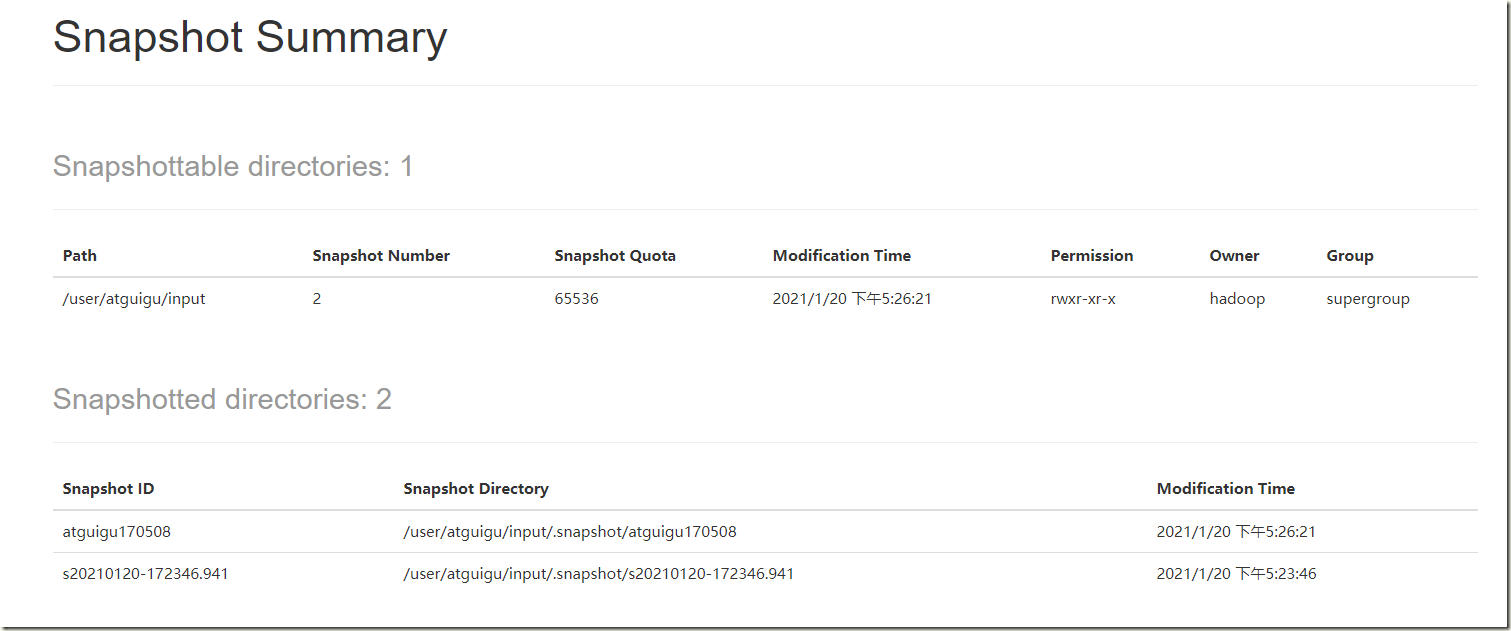

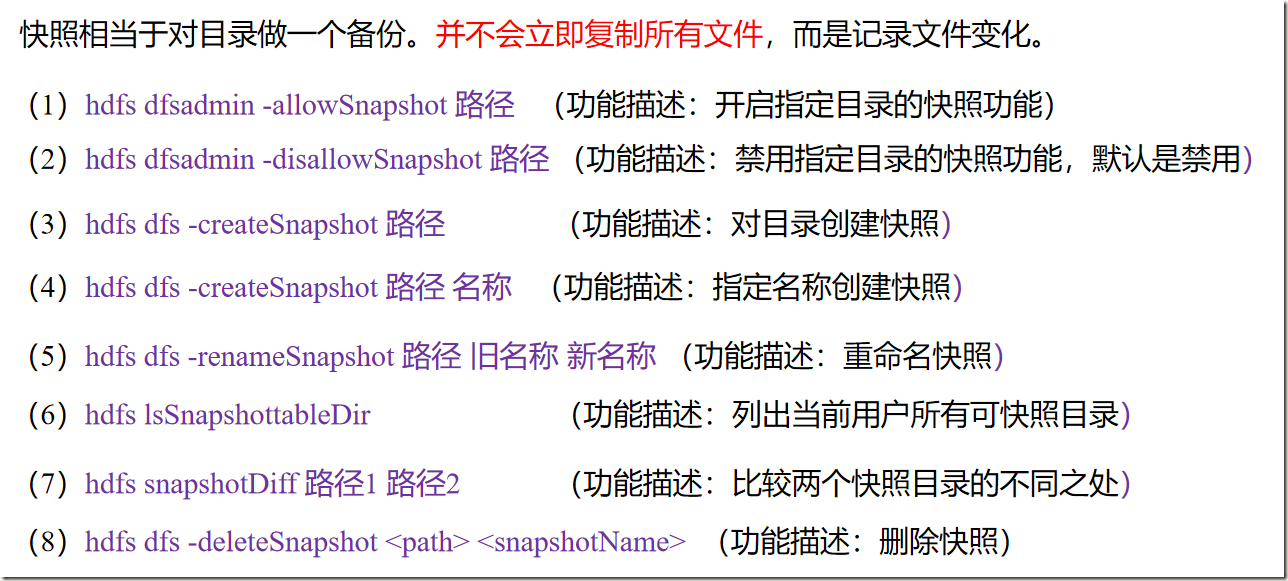

3.4、快照管理

1)开启/禁用指定目录的快照功能

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfsadmin -allowSnapshot /user/atguigu/input Allowing snaphot on /user/atguigu/input succeeded [hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfsadmin -disallowSnapshot /user/atguigu/input Disallowing snaphot on /user/atguigu/input succeeded

2)对目录创建快照

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfs -createSnapshot /user/atguigu/input Created snapshot /user/atguigu/input/.snapshot/s20210120-172346.941

通过web访问hdfs://hadoop102:50070/user/atguigu/input/.snapshot/s…..

快照和源文件使用相同数据

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfs -ls -R /user/atguigu/input/.snapshot/ drwxr-xr-x - hadoop supergroup 0 2021-01-20 17:23 /user/atguigu/input/.snapshot/s20210120-172346.941 -rw-r--r-- 3 hadoop supergroup 15429 2021-01-20 15:41 /user/atguigu/input/.snapshot/s20210120-172346.941/LICENSE.txt -rw-r--r-- 3 hadoop supergroup 101 2021-01-20 15:41 /user/atguigu/input/.snapshot/s20210120-172346.941/NOTICE.txt -rw-r--r-- 3 hadoop supergroup 1366 2021-01-20 15:41 /user/atguigu/input/.snapshot/s20210120-172346.941/README.txt

3)指定名称创建快照

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfs -createSnapshot /user/atguigu/input miao170508 Created snapshot /user/atguigu/input/.snapshot/miao170508

4)重命名快照

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfs -renameSnapshot /user/atguigu/input/ miao170508 atguigu170508

5)列出当前用户所有可快照目录

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs lsSnapshottableDir drwxr-xr-x 0 hadoop supergroup 0 2021-01-20 17:26 2 65536 /user/atguigu/input

6)比较两个快照目录的不同之处

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs snapshotDiff /user/atguigu/input/ . .snapshot/atguigu170508

7)恢复快照

[hadoop@hadoop102 hadoop-2.7.2]$ hdfs dfs -cp /user/atguigu/input/.snapshot/s20210120-172346.941 /user