一 Thread类继承式创建

#继承Thread式创建

import threading

import time

class MyThread(threading.Thread):

def __init__(self,num):

threading.Thread.__init__(self)

self.num=num

def run(self):

print("running on number:%s" %self.num)

time.sleep(3)

t1=MyThread(56)

t2=MyThread(78)

t1.start()

t2.start()

print("ending")

二 GIL(全局解释器锁)

'''

定义: In CPython, the global interpreter lock, or GIL, is a mutex that prevents multiple native threads from executing Python bytecodes at once. This lock is necessary mainly because CPython’s memory management is not thread-safe. (However, since the GIL exists, other features have grown to depend on the guarantees that it enforces.) '''

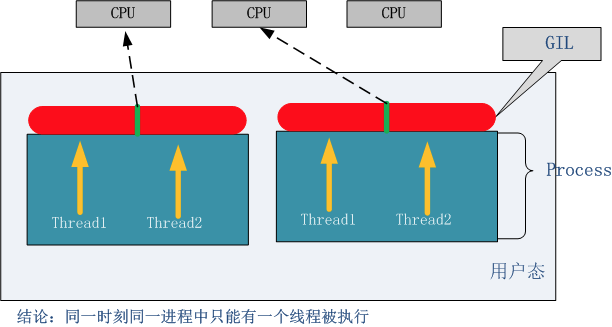

Python中的线程是操作系统的原生线程,Python虚拟机使用一个全局解释器锁(Global Interpreter Lock)来互斥线程对Python虚拟机的使用。为了支持多线程机制,一个基本的要求就是需要实现不同线程对共享资源访问的互斥,所以引入了GIL。

GIL:在一个线程拥有了解释器的访问权之后,其他的所有线程都必须等待它释放解释器的访问权,即使这些线程的下一条指令并不会互相影响。

在调用任何Python C API之前,要先获得GIL

GIL缺点:多处理器退化为单处理器;优点:避免大量的加锁解锁操作

1.1 GIL的早期设计

Python支持多线程,而解决多线程之间数据完整性和状态同步的最简单方法自然就是加锁。 于是有了GIL这把超级大锁,而当越来越多的代码库开发者接受了这种设定后,他们开始大量依赖这种特性(即默认python内部对象是thread-safe的,无需在实现时考虑额外的内存锁和同步操作)。慢慢的这种实现方式被发现是蛋疼且低效的。但当大家试图去拆分和去除GIL的时候,发现大量库代码开发者已经重度依赖GIL而非常难以去除了。有多难?做个类比,像MySQL这样的“小项目”为了把Buffer Pool Mutex这把大锁拆分成各个小锁也花了从5.5到5.6再到5.7多个大版为期近5年的时间,并且仍在继续。MySQL这个背后有公司支持且有固定开发团队的产品走的如此艰难,那又更何况Python这样核心开发和代码贡献者高度社区化的团队呢?

1.2 GIL的影响

无论你启多少个线程,你有多少个cpu, Python在执行一个进程的时候会淡定的在同一时刻只允许一个线程运行。

所以,python是无法利用多核CPU实现多线程的。

这样,python对于计算密集型的任务开多线程的效率甚至不如串行(没有大量切换),但是,对于IO密集型的任务效率还是有显著提升的。

计算密集型:

#coding:utf8

from threading import Thread

import time

def counter():

i = 0

for _ in range(50000000):

i = i + 1

return True

def main():

l=[]

start_time = time.time()

for i in range(2):

t = Thread(target=counter)

t.start()

l.append(t)

t.join()

# for t in l:

# t.join()

end_time = time.time()

print("Total time: {}".format(end_time - start_time))

if __name__ == '__main__':

main()

'''

py2.7:

串行:25.4523348808s

并发:31.4084379673s

py3.5:

串行:8.62115597724914s

并发:8.99609899520874s

'''

1.3 解决方案

用multiprocessing替代Thread multiprocessing库的出现很大程度上是为了弥补thread库因为GIL而低效的缺陷。它完整的复制了一套thread所提供的接口方便迁移。唯一的不同就是它使用了多进程而不是多线程。每个进程有自己的独立的GIL,因此也不会出现进程之间的GIL争抢。

#coding:utf8

from multiprocessing import Process

import time

def counter():

i = 0

for _ in range(40000000):

i = i + 1

return True

def main():

l=[]

start_time = time.time()

for _ in range(2):

t=Process(target=counter)

t.start()

l.append(t)

#t.join()

for t in l:

t.join()

end_time = time.time()

print("Total time: {}".format(end_time - start_time))

if __name__ == '__main__':

main()

'''

py2.7:

串行:6.1565990448 s

并行:3.1639978885 s

py3.5:

串行:6.556925058364868 s

并发:3.5378448963165283 s

'''

当然multiprocessing也不是万能良药。它的引入会增加程序实现时线程间数据通讯和同步的困难。就拿计数器来举例子,如果我们要多个线程累加同一个变量,对于thread来说,申明一个global变量,用thread.Lock的context包裹住三行就搞定了。而multiprocessing由于进程之间无法看到对方的数据,只能通过在主线程申明一个Queue,put再get或者用share memory的方法。这个额外的实现成本使得本来就非常痛苦的多线程程序编码,变得更加痛苦了。

总结:因为GIL的存在,只有IO Bound场景下得多线程会得到较好的性能 - 如果对并行计算性能较高的程序可以考虑把核心部分也成C模块,或者索性用其他语言实现 - GIL在较长一段时间内将会继续存在,但是会不断对其进行改进。

所以对于GIL,既然不能反抗,那就学会去享受它吧!

2 同步锁 (Lock)

import time

import threading

def addNum():

global num #在每个线程中都获取这个全局变量

#num-=1

temp=num

time.sleep(0.1)

num =temp-1 # 对此公共变量进行-1操作

num = 100 #设定一个共享变量

thread_list = []

for i in range(100):

t = threading.Thread(target=addNum)

t.start()

thread_list.append(t)

for t in thread_list: #等待所有线程执行完毕

t.join()

print('Result: ', num)

锁通常被用来实现对共享资源的同步访问。为每一个共享资源创建一个Lock对象,当你需要访问该资源时,调用acquire方法来获取锁对象(如果其它线程已经获得了该锁,则当前线程需等待其被释放),待资源访问完后,再调用release方法释放锁:

扩展思考

'''

1、为什么有了GIL,还需要线程同步?

多线程环境下必须存在资源的竞争,那么如何才能保证同一时刻只有一个线程对共享资源进行存取?

加锁, 对, 加锁可以保证存取操作的唯一性, 从而保证同一时刻只有一个线程对共享数据存取.

通常加锁也有2种不同的粒度的锁:

coarse-grained(粗粒度): python解释器层面维护着一个全局的锁机制,用来保证线程安全。

内核级通过GIL实现的互斥保护了内核的共享资源。

fine-grained(细粒度): 那么程序员需要自行地加,解锁来保证线程安全,

用户级通过自行加锁保护的用户程序的共享资源。

2、GIL为什么限定在一个进程上?

你写一个py程序,运行起来本身就是一个进程,这个进程是有解释器来翻译的,所以GIL限定在当前进程;

如果又创建了一个子进程,那么两个进程是完全独立的,这个字进程也是有python解释器来运行的,所以

这个子进程上也是受GIL影响的

'''

3 死锁与递归锁

所谓死锁: 是指两个或两个以上的进程或线程在执行过程中,因争夺资源而造成的一种互相等待的现象,若无外力作用,它们都将无法推进下去。此时称系统处于死锁状态或系统产生了死锁,这些永远在互相等待的进程称为死锁进程。

import threading

import time

mutexA = threading.Lock()

mutexB = threading.Lock()

class MyThread(threading.Thread):

def __init__(self):

threading.Thread.__init__(self)

def run(self):

self.fun1()

self.fun2()

def fun1(self):

mutexA.acquire() # 如果锁被占用,则阻塞在这里,等待锁的释放

print ("I am %s , get res: %s---%s" %(self.name, "ResA",time.time()))

mutexB.acquire()

print ("I am %s , get res: %s---%s" %(self.name, "ResB",time.time()))

mutexB.release()

mutexA.release()

def fun2(self):

mutexB.acquire()

print ("I am %s , get res: %s---%s" %(self.name, "ResB",time.time()))

time.sleep(0.2)

mutexA.acquire()

print ("I am %s , get res: %s---%s" %(self.name, "ResA",time.time()))

mutexA.release()

mutexB.release()

if __name__ == "__main__":

print("start---------------------------%s"%time.time())

for i in range(0, 10):

my_thread = MyThread()

my_thread.start()

在Python中为了支持在同一线程中多次请求同一资源,python提供了可重入锁RLock。这个RLock内部维护着一个Lock和一个counter变量,counter记录了acquire的次数,从而使得资源可以被多次require。直到一个线程所有的acquire都被release,其他的线程才能获得资源。上面的例子如果使用RLock代替Lock,则不会发生死锁:

4 Semaphore(信号量)

Semaphore管理一个内置的计数器,

每当调用acquire()时内置计数器-1;

调用release() 时内置计数器+1;

计数器不能小于0;当计数器为0时,acquire()将阻塞线程直到其他线程调用release()。

实例:(同时只有5个线程可以获得semaphore,即可以限制最大连接数为5):

import threading

import time

semaphore = threading.Semaphore(5)

def func():

if semaphore.acquire():

print (threading.currentThread().getName() + ' get semaphore')

time.sleep(2)

semaphore.release()

for i in range(20):

t1 = threading.Thread(target=func)

t1.start()

应用:连接池