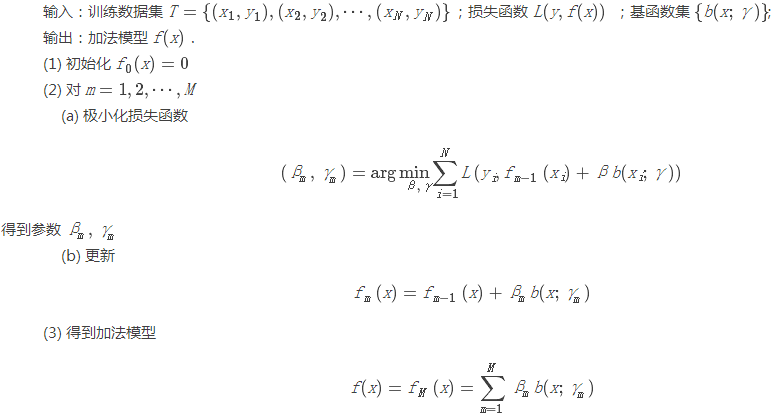

前向分步算法与加法模型(forward stagewise algorithm and additive model)

(1) AdaBoost:前向分步算法中损失函数取指数损失函数

(2) LogitBoost:前向分步算法中损失函数取的是Logistic Loss

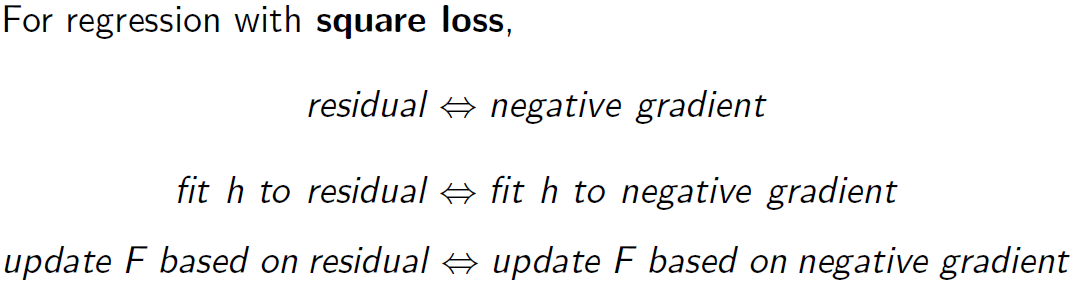

(3) GradientBoosting(梯度提升):当损失函数是平方损失和指数损失函数时,每一步优化是很简单的。比如对于平方损失函数,第二步a中的极小化可以转化为找到 ,使其拟合数据的残差。但对一般损失函数而言,往往每一步优化并不那么容易。而GradientBoosting,是利用最速下降法的近似方法,其关键是利用损失函数的负梯度在当前模型的值作为回归问题提升树算法中的残差的近似值,拟合一个回归树

,使其拟合数据的残差。但对一般损失函数而言,往往每一步优化并不那么容易。而GradientBoosting,是利用最速下降法的近似方法,其关键是利用损失函数的负梯度在当前模型的值作为回归问题提升树算法中的残差的近似值,拟合一个回归树