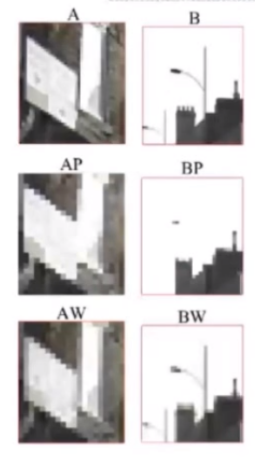

深度学习中的下采样(max-pooing, average-pooling, strided-convolution)通常会有两个不足:破坏了目标的基本结构、放大随机噪声。上采样操作同样容易受到影响。下面给出一个图示,A和B是两个区域,AP是max-pooling的结果,AW是小波处理的结果,可以看到max-pooling导致了结构的损失。而离散小波变换的处理结果要好很多,窗户的边缘和柱子的形状仍然保持的非常好。

离散小波变换可以把图像分解为一个低频分量\(X_{ll}\),和三个高频分量\(X_{hl}, X_{lh}, X_{hh}\),三个高频成分保持了图像的细节信息,如果图像的噪声,噪声也是高频信息,保留在高频分量里面。各个分量如下图所示:

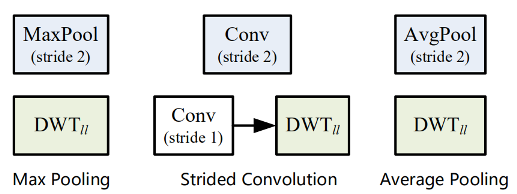

在网络中,作者主要使用了三种操作替换,MaxPool 和 AvgPool 用 DWT\(_{ll}\) 替换,步长为2有卷积用步长为1的 DWT\(_{ll}\) 替换。下图所示:

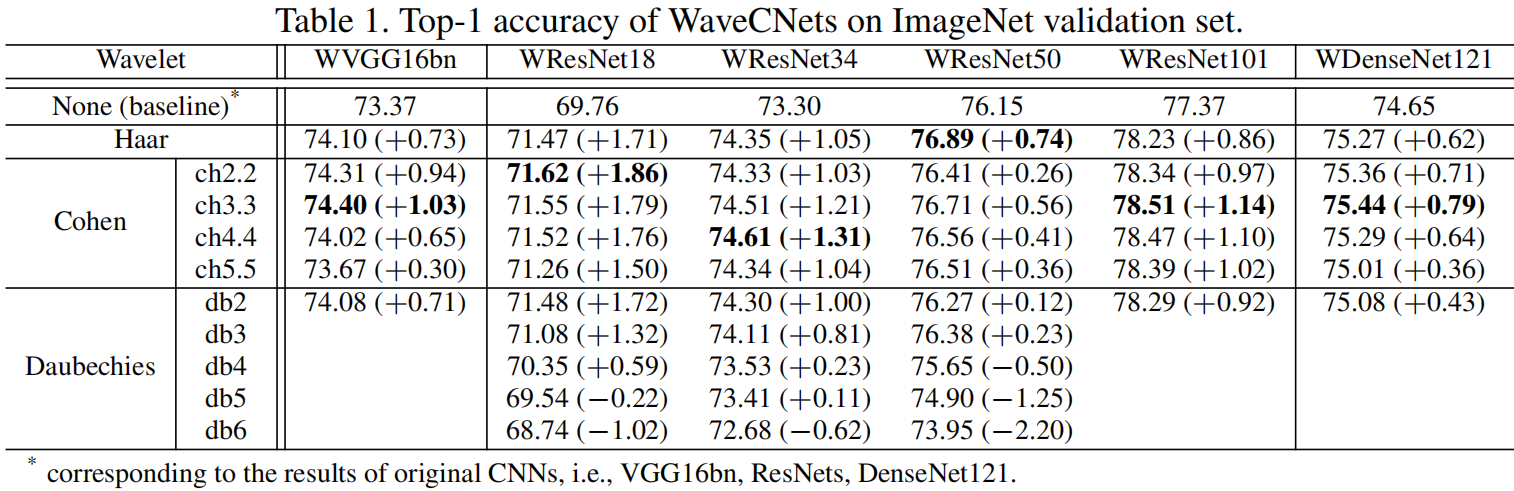

在实验中,作者在ImageNet数据集上测试了三种小波,包括Haar小波,Cohen小波,Daubechies小波,可以看到Haar和Cohen可以提高分类的性能。Daubechies是一种非对称的小波,有时候会降低分类的性能。

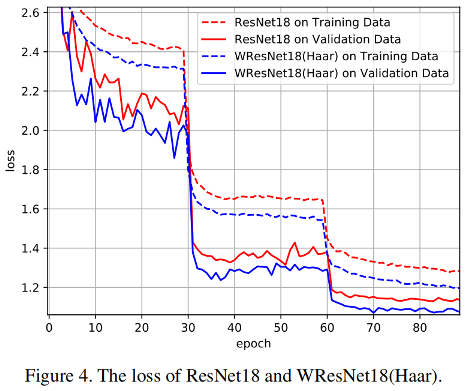

同时,从loss上可以看出,加入小波以后,可以加速网络的训练。

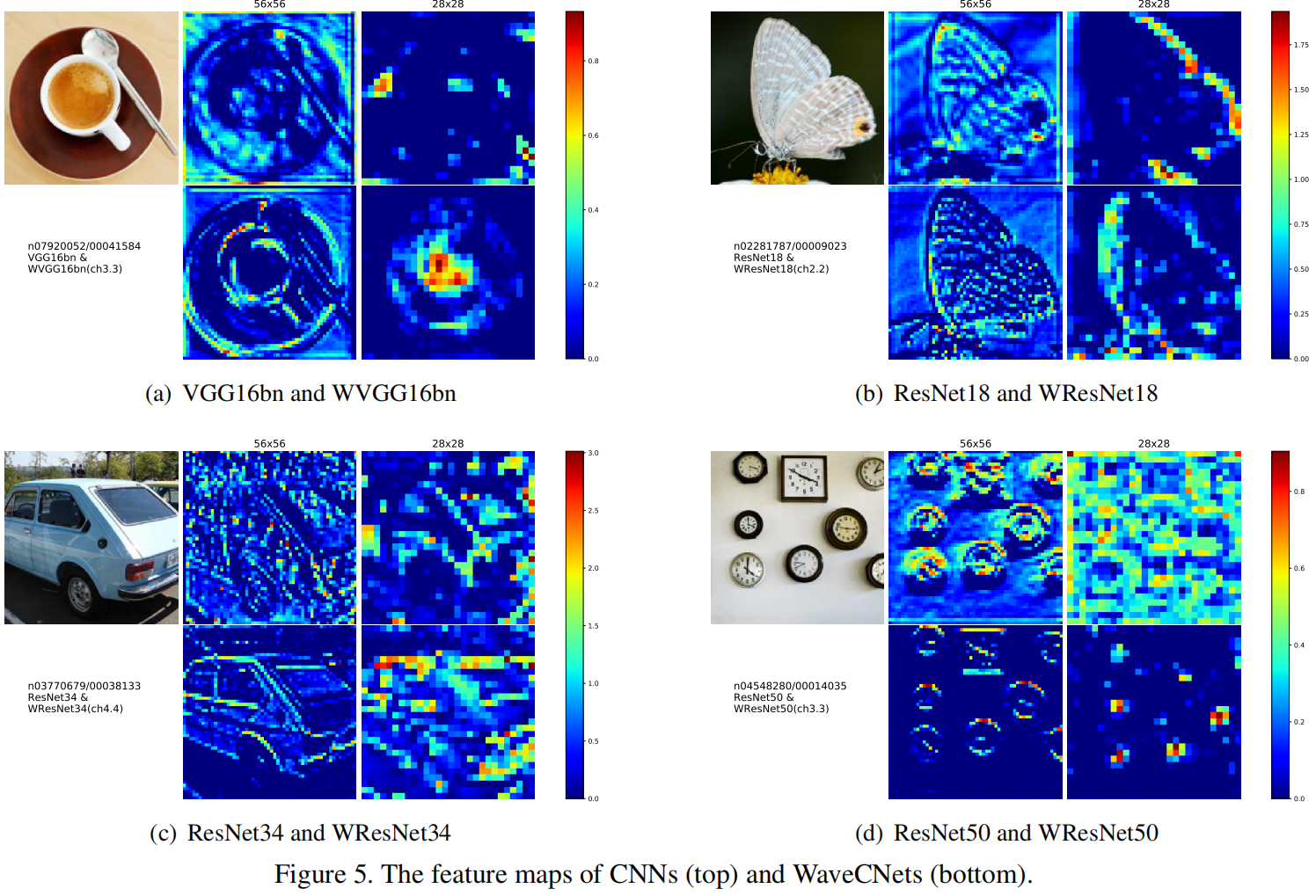

下图是一个可视化的结果,每个子图的第一行是原网络的feature map,第二行是加入小波以后输出的feature map。从图中可以看出,原来的CNN网络输出的 feature map,背景含的噪声更多一些,目标结构被破坏的比较严重。加入小波以后,背景噪声明显被抵制,同时目标的结构更加完整。