Spark集群搭建

一、环境说明

1、机器:3台虚机(hadoop01/hadoop02/hadoop03)

2、Linux版本:CentOS 6.5

3、JDK版本:1.8

4、Hadoop版本:hadoop-2.5.2

5、Spark版本:Spark-1.3.1

6、Scala版本:scala-2.10.6

二、安装步骤

1、安装Hadoop,这里不做具体讲解

172.16.1.156 hadoop01

172.16.1.157 hadoop02

172.16.1.158 hadoop03

2、下载Spark

如果是基于Hadoop部署spark,可以对应hadoop的版本下载spark

下载地址:http://spark.apache.org/downloads.html

3、下载Scala

下载地址:http://www.scala-lang.org/download/2.10.6.html

4、安装Scala

解压:tar -zxvf scala-2.10.6.tgz

5.安装spark

解压:tar -zxvf spark-1.3.1-bin-hadoop2.4.tgz

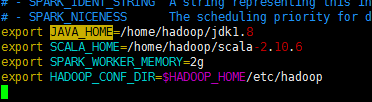

6、在~/.bash_profile中配置环境变量

QQ截图20160427162720.png

7、配置spark_env.sh(Spark运行的环境变量)

修改spark_env.sh.template复制为spark_env.sh

mv spark_env.sh.template spark_env.sh

配置以上环境变量

export JAVA_HOME=/home/hadoop/jdk1.8

export SPARK_MASTER_IP=spark01

export SPARK_MASTER_PORT=7077

export SPARK_WORKER_CORES=1

export SPARK_WORKER_INSTANCES=1

8、复制hadoop01节点配置好的spark到其他节点

scp -r ~/spark-1.3.1-bin-hadoop2.4/ hadoop@hadoop02:~/

scp -r ~/spark-1.3.1-bin-hadoop2.4/ hadoop@hadoop03:~/

9.spark的web管理界面 :http://172.16.1.156:8080/

spark WEBUI界面:http://172.16.1.156:4040/jobs/

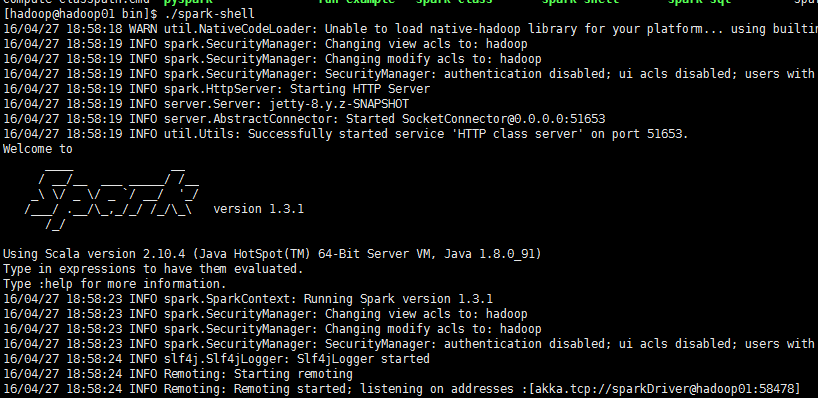

spark-shell启动:

到spark的bin目录下执行 ./spark-shell