通常说的SVM与逻辑回归的联系一般指的是软间隔的SVM与逻辑回归之间的关系,硬间隔的SVM应该是与感知机模型的区别和联系。而且工程中也不能要求所有的点都正确分类,训练数据中噪声的存在使得完全正确分类很可能造成过拟合。

软间隔SVM与逻辑回归的联系

要说软间隔SVM与联系就要看软间隔SVM的缘由。

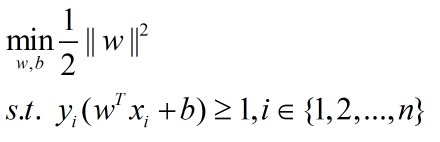

软间隔SVM表示样本数据不必要求全部正确分类,允许少量的数据点犯错。于是将硬间隔SVM的优化目标由:

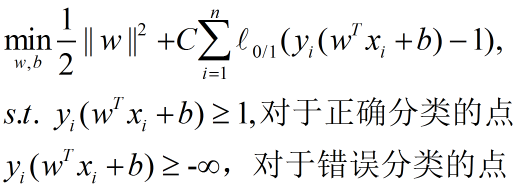

变成硬间隔的优化目标:

在上面的优化目标中加上了惩罚项,C越大惩罚越大允许的错误越小。但是直接使用0/1损失函数的话其非凸、非连续,数学性质不好优化起来比较复杂,因此需要使用其他的数学性能较好的函数进行替换,替代损失函数一般有较好的数学性质。常用的三种替代函数:

1、hinge损失:![]()

2、指数损失:![]()

3、对吕损失:![]()

一般的软间隔SVM采用的是hinge损失函数进行替代,可以得到常见的软件的SVM的优化目标函数。如果采用的是对率损失函数进行替代那么就和逻辑回归的优化目标几乎相同,这就得到了软间隔SVM与逻辑回归的数学上的联系,因此一般来说SVM的性能和逻辑回归的性能差不多。

软间隔SVM与逻辑回归的区别

1、逻辑回归通过输出预测概率后根据阈值进行判断类别,SVM则直接输出分割超平面,然后使用0/1函数对距离进行分类,不能直接输出概率值,如果需要SVM输出概率值则需要进行特殊处理,可以根据距离的大小进行归一化概率输出。

2、逻辑回归可以使用多阈值然后进行多分类,SVM则需要进行推广。

3、SVM在训练过程只需要支持向量的,依赖的训练样本数较小,而逻辑回归则是需要全部的训练样本数据,在训练时开销更大。